ネモ・ガードレールAIの安全性と信頼性を高める

この記事では、ネモ・ガードレールとは何か、その実用的なアプリケーションとその統合について詳しく説明します。

シリーズ全体を読む

- 交差エントロピー損失:機械学習におけるその役割を解明する

- バッチとレイヤーの正規化 - ニューラルネットワークの効率性を引き出す

- ベクトル・データベースによるAIと機械学習の強化

- ラングチェーンツール先進のツールセットでAI開発に革命を起こす

- ベクターデータベース検索テクノロジーの未来を再定義する

- ローカル感度ハッシング (L.S.H.):包括的ガイド

- AIの最適化:安定した普及と効率的なキャッシュ戦略への手引き

- ネモ・ガードレールAIの安全性と信頼性を高める

- ベクトル・データベースに最適化されたデータ・モデリング技法

- カラーヒストグラムの謎を解く:画像処理と解析の手引き

- BGE-M3を探る:Milvusによる情報検索の未来

- BM25を使いこなす:Milvusにおけるアルゴリズムとその応用を深く掘り下げる

- TF-IDF - NLPにおける項頻度-逆文書頻度の理解

- ニューラルネットワークにおける正則化を理解する

- 初心者のためのヴィジョン・トランスフォーマー(ViT)理解ガイド

- DETRを理解する:トランスフォーマーによるエンドツーエンドのオブジェクト検出

- ベクトル・データベース vs グラフ・データベース

- コンピュータ・ビジョンとは?

- 画像認識のための深層残差学習

- トランスフォーマーモデルの解読:そのアーキテクチャと基本原理の研究

- 物体検出とは?総合ガイド

- マルチエージェントシステムの進化:初期のニューラルネットワークから現代の分散学習まで(アルゴリズム編)

- マルチエージェントシステムの進化:初期のニューラルネットワークから現代の分散学習まで(方法論編)

- CoCaを理解する:コントラスト・キャプションによる画像テキスト・ファウンデーション・モデルの進歩

- フローレンスマイクロソフトによるコンピュータビジョンの高度な基礎モデル

- トランスフォーマーの後継者候補マンバ

- ALIGNの説明ノイジー・テキスト教師による視覚・視覚言語表現学習のスケールアップ

#はじめに

組織が重要な業務においてAIテクノロジーへの依存度を高める中、AIの安全性と信頼性の重要性はかつてないほど高まっている。AIシステムの正確性、信頼性、堅牢性を確保することは、倫理的責任の問題であるだけでなく、市場における信頼と信用を維持するためにも不可欠である。AIが様々な分野に深く組み込まれるようになるにつれ、コストのかかるエラーを防ぎ、意図しない結果を回避し、これらのシステムの脆弱性を悪用する可能性のある攻撃から保護するためには、安全性を優先することが極めて重要になる。一般市民と産業界が自信を持って信頼できるAIシステムを構築することが不可欠なのです。

この高まるニーズに応えるため、NVIDIAは、大規模言語モデル(LLMs)を利用するスマート・アプリケーションが正確であるだけでなく、適切、適切かつ安全であることを保証するために必要なツールを提供するように設計されたオープンソースのツールキットであるNeMo Guardrailsを発表しました。NeMo Guardrailsは、これらのセーフガードを効果的に実装するために必要なすべてのコード、例、ドキュメントを含む包括的なパッケージを提供することで、企業がAI主導のテキスト生成アプリケーションの安全性を強化することを支援します。このツールキットを使用することで、企業は自社のAIシステムを業界のベストプラクティスに合わせることができ、自社のAIソリューションが高い信頼性と安全性の基準を満たすことが保証されます。

AIが進化を続け、その用途が拡大するにつれて、NeMo Guardrailsが提供するような安全対策の役割はますます重要になります。これらのツールは、組織が潜在的なリスクに先手を打ち、AIシステムの完全性を強化し、さまざまな領域で安全に展開できる信頼できるAIの構築という幅広い取り組みに貢献するのに役立ちます。

dalle.jpeg

dalle.jpeg

ネモ・ガードレールを理解する

よくわかるニモのガードレール](https://assets.zilliz.com/Understanding_Nemo_Guardrails_0dfb075dd0.png) 画像ソース

AIの自動テキスト生成は、いくつかの潜在的なリスクや不正確さをもたらす可能性があるため、生成されたテキストを軌道に乗せるためのメカニズムが不可欠となる。そこで重要になるのが「ガードレール」という概念であり、基本的にはAIが軌道から外れたコンテンツを生成するのを防ぐバリアとして機能する。NeMo Guardrailsは、このような必要不可欠なセーフガードを提供するために特別に設計されたツールキットです。

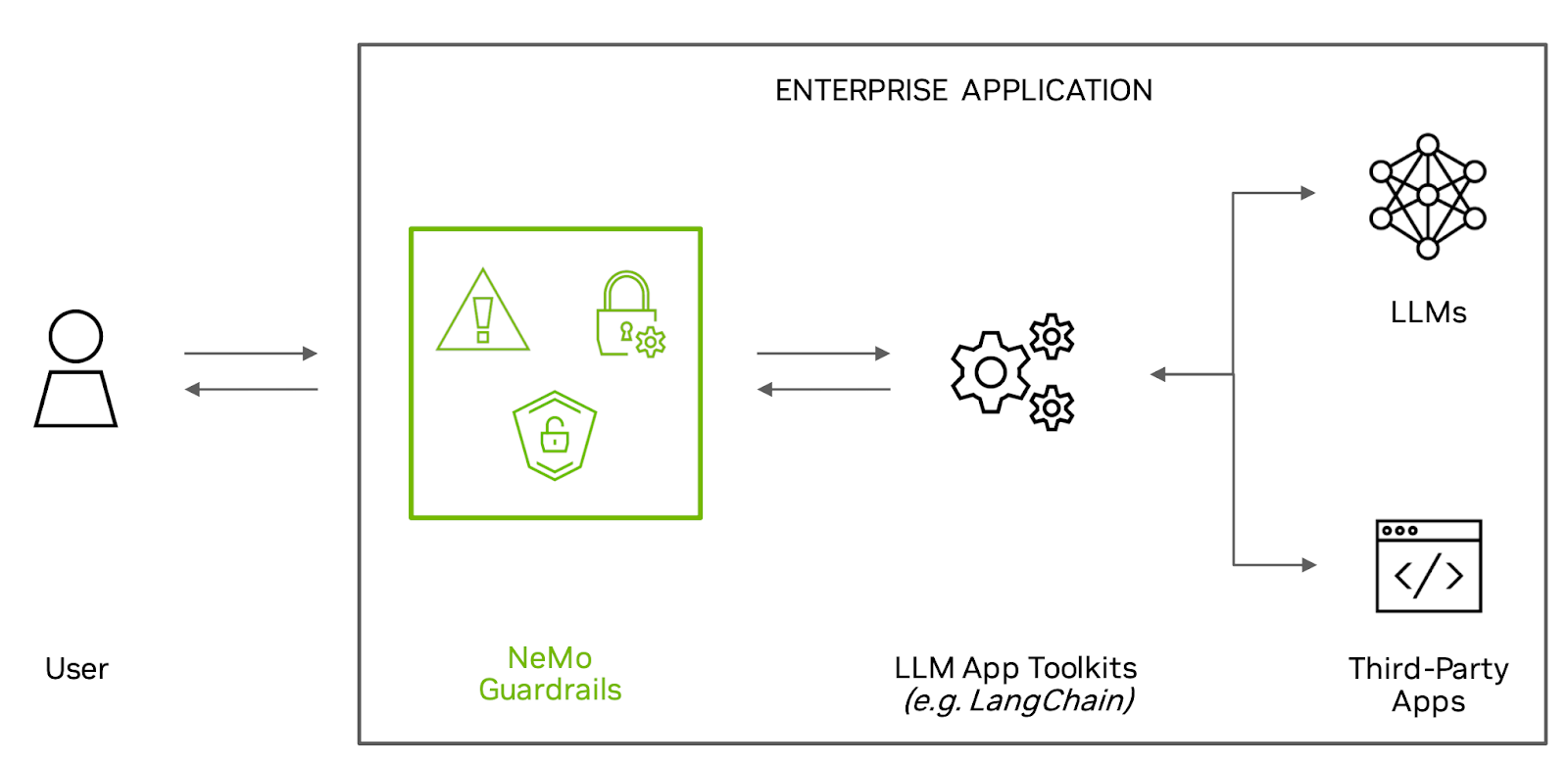

プログラミングにおけるガードレールとは、プログラム可能なルールや制約のことで、アプリケーション・コード(またはユーザー)と大規模言語モデル(LLM)の仲介役を果たす。これらのガードレールは、ユーザーがAI主導のチャットボットと行うインタラクションを監視、影響、制御し、生成されるコンテンツが許容範囲内に収まるようにします。NeMo Guardrailsは、主に3種類のガードレールを強力にサポートします:トピック・ガードレールは、会話を目的のテーマに関連したものに保ちます。セーフティ・ガードレールは、AIが有害または不適切なコンテンツを生成するのを防ぎます。セキュリティ・ガードレールは、AIシステムの潜在的な悪用や搾取から保護します。

NeMo Guardrailsを実装することで、開発者はAIとの対話をより効果的に管理・誘導し、エラーの可能性を低減し、AI駆動型アプリケーションの全体的な安全性と信頼性を向上させることができます。

ネモ・ガードレール](https://assets.zilliz.com/Nemo_Guardrails_c846cead21.png)

トピック・ガードレール

トピック・ガードレール**から始めましょう。これは、AIの応答をユーザーのクエリに沿ったものに保ち、生成されるテキストがオントピックで適切なものになるようにするためのものです。これらのガードレールは、AIが無関係な話題に逸脱するのを防ぐのに役立ち、それによってユーザーのニーズに焦点を維持します。

安全ガードレール

次に、すべての生成コンテンツが事前に定義された倫理基準を満たしていることを確認するために、組み込みのフィルターとモニターを備えた安全ガードレールがあります。これらのガードレールは、偏見、攻撃的な言葉、不適切なコンテンツを排除し、AIのアウトプットが尊重され、責任あるものであることを保証します。

セキュリティ・ガードレール

最後に、セキュリティ・ガードレールは、データ・ポイズニングやモデル反転攻撃などの潜在的脅威からAIモデルを保護するために極めて重要です。機密データを保護し、悪意のある活動からAIシステムを守ることで、これらのガードレールはAIモデルの完全性を維持し、ユーザーの信頼を築くのに役立ちます。

これらのコア機能に加え、NeMo Guardrailsは包括的なドキュメントと多数の実用例を提供しています。これにより、開発者は、特定のニーズに応じてAI安全機能を実装およびカスタマイズする方法を理解しやすくなり、AI駆動型アプリケーションの全体的な信頼性とセキュリティが強化されます。

それでは、Nemo Guardrailsのインストール、実装、使用方法の例を見てみましょう。

ステップ1:インストール

pip install nemoguardrails

ステップ2:新しいguardrails設定を作成する

全てのguardrailsの設定はフォルダに保存する必要があります。標準的なフォルダ構造は以下の通りです:

.

├── config

│ ├── actions.py

│ ├── config.py

│ ├── config.yml

│ ├── rails.co

│ ├── ...

config などのフォルダを作成し、設定を保存する:

mkdir config

config.ymlには全ての一般的な設定オプション(LLM モデル、アクティブなレール、カスタム設定データなど)、config.pyにはカスタムの初期化コード、actions.py` にはカスタムの Python アクションが含まれます。

以下は config.yml の例です:

# config.yml の例です。

モデル

- タイプ:メイン

エンジン:openai

model: gpt-3.5-turbo-instruct

レール:

# 入力レールは、ユーザーからの新しい入力を受け取ったときに呼び出されます。

入力を受け取る:

が流れる:

- 脱獄をチェックする

- 入力時に機密データをマスクする

# ボットメッセージが生成された後、出力レールが起動される。

を出力する:

が流れる:

- 事実のセルフチェック

- 自己チェック幻覚

- アクティブフェンス

- ゴタイゴト真実チェック

を設定する:

# ユーザ入力時にマスクされるエンティティのタイプを設定する。

sensitive_data_detection:

入力:

エンティティ

- PERSON

- メールアドレス

このガードレール設定は、AIモデルの安全性と信頼性を確保するためのルールを指定するもので、特に入力と出力の相互作用に焦点を当てている。各セクションを入力のレールから説明しましょう。設定されたフローには、Check Jailbreak (脱獄のチェック) が含まれます。**プライバシーとセキュリティを保護するために、ユーザーから受け取った機密情報(個人名やメールアドレスなど)をマスクしたり隠したりします。

次に、self check facts, self check hallucination, activefence moderation, gotitai rag truthcheck というフローが設定された出力レールがある。セルフ・チェック・ファクトは、信頼できるソースやデータベースと相互参照することで、生成されたレスポンスの事実の正確さを検証します。self check hallucination は、生成された回答に幻覚的な内容や無意味な内容が含まれていないかチェックし、一貫性と関連性を確保します。生成された回答から有害または不適切なコンテンツをフィルタリングするために、ActiveFenceによって提供されるモデレーション機構を含む。gotItai Rag truthcheck**は、GotItAIが提供する真実チェックサービスを利用し、生成されたレスポンスの正確性を事実情報と照らし合わせて検証します。

全体として、このガードレール構成は、入力検証、出力検証、および機密データの保護を含む、AI対話プロセス全体を通して様々な安全対策を実施することを目的とし、それによってAIモデルの信頼性と信頼性を高めます。

プログラマブル・ガードレール](https://assets.zilliz.com/programmable_guardrails_5846fa4729.png)

ステップ3: ガードレイル設定をロードして使用する

guardrailsの設定をロードしてLLMRailsインスタンスを作成し、generate/generate_asyncメソッドを使ってLLMを呼び出します。

from nemoguardrails import LLMRails, RailsConfig

# 指定したパスからguardrailsの設定を読み込みます。

config = RailsConfig.from_path("PATH/TO/CONFIG")

rails = LLMRails(config)

completion = rails.generate(

messages=[{"role": "user", "content": "Hello world!"}].

)

サンプル出力

{"role":"アシスタント", "コンテンツ":"こんにちは!どうされましたか?}

上記のコードからわかるように、Nemoガードレールの実装と使用は3つのステップだけで本当に簡単です。また、設定ファイルであなたの特定の要件に応じて安全機能を簡単にカスタマイズできることにも気づいていただけたと思います。

実用的なアプリケーション

Nemo Guardrailsは実世界の様々なアプリケーション、特にRAGパイプラインを含む大規模な言語モデル(LLM)がリスクを回避し、安全性とコンプライアンスを確保するために慎重に管理されなければならない場合に非常に役立ちます。このようなアプリケーションの例としては、ヘルスケアアドバイスプラットフォーム、教育ツール、金融アドバイスなどがある。

ヘルスケアアドバイスプラットフォームに関しては、ユーザーに危害を加える可能性があるため、ミスは許されない。教育ツールでは、NeMoガードレールは、LLMが提供するコンテンツが正確で、年齢にふさわしく、教育的に健全であることを保証するのに役立ちます。最後に、金融アドバイスツールでは、機械学習モデルによって提供される情報が正確で誤解を招くものでないことを保証することが重要である。

ネモ・ガードレールの統合

NeMo GuardrailsをAIモデルやシステムに統合するには、さまざまなプラットフォームやテクノロジーで大規模言語モデル(LLM)を効果的かつ安全に使用するためのベストプラクティスがいくつかあります。幅広いAIテクノロジーをサポートするNVIDIAのエコシステムに焦点を当てると、Nemo Guardrailsを組み込む際に考慮すべき点がいくつかあります。

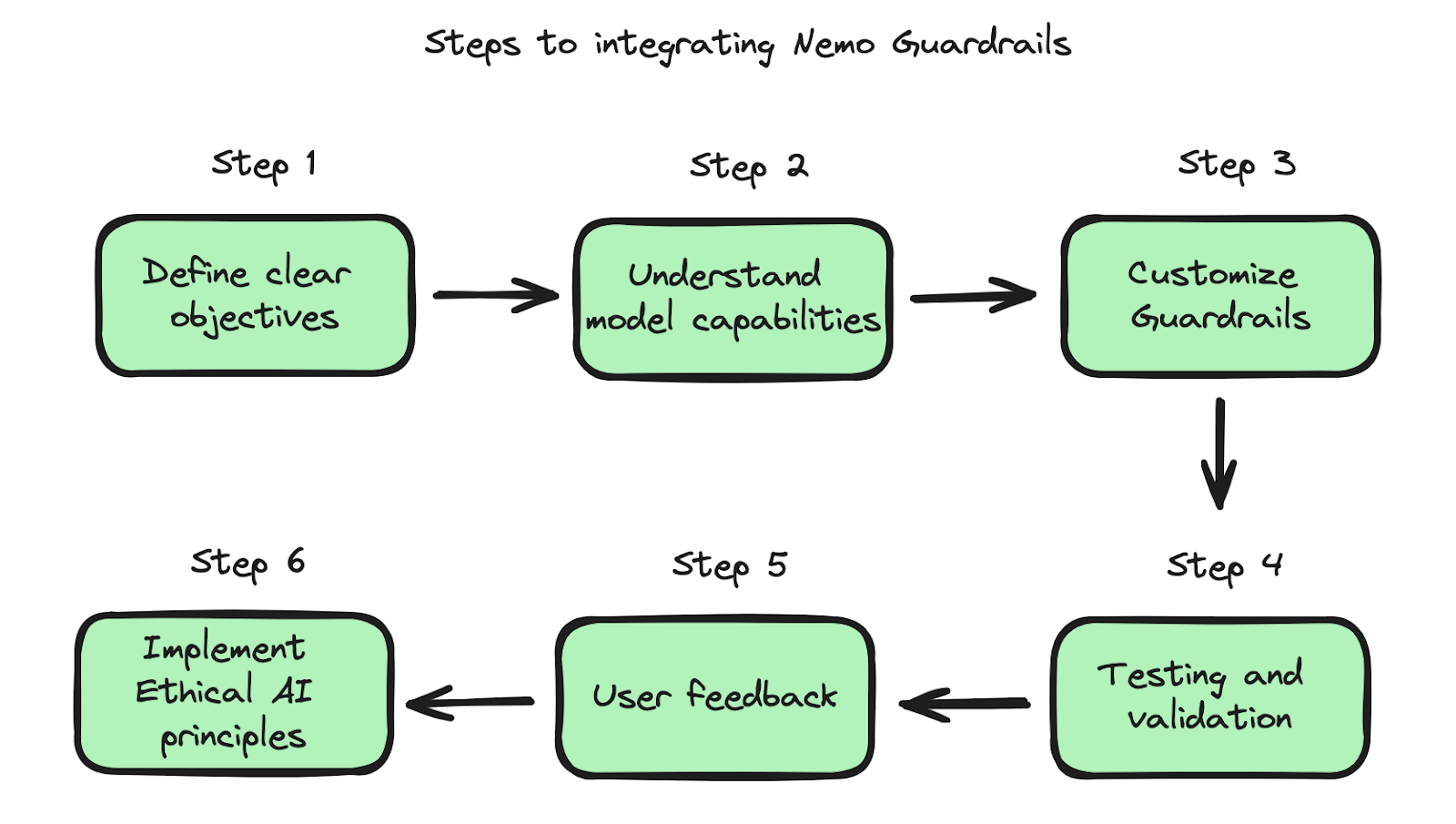

ガードレイルの目標

まず、何を達成するためにガードレールが必要なのかを明確に定義することから始める。これには、コンテンツのモデレーション、データのプライバシー、特定の規制への準拠、有害なコンテンツの生成の防止などが含まれる。次に、使用するAIモデルの能力と限界を深く理解することで、ガードレールを正しく設定することができます。次に、アプリケーションの特定のニーズに合わせてガードレールをカスタマイズし、実際のシナリオで定期的にテストして、ガードレールが意図したとおりに機能していることを確認する。

ユーザーフィードバック

さらに、ガードレールに関するAIのパフォーマンスについて、ユーザーからのフィードバックを収集する仕組みを実装することをお勧めします。このフィードバックを使ってガードレールを微調整し、ユーザーの満足度と安全性を向上させるのだ。最後になるが、ガードレールの実装が倫理的なAIの原則を遵守し、公平性、説明責任、透明性を促進するようにすること。

ネモ・ガードレールの互換性

それでは、Nemo GuardrailsとAIテクノロジーやプラットフォームとの互換性についてお話ししましょう。ご存知かもしれませんが、Nemo GuardrailsはNVIDIAのエコシステム内で特に関連しており、これらのGuardrailsを活用できる様々なツールやプラットフォームが含まれています。Nemo Guardrailsと統合できる素晴らしいツールの1つが、AIモデルをデプロイするためのNVIDIAのサービスであるRivaであり、開発者はトレーニング段階と推論段階の両方にガードレールをシームレスに適用することができます。次に、DGXシステムやCUDA-X AIライブラリなどのNVIDIAのプラットフォームがあり、ガードレールはNVIDIAハードウェアが提供するパフォーマンスの利点を妨げないようにスケーラブルで効率的であるべきであるため、スケーラブルAIのデプロイのために設計されています。

Nemo Guardrailsは、TensorFlowやPyTorchなど、NVIDIAのエコシステム内で一般的に使用されている様々なディープラーニングフレームワークと互換性があります。NeMo Guardrailsは、モデルのライフサイクルのさまざまな段階で制約や修正を適用するために、これらのフレームワークと完璧に相互作用する必要があります。

結論

ここまでで、NeMo GuardrailsがAIの信頼性と安全性をどのように変化させたか、ガードレールとは何か、どのように機能するか、AIにおける実用的なアプリケーションについてご理解いただけたと思います。また、NeMo GuardrailsをAI統合にいかに簡単に実装できるか、そのためのベストプラクティスもご理解いただけたと思います。

NeMo Guardrailsが、大規模言語モデル(LLM)を使用するスマートアプリケーションや会話AIが、正確で、適切で、適切で、安全であることを保証するために、効率的かつ効果的に動作する堅牢なフレームワークを提供することを説明しました。NeMo Guardrailsは、世界中の開発者に、AIとの対話を安全、適切、かつ規制要件に準拠したものに保つための特定の基準とルールを適用する権限を与えます。AIの出力をフィルタリング、変更、リダイレクトすることで、これらのガードレールは有害なコンテンツの拡散を防ぎ、ユーザーデータのプライバシーを保護し、倫理的な基準を維持するのに役立ち、AIアプリケーションの信頼と信用を育みます。

AI技術が進歩し続ける中、NeMo Guardrailsのような洗練された安全機能を組み込むことは、これらの強力なツールがもたらす課題に対処する上で不可欠となる。開発者、研究者、組織は、AIシステムが効果的であるだけでなく、社会の価値観、規制要件、安全基準に沿ったものであることを保証するために、これらのガードレールを理解し、実装することを優先しなければなりません。AIシステムへのNeMoガードレールの継続的な統合は、様々な産業におけるAI技術の責任ある倫理的な展開において重要な役割を果たすだろう。

読み続けて

AIの最適化:安定した普及と効率的なキャッシュ戦略への手引き

このブログでは、Stable Diffusionモデルを最適化するための様々なキャッシング戦略について説明します。

BM25を使いこなす:Milvusにおけるアルゴリズムとその応用を深く掘り下げる

Milvusを使えば、文書とクエリをスパースベクトルに変換するBM25アルゴリズムを簡単に実装できる。そして、これらのスパースベクトルは、特定のクエリに従って最も関連性の高い文書を見つけるためのベクトル検索に使用することができる。

ニューラルネットワークにおける正則化を理解する

正則化は、機械学習モデルが学習過程でオーバーフィットするのを防ぐ。正則化の概念と主な正則化テクニックについて説明する。