RGB-Xモデルで豊かな視覚的洞察を引き出す

機械学習はマルチモーダルに向かって進化しており、Computer Visionの多くのモデルは現在、視覚や3Dのような分野にまで広がっている。RGB-Xデータとは、従来のRGB(赤、緑、青)情報に加えて、赤外線、深度、表面法線などの追加データが組み込まれたものである。

最近Zillizが主催したNYC Unstructured Data Meetupで、Voxel51の機械学習とデベロッパーリレーションの専門家であるDaniel Guralは、RGB-Xモデルについて洞察に満ちた講演を行い、これらの複雑なデータフォーマットを扱うための最新の進歩とベストプラクティスに焦点を当てた。また、彼のプレゼンテーションは、Visual AIのこの成長分野における主要なモデルのいくつかを探求し、RGB-Xモデルが画像分析にもたらすより豊かで詳細なデータの取り扱いに関する貴重なガイダンスを提供しました。このブログでは、グラル氏の講演から得られた重要なポイントを要約する。より詳細にご興味のある方は、YouTubeでプレゼンテーションの全文をご覧ください。

RGB-Xモデルを理解するRGB-Xモデルは、コンピュータビジョンにおける高度な機械学習モデルであり、深度、赤外線、または表面法線などの追加チャンネルを組み込むことによって、従来のRGB(赤、緑、青)データを拡張します。RGB-XのXは、以下のような様々な種類のデータを表すことができる:

深度情報:深度情報:カメラからシーン内のオブジェクトまでの距離を測定し、空間的コンテキストを提供する。例えば自動運転車のシナリオでは、深度データは歩行者が5メートル先にいることを車両が判断するのに役立ち、安全なナビゲーションを支援する。

赤外線データ熱シグネチャをキャプチャするため、ナイトビジョンや赤外線画像に役立つ。野生動物のモニタリングでは、赤外線データにより、研究者は夜間でも動物の動きを邪魔することなく追跡できる。

法線マップリアルな3Dレンダリングや照明計算に不可欠。バーチャルリアリティゲームでは、法線マップがテクスチャや照明のリアリズムを高め、より没入感のある環境を作り出します。

熱画像**:赤外線と同様、温度変化に焦点を当て、特に熱分布を測定する。建物の検査では、熱損失や電気系統の問題を特定できるため、潜在的な問題の早期発見に役立つ。

これらの追加チャンネルは、視覚シーンのより包括的な解析と理解を可能にする、新たな次元の情報を提供します。RGB-Xモデルが実際にどのようにこれらのデータを統合しているかを理解するために、建物の前に立つ人の例を考えてみましょう。

図- 建物の前に立つ人のさまざまな表現.png

図- 建物の前に立つ人のさまざまな表現.png

図:建物の前に立つ人のさまざまな表現

上の図は、建物の前に立つ人物の4つの異なる表現です。POSEパネルは、骨格ポーズ推定を重ねた元の画像を示しています。SEGパネルはセグメンテーションを表示し、異なる体の部位と衣服が色分けされています。DEPTHパネルは奥行きを表現するためにカラーグラデーションを使用し、暖かい色はより近いオブジェクトを示します。NORMALパネルはサーフェス法線を表示し、3D空間におけるサーフェスの向きを色で表します。

この例は、RGB-Xモデルが、ポーズ推定、セグメンテーション、奥行き知覚、表面法線計算など、シーンの複数の側面を同時に処理できることを示しています。この多面的なアプローチにより、視覚情報をより総合的に理解することができる。これらの構成要素を分解してみよう:

姿勢推定**:画像内の人体部位の位置と向きを特定する。キーポイント検出を使用して関節の位置を特定し、人物の骨格表現を作成する。フィットネス・アプリケーションでは、ポーズ推定は、理想的なモデルと姿勢を比較することで、ユーザーがエクササイズ中にフォームを修正するのに役立つ。

セグメンテーション**:画像を複数のセグメントまたはオブジェクトに分割する処理。RGB-Xモデルでは、異なる身体の部分、衣服、背景要素を区別することができます。例えば、拡張現実のファッションアプリでは、セグメンテーションによって、ユーザーが自分の体に服のアイテムを正確に重ねることで、さまざまな服をバーチャルに試着できるようになる。

奥行き知覚**:奥行き情報を使って、モデルはシーンの3D構造を理解することができる。画像では、暖色系(赤や黄色)はカメラに近い物体を示し、寒色系(青や紫)はより遠くの要素を示している。これは、ロボットが倉庫内の障害物を回避するのに役立つ、ロボット工学のアプリケーションで重要な役割を果たす可能性がある。

表面法線計算:この技法は、3D空間における面の向きを計算します。NORMALパネルの色分けは異なるサーフェスの向きを表し、シーン内のオブジェクトのジオメトリを理解するための重要な情報を提供します。3Dモデリングソフトウェアでは、サーフェス法線情報は、アーティストがよりリアルなテクスチャや照明効果を作成するのに役立ちます。

さて、RGB-Xモデルの中核となるコンポーネントを探ったところで、複雑な視覚的課題に取り組むために、これらのモデルがさまざまな業界でどのように適用できるかを学んでいきましょう。

RGB-Xモデルの応用例

多面的な視覚情報を処理する能力を持つRGB-Xモデルは、フレームをまたいだ物体追跡や困難な地形測量など、様々な業界やユースケースで応用されています。

1.フレームをまたいだ物体追跡

RGB-Xモデルは、従来の物体検出を超えて、複数のビデオまたは画像シーケンスフレームにわたって物体を追跡することで、物体の追跡に最適です。これらのモデルは、パフォーマンスを向上させるために、追加モダリティと共にRGBデータを使用します。

Guralが共有するRGB-Xトラッキングシステムの構造を見てみましょう:

図- RGB-Xトラッキングシステム構造.png](https://assets.zilliz.com/Figure_RGB_X_tracking_system_structure_0b3fa25063.png)

図RGB-Xトラッキングシステムの構造

このシステムは、RGBカメラや、深度、熱、その他のデータタイプをキャプチャするセンサーなど、様々なソースからの入力から始まります。これらの入力は中央のRGBトラッカーに送られます。

2つの主要な処理ストリームがこのコアを取り囲んでいます:**モダリティ・アグノスティック・コンポーネントとモダリティ・アウェア・コンポーネントです。Modality-Agnosticコンポーネントはすべての入力タイプに共通する機能を処理し、Modality-Awareセクションは深度や熱データなど特定の入力モダリティに特化しています。

このシステムは、メモリー(MeME)とエンベッディング(Emb.)モジュールを含む浅いエンベッディング技術を使用して、初期入力表現を作成する。ディープ・プロンプティングは、メモリー・モジュールとプロンプト・モジュールを繰り返し使用して、情報を洗練し、文脈化します。

これらのコンポーネントが協働して、ジェネラリストRGB-X視覚物体追跡(VOT)システムを形成する。このシステムは、深度、イベントデータ、赤外線画像などのソースからの情報を整列して処理し、異なるモダリティ間での追跡を可能にします。

このアプローチにより、RGB-Xモデルは様々な条件下で効果的に物体を追跡することができます。その用途は以下の通りです:

監視システム**:センサータイプの切り替えを含む、複数のカメラフィードにわたる個人または物体の追跡。

自律走行車車両、歩行者、障害物をリアルタイムで追跡し、視覚、深度、場合によっては熱データを使用して、さまざまな条件下で追跡を維持する。

ロボティクス:*** 視覚データだけでは不十分な場合に、複数のデータストリームを使用して物体の持続性を維持し、ロボットが動的環境で物体を追跡し、相互作用するのを支援する。

スポーツ分析パフォーマンス分析のために選手や用具を追跡し、視覚追跡と生理学的モニタリングのための赤外線など他のデータタイプを組み合わせる可能性がある。

RGB-Xトラッキングのマルチモーダルな性質は、様々な照明、部分的なオクルージョン、複雑な環境などの厳しい条件下でも一貫したパフォーマンスを可能にします。対象物が視覚的に見えなくなった場合、深度や熱情報がトラッキング精度を維持するのに役立ちます。

2.困難な地形の調査

RGB-Xモデルは、特に困難な環境での測量や地図作成に役立ちます。主な用途は以下の通りです:

ドローンによるマッピングドローンにRGB-X対応センサーを搭載することで、徒歩でのアクセスが困難または危険なエリアの詳細な3D地図を作成することが可能になる。例えば、自然災害の後、RGB-X機能を搭載したドローンは、被害地域を迅速に地図化し、緊急対応者がより効果的に活動計画を立てるのに役立つ。

オンボード処理**:高度なRGB-Xモデルは、ドローン上で直接リアルタイム処理を実行できるため、即座の分析と意思決定が可能になる。捜索救助のシナリオでは、ドローンはすべてのデータを基地局に送信することなく、行方不明者の位置を自律的に特定し報告することができる。

地質調査:** RGB-Xデータの深度と法線情報は、地形の特徴や地層を理解するのに役立つ。鉱山探査では、RGB-Xモデルは、広大な土地の表面の特徴や組成を分析することで、鉱床の有望な地域を特定するのに役立つ。

図- RGB-Xデータが単純な航空画像を3Dモデルに変換する方法.png](https://assets.zilliz.com/Figure_How_RGB_X_data_can_transform_simple_aerial_imagery_into_3_D_models_92d6caee83.png)

図RGB-Xデータで単純な航空写真を3Dモデルに変換する方法

上の図は、RGB-Xデータによって、単純な航空画像が詳細な3Dモデルに変換され、都市開発、農業、環境モニタリングなど様々な分野で正確な分析と計画が可能になることを示している。例えば、都市計画担当者は、このようなモデルを使用して、新しい建設プロジェクトが既存の建物の太陽光照射に与える影響を評価することができます。

RGB-Xモデル開発の進歩

RGB-Xモデル開発における最近の進展により、性能と機能が大幅に改善されました。

1.サピエンスとその後

サピエンス・モデル**](https://arxiv.org/abs/2408.12569)は、RGB-X処理における大きな飛躍を意味する。サピエンス・モデルは4つの特殊なモデルで構成されており、それぞれが視覚理解の異なる側面に焦点を当てている:

1.姿勢推定:このモデルは、関節や顔のランドマークなど、人体のキーポイントを識別し、シーン内の個人のポーズを決定します。このモデルは、畳み込みニューラルネットワーク(CNN)とグラフ・ニューラル・ネットワーク(GNN)の組み合わせを使用して、これらのキーポイントを正確に特定し、接続する。実際の応用例としては、このモデルをスマートジムで使用し、運動フォームに関するリアルタイムのフィードバックを提供することが考えられる。

2.セグメンテーション:セグメンテーションモデルは、画像を異なる領域に分割し、異なる物体、身体部分、または背景要素を識別する。これは、完全畳み込みネットワーク(FCN)またはU-Netアーキテクチャを使用して、ピクセル単位の分類を生成する。このモデルは、歩行者、車両、道路標識など、街路シーンの異なる要素を正確に識別し、分離するために、自律走行車に適用することができる。

3.奥行き知覚:このモデルはカメラからの各ピクセルの距離を推定し、シーンの深度マップを作成する。多くの場合、ステレオマッチングや、エンコーダ・デコーダ・アーキテクチャを使用した単眼的奥行き推定などの技術が採用されます。ロボット工学アプリケーションでは、この深度情報は、ロボットが様々なサイズや形状の物体を正確に把握するのに役立つ。

4.**表面法線計算:このモデルは、3D空間における表面の向きを計算する。特殊なCNNアーキテクチャを使用して、各ピクセルの表面法線ベクトルを推定し、シーン内のオブジェクトの形状に関する重要な情報を提供する。これはAR(拡張現実)アプリケーションにおいて価値があり、仮想オブジェクトが現実世界の表面とリアルに相互作用することを可能にする。サピエンスの動きを見てみよう。

2人の被験者のポーズ、セグメンテーション、深度、法線マップを示すRGB-Xモデル出力.png](https://assets.zilliz.com/Figure_RGB_X_model_outputs_showing_pose_segmentation_depth_and_normal_maps_for_two_subjects_4f4285b8d3.png)

図:2人の被写体のポーズ、セグメンテーション、深度、法線マップを示すRGB-Xモデルの出力。

上の画像は、Sapiensのような高度なRGB-Xモデルの能力を示している。2組の画像が表示され、それぞれに元画像、ポーズ推定、セグメンテーション、深度マップ、表面法線マップの5つのパネルがある。上段は大人、下段は子供。これは、このモデルが多様な被写体を正確に処理できることを示している。

2.きめ細かな検索

RGB-Xデータの情報量が増えたことで、ビジュアルデータベース内でより詳細で具体的な検索が可能になりました。例えば

特定のアングルで撮影されたドローン画像の検索**:法線マップ情報を利用することで、カメラに対して表面が特定の角度に向いている画像を特定できる。これは建築調査において有用で、アナリストは特定の視点から建物の画像を見つけることができる。

深度チャンネルは、カメラからのオブジェクトの距離を指定するクエリーを可能にし、より正確な空間検索を可能にします。小売店の在庫管理システムでは、棚の特定の深さに置かれた商品を見つけるのに役立ちます。

赤外線データの熱異常の検索**:サーマルチャンネルは、産業検査や野生動物のモニタリングなどのアプリケーションで有用な、異常な熱シグネチャーのエリアを特定することができます。例えば、大規模な太陽光発電所では、この機能により、メンテナンスが必要なパネルの過熱を素早く特定することができます。

3.エンベディッドAIと自動運転車

RGB-Xモデルは、体現型AI、特に自動運転車の開発において重要な役割を果たしている。いくつかの応用例がある:

高度なナビゲーション:高度なナビゲーション:道路状況や障害物をよりよく理解するために、奥行き情報と法線情報を使用する。これにより、車両は周囲の詳細な3Dマップをリアルタイムで作成できる。例えば、ポットホールの深さと形状を理解することで、ポットホールを検知して回避することができます。

物体識別:** RGBデータと赤外線データを組み合わせることで、さまざまな照明条件下での物体検出を改善。これは特に、低照度や悪天候下で歩行者、動物、障害物を識別するのに役立つ。例えば、霧の夜、RGB画像だけでははっきりと見えない横断歩道を渡る歩行者を検出することができます。

乗客モニタリング:** 深度データと熱データを使って乗客の健康と安全をモニタリングする。このアプローチでは、車両内の苦痛や異常行動の兆候を検出することができる。例えば、乗客が眠ってしまったり、医療上の緊急事態に陥ったりした場合、システムがそれを検知し、車両に適切な行動を取らせることができる。

自動運転車におけるRGB-Xモデルの応用は、単なる障害物回避にとどまらない。これらのモデルは、ユーザーが車外の物体を指さしてその情報を受け取ったり、車内の乗客の健康と安全を監視したりするなど、より高度なインタラクションを可能にします。

RGB-Xモデルの課題と考察

このような進歩はエキサイティングな新しい可能性を開くが、RGB-Xモデルを実世界に展開する際には、以下のような課題と考慮点があることを認識することが重要である:

1.データの複雑さ:* 4チャンネルデータの管理と処理には、より多くの計算リソースとストレージ容量が必要です。このため、ハードウェアへの要求が高まり、効率的なデータ管理戦略が必要になります。

2.モデルの解釈可能性:* モデルがより複雑になるにつれ、その決定が解釈可能で説明可能であることを保証することが極めて重要になります。開発者は、RGB-Xモデルの決定をより透明化するために、注意の可視化や特徴の重要度分析のような技術を実装する必要があるかもしれません。

3.倫理とプライバシー:* RGB-Xモデルの強化された機能は、データプライバシーとAIの倫理的使用に関する新たな問題を提起する。例えば、短いビデオクリップから詳細な3Dアバターを作成する能力は、個人のプライバシーと同意に影響を与える可能性がある。RGB-Xテクノロジーを導入する組織は、強固なデータ保護ポリシーを策定し、データを取得・処理される個人から明確な同意を得る必要があるかもしれない。

RGB-X モデルとベクトルデータベースの統合

グラル氏が講演で強調したように、RGB-Xモデルは単純な推論を超える。これらのモデルを使えば、表面法線、深度、熱データ、あるいはあなたが興味を持っているその他のチャンネルについて予測を行うだけでなく、それらの埋め込みを作成することもできます」と彼は説明する。この洞察は、RGB-Xモデルの2つの機能を強調しています。RGB-Xモデルは、マルチチャンネル出力を予測し、複雑な視覚的特徴を捉える強力なvector embeddingsを生成することができ、画像検索や分類のような下流のタスクにより豊かな表現を提供します。

RGB-Xモデルは高次元の埋め込みを生成するため、これらの埋め込みを効率的に保存、インデックス付け、検索することが重要になります。MilvusやZilliz Cloudのようなベクターデータベースは、この複雑な多次元データを管理するために構築されており、RGB-Xモデルによって生成されたリッチな埋め込みを処理し最適化するための理想的なソリューションです。

ここでは、ベクトルデータベースがRGB-Xモデルのアプリケーションをどのように強化するかを紹介します:

1.効率的な類似検索**:ベクトルデータベースは、高次元の埋め込み空間において、類似したアイテムを検索します。RGB-Xデータでは、複雑な基準に基づいて、視覚的または構造的に類似したシーンを素早く見つけることができます。大規模な監視システムでは、オペレータはMilvusを使用して、深度、熱、または複合RGB-X空間で類似した埋め込みパターンを持つ映像を即座に検索することができる。

2.拡張性:RGB-Xアプリケーションの増加に伴い、ベクトル埋め込み量も増加します。Zilliz Cloudのようなベクターデータベースは、これらのエンベッディングの膨大なデータセットを扱うことができ、街全体のセンサーネットワークや広範な衛星画像解析のようなアプリケーションに理想的です。

3.柔軟なスキーマ:RGB-Xの出力は、視覚的特徴から深度や熱表現まで、多様なタイプのベクトル埋め込みを生成することがよくあります。Milvusはこのような多様性に対応し、異なるRGB-Xアスペクト埋め込みを統一的に保存し、照会することができます。

4.RAGとGenAI:RGB-Xベクトル埋め込みをMilvusに保存することで、GenAIアプリケーションのための、より効果的なRAG(retrieval-augmented generation)パイプラインを構築することができます。このアプローチは、マルチモーダル埋め込みを使用して複雑な視覚シーンについて推論する必要があるAIモデルのパフォーマンスを大幅に向上させることができます。

5.マルチモーダル埋め込みサポート**:Milvusは、異なるモダリティからの埋め込みを保存し、比較するのに適しています。この機能は、視覚、深度、熱の埋め込み空間間の関係を分析するRGB-Xアプリケーションにとって非常に重要です。

MilvusをFiftyOneのようなツールと統合することで、RGB-Xワークフローをさらに強化することができます。このような統合により、データセットとそれに対応するエンベッディングのシームレスな管理、複雑なRGB-X出力の視覚化、マルチチャンネル画像エンベッディングの大規模なコレクション間での効率的な類似性検索が可能になります。

ハンズオン:FiftyOneによる単眼深度推定

RGB-Xモデルの実用的なアプリケーションを説明するために、SUNRGBDデータセットを使ってFiftyOneを単眼的な奥行き推定に使用するハンズオンの例を見てみましょう。ここでは、RGB-D(RGB + Depth)データをFifty Oneに読み込んで処理する方法を説明します。また、このデータでRGB-Xモデルを活用するための完全なチュートリアルへのリンクも掲載します。

ステップ1:セットアップとインストール

まず、必要なライブラリをインストールし、データセットをダウンロードする必要がある:

pip install fiftyone

!.curl -o sunrgbd.zip https://rgbd.cs.princeton.edu/data/SUNRGBD.zip

sunrgbd.zipを解凍する。

このコードはFiftyOneをインストールし、SUNRGBDデータセットをダウンロードし、解凍します。FiftyOneはデータセットの管理と可視化のためのツールで、コンピュータビジョンのタスクに役立ちます。

ステップ 2: 必要なライブラリのインポート

次に、必要なPythonライブラリをインポートします:

from glob import glob

numpy を np としてインポートする。

from PIL import Image

インポートトーチ

foとしてfiftyoneをインポート

import fiftyone.zoo as foz

import fiftyone.brain as fob

from fiftyone import ViewField as F

これらのインポートにより、ファイル操作(glob)、数値演算(numpy)、画像処理(PIL)、ディープラーニング(torch)、データセット管理(fiftyone)のツールが提供される。

ステップ3:データセットの作成

では、FiftyOneデータセットを作成し、SUNRGBDデータセットからサンプルを入力します:

データセット = fo.Dataset(name="SUNRGBD-20", persistent=True)

# 20シーンに制限

scene_dirs = glob("SUNRGBD/k*/*/*")[:20].

サンプル = [].

for scene_dirs in scene_dirs:

# シーンディレクトリから画像ファイルのパスを取得

image_path = glob(f"{scene_dir}/image/*")[0] # シーンディレクトリから画像ファイルのパスを取得する

# シーンディレクトリから深度マップファイルのパスを取得

depth_path = glob(f"{scene_dir}/depth_bfx/*")[0] # シーンディレクトリから深度マップファイルのパスを取得する。

depth_map = np.array(Image.open(depth_path))

depth_map = (depth_map * 255 / np.max(depth_map)).astype("uint8")

sample = fo.Sample(

filepath=image_path、

gt_depth=fo.Heatmap(map=depth_map)、

)

samples.append(sample)

dataset.add_samples(samples)

このコードは "SUNRGBD-20 "という新しいFiftyOneデータセットを作成します。そして、SUNRGBDデータセットから20のシーンを繰り返し、各シーンのRGB画像とそれに対応する深度マップの両方を読み込みます。深度マップは正規化され、視覚化しやすいように8ビットフォーマットに変換される。各画像の深度ペアはサンプルとしてデータセットに追加され、深度マップはヒートマップとして保存される。

ステップ 4: FiftyOne アプリの起動

最後に、FiftyOne アプリを起動してデータセットを視覚化します:

セッション = fo.launch_app(dataset, auto=False)

# 次に、ブラウザでlocalhost:5151へのタブを開きます。

このコードではFiftyOneアプリが起動され、データセットを調査・分析するためのウェブベースのインターフェイスが提供されます。このインターフェースには、ウェブブラウザを開いて localhost:5151 に移動することでアクセスできます。

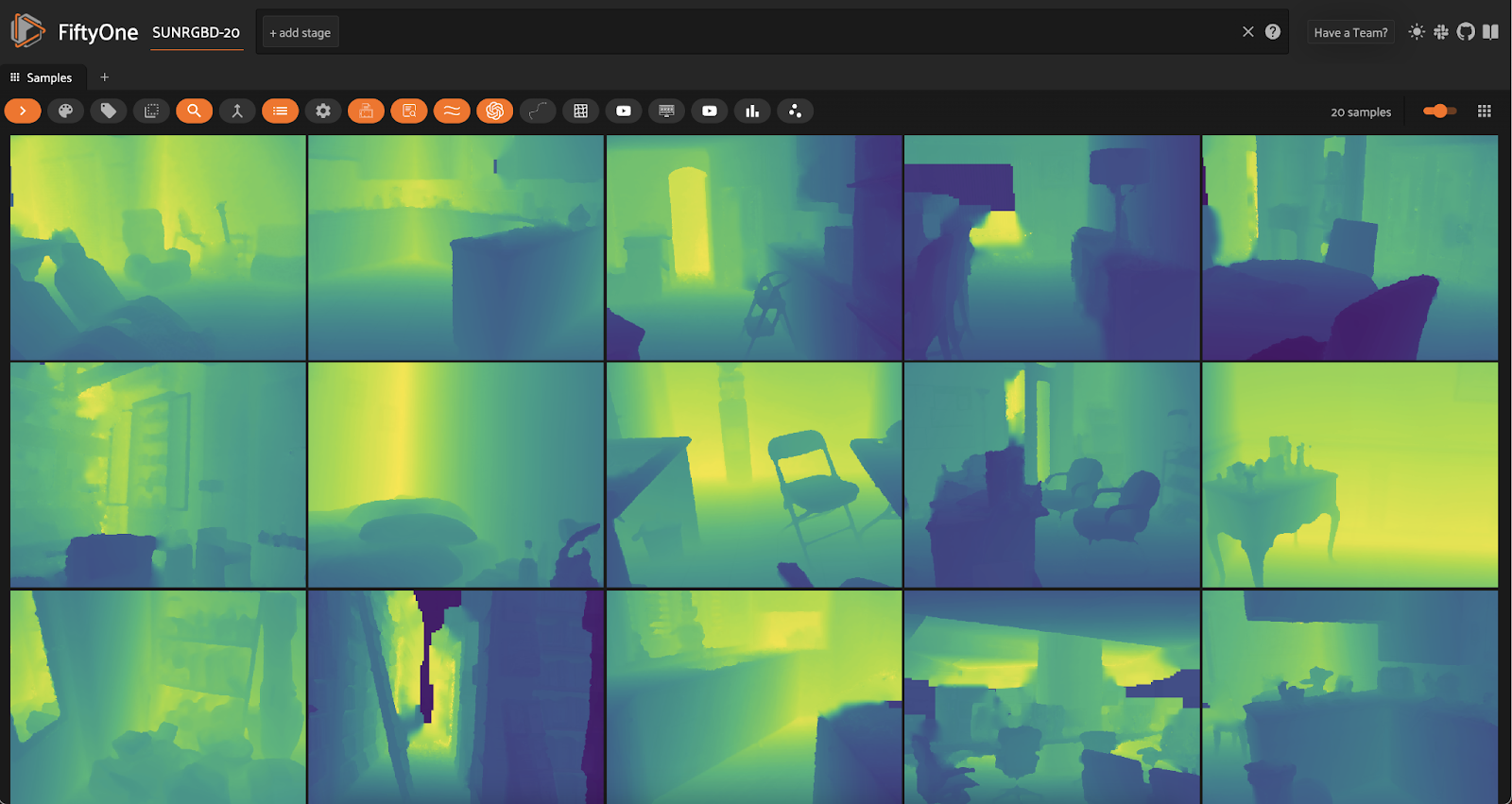

インターフェイスはこのようなものになるはずです:

図- FiftyOne.pngにおけるSUNRGBD-20データセットの深度マップ

図- FiftyOne.pngにおけるSUNRGBD-20データセットの深度マップ

図:FiftyOneのSUNRGBD-20データセットの深度マップ

この出力は、私たちが作成したSUNRGBD-20データセットからの深度マップを示しています。ヒートマップは様々な屋内シーンの深度情報を表しており、明るい黄色と緑色はより近い物体や表面を、暗い青色はカメラから遠い領域を表しています。

データセットを読み込んだので、このチュートリアルに従って、単眼深度推定モデルを実行することができます。

RGB-Xモデルによる機械学習の未来

RGB-Xモデルが進化し続けるにつれて、機械学習とAIの将来に大きな影響を与える可能性が高い:

1.人間とデジタルのインタラクションの強化

RGB-Xモデルは、人間とデジタル・システム間のより自然で直感的なインタラクションを可能にします。以下のような用途が考えられます:

短いビデオクリップからリアルな3Dアバターを作成:** RGB-Xモデルは、奥行きと法線情報を活用することで、限られた入力データから、より正確で詳細な個人の3D表現を生成できます。これにより、参加者の表情や動きを正確に模倣した本物そっくりのアバターで参加者を表現することができ、バーチャルミーティングに革命をもたらす可能性があります。

仮想現実や拡張現実のためのジェスチャー認識の向上:*** 情報チャネルが増えることで、手や体の動きをより正確に追跡できるようになり、より応答性の高い没入感のあるVR/AR体験が可能になります。例えば、VR彫刻アプリケーションでは、システムが指の細かい動きを正確に検出することで、仮想粘土をより正確かつ直感的に操作できるようになる。

顔認識と感情検出システムの強化:**深度データと熱データを組み込むことで、これらのシステムは顔の表情と生理的反応をよりよく理解できるようになり、より正確な感情検出につながる。これは市場調査に応用でき、企業は製品や広告に対する視聴者の反応をより正確に測定できる。

グラルは、シンプルなビデオ入力から詳細な3Dアバターを作成するRGB-Xモデルの可能性を強調した。この技術は、ビデオゲームからバーチャルオフィスまで、バーチャル環境でのインタラクション方法を変える可能性がある。

2.高度なロボット工学

RGB-Xデータのマルチモーダルな性質は、ロボット工学において特に価値がある:

物体操作の向上:** 奥行きと法線のデータは、ロボットが物体の形状や質感をよりよく理解するのに役立ち、多様な物体のより正確な把持と操作を可能にする。倉庫内では、ロボットは繊細なガラス製品から奇妙な形のパッケージまで、様々な製品を同じように器用に扱うことができます。

ナビゲーションの強化:** RGBと奥行き情報を組み合わせることで、複雑な環境でもより正確な動きが可能になり、乱雑な空間や動的な空間をナビゲートするロボットの能力が向上する。例えば、家事支援ロボットは家具やペットの周りをナビゲートし、より効果的に人を移動させることができる。

人間とロボットのインタラクションの向上:*** 人間のポーズやジェスチャーをより正確に理解することで、ロボットは微妙な合図を解釈して適切に反応し、より自然に人とインタラクションできるようになる。これは、ロボットが患者の動きや非言語的なコミュニケーションに敏感に反応しながら患者を支援する、医療現場で特に価値を発揮する可能性がある。

3.環境モニタリングと環境保全

RGB-Xモデルは、環境モニタリングと環境保護に革命をもたらす可能性を秘めています:

正確な森林マッピング:** RGB画像と深度情報を組み合わせることで、正確な木の数え方と種の識別が可能になります。これは森林管理や保全活動に役立つ。例えば、研究者はRGB-Xセンサーを搭載したドローンを使って森林の健全性を迅速に評価し、病気や森林伐採の影響を受けている地域を高い精度で特定することができる。

野生動物の追跡:**熱とRGBデータを使って、動物の個体数を非侵襲的に監視する。このアプローチは、動物の行動や生息地の利用について、被写体の邪魔をすることなく貴重な洞察を得ることができる。例えば、自然保護活動家は、RGB-X搭載カメラを使って、低照度条件や密生した植生の中でも、自然の生息地で絶滅危惧種を追跡することができる。

気候変動の影響評価**:深度と法線データを活用して、海岸浸食や氷河後退などの地形の経年変化を追跡する。経時的な景観の詳細な3Dモデルを作成することで、科学者は気候変動の影響をより正確に定量化・視覚化できる。これは、海面上昇と沿岸地域社会への影響を監視する上で特に有用である。

結論

Gural氏は、RGB-Xモデル開発の進歩を共有し、これらのモデルが従来のRGBチャンネルを超え、コンピュータビジョンとAIの新たな次元を解き放つことを紹介した。深度、赤外線などの追加データを統合することで、RGB-Xモデルはビジュアル分析能力を再定義し、自律走行車、ロボット工学、環境モニタリングなどの多様なアプリケーションで貴重な存在となっている。

続きを読む

ヴィジョン・トランスフォーマー(ViT)とは - Zilliz blog](https://zilliz.com/learn/understanding-vision-transformers-vit)

生成AIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

読み続けて

Migrating from S3 Vectors to Zilliz Cloud: Unlocking the Power of Tiered Storage

Learn how Zilliz Cloud bridges cost and performance with tiered storage and enterprise-grade features, and how to migrate data from AWS S3 Vectors to Zilliz Cloud.

Zilliz Cloud Enterprise Vector Search Powers High-Performance AI on AWS

Zilliz Cloud on AWS powers secure, scalable, ultra-fast vector search for enterprise AI apps, with BYOC, sub-10ms latency, and zero-DevOps simplicity.

Build for the Boom: Why AI Agent Startups Should Build Scalable Infrastructure Early

Explore strategies for developing AI agents that can handle rapid growth. Don't let inadequate systems undermine your success during critical breakthrough moments.