OpenAIのChatGPT

シリーズ全体を読む

- OpenAIのChatGPT

- GPT-4.0と大規模言語モデルの秘密を解き明かす

- 2024年のトップLLM:価値あるもののみ

- 大規模言語モデルと検索

- ファルコン180B大型言語モデル(LLM)の紹介

- OpenAIウィスパー高度なAIで音声をテキストに変換する

- OpenAI CLIPを探る:マルチモーダルAI学習の未来

- プライベートLLMとは?大規模言語モデルをプライベートで実行 - privateGPTとその先へ

- LLM-Eval:LLMの会話を評価するための合理的なアプローチ

- CohereのRerankerを使いこなし、AIのパフォーマンスを向上させる

- PagedAttentionを用いた大規模言語モデルサービングの効率的なメモリ管理

- LoRAの説明LLMを微調整するための低ランク適応

- 知識の蒸留:妥当性を犠牲にすることなく、大規模で計算量の多いLLMから小規模なLLMへ知識を移行する

- RouteLLM: LLM展開におけるコストと品質のトレードオフをナビゲートするオープンソースフレームワーク

- 検証者-検証者ゲームがLLM出力の可読性を向上させる

- 金魚のように、暗記をするな!ジェネレーティブLLMで暗記を軽減する

- LLMにおけるメニーショット・インコンテキスト学習のパワーを解き放つ

- 双眼鏡でLLMを発見:機械生成テキストのゼロショット検出

OpenAIのChatGPTの背景

ChatGPT (Chat Generative Pre-trained Transformer)は、Open AIチームが構築した大規模言語モデル(LLM)のGPT-3.5とGPT-4ファミリーをベースに、教師あり学習と強化学習のテクニックを使って微調整された、非常に重要なツールです。Open AIの開発者たちは、ユーザーが自然言語で問い合わせができるようにChatGPTを設計しました。ChatGPTのユニークな点は、ソーシャルメディアへの投稿やニュース記事、その他の人間のコミュニケーションソースなど、膨大な量のテキストデータに対して事前に訓練されていることだ。その結果、ChatGPTはその豊富な事前学習により、様々なテキスト入力に対して自然で適切な応答を生成することができます。例えば、特定のトピックについてChatGPTに質問すると、関連性が高く有益な包括的な回答を提供することができます。さらに、ChatGPTは非常にユーザーフレンドリーで、基本的なコンピュータスキルがあれば誰でもアクセスできます。従って、仕事や研究で自然言語処理を使用する人にとって貴重なツールです。

スクリーンショット 2023-05-09 at 8.56.16 PM.png](https://assets.zilliz.com/Screenshot_2023_05_09_at_8_56_16_PM_14043f6a5e.png)

チャットGPTの基本

ChatGPTは人間の会話をシミュレートするように設計されており、ウェブアプリケーション、モバイルアプリケーション、ソーシャルメディアプラットフォームに導入することができます。ChatGPTを使用するには、ユーザーがチャットウィンドウに質問を入力する必要があり、チャットボットは自然言語処理(NLP)アルゴリズムを使って質問を分析します。そして、分析されたデータに基づいて、最も関連性の高い回答をユーザーに提供します。

ChatGPTは、さまざまなユーザーのニーズに合わせてカスタマイズすることができる。例えば、ユーザーはチャットボットのトーン、言語、スタイルを選択し、よりパーソナライズされたものにすることができます。

ChatGPTは、ユーザーからのフィードバックを分析することで、常に学習し、対応を改善しています。また、機械学習やディープラーニングアルゴリズムなどの他のテクノロジーツールとも統合されており、精度と効率を高めています。

ChatGPT はソフトウェアを書くことができますか?

ChatGPTは、Python、Java、JavaScript、C++などの様々なプログラミング言語で、コードを含むテキストを生成することができます。ただし、ChatGPTが生成したコードが正しい場合や最適な場合もありますので、本番で使用する前に人間のプログラマーによるレビューとテストが必要です。

また、ChatGPT のコードを書く能力は、トレーニングされたプログラミングパラダイム、ライブラリ、構文に制限されます。そのため、モデルは特定のデータセットで学習され、そのデータセットの範囲内でしかコードを生成できないため、特定のドメインや特殊なドメインのコードしか生成できない可能性があります。

ChatGPTはコードを生成することはできますが、人間のプログラマーの代わりにはなりません。人間のプログラマーは、AIモデルには欠けているコンテキスト、洞察、経験を提供することができます。例えば、プログラマーはコードが最適化され、効率的で、業界標準に準拠していることを確認することができます。

ChatGPT の限界

ChatGPTの主な限界の1つは、会話の文脈を理解できないことです。ChatGPTは会話で使用される単語やフレーズに基づいて応答を生成することができますが、その根本的な意味を理解するのに手助けが必要な場合があります。その結果、会話に関係のない回答や不適切な回答が返ってくることがあります。その他の制限事項

限られた知識ベース

ChatGPTの限界は、知識ベースが限られていることです。ChatGPTは膨大な情報にアクセスすることができますが、特定の質問に答えるためには、より具体的な情報が必要になることがあります。この限界は「幻覚」と呼ばれることもあり、意味不明な答えが返ってくることがあるので、修正または完了する必要があります。このブログ記事で、正解と比較した幻覚の例をいくつか見ることができる。

文脈の欠如

ChatGPTの主な限界の一つは、会話の文脈を理解できないことです。ChatGPTは会話で使用された単語やフレーズに基づいて回答を生成することができますが、その根本的な意味を理解するのに手助けが必要な場合があります。このような文脈の欠如により、ディスカッションに関係のない、または不適切な応答が行われる可能性があります。

バイアス

すべての言語モデルと同様に、ChatGPTは回答に偏りを示すことがあります。このバイアスは、バイアスやステレオタイプが含まれている可能性のある学習データから学習するためです。その結果、差別的または攻撃的な応答が返されることがあります。

感情的知性の欠如

ChatGPTはユーザーの感情を理解したり、共感したりすることができません。この感情的な知性の欠如は、ユーザーの感情的な状態に対して無頓着であったり、鈍感な応答となる可能性があります。

多言語サポートの制限

ChatGPTは主に英語のデータでトレーニングされているため、他の言語では効果が低い可能性があります。異なる言語での応答を生成することができますが、これらの応答の品質と精度は、英語で生成されたものよりも低い可能性があります。

ChatGPTは強力な技術ですが、その限界を認識し、適切に使用することが重要です。

ChatGPT の使用例にはどのようなものがありますか?

ChatGPTは最先端の言語モデルであり、タスクを自動化し、ユーザーにパーソナライズされた支援を提供するために、様々なアプリケーションで使用することができます。ChatGPTのユースケースをいくつかご紹介します:

バーチャルアシスタンス:ChatGPTをSiriやAlexaのようなバーチャルアシスタントに統合することで、ユーザーの問い合わせに対して人間のような応答を提供することができます。バーチャルアシスタントは、全体的なユーザーエクスペリエンスを向上させ、人間のアシスタントの作業負荷を軽減することができます。

サポートチャットボット:ChatGPTは、顧客からの問い合わせに対応し、適切なソリューションを提供できるサポートチャットボットを作成するために使用できます。ChatGPTを使用すると、チャットボットはユーザーの意図を理解し、コンテキストに基づいてパーソナライズされた応答を提供することができます。

コンテンツ作成:ChatGPTは、記事作成、メールマーケティング、ソーシャルメディア投稿などのコンテンツ作成アプリケーション用のテキストを生成できます。ChatGPTにトピックやプロンプトを提供することで、数秒以内に高品質のコンテンツを生成できます。

言語翻訳:ChatGPTはコンテンツをある言語から別の言語に翻訳することができます。この機能は、異なる言語を話す人々の間のコミュニケーションを改善したり、ユーザーにローカライズされたコンテンツを提供することができます。

これらは、ChatGPTがどのようにタスクを自動化し、ユーザーエクスペリエンスを向上させることができるかのほんの一例に過ぎません。ChatGPTが進化し続けるにつれて、より多くのユースケースが出てくるでしょう。

ChatGPT は他のアプリケーションと統合できますか?

OpenAIはAPIとライブラリを提供しており、開発者は自分のアプリケーションとChatGPTを統合することができます。OpenAIがサポートしているライブラリはPythonとNode.jsですが、コミュニティはすでにC#/.Net、Crystal、Go、Java、Kotlin、PHP、R、Ruby、Scala、Swift、Unityの素晴らしいサポートを提供しています。 ChatGPTで動作するツールとプラグイン

ChatGPT 取得プラグイン

Knowledge Base Retrieval Plugin](https://github.com/openai/chatgpt-retrieval-plugin)は、ChatGPTが外部でホストされているドキュメントスニペットから重要な情報を抽出するためのツールです。ChatGPTが自然言語でニーズを伝えたり、質問をすることで、収集・保存しているファイルやメモ、メールなど様々なソースから必要なデータを取得することができます。この機能により、ChatGPTは正確で信頼できる情報を素早く効率的に提供することができます。

ChatGPT検索プラグインGitHubリポジトリ](https://assets.zilliz.com/Screenshot_2023_05_09_at_5_21_01_PM_82c65cd5e5.png)

Milvus](https://github.com/openai/chatgpt-retrieval-plugin/tree/main/docs/providers/milvus)とZillizの両方に対応したRetrieval Pluginがあり、ChatGPT Pluginで社内文書の検索を効率化することで、企業はこのプラグインの恩恵を受けることができます。 このプラグインを使用することで、従業員は単一のソースから正確で最新の情報にアクセスすることができます。さらに、開発者はこのプラグインを利用して、独自のナレッジベースを作成・管理することができます。

オートGPT

Auto-GPT は、Significant Gravitasという開発者が最近GitHubで共有したPythonアプリケーションである。GPT-4を基盤として利用するこのプログラムは、各行動にユーザーからのプロンプトを必要とすることなく、AIが独立して機能することを可能にする。AIエージェント」という概念はこの機能から生まれたもので、AIはインターネットを利用し、ユーザーの介入なしに自律的にコンピューター上でコマンドを実行することができる。

ミニGPT-4

MiniGPT-4は、高度な大規模言語モデルによって視覚情報とテキスト情報の理解を強化する最先端の視覚言語モデルです。事前に学習されたViTとQ-Formerを特徴とするビジョンエンコーダ、単一の線形射影層、および先進的なVicuna大規模言語モデルを含む。MiniGPT-4は、視覚的特徴をVicunaと整合させるために、線形射影レイヤーをトレーニングするだけです。MiniGPT-4は、詳細な画像説明を生成する機能や、手書きの原稿からウェブサイトを作成する機能など、GPT-4と同様の多くの機能を備えています。さらに、与えられた画像からインスピレーションを得て物語や詩を書いたり、画像に示された問題に対する解決策を提供したり、料理の写真から料理の作り方を教えたりといった新しい機能も備えている。

新しいAIスタックの紹介 - ChatGPT+Vector Database+Prompt-as-code (CVP)

ChatGPTは印象的です。そして今、ベクター・データベースが、ChatGPTの限られた知識ベースのハンディキャップをどのように最小化できるかを強調する時です。新しいAIスタック、ChatGPT、ベクター・データベース、プロンプト・アズ・コード、またはCVPスタックを紹介します。ChatGPTは、自然言語の質問に答えるのに素晴らしい仕事をする。ユーザーのクエリと検索されたテキストを結びつけるプロンプトと組み合わせることで、ChatGPTが「幻覚のような答え」を出すのを緩和し、代わりにChatGPTが適切で正確な回答を生成することができます。

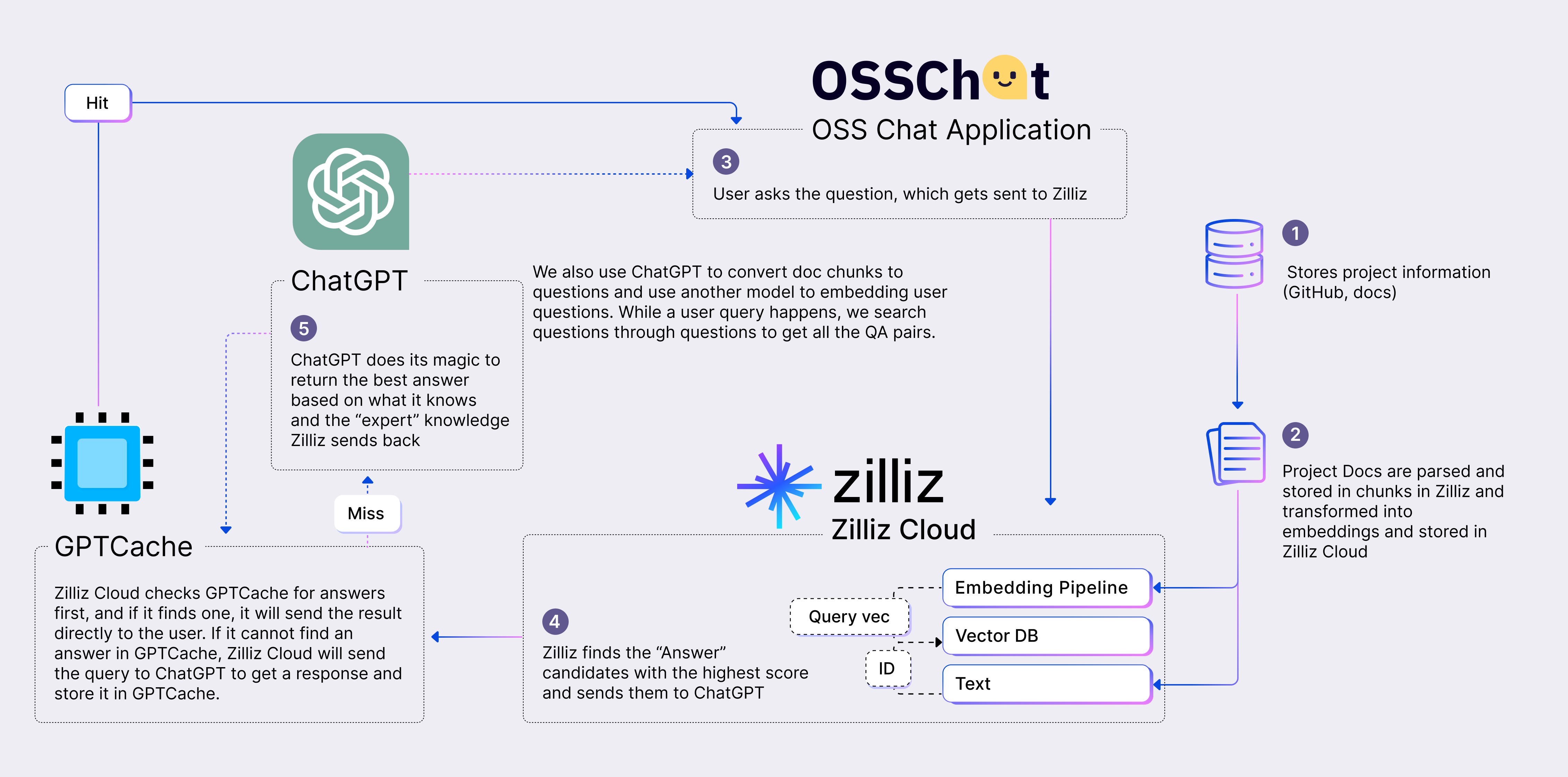

OSSチャットオープンソースプロジェクトに関する技術知識のためのチャットボット

OSSチャットは、お気に入りのオープンソースプロジェクトに関する技術的な知識を提供するチャットボットです。OSSチャットの現在のリリースでは、Hugging Face、Pytorch、Mini-GPT-4、Auto-GPT、OpenCV、LangChain、Next.js、Ray、React、Vue.js、React Native、Milvusをサポートしていますが、他のいくつかの人気のあるオープンソースプロジェクトに拡張する予定です。OSSチャットは、OpenAIのChatGPTとベクターデータベースのZillizを使って構築されました。一番の特徴は?私たちは、それを使う人なら誰でも無料のサービスとして提供しています。もし、あなたのオープンソースプロジェクトを掲載したい場合は、お知らせください。

OSSチャット図.png

OSSチャット図.png

ChatGPTは自然言語クエリに答えるための優れた技術です。しかし、知識ベースが限られているため制約があり、知らないトピックについて質問されると幻覚のような答えが返ってくることがあります。

この制約を克服するために、我々はChatGPT + Vectorデータベース + prompt-as-codeという新しいAIスタックを導入しました。

ChatGPTを、ユーザのクエリと検索されたテキストを結びつけるプロンプトと組み合わせると、適切で正確な応答が生成されます。このアプローチにより、ChatGPTが "幻覚のような回答 "を提供するのを緩和することができます。

CVP スタックの実用的なデモンストレーションとして、OSS Chat を構築しました。オープンソースプロジェクトの様々な GitHub リポジトリと、関連するドキュメントページを真実のソースとして活用します。このデータをエンベッディングに変換してZillizに保存し、関連するコンテンツは別のデータストアに保存します。

ユーザーが任意のオープンソースプロジェクトについて質問することによってOSS Chatと対話するとき、我々は関連する一致を見つけるためにZillizで類似検索をトリガします。検索されたデータはChatGPTに供給され、正確で精度の高い回答を生成します。

LLM レスポンスを保存するセマンティックキャッシュの構築:GPTCache

セマンティックキャッシュはアプリケーションにいくつかの利点をもたらす強力なツールです。LLMのレスポンスを保存するためにセマンティックキャッシュを構築するときに期待できる利点のいくつかを紹介します:

パフォーマンスの向上。LLM レスポンスをキャッシュに保存することで、レスポンスの取得にかかる時間を大幅に短縮することができます。これは、レスポンスが以前にリクエストされ、すでにキャッシュに存在している場合に特に当てはまります。レスポンスをキャッシュに格納することで、アプリケーション全体のパフォーマンスが向上します。

費用の削減。ほとんどのLLMサービスは、リクエスト数とトークン数の組み合わせに基づいて料金を請求します。LLMのレスポンスをキャッシュすることで、サービスへのAPI呼び出し回数を減らすことができ、コスト削減につながります。これは、APIコールの費用が大きくなる可能性のある、高いトラフィックレベルを扱う場合に特に関連します。

スケーラビリティの向上。LLM応答をキャッシュすることで、LLMサービスの負荷を軽減し、アプリケーションのスケーラビリティを向上させることができます。キャッシュはボトルネックの回避に役立ち、アプリケーションが増大するリクエストに確実に対応できるようにします。

カスタマイズ。セマンティックキャッシュは、入力のタイプ、出力フォーマット、レスポンスの長さなど、特定の要件に基づいてレスポンスを保存するようにカスタマイズすることができます。これはキャッシュを最適化し、より効率的にするのに役立ちます。

ネットワークの待ち時間の短縮。セマンティックキャッシュをユーザーの近くに配置することで、LLMサービスからのデータ取得にかかる時間を短縮することができます。ネットワークの待ち時間を減らすことで、全体的なユーザーエクスペリエンスを向上させることができます。

LLMのレスポンスを保存するためのセマンティックキャッシュを構築することで、パフォーマンスの向上、費用の削減、拡張性の向上、カスタマイズ性、ネットワーク遅延の短縮など、いくつかの利点が得られます。これを念頭に、私たちはGPTCacheを構築し、オープンソース化しました。

GPTCacheは、言語モデルによって生成された応答を保存するキャッシュを実装することによって、GPTベースのアプリケーションの効率と速度を改善するために設計されたオープンソースのツールです。GPTCacheでは、埋め込み関数、類似度評価関数、保存場所、退避などのオプションを含め、ユーザーが必要に応じてキャッシュをカスタマイズすることができます。また、GPTCacheは現在OpenAI ChatGPTインターフェースとLangChainインターフェースをサポートしています。

主要リソース

- ZillizとMilvusによるChatGPT検索プラグイン](https://zilliz.com/blog/chatgpt-retrieval-plugin-zilliz-milvus)

- ChatGPT用キャッシュ](https://zilliz.com/blog/Yet-another-cache-but-for-ChatGPT)

- パフォーマンスとコスト改善のためのLLMクエリのキャッシュ](https://zilliz.com/blog/Caching-LLM-Queries-for-performance-improvements)

読み続けて

大規模言語モデルと検索

ラージ・ランゲージ・モデル(LLM)と検索技術の統合について、ZillizとMilvusによる実際の応用例や進歩を紹介します。

ファルコン180B大型言語モデル(LLM)の紹介

Falcon 180Bは、3.5兆のトークンで学習された180Bのパラメータを持つオープンソースの大規模言語モデル(LLM)です。 このブログでそのアーキテクチャと利点を学んでください。

PagedAttentionを用いた大規模言語モデルサービングの効率的なメモリ管理

PagedAttentionとvLLMは、LLMのサービスにおける重要な課題、特に推論にGPUメモリを使用する際の高いコストと非効率性を解決する。