HNSWlib vs ScaNN:アプリケーションに適したベクトル検索ツールの選択

AIを活用したアプリケーションが増え続ける中、高速でスケーラブルなベクトル検索ツールの必要性が不可欠となっている。ベクトル検索は、推薦システム、画像検索、自然言語処理(NLP)など、高次元データ間の類似性を見つけることが重要な分野で重要な要素となっている。ベクトル検索に利用可能な数多くのツールの中で、HNSWlib と ScaNN は広く利用されている2つの選択肢であり、それぞれが明確な利点を提供している。

この記事では、HNSWlib と ScaNN を比較し、それぞれの特徴、検索方法、スケーラビリティ、使用例に焦点を当て、どちらがあなたのニーズに適しているかを判断するのに役立ちます。

ベクトル検索とは?

HNSWlib と ScaNN の具体的な説明に入る前に、ベクトル検索について理解しておく必要があります。簡単に言うと、ベクトル検索、またはベクトル類似性検索は、与えられたクエリベクトルに最も近い高次元空間のベクトル(データポイント)を見つけます。これらのベクトルは多くの場合、機械学習モデルによって生成され、非構造化データの本質(例えば、文章の意味や画像の特徴)を捉える。

完全一致やフィルタリングに基づいて検索する従来のデータベースとは異なり、ベクトル検索は類似性に焦点を当てる。その目的は、距離メトリック(ユークリッド距離や余弦類似度など)に基づいて、互いに「近い」ベクトルを見つけることである。例えば、ベクトルは自然言語処理(NLP)において単語や文章を表すことができ、ベクトル検索は最も意味的に類似した単語や文章を見つけるのに役立つ。推薦システムでは、ベクトル検索はユーザーの好みに最も近いアイテムを特定する。ベクトル検索は、retrieval augmented generation (RAG)、大規模言語モデル(LLMs)に余分な文脈情報を提供することでその出力を補強する技術、においても重要な役割を果たしている。

市場には、ベクトル検索を実行するための多くのソリューションがあります:

- HNSWlibやScaNNのようなベクトル検索ライブラリ。

- Milvus](https://zilliz.com/what-is-milvus)、Zilliz Cloud (フルマネージドMilvus)のような目的別ベクトルデータベース。

- Chroma](https://zilliz.com/blog/milvus-vs-chroma)やMilvus Liteのような軽量ベクトルデータベース。

- 従来のデータベース ベクトル検索アドオン付き。

HNSWlib とは?概要

HNSWlib (Hierarchical Navigable Small World)は、スモールワールドグラフに基づく高速な 近似最近傍探索 (ANNS) アルゴリズムを実装したオープンソースライブラリです。この手法により、高次元ベクトル空間において非常に効率的な検索が可能になります。HNSWlibは検索速度とメモリ効率のバランスで人気があり、高速検索が重要なアプリケーションの強力なツールとなっている。

HNSWlib のコア機能と強み

HNSWlib の主な利点の 1 つは、ベクトル検索に対する グラフベースのアプローチ です。このライブラリは、各ノードがベクトルを表し、ノード間の接続が他のベクトルへの近接性を表すグラフを構築します。クエリが作成されると、検索アルゴリズムはグラフをナビゲートし、最も類似したベクトルを見つけます。

- インメモリ検索**:HNSWlib はすべての処理をメモリ上で行うため、低レイテンシ検索が可能です。このため、リアルタイム・アプリケーションに最適です。

- 効率的な検索階層的なグラフ構造により、大規模なデータセットでも近似最近傍探索を高速に行うことができます。

- 使いやすさHNSWlib はセットアップが簡単で、 多くの設定を必要としません。最小限のチューニングですぐに使えるように設計されているため、 高速で使いやすいベクトル検索ツールを求める開発者に最適です。

HNSWlib とベクトル検索の統合方法

HNSWlib のベクトル検索機能は、グラフベースのアプローチを中心に展開 されます。ライブラリは階層グラフを構築し、クエリはこのグラフをトラバースして処理され、クエリに近いベクトルを見つけるためにノード間をジャンプします。この方法は、必要な比較の回数を減らし、検索処理を高速化する。しかし、HNSWlib は近似最近傍探索ツールであるため、常に正確な最近傍を返すとは限りませんが、最小限の遅延でそれを行うというトレードオフがあります。

ScaNN とは?概要

ScaNN (Scalable Nearest Neighbors)はGoogleによって開発されたベクトル検索ライブラリである。大規模なデータセットを高効率かつ高速に処理するように設計されている。推薦エンジン、画像検索、NLPタスクなど、高速なベクトル検索を必要とするアプリケーションにとって強力なツールです。ScaNN は 近似最近傍探索(ANNS) 向けに最適化されており、速度と精度のバランスが取られています。

ScaNN のコア機能と強み

ScaNN は、数十億のベクトルを含むような 大規模なデータセット を効率的に処理するように構築されています。これは、パーティショニング、量子化、非対称ハッシュなどのテクニックの組み合わせによって達成される。これらの手法は、探索空間を縮小し、メモリ使用量と探索速度を向上させるのに役立つ。

- パーティショニングと量子化**:ScaNN はデータセットを小さなクラスターに分割し、ベクトルを圧縮してメモリ使用量を削減します。

- カスタマイズ可能なトレードオフ**:ScaNNは、ユーザーが検索速度と精度のバランスをコントロールできるため、様々なユースケースに柔軟に対応できる。

- TensorFlowとの統合:ScaNNはTensorFlow**とシームレスに統合されており、埋め込みやベクトル表現を使用する機械学習ワークフローに簡単に組み込むことができます。

ScaNN のベクトル検索処理方法

ScaNN は 近似最近傍探索 に焦点を当て、分割や量子化のようなテクニックを使用してパフォーマンスを向上させます。データセットをより小さなパーティションに分割することで、ScaNN は検索空間を狭め、高速なクエリ処理を可能にします。また、メモリ使用量を削減するベクトル圧縮もサポートしているため、ScaNN は大規模データを効率的に処理する必要があるアプリケーションに適しています。

HNSWlib と ScaNN の主な違い

HNSWlib と ScaNN はどちらも高速な近似最近傍探索のために設計されていますが、探索方法、データ処理アプローチ、スケーラビリティ、柔軟性など、いくつかの点で異なっています。これらの違いを詳しく調べてみよう。

検索方法

HNSWlibはグラフベースの検索アルゴリズムに基づいています。各ノードがベクトルを表すグラフを構築し、検索アルゴリズムはグラフをナビゲートして近傍を見つけます。階層的なグラフ構造により、HNSWlib は近似近傍を素早く見つけ、必要な比較回数を最小限に抑えることができます。この方法は、スピードが重要なインメモリ検索に特に効果的です。

一方、ScaNN は、パーティショニング と量子化 を組み合わせて検索空間を縮小する。ScaNN はデータセットをパーティションにクラスター化し、最も関連性の高いパーティション内で検索を実行する。これにより ScaNN は、精度と速度のバランスを保ちながら、非常に大きなデータセットを効率的に扱うことができる。ScaNN はベクトル圧縮に重点を置くことで、スケーラビリティをさらに高めている。

データ処理

HNSWlib は インメモリデータセット を扱うように設計されており、検索のために データセット全体を RAM にロードする必要があります。このアプローチは低レイテンシー検索を保証しますが、データセットが大きすぎてメモリに収まらない場合はスケーラビリティが制限されます。

ScaNN はデータの取り扱いに関してより柔軟である。ベクトル圧縮とパーティショニングを使用してメモリ使用量を削減し、より大きなデータセット**をより効率的に扱うことができる。ScaNNは主にメモリ上で動作するが、その圧縮技術により、メモリが制約となるアプリケーションに適している。

スケーラビリティとパフォーマンス

スケーラビリティの面では、ScaNN が HNSWlib よりも優れている。ScaNN のパーティショニングと量子化技術により、非常に大きなデータセッ トに対してより効果的にスケーリングできる。高い検索速度を維持しながら数十億のベクトルを扱えるように設計されているため、データセットのサイズが重要な意味を持つ大規模アプリケーションに特に適しています。

HNSWlibは中規模データセットでは良好な性能を発揮するが、メモリ内演算には限界がある。データセットが大きくなるにつれて、必要なメモリは増加し、これがスケーラビリティの制限要因となり得る。しかし、メモリに余裕で収まるデータセットに対しては、 HNSWlib は優れた速度を提供し、 リアルタイム検索アプリケーション に最適です。

柔軟性とカスタマイズ

ScaNNは、特に検索速度と精度のバランスに関して、より多くのカスタマイズ・オプションを提供する。ユーザーは、アプリケーションの特定の要件に基づいて、スピードや精度を優先するようにシステムを微調整できる。この柔軟性により、ScaNNは様々なユースケースに適応できる。

HNSWlibはカスタマイズ性は低いが、使い方はシンプルだ。HNSWlib**は、カスタマイズ性は低いが、使い方はシンプルで、最小限の設定だけですぐに効率的に動作するように設計されている。そのため、パラメータを細かく調整する必要がなく、高速で使いやすいソリューションを求める開発者には最適な選択肢となります。

統合とエコシステム

ScaNNはTensorFlowと緊密に統合されており、すでにこのフレームワークに依存している機械学習アプリケーションにとって理想的な選択肢となっている。TensorFlow との統合により、機械学習ワークフローにおけるベクトル探索プロセスが簡素化され、特に埋め込みを含むタスクに適しています。

HNSWlibは、ScaNNほど機械学習フレームワークと深く統合されてはいないが、Pythonベースのアプリケーションに簡単に統合できるスタンドアロンライブラリだ。レコメンデーション・エンジンからNLPアプリケーションまで、様々な業界で広く使われており、そのシンプルなAPIは既存のシステムに組み込むことを容易にしています。

使いやすさ

HNSWlibはそのシンプルさで知られています。セットアップが簡単で、最小限の設定しか必要とせず、デフォルト設定で効率的に動作します。このため、ベクトル検索に 単純で高速なソリューション を必要とする開発者に最適です。

ScaNNもユーザーフレンドリーではあるが、特に速度と精度のトレードオフを微調整する際には、もう少しセットアップが必要になる。しかし、TensorFlowエコシステム内で作業する開発者にとっては、ScaNNの統合のしやすさはワークフローを合理化することができる。

コストの考慮

コスト面では、HNSWlib は CPU ベースの検索に最適化されており、操作はすべてメモリ内で実行されるため、必要なハードウェアが少なくて済む。しかし、データセット全体を保持するのに十分なメモリが必要なため、データセットが大きい場合はコストが増加する可能性がある。

より大きなデータセットを効率的に扱うことに重点を置くScaNNは、特にメモリの点で、より多くの計算資源を必要とするかもしれない。しかし、ベクトルを圧縮し、データセットを分割する能力は、全体的なメモリ使用量を削減するのに役立ち、大規模アプリケーションのインフラストラクチャー・コストを削減できる可能性がある。

セキュリティ機能

HNSWlib も ScaNN も、暗号化やアクセス制御のようなセキュリティ機能を内蔵してい ません。開発者は、データの暗号化やユーザー認証など、アプリケーションの特定の要件に基づいて独自のセキュリティ対策を実装する必要があります。より高度なセキュリティや可用性が必要な場合は、Milvus**のような、ScaNN や HNSWlib よりもはるかに高度でエンタープライズレベルの機能を備えた **目的別ベクターデータベースを選択することができます。

HNSWlib を選ぶとき

HNSWlib は、** 中規模のデータセット** を対象とした、** 高速な インメモリ検索ソリューション** が必要な場合に最適です。HNSWlib のグラフベースのアプローチは、 低レイテンシ検索 を提供し、 検索速度が重要な リアルタイムアプリケーション に最適です。また、HNSWlib はセットアップが簡単で、カスタマイズの必要があまりないため、大規模な微調整を必要とせず、迅速で効率的なソリューションを求める開発者に最適です。

HNSWlib は次のような場合にご利用ください:

- メモリに余裕で収まる 中規模データセット を扱う場合。

- 最小限の待ち時間でリアルタイム検索機能が必要な場合。

- 最小限の設定でシンプルなセットアップを好む。

ScaNNを選ぶとき

ScaNNは、大規模なデータセットを扱い、高効率でスケーラブルなソリューションが必要な場合に適しています。数十億のベクトルを扱うことができ、パーティショニングと量子化技術と組み合わされることで、速度とメモリ効率が不可欠なアプリケーションに最適です。ScaNN は、TensorFlow を使用し、高速な近似最近傍探索を必要とする 機械学習ワークフロー に特に適しています。

次のような場合に ScaNN を使用してください:

- 大規模なデータセット**を扱う場合。

- アプリケーションに TensorFlow との統合が必要な場合。

- 検索速度と精度**のバランスが必要な場合。

ベクター検索ライブラリと専用ベクターデータベースの比較

HNSWlibやScaNNのようなベクトル検索ライブラリも、Milvusのような目的別ベクトルデータベースも、高次元ベクトルデータの類似性検索問題を解決することを目的としていますが、その役割は異なります。

ベクトル検索ライブラリは、効率的な最近傍探索のタスクだけに焦点を当てています。これらのライブラリは、クエリーベクトルに類似したベクトルを見つけるための軽量で高速なソリューションを提供します。これらのライブラリは、小規模なシングルノード環境や、静的または中程度のサイズのデータセットを持つアプリケーションでよく使用されます。しかし、一般的に、動的データの管理、永続性の提供、分散システム間でのスケーリングなどの機能が欠けている。これらのライブラリを使用する開発者は、通常、データ管理、更新、スケーリングを手動で処理する必要がある。

一方、MilvusやZilliz Cloud(マネージドMilvus)のような目的別ベクトルデータベースは、大規模なベクトルデータ管理のために設計された包括的なシステムです。これらのデータベースは単純なベクトル検索にとどまらず、永続ストレージ、リアルタイム更新、分散アーキテクチャ、高度なクエリ機能などの機能を提供している。これらのデータベースは動的なデータセットをサポートし、データが頻繁に更新されるリアルタイムアプリケーションを容易に扱うことができます。さらに、ベクターデータベースには、ベクター検索と従来のフィルタリングやメタデータクエリを組み合わせるための統合サポートが含まれていることが多く、スケーラビリティ、高可用性、より複雑な検索機能を必要とする本番環境に最適です。

- Zilliz Cloudの最新の新機能と機能強化をご覧ください:Zilliz Cloudアップデート:マイグレーションサービス、Fivetranコネクター、マルチレプリカ、その他

各ベクトル検索ソリューションを選択するタイミング

ベクターサーチ・ライブラリー**を選択する場合:

- 小規模から中規模の比較的静的なデータセットを持っている。

- インデックス作成と検索アルゴリズムを完全にコントロールしたい。

- 既存のシステムに検索を組み込み、インフラを管理できる。

目的別ベクターデータベース**を選択する場合:

- 分散システムで数十億ベクトルまで拡張する必要がある。

- データセットが頻繁に変更され、リアルタイムの更新が必要な場合。

- ストレージ、スケーリング、クエリの最適化を代行してくれるマネージドソリューションを好む。

まとめると、ベクトル検索ライブラリ は、スピードとメモリ効率が優先されるが、運用の複雑さは最小限の、よりシンプルで小規模なユースケースに最適である。これとは対照的に、目的別ベクターデータベース は、動的なデータ処理、スケーラビリティ、使いやすさが要求される大規模なプロダクショングレードのシステム向けに設計されており、多くの場合、複雑なアプリケーションを管理する開発者に大きな運用上のメリットをもたらします。

あらゆるベクトル検索ソリューションの評価と比較

さて、さまざまなベクトル検索ソリューションの違いはわかった。次の疑問は、検索アルゴリズムが正確な結果を確実に、しかも高速に返すにはどうすればいいか?様々なANNアルゴリズムの有効性を、特に規模に応じてどのように評価するか?

これらの質問に答えるには、ベンチマークツールが必要である。そのようなツールは数多くあるが、最も効率的なものとして2つが挙げられる:**ANNベンチマーク](https://zilliz.com/glossary/ann-benchmarks)とVectorDBBenchである。

ANNベンチマーク

ANN Benchmarks](https://zilliz.com/glossary/ann-benchmarks) (Approximate Nearest Neighbor Benchmarks)は、様々な近似最近傍(ANN)アルゴリズムの性能を評価・比較するために設計されたオープンソースプロジェクトである。高次元ベクトル探索などのタスクで異なるアルゴリズムをベンチマークするための標準化されたフレームワークを提供し、開発者や研究者が様々なデータセットで探索速度、精度、メモリ使用量などのメトリクスを測定することを可能にします。ANN-Benchmarksを使うことで、Faiss、Annoy、HNSWlibなどのライブラリにあるようなアルゴリズムの速度と精度のトレードオフを評価することができます。

ANN Benchmarks GitHub リポジトリ: https://github.com/erikbern/ann-benchmarks

ANNベンチマークウェブサイト: https://ann-benchmarks.com/

VectorDBBench: オープンソースのベンチマークツール

VectorDBBenchは、高性能なデータ保存・検索システム、特にベクトルデータベースを必要とするユーザーのために設計されたオープンソースのベンチマークツールです。このツールにより、ユーザは独自のデータセットを用いてMilvusやZilliz Cloud(マネージドMilvus)などの異なるベクトルデータベースシステムの性能をテスト・比較し、ユースケースに最も適したものを決定することができる。VectorDBBenchはPythonで書かれており、MITオープンソースライセンスの下でライセンスされている。

VectorDBBenchのGitHubリポジトリ: https://github.com/zilliztech/VectorDBBench

VectorDBBench Leaderboard](https://zilliz.com/vector-database-benchmark-tool?database=ZillizCloud%2CMilvus%2CElasticCloud%2CPgVector%2CPinecone%2CQdrantCloud%2CWeaviateCloud&dataset=medium&filter=none%2Clow%2Chigh&tab=1)**で主流のベクトルデータベースのパフォーマンスを簡単に見てみましょう。

VectorDB評価のテクニックと洞察:

- ベンチマークベクターデータベースのパフォーマンス:テクニックと洞察](https://zilliz.com/learn/benchmark-vector-database-performance-techniques-and-insights)

- ベクターデータベースを他のデータベースと比較する](https://zilliz.com/comparison)

VectorDB、GenAI、MLに関するその他のリソース

- ジェネレーティブAIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

- あなたのGenAIアプリのためのトップパフォーマンスAIモデル|Zilliz](https://zilliz.com/ai-models)

- RAGとは](https://zilliz.com/learn/Retrieval-Augmented-Generation)

- 大規模言語モデル(LLM)を学ぶ](https://zilliz.com/learn/ChatGPT-Vector-Database-Prompt-as-code)

- ベクトルデータベース101](https://zilliz.com/learn/what-is-vector-database)

- 自然言語処理(NLP)](https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models)

読み続けて

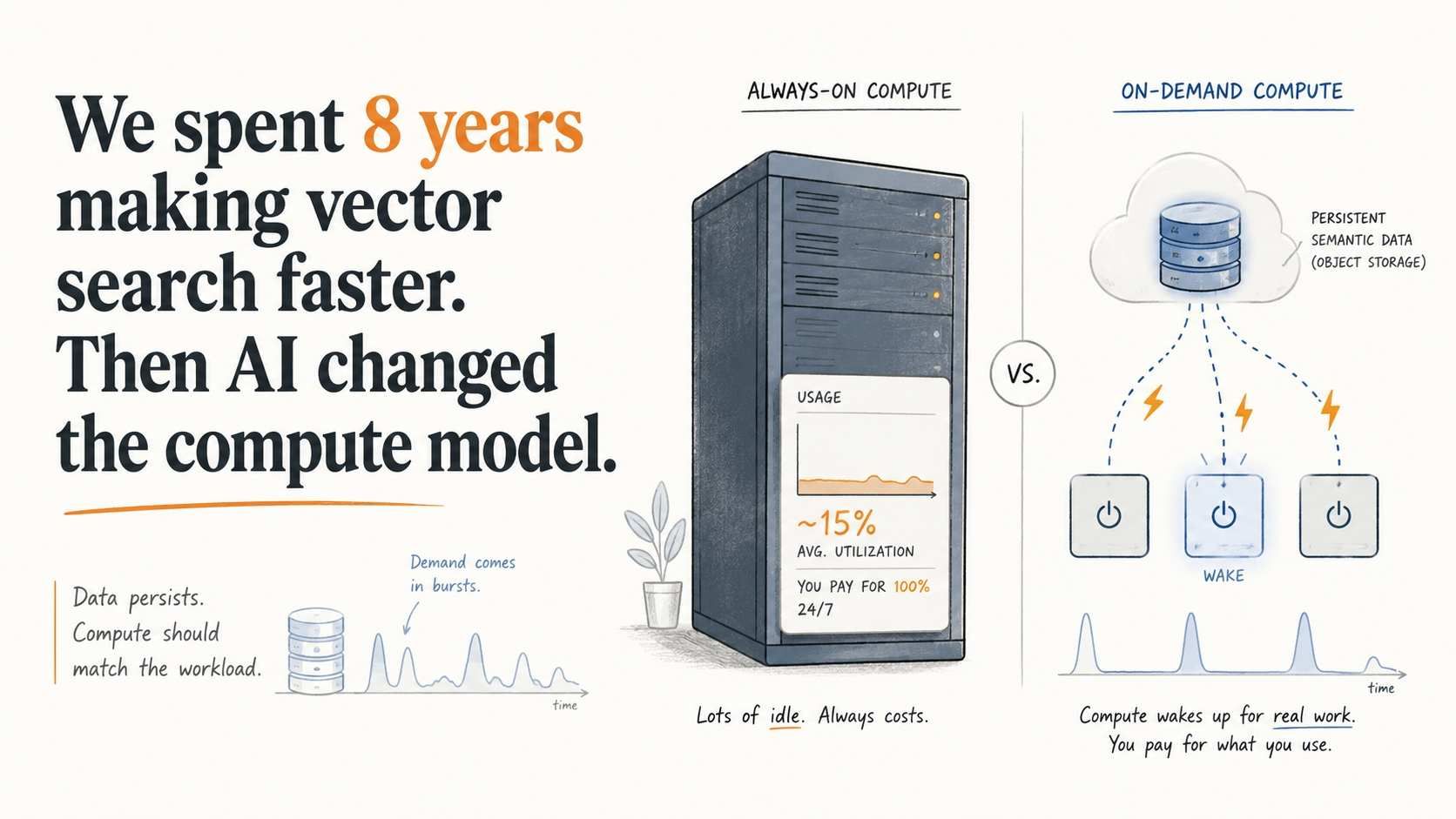

We spent 8 years making vector databases faster. Then we stopped.

Rarely queried embeddings still need to stay searchable. See how Vector Lakebase enables on-demand vector search without always-on compute costs.

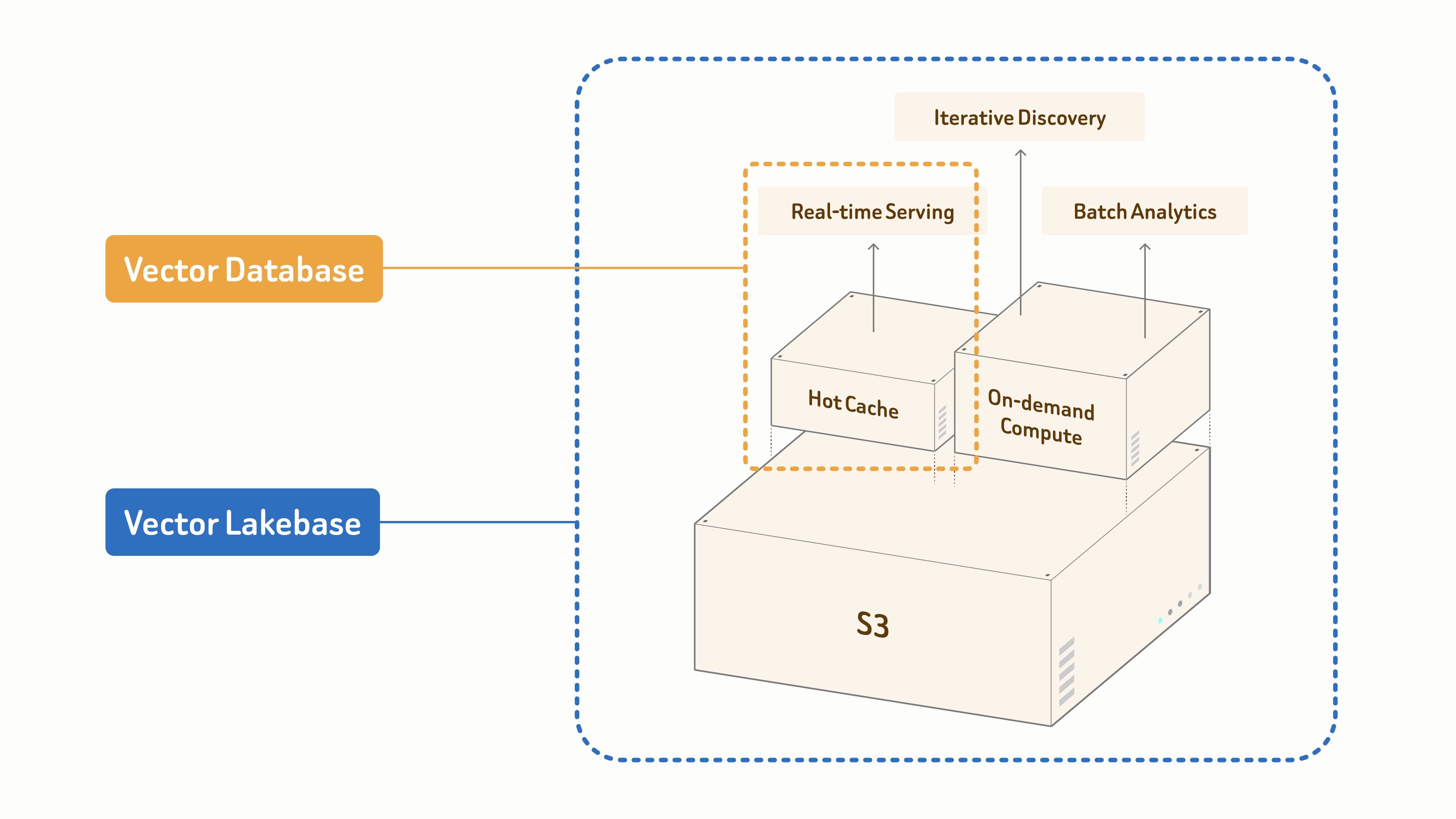

From Vector Database to Vector Lakebase

Zilliz offers a fully managed Vector Lakebase powered by Milvus, unifying real-time vector search, lake-scale discovery, and Al data operations.

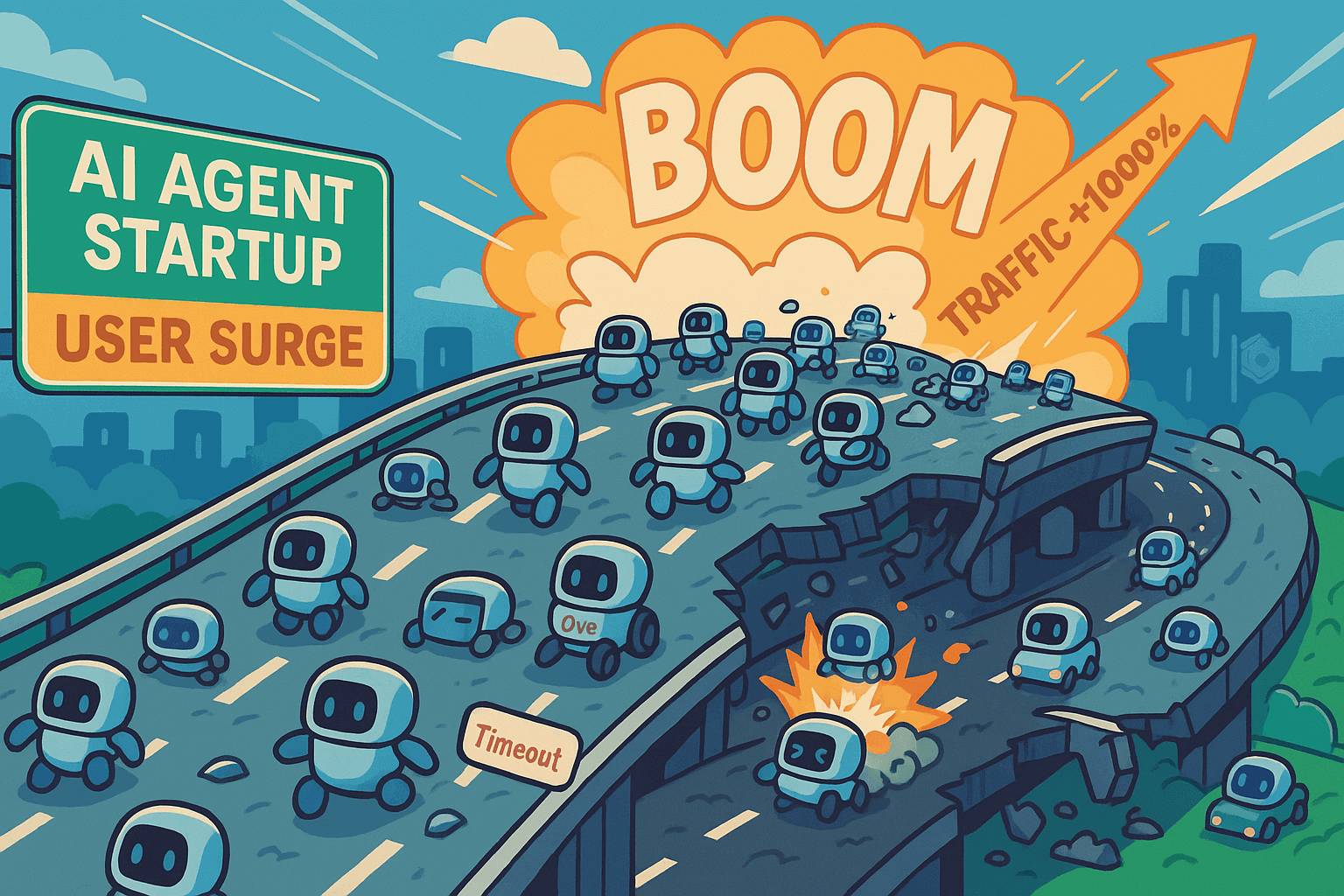

Why Not All VectorDBs Are Agent-Ready

Explore why choosing the right vector database is critical for scaling AI agents, and why traditional solutions fall short in production.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.