Elasticsearch vs Vearch GenAIアプリケーションに適したデータベースの選択

AI主導のアプリケーションが進化する中、これらの進化をサポートするベクトル検索機能の重要性はいくら強調してもし過ぎることはない。このブログ記事では、ベクトル検索機能を持つ2つの著名なデータベースについて説明する:Elasticsearch と Vearch です。ElasticsearchとVearch**である。それぞれ、推薦エンジン、画像検索、セマンティック検索などのアプリケーションに不可欠なベクトル検索を扱うための堅牢な機能を提供している。私たちのゴールは、開発者やエンジニアに明確な比較を提供し、どのデータベースが彼らの特定の要件に最も適しているかを判断する手助けをすることです。

ベクターデータベースとは?

Elasticsearch と Vearch を比較する前に、まずベクターデータベースのコンセプトについて説明します;

ベクトルデータベース](https://zilliz.com/learn/what-is-vector-database) は高次元のベクトル を保存し、クエリするために特別に設計されています。ベクトルは非構造化データ の数値表現です。これらのベクトルは、テキストの意味、画像の視覚的特徴、または製品の属性などの複雑な情報をエンコードします。効率的な類似検索を可能にすることで、ベクトルデータベースはAIアプリケーションにおいて極めて重要な役割を果たし、より高度なデータ分析と検索を可能にしている。

ベクトルデータベースの一般的なユースケースには、電子商取引の商品推奨、コンテンツ発見プラットフォーム、サイバーセキュリティにおける異常検知、医療画像分析、自然言語処理(NLP)タスクなどがある。また、AI幻覚のような問題を軽減するために、外部知識を提供することによって大規模言語モデル(LLM)の性能を向上させる技術であるRAG(Retrieval Augmented Generation)でも重要な役割を果たしている。

市場には、以下のような多くの種類のベクトル・データベースがある:

- Milvus](https://zilliz.com/what-is-milvus)、Zilliz Cloud(フルマネージドMilvus)など。

- Faiss](https://zilliz.com/learn/faiss)やAnnoyのようなベクトル検索ライブラリ。

- Chroma](https://zilliz.com/blog/milvus-vs-chroma)やMilvus Liteのような軽量ベクトルデータベース。

- 小規模なベクトル検索が可能なベクトル検索アドオンを備えた従来のデータベース**。

Elasticsearch は Apache Lucene ベースの検索エンジンで、アドオンとしてベクトル検索がある。Vearchは専用のベクターデータベースである。この投稿では、両者のベクトル検索機能を比較する。 ;

Elasticsearch:概要とコアテクノロジー

Elasticsearch は Apache Lucene ライブラリ上に構築されたオープンソースの検索エンジンです。リアルタイムのインデックス作成と全文検索で知られているため、重いアプリケーションやログ分析に最適な検索エンジンです。Elasticsearchを使えば、大量のデータを高速かつ効率的に検索・分析することができます。

Elasticsearchは検索と分析のために構築され、ファジー検索、フレーズマッチ、関連性ランキングなどの機能を備えています。複雑な検索クエリやリアルタイムのデータ検索が必要なシナリオに最適です。AIアプリケーションの台頭により、Elasticsearchはベクトル検索機能を追加し、画像認識、文書検索、Generative AIなどのAIユースケースに必要な類似検索や意味検索ができるようになりました。

ベクター検索

ベクター検索は Apache Lucene を通して Elasticsearch に統合されている。Lucene は定期的にマージされる不変のセグメントにデータを整理し、ベクターは他のデータ構造と同じようにセグメントに追加されます。このプロセスでは、インデックスを作成する際にベクタをメモリ上にバッファリングし、 必要なときにバッファをセグメントの一部としてシリアライズします。セグメントを定期的にマージして最適化を行い、すべてのセグメントでヒットしたベクターを検索します。

Elasticsearch はベクトルのインデックス作成に HNSW (Hierarchical Navigable Small World) アルゴリズムを使用しており、類似したベクトル同士が接続されたグラフを作成します。HNSWはシンプルで、強力なベンチマーク性能を持ち、インデックスの完全な再学習を必要とせずにインクリメンタルな更新に対応できることから選ばれました。このシステムは、通常数十ミリ秒から数百ミリ秒でベクトル検索を実行し、総当たりアプローチよりもはるかに高速である。

Elasticsearch の技術的なアーキテクチャは最大の強みの一つである。このシステムは同時インデックス作成中であってもロックフリー検索をサポートし、ドキュメントの更新時には異なるフィールド間で厳格な一貫性を維持する。そのため、ベクトルフィールドとキーワードフィールドの両方を更新した場合、検索はすべての古い値かすべての新しい値のどちらかを見ることになり、データの一貫性が保証される。システムは利用可能なRAMを超えて拡張することができますが、ベクターデータがメモリに収まる場合にパフォーマンスが最適化されます。

コアとなるベクトル検索機能だけでなく、Elasticsearchは実用的な統合機能を提供しており、その価値は非常に高い。ベクトル検索は従来のElasticsearchのフィルタと組み合わせることができるので、ベクトルの類似性と全文検索結果をミックスしたハイブリッド検索を行うことができます。ベクトル検索は Elasticsearch のセキュリティ機能、アグリゲーション、インデックスソートと完全に互換性があるため、最新の検索ユースケースに対応する完全なソリューションです。

Vearch** とは?概要とコアテクノロジー

Vearchは、高速で効率的な類似検索を必要とするAIアプリケーションを開発する開発者のためのツールです。超強力なデータベースのようなものだが、通常のデータを保存する代わりに、最新のAI技術の多くを支えるトリッキーなベクトル埋め込みを扱うように構築されている。

Vearchの最もクールな点は、そのハイブリッド検索だ。ベクトルによる検索(類似した画像やテキストを見つけることを想像してほしい)と、数値やテキストのような通常のデータによるフィルタリングができる。そのため、「このような商品を探す、ただし電子機器カテゴリーで500ドル以下」というような複雑な検索も可能だ。何百万ものベクトルからなるコーパスをミリ秒単位で検索できるのだ。

Vearchはニーズに応じて成長するように設計されている。クラスタのセットアップを使用し、コンピュータのチームが一緒に働くようなものだ。異なるタイプのノード(マスター、ルーター、パーティション・サーバー)があり、メタデータの管理からデータの保存や計算まで、異なるジョブを処理する。これにより、Vearchはデータの増加に合わせてスケールアウトし、信頼性を高めることができる。より多くのデータやトラフィックを処理するために、汗をかくことなくマシンを追加することができます。

開発者にとっては、Vearchは生活を容易にする素晴らしい機能をいくつか備えている。リアルタイムでインデックスにデータを追加できるので、検索結果は常に最新の状態に保たれます。複雑なデータに便利な、1つのドキュメントに複数のベクトル・フィールドをサポートする。また、Python SDKも用意されており、迅速な開発とテストが可能だ。Vearchはインデックス作成方法(IVFPQとHNSW)に柔軟性があり、CPUとGPUの両方のバージョンをサポートしているので、特定のハードウェアや使用ケースに合わせて最適化することができます。レコメンデーションシステム、類似画像検索、または高速な類似マッチングを必要とするAIアプリの構築など、Vearchはそれを効率的に実現するツールを提供します。

##主な違い

Elasticsearch と Vearch のベクトル検索比較:開発者ガイド

ベクトル検索ツールとして Elasticsearch と Vearch のどちらかを選択する場合、多角的に比較する必要があります。両者ともベクトル検索機能を備えていますが、そのニーズや得意とするシナリオは異なります。ここでは、あなたのユースケースに適したツールを選ぶための簡単な概要を説明します。

検索方法

Elasticsearch:Elasticsearch は Apache Lucene を使った HNSW (Hierarchical Navigable Small World) アルゴリズムによるベクトル検索を採用しています。HNSW は類似したベクトルが連結されたグラフを構築するため、効率的な検索が可能です。ベクトルベースの検索と従来のキーワードベースのフィルタをミックスしたハイブリッドクエリをサポートしているので、複雑なクエリの組み合わせを必要とするアプリケーションに適している。

Vearch:VearchはHNSWとIVFPQ(Inverted File with Product Quantization)もサポートしています。HNSWはスピードと精度に優れ、IVFPQはメモリ効率、特にGPU使用時に優れています。VearchはAIアプリケーションのために作られ、ベクトル埋め込み間の類似性マッチングに重点を置いています。

データ処理

Elasticsearch:Elasticsearch は構造化・半構造化データ用に設計されている。非構造化データ(テキストや埋め込みなど)も扱えるが、基本はフルテキスト検索だ。検索と分析をベクトル検索と組み合わせているので、ハイブリッドなユースケースに適している。

Vearch:Vearchは非構造化データ、特にベクトル埋め込み用に設計されている。1つのドキュメントで複数のベクトルフィールドをサポートしており、エンティティが複数のエンベッディング(テキストや画像のエンベッディングなど)を持つAIアプリケーションに便利だ。また、リアルタイムの更新にも対応しているので、検索結果は常に最新の状態に保たれる。

スケーラビリティとパフォーマンス

Elasticsearch:Elasticsearch はクラスタ間で水平にスケールし、ベクターデータがメモリに収まる場合は良好なパフォーマンスを発揮します。データをセグメント化し、定期的にマージすることで大規模なデータセットを扱いますが、クエリが利用可能な RAM を超えるとパフォーマンスが低下します。

Vearch:Vearchのアーキテクチャはスケーラビリティを重視して設計されている。マスター、ルーター、パーティション・サーバーという専用のノードの役割を持つクラスタ・ベースの設計を採用している。これにより、Vearchはデータやトラフィックが増加してもスムーズに拡張でき、特定のノードが計算負荷の高いベクトル演算を処理できます。また、要求の厳しいAIワークロード向けにGPUサポートも用意されている。

柔軟性とカスタマイズ

Elasticsearch:Elasticsearch はベクトル検索と成熟した全文検索機能を組み合わせるのが得意だ。ベクトル類似性マッチングを実行しながら、従来のフィールドを使って結果をフィルタリングしたりソートしたりできる。集計やハイブリッド検索もサポートしているので、様々なデータモデルに対応できる。

Vearch:Vearchは、推薦システムやマルチメディア検索のようなAI主導のユースケース向けに高度にカスタマイズできる。リアルタイムのインデックス作成が可能で、CPUとGPUの両方の計算をサポートしているため、ハードウェアに応じてパフォーマンスを調整することができる。また、複数のベクトル・インデックス方式をサポートしているため、柔軟性がさらに高まります。

統合とエコシステム

Elasticsearch:成熟したツールとして、Elasticsearch は可視化のための Kibana やデータ取り込みのための Logstash を含む多くのエコシステムやフレームワークとうまく統合できる。Elasticsearchは既存のワークフローと互換性があるため、すでにElasticsearchのエコシステムを利用しているのであれば、Elasticsearchを選択するのが無難だろう。

Vearch:Vearchはあまり成熟していないが、より特化している。そのPython SDKは、AIパイプライン、特に機械学習と深層学習アプリケーションに簡単に統合できる。Elasticsearchのような広範なエコシステムはないが、AIアプリケーションに特化しているので、組み込みが多いシステムに向いている。

使いやすさ

Elasticsearch:Elasticsearch はそのエコシステムに慣れていれば簡単に使える。しかし、そのベクトル検索機能は比較的新しいので、設定や専門知識が必要になるかもしれません。ドキュメントとコミュニティサポートは大きなプラスだ。

Vearch:Vearchは、AIユースケースにはシンプルである。PythonのSDKとリアルタイムのインデックスにより、開発者はエンベッディングをより簡単に扱うことができる。しかし、そのエコシステムは狭く、コミュニティ・サポートが少ないことは、一部の開発者にとっての課題かもしれない。

コストの検討

Elasticsearch:コストはクラスタサイズとデータ量に依存します。マネージド Elasticsearch サービスは利便性を向上させますが、コストは増加します。また、最適なベクトル検索のパフォーマンスを得るためには、より多くのメモリが必要になる可能性があり、それがコストに上乗せされます。

Vearch:Vearchは大規模AIアプリケーション向けに設計されている。GPUのサポートはハードウェア・コストを増加させますが、パフォーマンスを大幅に向上させます。ユースケースにもよりますが、AI中心のアプリケーションにはこちらの方がお得です。

セキュリティ機能

Elasticsearch:Elasticsearch は暗号化、認証、アクセス制御を含む強固なセキュリティ機能を備えています。そのすべてがコアサービスとマネージドサービスに統合されているため、企業のセキュリティ標準に準拠しています。

Vearch:Vearchは最初から備わっているセキュリティ機能は少ないが、基本的な認証とアクセス制御をサポートしている。高度なセキュリティを必要とするアプリケーションには、手動で追加のレイヤーを実装する必要がある。

Elasticsearch を選択するタイミング

Elasticsearch はベクトル検索と従来の検索、ビッグデータの分析を組み合わせたユースケースに適しています。全文検索、キーワードフィルタリング、ベクトル類似クエリを混在させる必要があるハイブリッド検索シナリオに最適です。ログ分析、eコマース検索、エンタープライズ検索に既にElasticsearchを使用しており、その堅牢なエコシステム、スケーラビリティ、統合性を活用したい場合は、Elasticsearchを選択するのが良いでしょう。複雑なクエリ、関連性ランキング、Kibana や Logstash との互換性が必要な場合は、Elasticsearch が安全です。

Vearch を選択する場合

Vearch は、レコメンデーションエンジン、画像類似検索、生成 AI のユースケースなど、ベクトル埋め込みに大きく依存する AI 主導のアプリケーション向けです。非構造化ベクトルデータ用に設計されており、リアルタイムのインデックス作成とGPU加速パフォーマンスに優れています。Vearchはドキュメントごとに複数のベクトルフィールドを扱うことができ、様々なインデックス作成方法をサポートしているので、AIにおける複雑なデータモデルに最適です。マルチメディア検索や、スケーラビリティを必要とする埋め込み中心のアプリケーションに重点を置いているのであれば、Vearchは最適なソリューションです。

概要

Elasticsearch と Vearch はどちらもベクトル検索に適していますが、理由は異なります。Elasticsearch は汎用性があり、エコシステムがあり、ハイブリッド検索機能があるので、伝統的な検索ワークロードにも新しい検索ワークロードにも安心です。VearchはAIアプリケーションに最適化されており、埋め込みが多いユースケースで高速かつ効率的な類似検索を行う。ユースケース、データ・タイプ、パフォーマンス要件に基づいてこの2つの中から選択し、プロジェクト目標に合ったテクノロジーを選びましょう。

ElasticsearchとVearchの概要についてはこちらをお読みいただきたいが、これらを評価するには、ユースケースに基づいて評価する必要がある。それを手助けしてくれるツールの一つが VectorDBBench で、ベクトルデータベースを比較するためのオープンソースのベンチマークツールだ。最終的には、独自のデータセットとクエリパターンを使って徹底的にベンチマークを行うことが、分散データベースシステムにおけるベクトル検索に対する、強力だが異なるこの2つのアプローチのどちらを選ぶかを決める鍵となるだろう。

オープンソースのVectorDBBenchを使ってベクトルデータベースを評価・比較する

VectorDBBenchは、高性能なデータ保存・検索システム、特にベクトルデータベースを必要とするユーザーのためのオープンソースのベンチマークツールです。このツールにより、ユーザはMilvusやZilliz Cloud(マネージドMilvus)のような異なるベクトルデータベースシステムを独自のデータセットを使ってテストし比較し、自分のユースケースに合うものを見つけることができます。VectorDBBenchを使えば、ユーザーはマーケティング上の主張や伝聞ではなく、実際のベクターデータベースのパフォーマンスに基づいて決定を下すことができます。

VectorDBBenchはPythonで書かれており、MITオープンソースライセンスの下でライセンスされています。VectorDBBenchは、その機能と性能の改善に取り組む開発者のコミュニティによって活発にメンテナンスされています。

VectorDBBenchをGitHubリポジトリ**からダウンロードして、我々のベンチマーク結果を再現したり、あなた自身のデータセットでパフォーマンス結果を得てください。

VectorDBBench Leaderboard](https://zilliz.com/vector-database-benchmark-tool?database=ZillizCloud%2CMilvus%2CElasticCloud%2CPgVector%2CPinecone%2CQdrantCloud%2CWeaviateCloud&dataset=medium&filter=none%2Clow%2Chigh&tab=1)で、主流のベクトルデータベースのパフォーマンスを簡単に見てみましょう。

ベクターデータベースの評価については、以下のブログをお読みください。

- ベンチマーク・ベクター・データベースのパフォーマンス:テクニックと洞察](https://zilliz.com/learn/benchmark-vector-database-performance-techniques-and-insights)

- VectorDBBench: Open-Source Vector Database Benchmark Tool](https://zilliz.com/learn/open-source-vector-database-benchmarking-your-way)

- ベクターデータベースを他のデータベースと比較する](https://zilliz.com/comparison)

VectorDB、GenAI、MLに関するその他のリソース

- ジェネレーティブAIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

- あなたのGenAIアプリのためのトップパフォーマンスAIモデル|Zilliz](https://zilliz.com/ai-models)

- RAGとは](https://zilliz.com/learn/Retrieval-Augmented-Generation)

- 大規模言語モデル(LLM)を学ぶ](https://zilliz.com/learn/ChatGPT-Vector-Database-Prompt-as-code)

- ベクトルデータベース101](https://zilliz.com/learn/what-is-vector-database)

- 自然言語処理(NLP)](https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models)

読み続けて

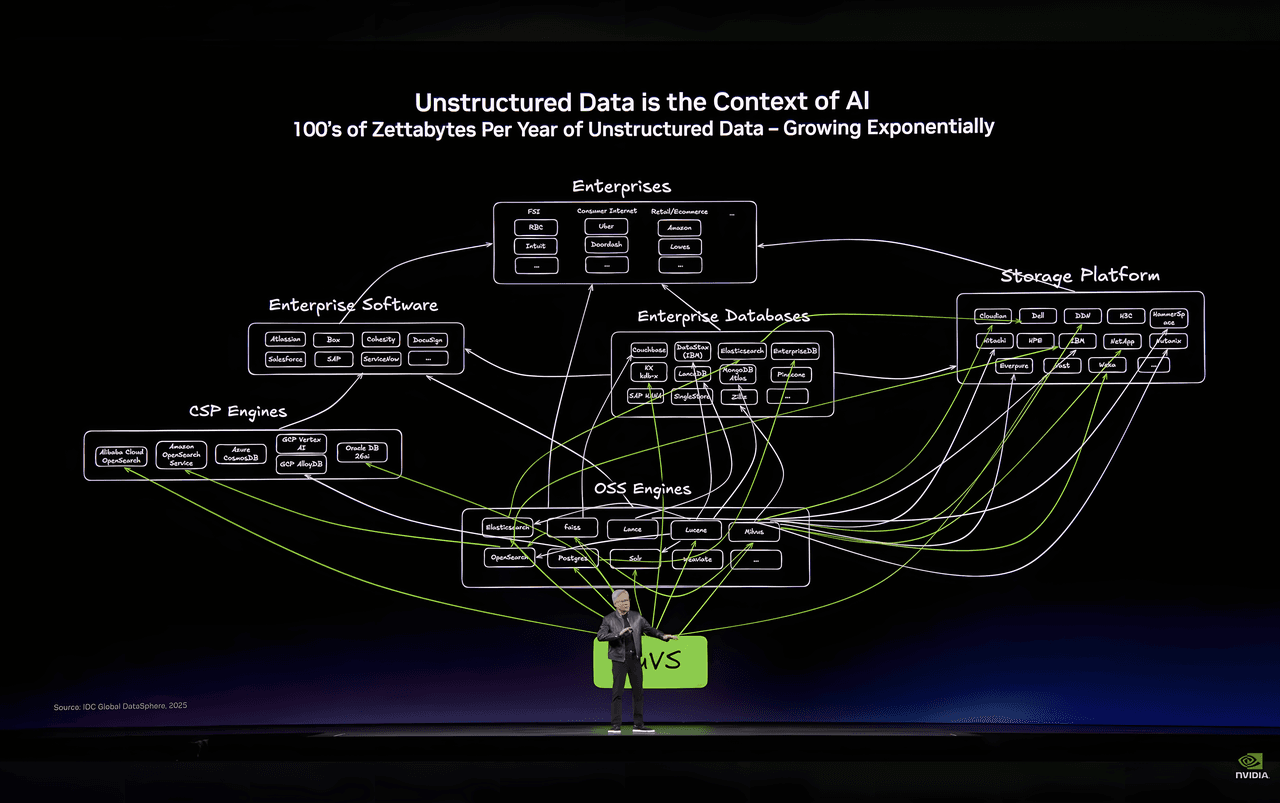

How Zilliz Ended Up at the Center of NVIDIA’s Unstructured Data Story at GTC 2026

If unstructured data is the context of AI, then the ceiling of AI applications will be set not just by models, but by how mature the infrastructure for unstructured data becomes.

Zilliz Cloud BYOC Now Available Across AWS, GCP, and Azure

Zilliz Cloud BYOC is now generally available on all three major clouds. Deploy fully managed vector search in your own AWS, GCP, or Azure account — your data never leaves your VPC.

Selecting the Right ETL Tools for Unstructured Data to Prepare for AI

Learn the right ETL tools for unstructured data to power AI. Explore key challenges, tool comparisons, and integrations with Milvus for vector search.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.