Apache CassandraとKdbの比較:AIアプリケーションに適したベクター・データベースの選択

AI主導のアプリケーションが普及するにつれ、開発者やエンジニアは、ベクトルデータを効率的に処理する適切なデータベースを選択するという課題に直面している。この分野で人気のある2つの選択肢は、Apache CassandraとKdbです。この記事では、ベクター・データベースのニーズを判断するために、これらのテクノロジーを比較する。

ベクターデータベースとは?

Apache Cassandra**とKdbを比較する前に、まずベクター・データベースの概念について説明します。

ベクトル・データベース](https://zilliz.com/learn/what-is-vector-database)は、高次元のベクトルエンベッディングを格納し、クエリするために特別に設計されたもので、非構造化データの数値表現です。これらのベクトルは、テキストの意味的な意味、画像の視覚的な特徴、または製品の属性などの複雑な情報をエンコードします。効率的な類似検索を可能にすることで、ベクトルデータベースはAIアプリケーションにおいて極めて重要な役割を果たし、より高度なデータ分析と検索を可能にする。

ベクトルデータベースは、電子商取引の商品推奨、コンテンツ発見プラットフォーム、サイバーセキュリティにおける異常検知、医療画像分析、自然言語処理(NLP)タスクなど、多くのユースケースで採用されている。また、AI幻覚のような問題を軽減するために外部知識を提供することで大規模言語モデル(LLMs)のパフォーマンスを向上させる技術である、検索拡張生成(RAG)でも重要な役割を果たしている。

市場には、以下のような多くの種類のベクトル・データベースがある:

- Milvus](https://zilliz.com/what-is-milvus)、Zilliz Cloud(フルマネージドMilvus)など。

- Faiss](https://zilliz.com/learn/faiss)やAnnoyのようなベクトル検索ライブラリ。

- Chroma](https://zilliz.com/blog/milvus-vs-chroma)やMilvus Liteのような軽量ベクトルデータベース。

- 小規模なベクトル検索が可能なベクトル検索アドオンを備えた従来のデータベース**。

CassandraとKdbは、ベクトル・データベースに対する異なるアプローチを表している。Cassandraは、ベクトル検索機能を含むように進化した伝統的なデータベースであり、一方、Kdbは、ベクトル検索機能を追加した専用時系列データベースである。

Apache Cassandra:概要とコア・テクノロジー

Apache Cassandraはオープンソースの分散型NoSQLデータベースで、そのスケーラビリティと可用性で知られている。Cassandraの特徴には、可用性、拡張性、調整可能な一貫性、柔軟なデータ・モデルのためのマスターレス・アーキテクチャがあります。Cassandra 5.0](https://cassandra.apache.org/doc/latest/cassandra/vector-search/concepts.html)のリリースにより、Storage-Attached Indexes (SAI)機能を通じてベクトル埋め込みとベクトル類似性検索をサポートするようになった。この統合により、Cassandraはベクトル・データを扱えるようになりましたが、ベクトル検索はネイティブ機能ではなく、Cassandraの既存のアーキテクチャの拡張として実装されていることに注意することが重要です。

Cassandraのベクトル検索機能は、既存のアーキテクチャ上に構築されています。これにより、ユーザーはベクトル埋め込みを他のデータと一緒に保存し、類似検索を実行できるようになります。この統合により、Cassandraは大規模な分散データを扱う強みを維持しながら、AI主導のアプリケーションをサポートできるようになる。

Cassandraのベクトル検索の重要なコンポーネントは、ストレージ・アタッチド・インデックス(SAI)の使用です。SAIは高度にスケーラブルでグローバルに分散されたインデックスで、あらゆるベクトル・データ型の列に列レベルのインデックスを追加します。SAIは、データベースがベクトル検索やその他の検索インデックスを使用する際に、高いI/Oスループットを提供します。SAIは広範なインデックス機能を提供し、クエリとコンテンツ(文書、単語、画像などの大規模な入力を含む)の両方にインデックスを作成してセマンティクスを取得することができます。

Vector Searchは、SAIの新しいモジュール性を活用した、SAIの拡張性を検証する最初の事例である。このVector SearchとSAIの組み合わせにより、AIと機械学習のワークロードを処理するCassandraの機能が強化され、ベクトル・データベースの分野で強力な候補となる。

Kdb概要とコア・テクノロジー

KDBは、GPUを必要としないリアルタイムデータ処理に優れた高性能データベースです。生データの処理、ベクトル埋め込みデータの生成、保存、類似検索の実行をリアルタイムで行うことができます。KDBの主な強みの一つは、様々なデータタイプやユースケースをサポートするマルチモーダルなパフォーマンスです。KDBのアプローチは、ストリーミング、エンベッディング生成、ベクターデータベース、生データ処理、時系列、分析を統合ソリューションに統合し、開発者の技術スタックを大幅に簡素化し、アプリケーション間で適応可能にする。

KDBはダイナミック・インデックスを組み込んでおり、開発者は厳密なインデックスの制約を受けることなく、類似性検索のためのベクトル埋め込みを動的に選択することができます。これにより、より高速で柔軟な検索が可能になります。KDBはデータセット間の再エンコーディングをサポートしており、異なる次元の生データを再エンコーディングして保存することで、データセットをまたいだ類似検索が可能です。時系列データの場合、KDBはエンベッディング生成なしでもユニークな類似性検索機能を提供し、変化の速いデータセットと遅いデータセットの両方に対応するユーザーに汎用性を提供します。

パフォーマンスに関しては、KDBはHNSWのような一般的な手法とは一線を画している。KDBはHNSWと比較して17倍高速に検索を実行し、特に高速に変化する時間データに対して12倍少ないメモリを使用します。KDBは、変化の遅い時間ベースのデータセットに対して、メモリとディスクストレージを100倍削減し、同時に検索を10倍高速化する。類似検索、完全検索、リテラル検索を1つのクエリで組み合わせることで、コンテンツが進化してもクエリの関連性が保証されるため、KDBはリアルタイムで進化するデータに対する効率的なソリューションとなります。

KDBは、開発者がベクトル類似検索を従来のデータベースクエリと組み合わせることを可能にすることで、ベクトル検索機能を強化しています。これは、検索パラメータに基づいてカスタム制約を適用するフィルタによって実現されます。KDBは、FlatおよびqFlat(いずれも厳密な最近傍探索)、HNSW(効率的な探索のためのグラフベースのインデックス)、IVF(より高速だが精度の低い結果を得るためのクラスタベースの探索)、IVFPQ(メモリ効率と速度を向上させるIVFの圧縮バージョン)など、複数の探索手法をサポートしています。各手法には独自のトレードオフがあり、開発者は使用ケースに応じて最適なアプローチを選択することができる。

主な相違点

検索方法

KDBとCassandraは検索方法が大きく異なります。KDBはFlat、qFlat、HNSW、IVF、IVFPQなど複数のベクトル検索アルゴリズムをサポートし、網羅的検索と近似検索をミックスした検索ストラテジーを提供します。これにより、検索精度とパフォーマンスのバランスを柔軟にとることができます。一方、CassandraはStorage-Attached Indexes(SAI)を通じて、拡張機能としてベクトル検索を統合しています。SAIはベクトル埋め込みと類似検索を可能にしますが、KDBほど検索アルゴリズムに特化しておらず、多様性もありません。KDBのダイナミック・インデックスとモジュラー検索技術は、Cassandraのより限定的なインデックス・ベースのベクトル検索を凌駕します。

データ・ハンドリング

KDBは、構造化、半構造化、非構造化を含むさまざまなデータの取り扱いに優れています。生データをリアルタイムに処理し、ベクトル埋め込みをシームレスに生成し、類似検索を実行します。KDBのマルチモーダルな性質により、時系列データ、ストリーミングデータ、バッチデータをサポートし、汎用性を高めている。Cassandraは、主に構造化または半構造化された大規模分散データ向けに構築されており、SAIによってベクトル埋め込みが追加される。しかし、ベクトル検索はCassandraのコア機能ではなく、KDBほど効率的に非構造化データやリアルタイムのベクトル検索を扱えない可能性があります。

スケーラビリティとパフォーマンス

どちらのシステムもスケーラビリティは高いが、アプローチは異なる。KDBは、埋め込み生成、検索、分析などのさまざまなタスクを1つの統一されたソリューションに統合することでスケーリングし、より少ないメモリ使用量でより高速な検索パフォーマンス(HNSWの17倍高速)を提供します。Cassandraは、スケーラビリティのためにマスターレス分散アーキテクチャに依存しており、SAIはスケールでのベクトル検索を可能にします。Cassandraは汎用的な分散スケーラビリティに優れていますが、KDBはベクトル検索とデータ処理に特化しているため、リアルタイムの大量ユースケースでより高いパフォーマンスを発揮します。

柔軟性とカスタマイズ

KDBはデータモデリング、クエリ、カスタマイズにおいて優れた柔軟性を提供します。そのダイナミックインデキシングにより、ベクトル埋め込みが検索にどのように選択されるかをリアルタイムに調整することができ、開発者はパフォーマンスと精度を微調整することができます。また、ベクトル検索と従来のクエリを組み合わせることもできる。CassandraはNoSQLデータモデルという点では柔軟だが、ベクトル検索のカスタマイズ性には欠けている。SAIはベクトル・データ用のわかりやすくスケーラブルなインデックスを提供するが、検索方法やクエリの組み合わせをきめ細かくカスタマイズできるKDBにはかなわない。

統合とエコシステム

Cassandraはその豊富な統合エコシステムでよく知られており、多くのビッグ・データ・ツール、分散システム、クラウド・プラットフォームをサポートしています。SAIの導入により、AIや機械学習のワークロードもサポートできるようになり、より広範なエコシステムで多目的に利用できるようになった。KDBは、サードパーティツールとの統合はそれほど広くはないが、マルチモーダルデータとベクトル検索に重点を置いており、AIやリアルタイムデータ処理に特化したアプリケーションに適している。KDBは、AI主導のタスクを中心としたユースケースに対して、よりシームレスなソリューションを提供する可能性がある。

使いやすさ

使いやすさに関しては、CassandraはNoSQLデータベースや分散システムに慣れている開発者にとって学習曲線が緩やかです。そのドキュメントとエコシステムは、セットアップとメンテナンスのための確かなリソースを提供する。より高度なリアルタイム処理機能を持つ高性能データベースであるKDBは、特に特定のクエリ言語やアーキテクチャに不慣れな開発者にとっては、学習曲線が厳しいかもしれない。しかし、高度なベクトル検索機能を必要とするタスクでは、KDBのパフォーマンス上の利点は、追加の複雑さを上回るかもしれない。

コストに関する考察

コストに関する考慮事項は、各システムのユースケースによって異なります。Cassandraはオープン・ソース・モデルで広く採用されているため、インフラストラクチャの運用コストは低いですが、大規模なベクトル検索用にSAIをスケーリングする場合はコストが高くなる可能性があります。KDBは、パフォーマンス機能に特化しているため、初期インフラコストは高くなる可能性がありますが、大量データやリアルタイムデータのアプリケーションでは、メモリやストレージの使用量が少なくて済むため、コストを大幅に削減できます。大規模なベクトル検索を必要とする開発者にとっては、KDBの方が長期的な価値を提供できる可能性があります。

セキュリティ機能

KDBとCassandraは、暗号化、認証、アクセス制御などの堅牢なセキュリティ機能を提供します。Cassandraは、ロール・ベースのアクセス制御やTLS暗号化など、エンタープライズ・セキュリティ・プロトコルと簡単に統合できます。KDBもさまざまなレベルで暗号化とセキュリティを提供しますが、ハイパフォーマンス環境に重点を置いているため、そのセキュリティ機能はリアルタイムで高スループットのタスクに最適化されています。どちらのシステムもセキュアだが、標準的なコンプライアンス要件を持つ企業にはCassandraの方が適応しやすいかもしれない。

Cassandraを選ぶとき

Cassandraは、大規模な分散データを扱う必要があるユースケース、特に可用性とスケーラビリティが重要な関心事である場合に適した選択です。Cassandraは、書き込みスループットが高いグローバル・アプリケーションのように、構造化または半構造化された大量のデータを多数のノードに分散して保存する必要がある場合に威力を発揮する。ストレージ・アタッチド・インデックス(SAI)によるベクトル検索機能が追加されたCassandraは、従来のデータ・クエリに加えて基本的なベクトル検索を必要とするAI主導のアプリケーションに適している。Cassandraは、ベクトル検索を中核とするのではなく、追加機能として備えた堅牢でスケーラブルなNoSQLデータベースを探している企業に最適です。

KDBを選ぶとき

KDBは、リアルタイムのデータ処理と高性能なベクトル検索を必要とするユースケースに最適です。特に、時系列分析、金融データ、AIアプリケーションなど、動的インデックス作成、高速検索、シームレスな埋め込み生成が必要なタスクに適しています。KDBは、マルチモーダルデータ(構造化、半構造化、非構造化)を扱い、従来のクエリと組み合わせた高度なベクトル検索機能を必要とするシナリオに優れています。また、ストリーミング、ベクトル検索、アナリティクスを1つのプラットフォームに統合し、技術スタックを簡素化したい開発者にも最適です。

結論

まとめると、CassandraとKDBはどちらも強力なデータベースですが、それぞれの強みは異なる領域にあります。Cassandraは基本的なベクトル検索が必要な大規模分散データに最適であり、KDBはリアルタイムデータ処理と高度なベクトル検索機能に優れています。スケーラビリティや分散データを優先するか、動的検索オプションを備えた高性能なマルチモーダルデータ処理を優先するかなど、特定のユースケースによって適切なテクノロジーを選択する必要があります。

この記事ではCassandraとKdbの概要を説明しますが、特定のユースケースに基づいてこれらのデータベースを評価することが重要です。このプロセスを支援するツールの1つが、ベクトル・データベースのパフォーマンスを比較するために設計されたオープンソースのベンチマーク・ツールであるVectorDBBenchです。最終的には、特定のデータセットとクエリパターンを使った徹底的なベンチマークが、分散データベースシステムにおけるベクトル検索に対する、強力でありながら異なる2つのアプローチの間で、十分な情報に基づいた決断を下すために不可欠となる。

オープンソースのVectorDBBenchを使って、ベクターデータベースを自分で評価・比較する

VectorDBBenchは、高性能なデータ保存・検索システム、特にベクトルデータベースを必要とするユーザーのために設計されたオープンソースのベンチマークツールです。このツールにより、ユーザは独自のデータセットを用いてMilvusやZilliz Cloud(マネージドMilvus)などの異なるベクトルデータベースシステムの性能をテスト・比較し、ユースケースに最も適したものを決定することができます。VectorDBBenchを使用することで、ユーザーはマーケティング上の主張や逸話的証拠に頼るのではなく、実際のベクトルデータベースのパフォーマンスに基づいて情報に基づいた決定を下すことができます。

VectorDBBenchはPythonで書かれており、MITオープンソースライセンスの下でライセンスされています。VectorDBBenchは、その機能と性能の改善に取り組む開発者のコミュニティによって活発にメンテナンスされています。

VectorDBBenchをGitHubリポジトリ**からダウンロードして、我々のベンチマーク結果を再現したり、あなた自身のデータセットでパフォーマンス結果を得てください。

VectorDBBench Leaderboard](https://zilliz.com/vector-database-benchmark-tool?database=ZillizCloud%2CMilvus%2CElasticCloud%2CPgVector%2CPinecone%2CQdrantCloud%2CWeaviateCloud&dataset=medium&filter=none%2Clow%2Chigh&tab=1)**で主流のベクトルデータベースの性能を見てみましょう。

ベクターデータベースの評価については、以下のブログをお読みください。

- ベンチマークベクターデータベースのパフォーマンス:テクニックと洞察](https://zilliz.com/learn/benchmark-vector-database-performance-techniques-and-insights)

- VectorDBBench: オープンソースベクターデータベースベンチマークツール](https://zilliz.com/learn/open-source-vector-database-benchmarking-your-way)

- ベクターデータベースを他のデータベースと比較する](https://zilliz.com/comparison)

VectorDB、GenAI、MLに関するその他のリソース

- ジェネレーティブAIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

- あなたのGenAIアプリのためのトップパフォーマンスAIモデル|Zilliz](https://zilliz.com/ai-models)

- RAGとは](https://zilliz.com/learn/Retrieval-Augmented-Generation)

- 大規模言語モデル(LLM)を学ぶ](https://zilliz.com/learn/ChatGPT-Vector-Database-Prompt-as-code)

- ベクトルデータベース101](https://zilliz.com/learn/what-is-vector-database)

- 自然言語処理(NLP)](https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models)

読み続けて

Introducing Zilliz Cloud Global Cluster: Region-Level Resilience for Mission-Critical AI

Zilliz Cloud Global Cluster delivers multi-region resilience, automatic failover, and fast global AI search with built-in security and compliance.

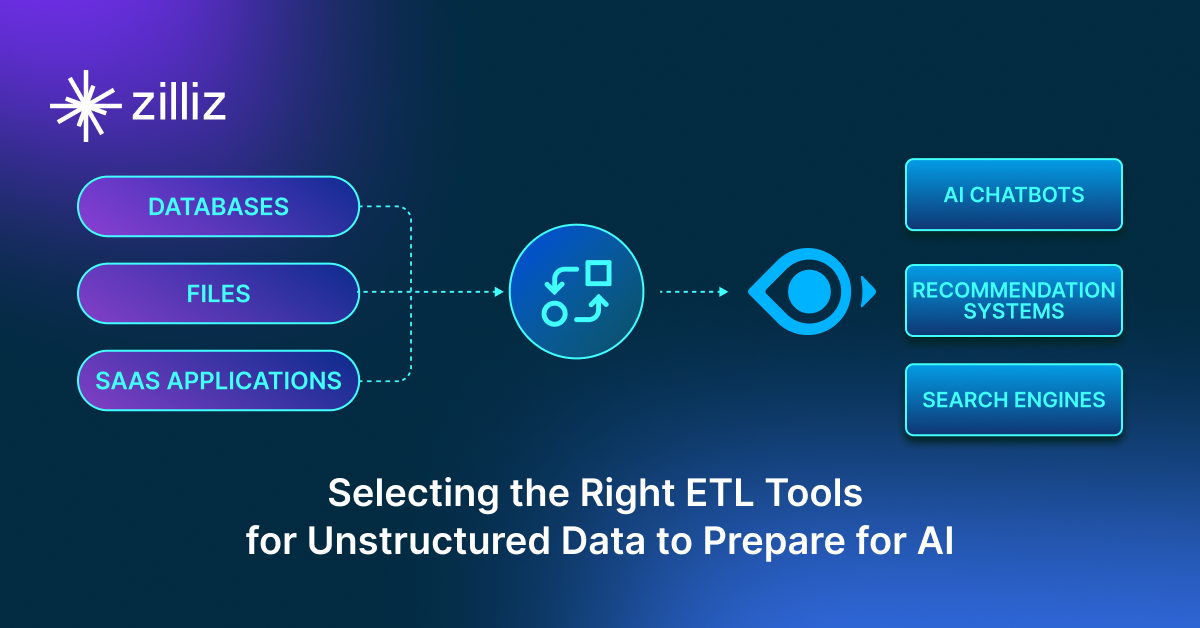

Selecting the Right ETL Tools for Unstructured Data to Prepare for AI

Learn the right ETL tools for unstructured data to power AI. Explore key challenges, tool comparisons, and integrations with Milvus for vector search.

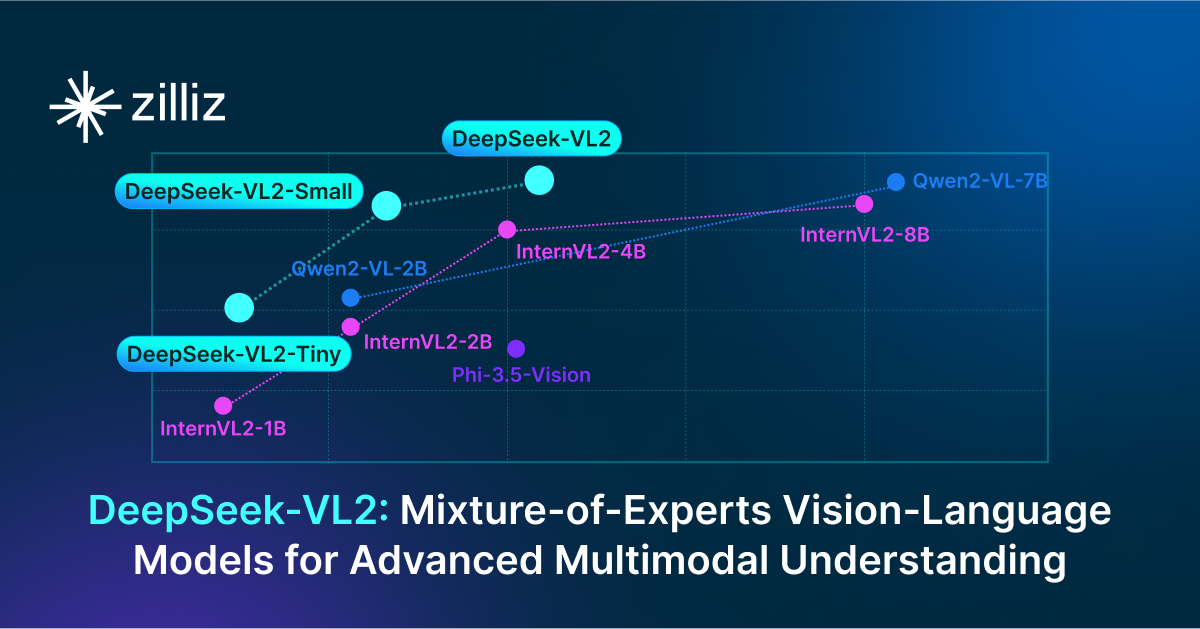

DeepSeek-VL2: Mixture-of-Experts Vision-Language Models for Advanced Multimodal Understanding

Explore DeepSeek-VL2, the open-source MoE vision-language model. Discover its architecture, efficient training pipeline, and top-tier performance.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.