Chroma vs Neo4j:ニーズに合ったベクターデータベースの選択

AIやデータドリブン・テクノロジーの進歩に伴い、アプリケーションに適したベクター・データベースを選択することの重要性が増している。ChromaとNeo4jは、この分野における2つの選択肢だ。ベクターデータベースとは?

ChromaとNeo4jを比較する前に、まずベクターデータベースの概念について説明します;

ベクトルデータベース](https://zilliz.com/learn/what-is-vector-database)は、特に高次元のベクトルを格納し、クエリするように設計されています。ベクトルは、非構造化データの数値表現です。これらのベクトルは、テキストの意味、画像の視覚的特徴、または製品の属性などの複雑な情報をエンコードします。効率的な類似検索を可能にすることで、ベクトルデータベースはAIアプリケーションの役割を果たし、より高度なデータ分析と検索を可能にする。

ベクトルデータベースの一般的なユースケースには、電子商取引の商品推奨、コンテンツ発見プラットフォーム、サイバーセキュリティにおける異常検知、医療画像分析、自然言語処理(NLP)タスクなどがある。また、AI幻覚のような問題を軽減するために、外部知識を提供することによって大規模言語モデル(LLM)の性能を向上させる技術であるRAG(Retrieval Augmented Generation)でも役割を果たしている。

市場には、以下のような多くの種類のベクトル・データベースがある:

- Milvus](https://zilliz.com/what-is-milvus)、Zilliz Cloud(フルマネージドMilvus)など。

- Faiss](https://zilliz.com/learn/faiss)やAnnoyのようなベクトル検索ライブラリ。

- Chroma](https://zilliz.com/blog/milvus-vs-chroma)やMilvus Liteのような軽量ベクトルデータベース。

- 小規模なベクトル検索が可能なベクトル検索アドオンを備えた従来のデータベース**。

Chromaはベクトル・データベースであり、Neo4jはベクトル検索をアドオンとして持つグラフ・データベースである。この投稿では、両者のベクトル検索機能を比較する。 ;

Chroma**とは?概要

Chromaは、AIアプリケーションの構築プロセスを簡素化する、オープンソースのAIネイティブベクターデータベースです。大規模な言語モデル(LLM)と、それらが効果的に機能するために必要なデータとの橋渡しをする。Chromaの主な目的は、知識、事実、スキルにLLMが簡単にアクセスできるようにすることで、AI搭載アプリケーションの開発を効率化することだ。Chromaの中核は、ベクターデータを管理するためのツールを提供することで、開発者はエンベッディング(データのベクター表現)を関連するメタデータとともに保存することができる。この機能は、多くのAIアプリケーションにとって非常に重要であり、ベクトル関係に基づく効率的な類似検索やデータ検索を可能にします。

Chromaの主な強みのひとつは、シンプルさと開発者の生産性を重視していることだ。Chromaの開発チームは、開発者がベクトル検索機能をアプリケーションに素早く統合できるよう、直感的なインターフェイスを作ることを優先した。使いやすさを重視するあまり、パフォーマンスが犠牲になることはありません。Chromaは高速かつ効率的に設計されているため、さまざまなアプリケーションに適している。Chromaはサーバーとして動作し、PythonとJavaScript/TypeScriptの両方に対応したクライアントSDKを提供します。

Chromaの機能は、関連するエンベッディングのグループであるコレクションの概念を中心に展開されます。Chromaのコレクションにドキュメントを追加すると、システムは自動的にトークン化し、指定されたエンベッディング関数(指定されていない場合はデフォルトの関数)を使ってエンベッディングを行います。この処理により、生データは効率的に検索できるベクトル表現に変換される。エンベッディングとともに、Chromaでは各文書のメタデータを保存することができ、これにはデータのフィルタリングや整理に役立つ追加情報を含めることができます。Chromaは柔軟なクエリーオプションを提供しており、ベクトル埋め込みまたはテキストクエリーのいずれかを使用して類似文書を検索し、ベクトルの類似性に基づいて最も近い一致を返します。

Chromaはいくつかの点で際立っている。ChromaのAPIは直感的で使いやすいように設計されており、ベクターデータベースを初めて使う開発者でも学習曲線が少なくなっている。Chromaは様々なタイプのデータをサポートし、様々なエンベッディングモデルに対応しているため、ユーザーは特定のユースケースに最適なアプローチを選択することができる。Chromaは、他のAIツールやフレームワークとシームレスに統合できるように構築されており、複雑なAIパイプラインに適している。さらに、Chromaはオープンソース(ライセンスはApache 2.0)であるため、透明性が高く、コミュニティ主導の改善やカスタマイズが可能です。Chromaチームは、マネージドサービス(Hosted Chroma)の計画や様々なツールの改善など、積極的に機能強化に取り組んでおり、継続的な開発とサポートへのコミットメントを示している。

Neo4J: 基礎編

Neo4jのベクトル検索により、開発者はグラフ全体で類似データを検索するためのベクトル・インデックスを作成することができる。これらのインデックスは、ベクトル埋め込み(テキスト、画像、音声のようなデータの意味をとらえた数値表現)を含むノード・プロパティで動作します。システムは4096次元までのベクトルと、コサインおよびユークリッド類似性関数をサポートしている。

この実装では、HNSW(Hierarchical Navigable Small World)グラフを使用して、高速な近似k-最近傍検索を行う。ベクトル・インデックスに問い合わせを行う際、検索したい近傍ノードの数を指定すると、システムは類似度スコア順にマッチするノードを返す。これらのスコアは0~1で、高いほど類似度が高い。HNSWアプローチは、類似ベクトル間のつながりを保持し、システムがベクトル空間の異なる部分に素早くジャンプできるようにすることでうまく機能します。

ベクトル・インデックスの作成と使用は、クエリ言語を通して行います。CREATE VECTOR INDEX コマンドでインデックスを作成し、ベクトルの次元や類似関数などのパラメータを指定することができます。システムは設定された次元のベクトルだけがインデックスされることを確認します。これらのインデックスのクエリはdb.index.vector.queryNodesプロシージャで行われ、インデックス名、結果数、クエリベクトルを入力として受け取ります。

Neo4jのベクトルインデックスには、ベクトル表現を圧縮することでメモリ使用量を削減する量子化のようなパフォーマンス最適化があります。ノードあたりの最大接続数(M)や、挿入時に追跡される最近傍の数(ef_construction)などのパラメータで、インデックスの動作を調整できます。これらのパラメータによって精度と性能のバランスをとることができるが、ほとんどのユースケースではデフォルトのままで十分である。また、システムはバージョン5.18から関係ベクトルインデックスをサポートしているので、関係プロパティで類似データを検索することができる。

これにより、開発者はAIを活用したアプリケーションを構築することができる。グラフクエリとベクトル類似性検索を組み合わせることで、アプリケーションは完全一致ではなく、意味的な意味に基づいて関連データを見つけることができる。例えば、映画の推薦システムは、グラフ構造を使用して、推薦がユーザーの好みと同じジャンルまたは時代から来ることを保証しながら、類似した映画を見つけるためにプロット埋め込みベクトルを使用することができます。

主な違い

ベクトル検索ツールとしてChromaとNeo4jのどちらかを選ぶには、それぞれの強みとユースケースを理解する必要がある。ここでは、両者の特徴、方法論、実用的な意味について説明します。

検索方法

- クロマChromaはシンプルなベクトル検索です。ベクトル埋め込みを使って効率的に類似検索を行うので、開発者にとっても簡単です。クエリーオプションは柔軟で、ベクター埋め込みやテキストクエリーで検索することができます。Chromaの手法はシンプルで、最小限のセットアップを望む開発者に最適だ。

- Neo4j**:Neo4jは、近似最近傍(ANN)検索にHNSW(Hierarchical Navigable Small World)グラフを使用する。この複雑なアルゴリズムは、類似したベクトルをつなぐグラフ構造を維持することで、大規模なデータセットでも高速なクエリを可能にする。このシステムはコサイン類似度とユークリッド類似度をサポートしているが、最大接続数(M)や追跡される最近傍(ef_construction)のようなパラメータを調整するためにANNの知識が必要になる。

データ

- クロマテキスト、画像、その他のエンベッディングのような非構造化データのために、Chromaはベクターデータとメタデータの管理を簡素化します。エンベッディング中心のワークフロー向けに設計されており、意味的類似性に大きく依存するAIアプリケーションに最適です。Chromaはフィルタリングのための構造化メタデータをサポートしていますが、その強みは非構造化データや半構造化データの処理にあります。

- Neo4j**:Neo4jは、構造化データ、半構造化データ、非構造化データの組み合わせに優れている。そのグラフデータベースモデルは非常に柔軟で、ノード間の関係を作成したり、類似性検索にベクトル埋め込みを使用したりできる。そのため、リッチな関係モデリングとベクトル検索を必要とするアプリケーションに適している。

スケーラビリティとパフォーマンス

- Chroma**:Chromaは、開発者の生産性を重視した高速なベクトル検索を実現する。ほとんどのAIや機械学習のワークロードに適しているが、小規模で埋め込みに特化したデータセットと、大規模で相互接続されたデータセットに適している。

- Neo4j**:Neo4jのスケーラビリティは、そのグラフ・アーキテクチャと結びついている。HNSWインデックス作成のための量子化と設定可能なパラメータにより、Neo4jは大規模データセットに最適化されている。そのスケーラビリティは、データポイント間の関係がデータそのものと同じくらい重要な、グラフを多用するユースケースで最適です。

柔軟性とカスタマイズ

- クロマシンプルなAPIとSDK(Python、JavaScript/TypeScript)により、開発者の複雑さを軽減。カスタマイズは主に関数の組み込みとメタデータの管理。機能調整よりも統合のしやすさを求めるユーザーに最適。

- Neo4j**:インデックス、クエリ、グラフ・モデリングに多くのカスタマイズ・オプションがあり、非常に柔軟。開発者はベクトル・インデックスを調整し、グラフ・クエリとベクトル検索を組み合わせてハイブリッド・アプリケーションを作ることができる。この柔軟性には、より厳しい学習曲線が伴う。

統合とエコシステム

- クロマ多くのAIツールやフレームワークと統合。オープンソースのため、カスタムワークフローと互換性があり、Hosted Chromaのような今後の機能はエコシステムの拡大を意味する。

- Neo4j**:成熟したグラフデータベースエコシステムの一部であるNeo4jは、多くのエンタープライズツールやフレームワークと統合している。関係ベクトルインデックス(バージョン5.18以降)は、グラフインサイトと意味的類似性を組み合わせることで、AIアプリケーションに新たな次元を追加する。

使いやすさ

- クロマシンプル。APIとファーストパーティのSDKにより学習曲線が短縮され、プラグアンドプレイのベクター検索ソリューションを求める開発者に最適。

- Neo4j**:グラフデータベースとHNSWの知識が必要。クエリ言語は強力だが、Neo4jやグラフ・ベースのアプローチに慣れていない開発者にとって、ベクター・インデキシングを始めるのは複雑かもしれない。

コスト

- クロマオープンソースであり、セルフホスティングであれば運用コストは最小限。ホスティングされた Chroma (近日公開予定) はコストを追加するかもしれないが、メンテナンスを簡素化できる。

- Neo4j**:ベクター・インデキシングを含むエンタープライズ機能は、特に大規模なデプロイメントには高いライセンスと運用コストがかかるかもしれない。しかし、グラフ機能は複雑なアプリケーションに投資する価値がある。

セキュリティ

- クロマオープンソース版の基本的なセキュリティ。今後のマネージド・オファリングでさらに追加される。

- Neo4j**:暗号化、認証、ロール・ベースのアクセス制御を含む高度なセキュリティ・オプション。エンタープライズ展開に適している。

Chromaを使うとき

Chromaは、埋め込みベースの類似検索に大きく依存するAIアプリケーションを構築する開発者に適しています。軽量で開発者に優しく、オープンソースであるため、小規模なプロジェクトや、メタデータ付きベクトルデータの管理とクエリを行うだけのプロジェクトに適している。もしあなたがテキストや画像のような非構造化データや半構造化データを扱っていて、グラフの関係性よりもシンプルさや統合のスピードを重視するのであれば、Chromaは適している。今後、Hosted Chromaのような機能が追加されれば、管理されたソリューションを求めるチームにとってはさらに使いやすくなるだろう。

Neo4jを使うとき

Neo4jは、データ点とデータ点の関係がデータそのものと同じくらい重要なシナリオに適している。そのグラフ・データベースとベクトル・インデックス機能は、レコメンデーション・システム、ナレッジ・グラフ、またはセマンティック検索とリレーショナルな洞察を融合させるアプリケーションのようなユースケースに最適です。構造化データとグラフクエリを組み合わせたり、ハイブリッドAIワークフロー用の関係ベクトルインデックスのような高度な機能を活用する必要があるアプリケーションなら、Neo4jは比類ない。しかし、その複雑なセットアップとチューニング要件は、深い技術的専門知識を持つプロジェクト向けです。

要約

ChromaとNeo4jはどちらもベクトル検索に適している。Chromaはシンプルで組み込み中心のワークフローに適しており、Neo4jはグラフモデリングとセマンティック検索に適している。ユースケース、データタイプ、パフォーマンス要件に合わせて選択する必要がある。エンベッディングに重点を置いたAIネイティブ・アプリケーションには、Chromaが最適だ。高度な関係モデリングやベクトル検索を必要とするグラフを多用するプロジェクトには、Neo4jの方が適している。プロジェクトのゴールと扱うデータの種類をよく考えて、正しい選択をしてほしい。

この記事では、ChromaとNeo4jの概要について説明したが、これらのデータベースをあなたの特定のユースケースに基づいて評価することが重要である。このプロセスを支援するツールの一つが、ベクターデータベースのパフォーマンスを比較するために設計されたオープンソースのベンチマークツールであるVectorDBBenchだ。最終的には、特定のデータセットとクエリパターンを使った徹底的なベンチマークが、分散データベースシステムにおけるベクトル検索に対する、強力でありながら異なる2つのアプローチの間で、十分な情報に基づいた決断を下すために不可欠となる。

オープンソースのVectorDBBenchを使って、ベクターデータベースを自分で評価・比較する

VectorDBBenchは、高性能なデータ保存・検索システム、特にベクトルデータベースを必要とするユーザーのために設計されたオープンソースのベンチマークツールです。このツールにより、ユーザはMilvusやZilliz Cloud(マネージドMilvus)のような異なるベクトルデータベースシステムの性能を、自身のデータセットを用いてテスト・比較し、ユースケースに最も適したものを決定することができます。VectorDBBenchを使用することで、ユーザーはマーケティング上の主張や逸話的証拠に頼るのではなく、実際のベクトルデータベースのパフォーマンスに基づいて情報に基づいた決定を下すことができます。

VectorDBBenchはPythonで書かれており、MITオープンソースライセンスの下でライセンスされています。VectorDBBenchは、その機能と性能の改善に取り組む開発者のコミュニティによって活発にメンテナンスされています。

VectorDBBenchをGitHubリポジトリ**からダウンロードして、我々のベンチマーク結果を再現したり、あなた自身のデータセットでパフォーマンス結果を得てください。

VectorDBBench Leaderboard](https://zilliz.com/vector-database-benchmark-tool?database=ZillizCloud%2CMilvus%2CElasticCloud%2CPgVector%2CPinecone%2CQdrantCloud%2CWeaviateCloud&dataset=medium&filter=none%2Clow%2Chigh&tab=1)で、主流のベクトルデータベースのパフォーマンスを簡単に見てみましょう。

ベクターデータベースの評価については、以下のブログをお読みください。

- ベンチマーク・ベクター・データベースのパフォーマンス:テクニックと洞察](https://zilliz.com/learn/benchmark-vector-database-performance-techniques-and-insights)

- VectorDBBench: Open-Source Vector Database Benchmark Tool](https://zilliz.com/learn/open-source-vector-database-benchmarking-your-way)

- ベクターデータベースを他のデータベースと比較する](https://zilliz.com/comparison)

VectorDB、GenAI、MLに関するその他のリソース

- ジェネレーティブAIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

- あなたのGenAIアプリのためのトップパフォーマンスAIモデル|Zilliz](https://zilliz.com/ai-models)

- RAGとは](https://zilliz.com/learn/Retrieval-Augmented-Generation)

- 大規模言語モデル(LLM)を学ぶ](https://zilliz.com/learn/ChatGPT-Vector-Database-Prompt-as-code)

- ベクトルデータベース101](https://zilliz.com/learn/what-is-vector-database)

- 自然言語処理(NLP)](https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models)

読み続けて

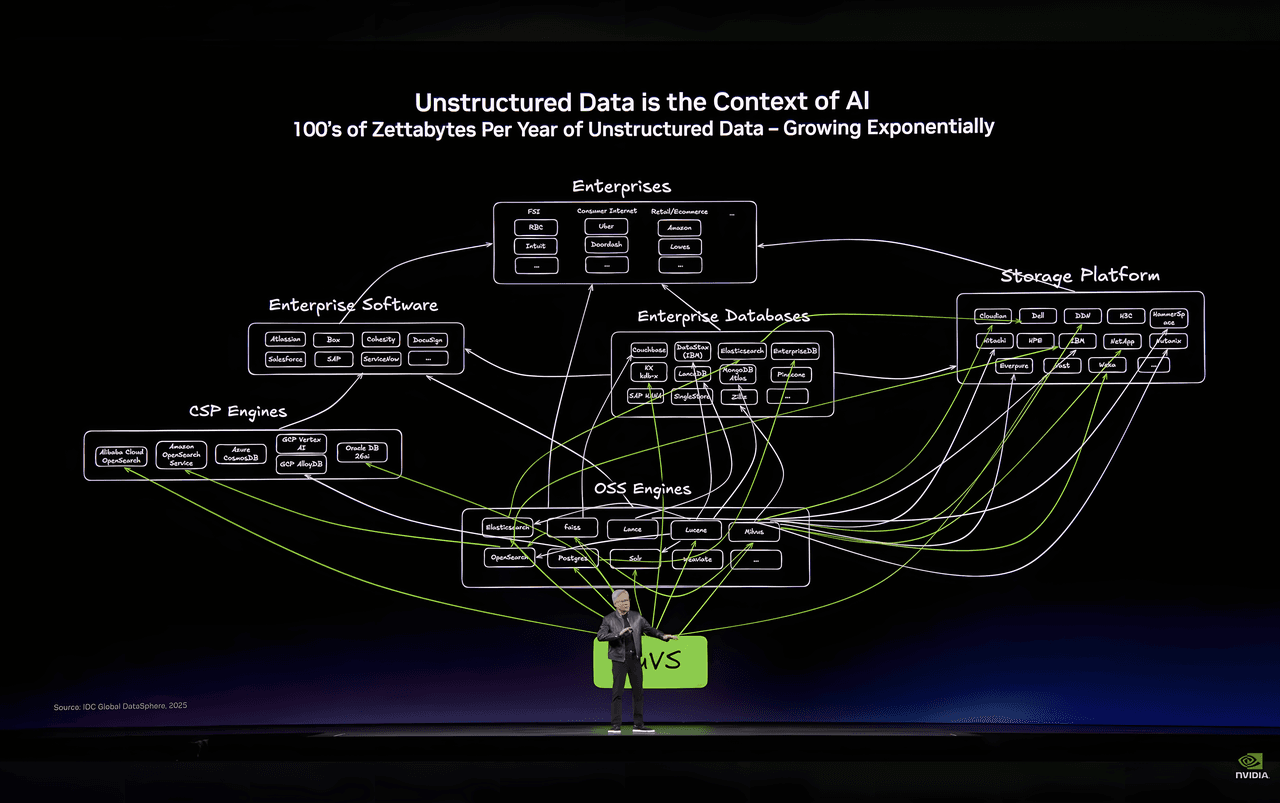

How Zilliz Ended Up at the Center of NVIDIA’s Unstructured Data Story at GTC 2026

If unstructured data is the context of AI, then the ceiling of AI applications will be set not just by models, but by how mature the infrastructure for unstructured data becomes.

Democratizing AI: Making Vector Search Powerful and Affordable

Zilliz democratizes AI vector search with Milvus 2.6 and Zilliz Cloud for powerful, affordable scalability, cutting costs in infrastructure, operations, and development.

Vector Databases vs. Object-Relational Databases

Use a vector database for AI-powered similarity search; use an object-relational database for complex data modeling with both relational integrity and object-oriented features.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.