Apache CassandraとVespaの比較:AIアプリケーションに適したベクター・データベースの選択

AI主導のアプリケーションが普及するにつれ、開発者やエンジニアは、ベクトルデータを効率的に処理する適切なデータベースを選択するという課題に直面している。この分野で人気のある2つの選択肢は、Apache CassandraとVespaです。この記事では、ベクター・データベースのニーズに対して十分な情報に基づいた決定を下すのに役立つ、これらのテクノロジーを比較する。

ベクターデータベースとは?

Apache Cassandra**とVespaを比較する前に、まずベクターデータベースの概念について説明します。

ベクトルデータベース](https://zilliz.com/learn/what-is-vector-database)は、高次元のベクトルエンベッディングを格納し、クエリするために特別に設計されたもので、非構造化データの数値表現です。これらのベクトルは、テキストの意味的な意味、画像の視覚的な特徴、または製品の属性などの複雑な情報をエンコードします。効率的な類似検索を可能にすることで、ベクトルデータベースはAIアプリケーションにおいて極めて重要な役割を果たし、より高度なデータ分析と検索を可能にする。

ベクトルデータベースは、電子商取引の商品推奨、コンテンツ発見プラットフォーム、サイバーセキュリティにおける異常検知、医療画像分析、自然言語処理(NLP)タスクなど、多くのユースケースで採用されている。また、AI幻覚のような問題を軽減するために外部知識を提供することで大規模言語モデル(LLMs)のパフォーマンスを向上させる技術である、検索拡張生成(RAG)でも重要な役割を果たしている。

市場には、以下のような多くの種類のベクトル・データベースがある:

- Milvus](https://zilliz.com/what-is-milvus)、Zilliz Cloud(フルマネージドMilvus)など。

- Faiss](https://zilliz.com/learn/faiss)やAnnoyのようなベクトル検索ライブラリ。

- Chroma](https://zilliz.com/blog/milvus-vs-chroma)やMilvus Liteのような軽量ベクトルデータベース。

- 小規模なベクトル検索が可能なベクトル検索アドオンを備えた従来のデータベース**。

CassandraとVespaは、ベクトル・データベースに対する異なるアプローチを表している。Cassandraは、ベクトル検索機能を含むように進化した伝統的なデータベースであり、一方Vespaは、専用に構築されたベクトル・データベースです。ベクトルデータを扱い、効率的に類似検索を実行するためにゼロから設計された。特化したソリューションとして、Vespaはベクトル操作のみに焦点を当て、類似検索やレコメンデーションなどのタスクに最適化されている。

Apache Cassandra:概要とコア・テクノロジー

Apache Cassandraは、スケーラビリティと可用性で知られるオープンソースの分散NoSQLデータベースです。Cassandraの特徴には、可用性、拡張性、調整可能な一貫性、柔軟なデータ・モデルのためのマスターレス・アーキテクチャがあります。Cassandra 5.0](https://cassandra.apache.org/doc/latest/cassandra/vector-search/concepts.html)のリリースにより、Storage-Attached Indexes (SAI)機能を通じてベクトル埋め込みとベクトル類似性検索をサポートするようになった。この統合により、Cassandraはベクトル・データを扱えるようになりましたが、ベクトル検索はネイティブ機能ではなく、Cassandraの既存のアーキテクチャの拡張として実装されていることに注意することが重要です。

Cassandraのベクトル検索機能は、既存のアーキテクチャ上に構築されています。これにより、ユーザーはベクトル埋め込みを他のデータと一緒に保存し、類似検索を実行できるようになります。この統合により、Cassandraは大規模な分散データを扱う強みを維持しながら、AI主導のアプリケーションをサポートできるようになる。

Cassandraのベクトル検索の重要なコンポーネントは、Storage-Attached Indexes(SAI)です。SAIは非常にスケーラブルでグローバルに分散されたインデックスで、あらゆるベクトル・データ型の列に列レベルのインデックスを追加します。ベクトル検索データベースやその他の検索インデックスに高いI/Oスループットを提供します。SAIは広範なインデックス機能を提供し、クエリとコンテンツ(文書、単語、画像などの大規模な入力を含む)の両方にインデックスを付けてセマンティクスを把握することができます。

Vector Searchは、SAIの新しいモジュール性を活用した、SAIの拡張性を検証する最初の事例です。このVector SearchとSAIの組み合わせにより、AIと機械学習のワークロードを処理するCassandraの機能が強化され、ベクトル・データベースの分野で強力な候補となる。

Vespa概要とコア・テクノロジー

Vespaは強力な検索エンジンとベクトルデータベースで、複数の種類の検索を一度に扱うことができます。ベクター検索、テキスト検索、構造化データによる検索に優れています。つまり、類似したアイテム(画像や商品など)を検索したり、テキスト内の特定の単語を検索したり、日付や数字に基づいて検索結果をフィルタリングしたりすることができます。Vespaは柔軟性があり、単純な数値から複雑な構造まで、さまざまなデータタイプを扱うことができます。

Vespaの際立った特徴のひとつは、ベクトル検索機能です。ドキュメントに任意のベクトルフィールドを追加することができ、Vespaはそれらを素早く検索します。テンソルと呼ばれる特殊なベクトルも扱うことができ、マルチパートのドキュメント埋め込みなどを表現するのに便利です。Vespaはこれらのベクトルの保存と検索をスマートに行うので、大量のデータを処理しても速度が落ちることはありません。

Vespaは超高速かつ効率的に構築されています。メモリを管理し、検索を行うためにC++で書かれた独自の特別なエンジンを使用しているため、複雑なクエリや大量のデータを扱う場合でも優れたパフォーマンスを発揮します。新しいデータを追加したり、多くの検索を同時に処理したりしても、スムーズに動作し続けるように設計されている。そのため、多くのトラフィックやデータを処理する必要がある、大規模で現実的なアプリケーションに最適です。

Vespaのもう一つの優れた点は、より多くのデータやトラフィックを処理するために自動的にスケールアップできることです。Vespaのセットアップにコンピュータを追加すれば、自動的にそれらのコンピュータに作業を分散させることができる。これは、複雑なセットアップをすることなく、ニーズの成長に合わせて検索システムを成長させることができることを意味します。Vespaは、データ量やトラフィックの変化に対応するために自動的に調整することもでき、コスト削減に役立ちます。そのため、時間とともに成長する検索システムを必要とするビジネスには最適です。

主な違いApache CassandraとVespaの比較

検索方法

CassandraとVespaの検索へのアプローチは異なります。Cassandraは、Storage-Attached Indexes(SAI)を使用して、従来のNoSQLデータ構造とともにベクトルの類似性検索を可能にします。SAIはベクトルの埋め込みと検索を可能にしますが、Cassandraのアーキテクチャの拡張であり、コア機能ではありません。一方、Vespaは検索に特化して構築されており、ベクトル、テキスト、構造化データの同時検索に優れている。Vespaは複数のベクトル・フィールドを追加でき、複雑なテンソル・ベースのベクトルも扱えるため、高性能でマルチ・モーダルな検索機能に特化している。

データハンドリング

Cassandraは、大規模、分散、構造化、半構造化データを処理するように設計されており、ベクトル・データはSAIを介して新しい機能として追加されました。Cassandraは主に分散ノード間でのデータの保存と検索に重点を置いています。Vespaはより柔軟で、構造化、半構造化、非構造化データを難なく扱うことができます。テキスト、数値データ、ベクトルを一緒に処理する能力により、複雑なデータセットを管理する際の汎用性を高めている。Vespaのテンソル機能は、AIアプリケーションでエンベッディングのような高度なデータモデルを扱う際に優位性を発揮します。

スケーラビリティとパフォーマンス

CassandraとVespaはどちらも高いスケーラビリティを備えていますが、アプローチは異なります。Cassandraのマスターレス・アーキテクチャは、複数のノードに容易に水平にスケールすることを可能にし、高い可用性とパフォーマンスを保証します。Vespaも複数のマシンに作業を分散することで効率的にスケールしますが、手動で介入することなくトラフィックやデータの変更に自動的に調整することでさらに一歩進んでいます。C++で書かれたVespaのメモリ管理と特化した検索エンジンは、複雑なクエリを処理する場合でも高速なパフォーマンスを保証する。一方、Cassandraのパフォーマンスはより一般化されており、検索よりも分散データ管理に最適化されている。

柔軟性とカスタマイズ

Cassandraは、特に分散アプリケーション向けに柔軟なデータ・モデルを提供しますが、検索機能を拡張するためにSAIに依存しているため、そのベクトル検索はカスタマイズ性に劣ります。Vespaはデータ・モデリングと検索のカスタマイズに関してはより柔軟です。開発者はベクトル検索、テキスト検索、構造化クエリをシームレスに組み合わせることができる。Vespaのテンソルサポートは、複雑な埋め込みを扱う能力をさらに強化し、検索操作のカスタマイズ性を向上させます。

統合とエコシステム

Cassandraは、ビッグ・データ・ツールやクラウド・プラットフォームとの幅広い統合をサポートするエコシステムが確立されています。幅広く採用されているため、既存のインフラへの組み込みも容易だ。Vespaはより専門的で、機械学習フレームワークやビッグデータシステムと統合できるが、検索を多用するアプリケーションに重点を置いている。Vespaのエコシステムは、複雑なAIやリアルタイム検索システムを構築する開発者向けだ。対照的に、Cassandraはベクトル検索を追加機能として持つ一般的な分散データワークロードにより適している。

使いやすさ

Cassandraは、NoSQLデータベースや分散システムに慣れている開発者にとって採用しやすく、豊富なドキュメントとコミュニティ・サポートがある。Vespaはより専門的であるため、特に検索エンジンやベクターデータベースに慣れていないユーザーにとっては学習曲線が急かもしれない。しかし、Vespaのドキュメントは包括的であり、自動化されたスケーリングと管理機能により、セットアップとメンテナンスの複雑さを長期的に軽減することができる。

コストの検討

Cassandraはオープンソースで広く採用されているため、分散データベースの運用コストは低いですが、ベクトル検索にSAIを追加すると、高性能な検索タスクのリソース使用量が増える可能性があります。Vespaの自動スケーリングと効率的なリソース管理は、トラフィックやデータサイズが変動する環境でのコスト最適化に役立ちます。しかし、その特化した機能はより強力なインフラを必要とし、Cassandraよりも初期コストが高くなる可能性があります。

セキュリティ機能

CassandraとVespaはどちらも強固なセキュリティ機能を提供しています。Cassandraは暗号化、認証、ロール・ベースのアクセス制御をサポートし、安全な分散データ操作を保証します。Vespaも暗号化ときめ細かなアクセス制御を提供しますが、検索を多用するアプリケーションに重点を置いているため、リアルタイム・データとベクトル検索環境向けに最適化されたセキュリティ機能を備えています。どちらのシステムもエンタープライズレベルのセキュリティを扱うことができるが、Cassandraの汎用的なアプローチの方が従来のITチームにはなじみがあるかもしれない。

Cassandraを選ぶとき

Cassandraは、高可用性とスケーラビリティを必要とする大規模な分散データを扱うユースケースに最適です。そのマスターレス・アーキテクチャは、複数のノード間で信頼できるパフォーマンスを保証し、グローバル・データ管理、大規模分析、分散AI駆動型ワークロードなどのアプリケーションに理想的です。従来のNoSQL運用と並行して基本的なベクトル検索機能が必要な場合、CassandraのStorage-Attached Indexes(SAI)を介したベクトル埋め込み機能の統合は、検索に特化した完全なエンジンを必要としない効果的なソリューションを提供します。

Vespaを選ぶとき

Vespaは、高度なマルチモーダル検索機能を必要とするアプリケーション、特にリアルタイムでベクトル、テキスト、構造化データを組み合わせて検索する必要がある場合に適した選択肢です。AI主導のレコメンデーション・システム、eコマース、コンテンツ・ディスカバリーなど、高速で柔軟な検索が重要なシナリオで優れています。ベクトル、テンソル、大規模なデータセットを含む複雑なクエリを効率的なスケーリングで処理できるVespaは、トップクラスのパフォーマンスと柔軟性を必要とする検索負荷の高いアプリケーションに最適なソリューションです。

結論

結論として、CassandraとVespaはニーズによって異なる目的を果たします。Cassandraは、スケーラビリティ、可用性、基本的なベクトル検索機能が鍵となる大規模分散データ・アプリケーションにとって強力な選択肢です。その強みは、多数のノードにまたがる大量のデータを高いパフォーマンスと信頼性で扱えることにあります。一方、Vespaは検索を多用するアプリケーションを得意とし、ベクトル、テキスト、構造化データによる高度なマルチモーダル検索機能を提供するため、AI主導のシステムや複雑なクエリに最適です。この2つのどちらを選ぶかは、分散データ管理に重点を置くか、強力なリアルタイム検索機能に重点を置くかによって決まります。

本記事ではCassandraとVespaの概要を説明するが、特定のユースケースに基づいてこれらのデータベースを評価することが重要だ。このプロセスを支援するツールの1つが、ベクトルデータベースのパフォーマンスを比較するために設計されたオープンソースのベンチマークツールであるVectorDBBenchです。最終的には、特定のデータセットとクエリパターンで徹底的なベンチマークを行うことが、分散データベースシステムにおけるベクトル検索に対する、強力でありながら異なるこの2つのアプローチの間で、十分な情報に基づいた決断を下すために不可欠となります。

オープンソースのVectorDBBenchを使って、ベクターデータベースを自分で評価・比較する

VectorDBBenchは、高性能なデータ保存・検索システム、特にベクトルデータベースを必要とするユーザーのために設計されたオープンソースのベンチマークツールです。このツールにより、ユーザは独自のデータセットを用いてMilvusやZilliz Cloud(マネージドMilvus)などの異なるベクトルデータベースシステムの性能をテスト・比較し、ユースケースに最も適したものを決定することができます。VectorDBBenchを使用することで、ユーザーはマーケティング上の主張や逸話的証拠に頼るのではなく、実際のベクトルデータベースのパフォーマンスに基づいて情報に基づいた決定を下すことができます。

VectorDBBenchはPythonで書かれており、MITオープンソースライセンスの下でライセンスされています。VectorDBBenchは、その機能と性能の改善に取り組む開発者のコミュニティによって活発にメンテナンスされています。

VectorDBBenchをGitHubリポジトリ**からダウンロードして、我々のベンチマーク結果を再現したり、あなた自身のデータセットでパフォーマンス結果を得てください。

VectorDBBench Leaderboard](https://zilliz.com/vector-database-benchmark-tool?database=ZillizCloud%2CMilvus%2CElasticCloud%2CPgVector%2CPinecone%2CQdrantCloud%2CWeaviateCloud&dataset=medium&filter=none%2Clow%2Chigh&tab=1)**で主流のベクトルデータベースの性能を見てみましょう。

ベクターデータベースの評価については、以下のブログをお読みください。

- ベンチマークベクターデータベースのパフォーマンス:テクニックと洞察](https://zilliz.com/learn/benchmark-vector-database-performance-techniques-and-insights)

- VectorDBBench: オープンソースベクターデータベースベンチマークツール](https://zilliz.com/learn/open-source-vector-database-benchmarking-your-way)

- ベクターデータベースを他のデータベースと比較する](https://zilliz.com/comparison)

VectorDB、GenAI、MLに関するその他のリソース

- ジェネレーティブAIリソースハブ|Zilliz](https://zilliz.com/learn/generative-ai)

- あなたのGenAIアプリのためのトップパフォーマンスAIモデル|Zilliz](https://zilliz.com/ai-models)

- RAGとは](https://zilliz.com/learn/Retrieval-Augmented-Generation)

- 大規模言語モデル(LLM)を学ぶ](https://zilliz.com/learn/ChatGPT-Vector-Database-Prompt-as-code)

- ベクトルデータベース101](https://zilliz.com/learn/what-is-vector-database)

- 自然言語処理(NLP)](https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models)

読み続けて

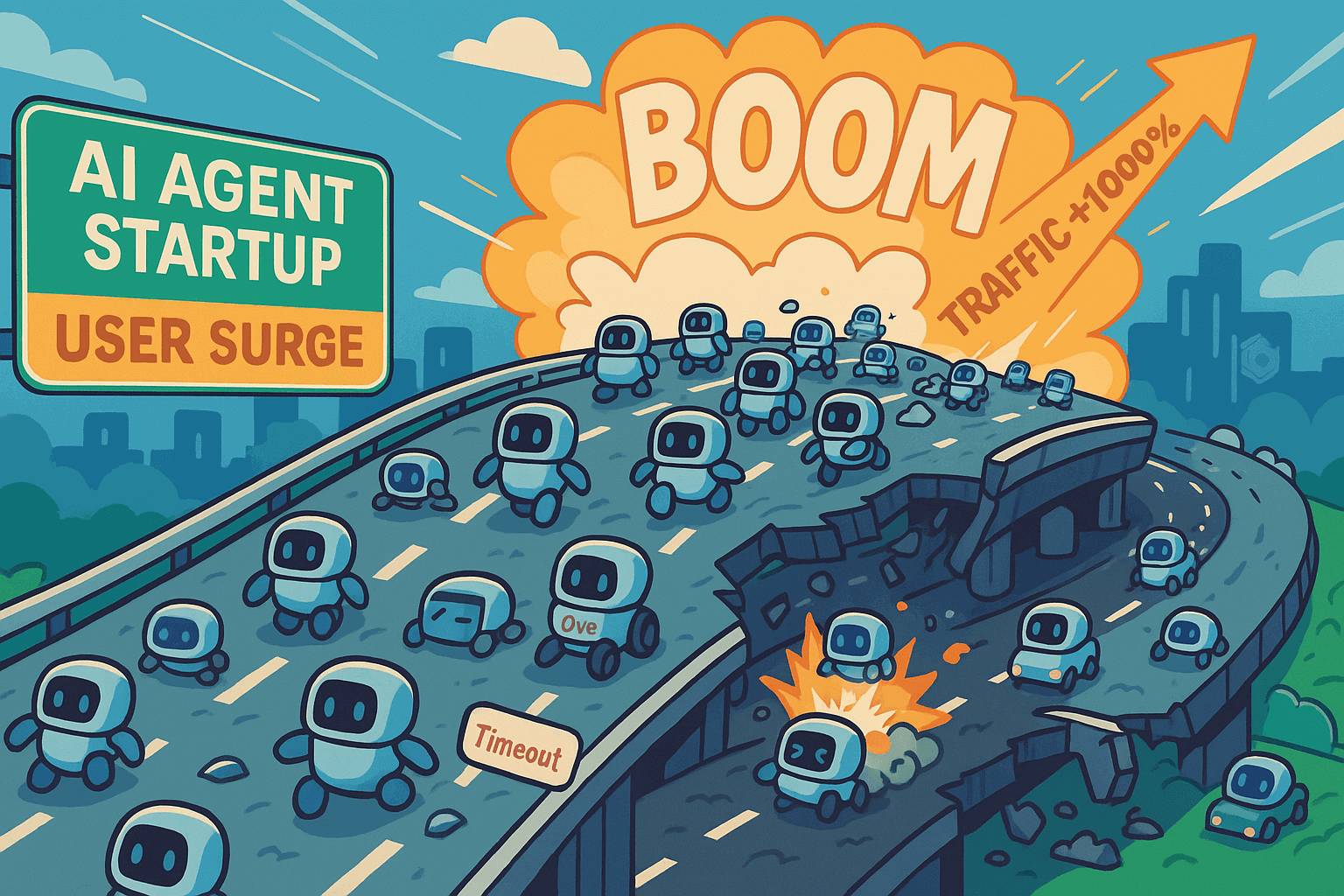

Why Not All VectorDBs Are Agent-Ready

Explore why choosing the right vector database is critical for scaling AI agents, and why traditional solutions fall short in production.

DeepRAG: Thinking to Retrieval Step by Step for Large Language Models

Discover DeepRAG, an advanced retrieval-augmented generation (RAG) model that improves LLM accuracy by retrieving only essential data through step-by-step reasoning.

Vector Databases vs. Hierarchical Databases

Use a vector database for AI-powered similarity search; use a hierarchical database for organizing data in parent-child relationships with efficient top-down access patterns.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.