2025년 개발자가 무시할 수 없는 오픈소스 LLM 프레임워크 10가지

2024년은 대규모 언어 모델(LLM)의 획기적인 해였으며, 2025년에 접어들면서 그 추진력은 둔화될 기미가 보이지 않습니다. GPT-4와 Gemini의 멀티모달 기능에서 실시간 적응형 AI 시스템에 이르기까지 LLM은 더 이상 최첨단 기술이 아니라 필수 요소입니다. 챗봇, 검색 엔진, 콘텐츠 제작 도구, 심지어 인간만이 처리할 수 있다고 생각했던 워크플로우를 자동화하는 데도 사용되고 있습니다.

하지만 강력한 LLM을 갖추는 것은 절반의 성공에 불과합니다. 확장 가능하고 효율적이며 프로덕션에 바로 사용할 수 있는 LLM 애플리케이션을 구축하는 것은 쉽지 않은 일이며, 바로 이 점에서 LLM 프레임워크가 필요합니다. 이 프레임워크는 워크플로를 간소화하고 성능을 향상시키며 기존 시스템과 원활하게 통합되므로 개발자가 적은 노력으로 이러한 모델의 잠재력을 최대한 활용할 수 있습니다.

이 글에서는 2025년으로 향하는 AI 개발자가 무시할 수 없는 10가지 오픈 소스 LLM 프레임워크를 집중적으로 살펴볼 것입니다. 이러한 프레임워크는 개발자가 그 어느 때보다 빠르게 확장, 최적화, 혁신할 수 있도록 도와주는 비밀 병기입니다. AI 프로젝트의 수준을 높일 준비가 되셨다면 지금 바로 시작하세요!

LangChain: 컨텍스트 인식, 다단계 AI 워크플로우 지원

랭체인**은 대규모 언어 모델(LLM)로 구동되는 애플리케이션의 개발을 간소화하도록 설계된 오픈 소스 프레임워크입니다. LLM과 외부 데이터 소스, API 또는 계산 로직을 결합하는 워크플로우 구축을 간소화하여 개발자가 대화형 에이전트, 문서 분석 및 요약과 같은 작업을 위한 동적 상황 인식 시스템을 만들 수 있도록 지원합니다.

주요 기능

사용 가능한 파이프라인: LangChain을 사용하면 여러 LLM 호출과 외부 함수를 쉽게 연결할 수 있어 복잡한 다단계 워크플로우를 가능하게 합니다.

기성품 체인: LangChain은 특정 상위 수준의 작업을 수행하도록 설계된 구성 요소의 체계적인 어셈블리인 사전 구성된 체인을 제공합니다. 이러한 기성품 체인은 프로젝트 시작을 간소화합니다.

신속한 엔지니어링 유틸리티**: 특정 작업에 맞는 프롬프트를 제작, 관리 및 최적화하기 위한 도구가 포함되어 있습니다.

메모리 관리**: 상호작용 전반에 걸쳐 대화 컨텍스트를 유지하기 위한 기본 제공 기능을 제공하여 보다 개인화된 애플리케이션을 구현할 수 있습니다.

LangChain은 타사 API, 벡터 데이터베이스, LLM 및 다양한 데이터 소스와 연결되었습니다. 특히, 밀버스 및 질리즈 클라우드와 같은 벡터 데이터베이스와의 LangChain 통합은 그 잠재력을 더욱 향상시킵니다. 밀버스는 수십억 개 규모의 임베딩 벡터를 관리하고 쿼리할 수 있는 오픈소스 고성능 벡터 데이터베이스입니다. 관련 데이터를 빠르고 정확하게 검색할 수 있게 함으로써 LangChain의 기능을 보완합니다. 개발자는 이 통합을 활용하여 Milvus가 문맥에 맞는 문서를 검색하는 확장 가능한 검색 증강 생성(RAG) 시스템을 구축할 수 있습니다. LangChain은 생성 모델을 사용하여 정확하고 통찰력 있는 결과물을 생성합니다. 자세한 내용은 아래 리소스를 참조하세요:

언어의 힘 활용하기: LangChain 소개 ](https://zilliz.com/learn/LangChain)

고급 RAG를 위한 질리즈 클라우드와 랭체인 통합](https://zilliz.com/product/integrations/langchain)

랭체인JS, 밀버스, 스트래피로 RAG 구축하기 ](https://zilliz.com/blog/build-rag-with-langchain-milvus-and-strapi)

밀버스, 랭체인, 오픈AI로 다국어 RAG 구축하는 방법](https://zilliz.com/blog/building-multilingual-rag-milvus-langchain-openai)

LangChain을 통한 노션 문서의 검색 증강 생성 ](https://zilliz.com/blog/retrieval-augmented-generation-on-notion-docs-via-langchain)

라마 인덱스: 다양한 데이터 소스에 LLM 연결하기

라마 인덱스**는 대규모 언어 모델(LLM)이 다양한 데이터 소스에 효율적으로 액세스하고 활용할 수 있도록 지원하는 오픈 소스 프레임워크입니다. 비정형 데이터의 수집, 구조화 및 쿼리를 간소화하여 문서 검색, 요약 및 지식 기반 챗봇과 같은 고급 AI 애플리케이션을 더 쉽게 구축할 수 있습니다.

주요 기능

데이터 커넥터**: PDF, SQL 데이터베이스, API, 벡터 스토어 등 다양한 소스에서 정형 및 비정형 데이터를 수집할 수 있는 강력한 커넥터 세트를 제공합니다.

색인 도구**: 개발자가 트리, 목록, 그래프 기반 구조를 포함한 사용자 정의 인덱스를 생성하여 데이터 쿼리 및 검색을 최적화할 수 있습니다.

쿼리 최적화**: 상황에 맞는 정확한 응답을 가능하게 하는 고급 쿼리 메커니즘을 제공합니다.

확장성: 고도로 모듈화되어 있어 외부 라이브러리 및 도구와 쉽게 통합하여 기능을 강화할 수 있습니다.

LLM에 최적화된 프레임워크**: LLM과 함께 작동하도록 설계되어 대규모 작업을 위한 컴퓨팅 리소스를 효율적으로 사용할 수 있습니다.

LlamaIndex는 확장 가능하고 효율적인 RAG 워크플로우를 지원하기 위해 Milvus 및 Zilliz Cloud와 같은 다양한 특수 목적 벡터 데이터베이스와 통합되었습니다. 이 설정에서 Milvus는 임베딩 벡터를 저장하고 쿼리하기 위한 고성능 백엔드 역할을 하며, LlamaIndex는 검색된 데이터를 구조화하고 정리하여 LLM이 처리할 수 있도록 합니다. 이러한 조합을 통해 개발자는 가장 관련성이 높은 데이터 포인트를 검색할 수 있으며, LLM은 보다 정확하고 컨텍스트를 인식하는 결과물을 제공할 수 있습니다. 자세한 내용은 아래 리소스를 참조하세요:

헤이스택 생산 준비가 완료된 AI 애플리케이션을 위한 RAG 파이프라인 간소화

헤이스택은 LLM 기반 애플리케이션 개발을 용이하게 하도록 설계된 오픈 소스 파이썬 프레임워크입니다. 개발자가 LLM을 다양한 데이터 소스 및 구성 요소와 통합하여 엔드투엔드 AI 솔루션을 만들 수 있도록 지원하므로 RAG, 문서 검색, 질문 답변, 답변 생성 등의 작업에 적합합니다.

주요 기능

유연한 파이프라인: Haystack을 사용하면 문서 검색, 질문 답변, 요약과 같은 작업을 위한 모듈식 파이프라인을 만들 수 있습니다. 개발자는 다양한 구성 요소를 결합하여 특정 요구사항에 맞게 워크플로를 조정할 수 있습니다.

리트리버-리더 아키텍처**: 효율적인 문서 필터링을 위한 리트리버와 리더(예: LLM)를 결합하여 정확하고 컨텍스트를 인식하는 응답을 생성합니다.

백엔드 애그노스틱**: Milvus 및 FAISS를 포함한 여러 벡터 데이터베이스 백엔드를 지원하여 배포의 유연성을 보장합니다.

LLM 통합**: 언어 모델과의 원활한 통합을 제공하여 개발자가 사전 학습되고 미세 조정된 모델을 다양한 작업에 활용할 수 있습니다.

확장성 및 성능**: 대규모 데이터 세트와 처리량이 많은 쿼리를 처리하는 데 최적화되어 엔터프라이즈 애플리케이션에 적합합니다.

2024년 3월, Haystack은 더욱 유연하고 사용자 정의가 가능한 아키텍처를 도입한 Haystack 2.0을 출시했습니다. 이 업데이트를 통해 병렬 분기 및 루핑과 같은 기능으로 복잡한 파이프라인을 생성할 수 있으며, LLM 및 에이전트 동작에 대한 지원이 강화됩니다. 새로운 디자인은 데이터 저장을 위한 공통 인터페이스를 강조하여 Milvus 및 Zilliz Cloud를 비롯한 다양한 데이터베이스 및 벡터 스토어와의 통합을 제공합니다. 이러한 유연성을 통해 Haystack 파이프라인 내에서 데이터에 쉽게 액세스하고 관리할 수 있어 확장 가능한 고성능 AI 애플리케이션 개발을 지원합니다. 자세한 내용은 아래 리소스를 참조하세요:

헤이스택 깃허브**: https://github.com/deepset-ai/haystack

통합: 헤이스택과 밀버스

Dify: LLM 기반 앱 개발 간소화하기

Dify**는 AI 애플리케이션 구축을 위한 오픈 소스 플랫폼입니다. 서비스형 백엔드와 LLM을 결합하여 주류 언어 모델을 지원하고 직관적인 프롬프트 오케스트레이션 인터페이스를 제공합니다. Dify는 고품질 RAG 엔진, 유연한 AI 에이전트 프레임워크, 직관적인 로우코드 워크플로우를 제공하여 개발자와 비전문가 사용자 모두 혁신적인 AI 솔루션을 만들 수 있도록 지원합니다.

주요 기능

LLM을 위한 서비스형 백엔드**: 백엔드 인프라를 처리하여 개발자가 서버 관리가 아닌 애플리케이션 구축에 집중할 수 있도록 합니다.

신속한 오케스트레이션**: 특정 작업에 맞는 프롬프트의 제작, 테스트 및 관리를 간소화합니다.

실시간 분석**: 모델 성능, 사용자 상호 작용 및 애플리케이션 동작에 대한 인사이트를 제공하여 워크플로를 최적화합니다.

광범위한 통합 옵션**: 타사 API, 외부 도구 및 인기 있는 LLM과 연결하여 맞춤형 워크플로우를 위한 유연성을 제공합니다.

Dify는 Milvus와 같은 벡터 데이터베이스와 잘 통합되어 복잡한 대규모 데이터 검색 작업을 처리하는 능력을 향상시킵니다. 개발자는 Dify를 Milvus와 페어링하여 RAG와 같은 작업을 위해 임베딩을 효율적으로 저장, 검색 및 처리하는 시스템을 만들 수 있습니다.

튜토리얼: Milvus와 함께 Dify 배포하기

Dify 문서](https://docs.dify.ai/)

레타(이전 MemGPT): 확장된 LLM 컨텍스트 창으로 RAG 에이전트 빌드하기

Letta는 장기 메모리를 장착하여 LLM을 향상시키기 위해 설계된 오픈 소스 프레임워크입니다. 정적으로 입력을 처리하는 기존 LLM과 달리 Letta는 모델이 과거의 상호 작용을 기억하고 참조할 수 있도록 하여 보다 역동적이고 컨텍스트를 인식하며 개인화된 애플리케이션을 구현할 수 있도록 합니다. 또한 메모리 관리 기술을 통합하여 시간이 지남에 따라 정보를 저장, 검색 및 업데이트하므로 사용자 상호 작용에 따라 진화하는 지능형 에이전트 및 대화형 시스템을 만드는 데 이상적입니다.

그림- 레타가 다양한 AI 도구와 함께 작동하는 방식](https://assets.zilliz.com/Figure_How_Letta_works_with_various_AI_tools_05d96d2548.png)

주요 기능 ### 주요 기능

자체 편집 메모리: Letta는 자체 편집 메모리를 도입하여 상담원이 자율적으로 지식 기반을 업데이트하고, 상호작용을 통해 학습하며, 시간이 지남에 따라 적응할 수 있도록 합니다.

에이전트 개발 환경(ADE): AI 에이전트를 생성, 배포, 상호 작용 및 관찰하기 위한 그래픽 인터페이스를 제공하여 개발 및 디버깅 프로세스를 간소화합니다.

지속성 및 상태 관리:** 에이전트가 메모리와 상호 작용을 포함한 상태를 유지하여 세션 간에 연속성을 유지함으로써 보다 일관되고 상황에 맞는 응답을 할 수 있도록 합니다.

도구 통합: 사용자 지정 도구 및 데이터 소스의 통합을 지원하여 상담원이 다양한 작업을 수행하고 필요에 따라 외부 정보에 액세스할 수 있도록 합니다.

모델에 구애받지 않는 아키텍처: 다양한 LLM 및 RAG 시스템과 함께 작동하도록 설계되어 다양한 모델 제공업체를 유연하게 선택하고 통합할 수 있습니다.

Letta는 주류 벡터 데이터베이스와 통합하여 고급 RAG 워크플로우를 위한 메모리 및 검색 기능을 향상시켰습니다. 확장 가능한 벡터 스토리지와 효율적인 유사도 검색을 활용하여 Letta는 AI 에이전트가 장기적인 컨텍스트 지식에 액세스하고 유지할 수 있도록 함으로써 빠르고 정확한 데이터 검색을 보장합니다. 이러한 통합을 통해 개발자는 지속적이고 확장 가능한 메모리를 유지하면서 고객 지원이나 개인화된 추천과 같은 특정 도메인에 맞춘 더 스마트한 컨텍스트 인식 애플리케이션을 구축할 수 있습니다. 자세한 내용은 아래 리소스를 참조하세요.

- 튜토리얼 | Milvus 통합을 통한 MemGPT

Vanna: AI 기반 SQL 생성 지원

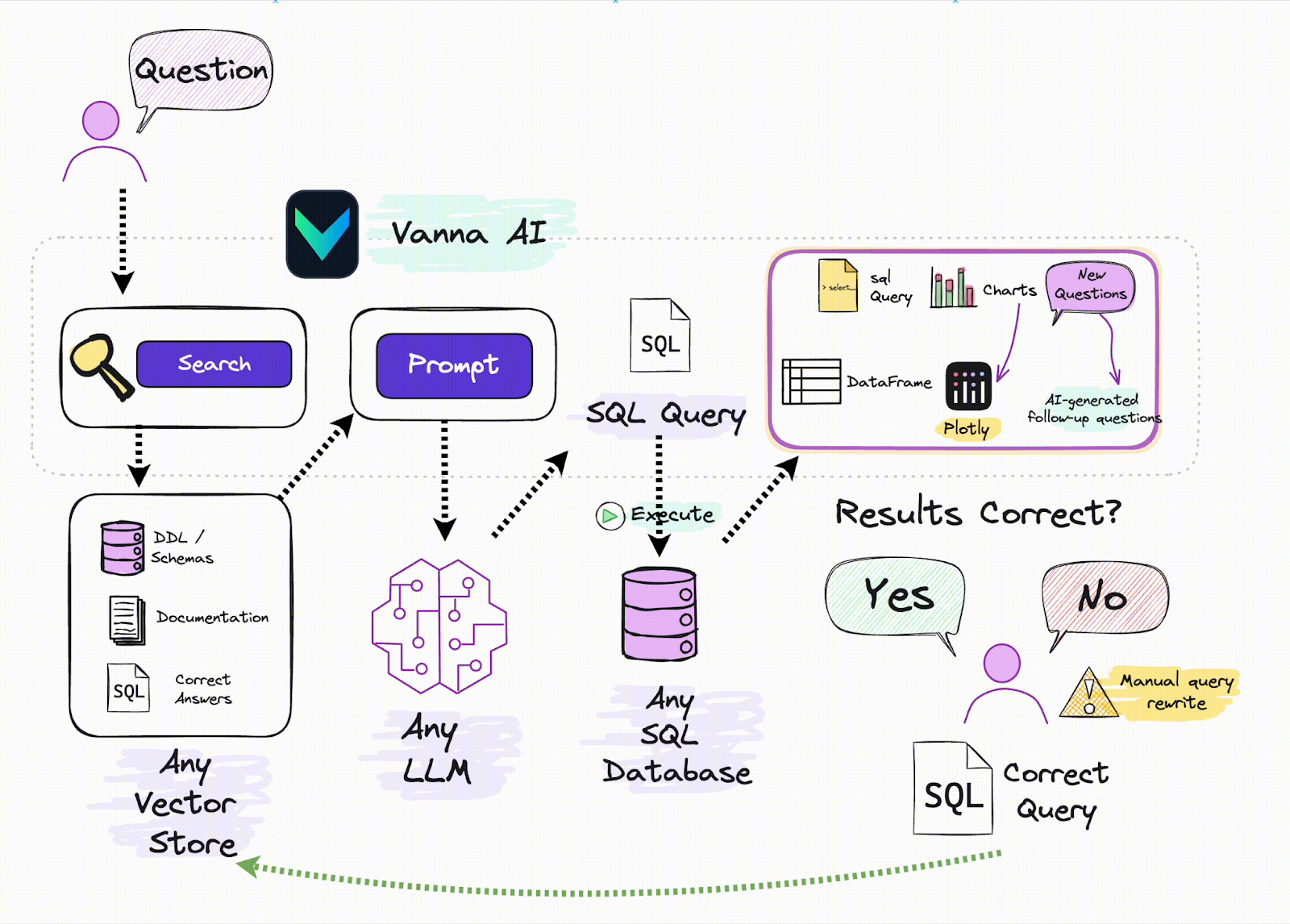

Vanna는 자연어 입력을 통해 SQL 쿼리 생성을 간소화하도록 설계된 오픈 소스 Python 프레임워크입니다. Vanna는 RAG 기술을 활용하여 사용자가 특정 데이터에 대해 모델을 학습시켜 질문을 던지고 데이터베이스에 맞는 정확한 SQL 쿼리를 받을 수 있도록 지원합니다. 이 접근 방식은 데이터베이스와 상호 작용하는 프로세스를 간소화하여 SQL에 대한 전문 지식이 없는 사용자도 쉽게 접근할 수 있도록 합니다.

Vanna

Vanna

주요 기능 ### 주요 기능

자연어를 SQL로 변환**: Vanna는 사용자가 자연어로 질문을 입력하면 연결된 데이터베이스에서 실행 가능한 정확한 SQL 쿼리로 변환합니다.

여러 데이터베이스 지원**: 이 프레임워크는 스노우플레이크, 빅쿼리, 포스트그레스 등 다양한 데이터베이스를 즉시 지원합니다. 또한 사용자 지정 커넥터를 통해 모든 데이터베이스와 쉽게 통합할 수 있습니다.

사용자 인터페이스 유연성**: Vanna는 주피터 노트북, 슬랙봇, 웹 앱, 스트림릿 앱 등 다양한 사용자 인터페이스 옵션을 제공하여 사용자가 자신의 워크플로에 가장 적합한 프런트엔드를 선택할 수 있습니다.

Vanna와 벡터 데이터베이스는 효과적인 RAG 시스템을 구축하기 위한 훌륭한 조합입니다. 사용자가 자연어 쿼리를 입력하면 Vanna는 벡터 데이터베이스를 활용하여 미리 저장된 벡터 임베딩을 기반으로 관련 데이터를 검색합니다. 그런 다음 이 데이터는 Vanna가 정확한 SQL 쿼리를 생성하는 데 사용되어 관계형 데이터베이스에서 구조화된 데이터를 더 쉽게 검색할 수 있도록 도와줍니다. 벡터 검색의 강력한 기능과 SQL 생성을 결합함으로써 Vanna는 비정형 데이터 작업을 간소화하고 사용자가 고급 SQL 지식 없이도 복잡한 데이터 세트와 상호 작용할 수 있게 해줍니다. 자세한 내용은 아래 리소스를 참조하세요:

튜토리얼: 튜토리얼: Vanna와 Milvus로 SQL 작성하기

Milvus + Vanna: AI 기반 SQL 생성](https://zilliz.com/product/integrations/vanna-ai)

코타에몽: AI 기반 문서 QA 구축

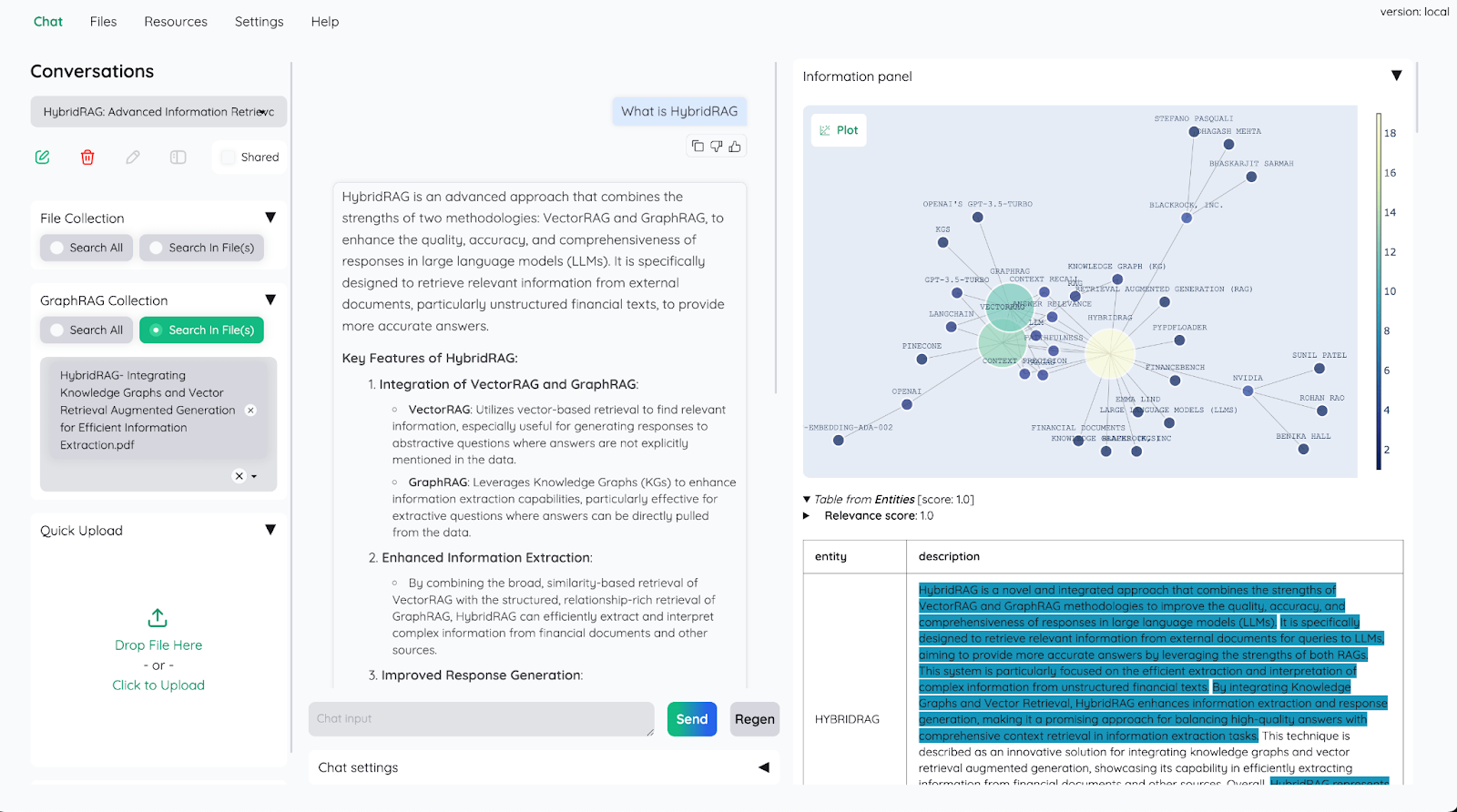

Kotaemon은 문서와 채팅할 수 있는 사용자 정의 가능한 오픈 소스 RAG UI입니다. 로컬 및 API 기반 언어 모델을 지원하는 깔끔한 다중 사용자 문서 QA 웹 인터페이스를 제공하며, 전체 텍스트 및 벡터 검색 기능을 갖춘 하이브리드 RAG 파이프라인을 제공하여 그림과 표가 포함된 문서에 대한 멀티모달 QA를 지원합니다.

최종 사용자와 개발자 모두를 위해 설계된 kotaemon은 ReAct 및 ReWOO와 같은 복잡한 추론 방법을 지원합니다. 문서 미리 보기, 검색 및 생성을 위한 구성 가능한 설정, 사용자 지정 RAG 파이프라인 구축을 위한 확장 가능한 프레임워크가 포함된 고급 인용 기능을 제공합니다.

코타에몬

코타에몬

주요 기능 ### 주요 기능

간편한 배포: Kotaemon은 최소한의 설정으로 LLM을 프로덕션에 배포할 수 있는 간단한 인터페이스를 제공하여 신속한 확장 및 통합을 지원합니다.

커스터마이징 가능한 파이프라인**: 개발자는 LLM을 외부 API, 데이터베이스 및 기타 도구와 결합하여 AI 워크플로를 쉽게 커스터마이징할 수 있습니다.

고급 프롬프트**: 신속한 엔지니어링 및 최적화를 위한 기본 제공 도구가 있어 특정 작업에 맞게 모델 출력을 보다 쉽게 미세 조정할 수 있습니다.

성능 최적화**: 고성능 작업을 위해 설계된 Kotaemon은 지연 시간이 짧은 응답과 효율적인 리소스 사용을 보장합니다.

멀티 모델 지원**: 이 프레임워크는 다양한 LLM 아키텍처를 지원하여 개발자가 특정 사용 사례에 가장 적합한 모델을 유연하게 선택할 수 있습니다.

Kotaemon은 Milvus와 같은 벡터 데이터베이스와 통합되어 검색 증강 생성(RAG)와 같은 작업에 필요한 관련 데이터를 빠르게 검색할 수 있습니다. Milvus의 효율적인 벡터 검색 기능을 활용하여 Kotaemon은 AI가 생성한 결과물의 컨텍스트와 관련성을 향상시킬 수 있습니다. 이러한 통합을 통해 개발자는 콘텐츠를 생성하고 대규모 데이터 세트에서 관련 정보를 검색하는 AI 시스템을 구축하여 전반적인 성능과 정확성을 향상시킬 수 있습니다.

vLLM: 실시간 AI 애플리케이션을 위한 고성능 LLM 추론

vLLM은 UC 버클리의 SkyLab에서 개발한 오픈 소스 라이브러리로, LLM 추론과 서빙을 최적화하도록 설계되었습니다. 성능과 확장성에 중점을 둔 vLLM은 기존 접근 방식에 비해 GPU 메모리 사용량을 절반으로 줄이면서 서빙 속도를 최대 24배까지 향상시키는 PagedAttention 같은 혁신 기술을 도입했습니다. 따라서 하드웨어 리소스를 효율적으로 활용해야 하는 까다로운 AI 애플리케이션을 구축하는 개발자에게 획기적인 변화를 가져올 것입니다.

주요 기능:

페이징 어텐션 기술: 어텐션 키와 값을 비연속적으로 저장하여 메모리 낭비를 줄이고 처리량을 최대 24배까지 개선함으로써 메모리 관리를 향상시킵니다.

연속 일괄 처리: 수신 요청을 실시간으로 집계하여 GPU 사용률을 극대화하고 유휴 시간을 최소화하여 처리량을 높이고 지연 시간을 줄입니다.

스트리밍 출력:** 실시간 토큰 생성을 제공하여 애플리케이션이 부분적인 결과를 즉시 제공할 수 있어 챗봇과 같은 실시간 사용자 상호 작용에 이상적입니다.

광범위한 모델 호환성: GPT, LLaMA 등 널리 사용되는 LLM 아키텍처를 지원하여 다양한 사용 사례에 유연하게 대응하고 기존 워크플로우와의 원활한 통합을 보장합니다.

OpenAI 호환 API 서버:** OpenAI를 미러링하는 API 인터페이스를 제공하여 OpenAI API에 익숙한 개발자가 기존 시스템에 간편하게 배포 및 통합할 수 있습니다.

vLLM은 Milvus와 같은 벡터 데이터베이스와 결합하면 고성능 RAG 시스템 구축의 초석이 됩니다. 벡터 데이터베이스는 상황에 맞는 정보를 검색하는 데 중요한 고차원 임베딩을 효율적으로 저장하고 검색합니다. vLLM은 최적화된 LLM 추론을 제공함으로써 이를 보완하여 검색된 정보를 정확한 상황 인식 응답으로 원활하게 처리할 수 있도록 합니다. 이러한 통합은 애플리케이션 성능을 향상시키고 검색된 데이터의 출력을 근거로 하여 AI 환각과 같은 문제를 해결합니다. 자세한 내용은 아래 리소스를 참조하세요.

Milvus, Qwen, vLLM으로 RAG 애플리케이션 구축하기](https://zilliz.com/blog/build-rag-app-with-milvus-qwen-and-vllm)

Milvus, vLLM, Meta의 Llama 3.1로 RAG 구축하기 ](https://zilliz.com/blog/building-rag-milvus-vllm-llama-3-1)

비정형: GenAI를 위한 비정형 데이터 접근성 확보하기

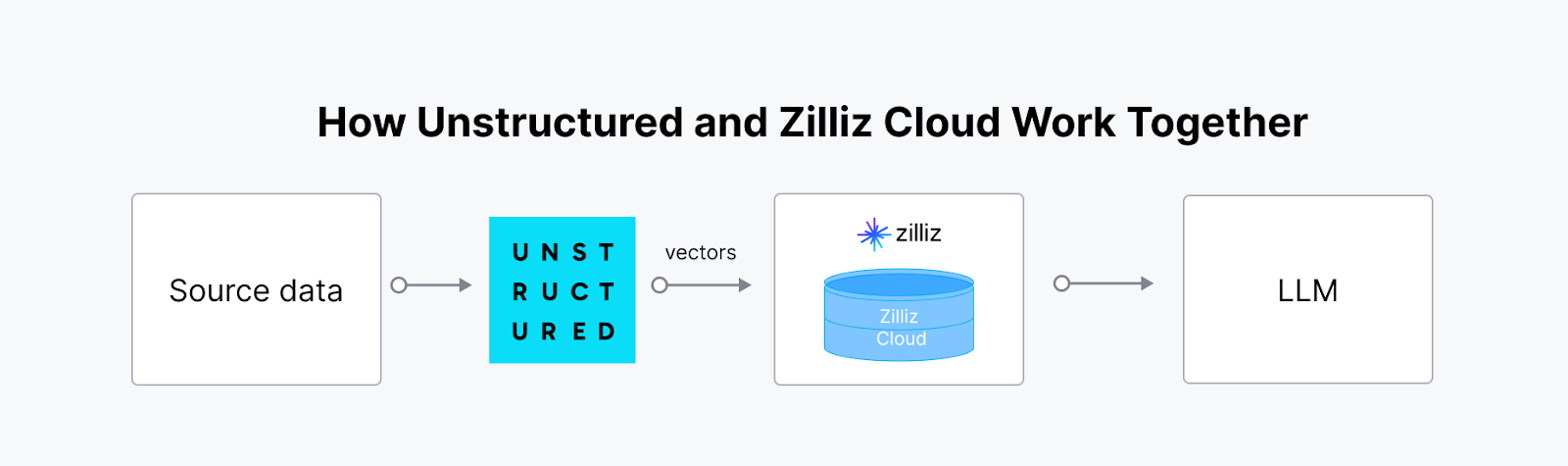

Unstructured는 PDF, HTML, Word 문서, 이미지 등 다양한 데이터 형식의 비정형 데이터 수집 및 전처리를 간소화하는 오픈 소스 라이브러리입니다. 이 라이브러리는 문서 분할, 정리, 추출, 스테이징, 청킹을 위한 모듈식 기능을 제공하여 비정형 데이터를 정형화된 형식으로 쉽게 변환할 수 있습니다. 이 툴킷은 LLM(대규모 언어 모델) 애플리케이션에서 데이터 워크플로우를 최적화하는 데 유용합니다.

Unstructured를 Milvus와 같은 벡터 데이터베이스와 통합하면 AI 애플리케이션에서 비정형 데이터를 관리하고 활용하기 위한 강력하고 확장 가능한 솔루션이 만들어집니다. Unstructured 플랫폼은 다양한 파일 형식의 비정형 데이터를 수집, 처리, 변환하여 AI에 적합한 벡터 임베딩으로 변환합니다. 이러한 임베딩은 고급 AI 워크플로우에 매우 중요하지만, 이를 효과적으로 저장, 색인 및 쿼리하려면 전문 벡터 데이터베이스가 필요합니다. 언스트럭처드와 밀버스(또는 질리즈 클라우드)의 시너지는 간소화된 엔드투엔드 파이프라인을 가능하게 하며, 이는 특히 검색 증강 세대(RAG) 및 스마트 챗봇과 개인화된 추천 시스템과 같은 기타 AI 기반 애플리케이션에 유용합니다.

비정형

비정형

튜토리얼 | Milvus 및 비정형을 사용한 RAG 구축

동영상 | 비정형용 Milvus 설정하기

Langfuse: LLM 애플리케이션을 위한 향상된 가시성 및 분석 기능

Langfuse는 팀이 LLM 애플리케이션을 공동으로 디버깅, 분석 및 반복할 수 있도록 지원하는 오픈 소스 LLM 엔지니어링 플랫폼입니다. 통합 가시성, 신속한 관리, 평가 및 메트릭과 같은 기능을 제공하며, 개발 워크플로우를 가속화하기 위해 기본적으로 통합되어 있습니다.

주요 기능

엔드투엔드 통합 가시성**: 프롬프트, 응답, 성능 메트릭을 포함한 LLM 상호 작용을 추적하여 투명성과 신뢰성을 보장합니다.

프롬프트 관리**: 프롬프트의 버전 관리, 최적화, 테스트를 위한 도구를 제공하여 강력한 AI 애플리케이션 개발을 간소화합니다.

유연한 통합**: LangChain, LlamaIndex 등 널리 사용되는 프레임워크와 원활하게 연동되어 광범위한 LLM 아키텍처를 지원합니다.

실시간 디버깅: 오류와 병목 현상에 대한 실행 가능한 인사이트를 제공하여 개발자가 빠르게 반복 작업을 수행할 수 있습니다.

Langfuse와 벡터 데이터베이스를 통합하면 임베딩 품질과 관련성에 대한 가시성을 제공하여 RAG 워크플로를 개선할 수 있습니다. 이러한 통합을 통해 개발자는 상세한 분석을 통해 벡터 검색 성능과 정확도를 모니터링하고 최적화하여 검색 프로세스를 세밀하게 조정하고 사용자 요구사항에 맞게 조정할 수 있습니다. 시작하려면 다음 튜토리얼을 확인하세요.

- Langfuse를 사용하여 RAG 품질 평가하기](https://milvus.io/docs/integrate_with_langfuse.md)

결론

2025년이 시작되면서 오픈 소스 프레임워크는 더 이상 유용한 부가 기능이 아니라 강력한 LLM 애플리케이션 구축의 기반이 되고 있음이 분명해졌습니다. LangChain과 LlamaIndex 같은 프레임워크는 데이터를 통합하고 쿼리하는 방식을 변화시켰으며, vLLM과 Haystack은 속도와 확장성에 대한 새로운 벤치마크를 설정하고 있습니다. Langfuse와 Letta와 같은 새로운 프레임워크는 통합 가시성과 메모리에서 고유한 강점을 제공하며, 더 스마트하고 반응성이 뛰어난 AI 시스템의 문을 열어줍니다.

이러한 프레임워크를 통해 개발자는 복잡한 문제를 해결하고, 대담한 아이디어를 실험하며, 가능성의 한계를 뛰어넘을 수 있습니다. 이러한 프레임워크를 손쉽게 사용할 수 있는 2025년은 더 스마트하고, 더 빠르고, 더 영향력 있는 GenAI 애플리케이션을 구축할 수 있는 해입니다.

계속 읽기

The AWS Outage Was a Wake-Up Call for Vector Database Cross-Region Disaster Recovery

Zilliz Cloud Had the Answer Before the Crisis. Zilliz Cloud is the world's first vector database with native cross-region disaster recovery.

Zilliz Cloud Introduces Advanced BYOC-I Solution for Ultimate Enterprise Data Sovereignty

Explore Zilliz Cloud BYOC-I, the solution that balances AI innovation with data control, enabling secure deployments in finance, healthcare, and education sectors.

Zilliz Cloud BYOC Upgrades: Bring Enterprise-Grade Security, Networking Isolation, and More

Discover how Zilliz Cloud BYOC brings enterprise-grade security, networking isolation, and infrastructure automation to vector database deployments in AWS