MLOps (Machine Learning Operations)

MLOps (Machine Learning Operations)

Da maschinelles Lernen (ML)-Modelle zunehmend in alltägliche Geschäftsprozesse integriert werden, stehen Unternehmen vor verschiedenen Herausforderungen, um die Genauigkeit und Relevanz ihrer Modelle in realen Umgebungen zu gewährleisten. Ein Hauptproblem ist die Datendrift - wenn sich die Daten, auf die sich die Modelle stützen, im Laufe der Zeit ändern, wodurch sie an Genauigkeit verlieren. Dies führt dazu, dass die Modelle kontinuierlich überwacht, neu trainiert und neu eingesetzt werden müssen, um sicherzustellen, dass ihre Vorhersagen weiterhin gültig sind.

Die Verwaltung dieser Modelle kann ohne die richtigen Systeme fehleranfällig, zeitaufwändig und teuer werden. MLOps (Machine Learning Operations) löst dieses Problem durch Automatisierung und Rationalisierung des gesamten Prozesses.

Wir wollen verstehen, wie MLOps den gesamten Lebenszyklus des maschinellen Lernens vereinfacht und automatisiert, von der Datenvorbereitung bis zur Modellbereitstellung und Überwachung.

Was ist MLOps?

Machine Learning Operations (MLOps) kombiniert maschinelles Lernen, DevOps und Data Engineering, um den Lebenszyklus des maschinellen Lernens zu rationalisieren. MLOps zielt darauf ab, ML-Modelle in Produktionsumgebungen in großem Umfang zuverlässig bereitzustellen und zu warten, von der Datenerfassung und Modellentwicklung bis hin zur Modellbereitstellung, Überwachung und Umschulung.

So wie DevOps Automatisierungs- und Integrationsverfahren für die Softwareentwicklung eingeführt hat, tut MLOps dasselbe für das maschinelle Lernen. Es wendet die Prinzipien von Continuous Integration (CI) und Continuous Deployment (CD) an und ermöglicht es Teams, Modelle schneller zu iterieren und gleichzeitig eine zuverlässige Überwachung und Leistung in Produktionsumgebungen sicherzustellen.

Wie funktioniert MLOps?

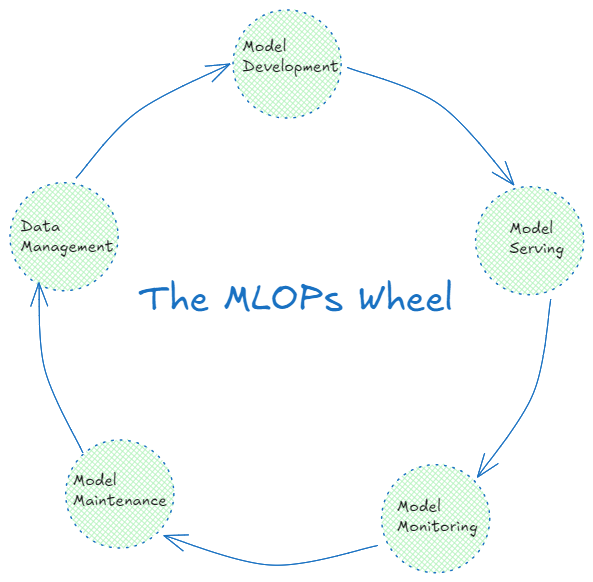

Der MLOps-Prozess umfasst mehrere Phasen, die zusammenarbeiten, um den gesamten Lebenszyklus des maschinellen Lernens zu rationalisieren. Diese sind:

Modellentwicklung

Bedienung des Modells

Modell Überwachung

Modellpflege

Datenverwaltung

Automatisierung

Abbildung- Mehrere Stufen im MLOps-Workflow.png

Abbildung- Mehrere Stufen im MLOps-Workflow.png

Abbildung: Mehrere Stufen im MLOps-Arbeitsablauf

Modellentwicklung

Der erste Schritt in MLOps ist die [Modellentwicklung] (https://zilliz.com/glossary/foundation-models), die die Grundlage jedes maschinellen Lernprojekts darstellt und mehrere wichtige Teilschritte umfasst:

Datenvorbereitung: Vor dem Training eines Modells müssen die Daten bereinigt und organisiert werden. Dazu gehören das Entfernen irrelevanter Informationen, das Auffüllen fehlender Werte, die Normalisierung der Daten und ihre Umwandlung in ein für ein ML-Modell geeignetes Format.

Feature-Engineering: Beim Feature-Engineering werden neue informative Merkmale erstellt oder vorhandene umgewandelt, um sie für das Modell nützlicher zu machen. So können Datenwissenschaftler beispielsweise neue Merkmale wie "Windgeschwindigkeit im Quadrat" oder "Temperaturgradienten" in einem Wettervorhersagemodell erstellen, um die Vorhersagegenauigkeit zu verbessern.

Modelltraining: Nach der Aufbereitung der Daten werden ML-Modelle trainiert. Datenwissenschaftler trainieren mehrere Modelle mit Algorithmen und Hyperparametern, um das leistungsstärkste Modell zu finden.

Modelltest: Sobald ein Modell trainiert ist, wird es an einem separaten Datensatz getestet, um sicherzustellen, dass es genaue Vorhersagen für neue, ungesehene Daten machen kann. Zur Bewertung der Leistung des trainierten ML-Modells werden auch verschiedene Bewertungsmetriken verwendet.

Model Serving

Sobald ein Modell entwickelt ist, muss es in einer Produktionsumgebung eingesetzt werden, damit es Vorhersagen in Echtzeit treffen kann:

Einsatz: Dies umfasst die Bereitstellung des Modells für Benutzer oder Anwendungen. Das Modell wird häufig über eine API bereitgestellt, um mit anderen Systemen zu interagieren. Bereitstellungslösungen wie Kubernetes und Docker helfen bei der Verwaltung dieses Prozesses, indem sie sicherstellen, dass die Modelle skalierbar und einfach zu warten sind.

Containerisierung: Modelle werden in Containern (wie Docker) isoliert, um Konsistenz zu gewährleisten. Container enthalten alle erforderlichen Komponenten - Code, Abhängigkeiten und Einstellungen -, damit das Modell in verschiedenen Umgebungen konsistent läuft.

Modell-Überwachung

Nach der Bereitstellung muss die Leistung des Modells kontinuierlich überwacht werden, um sicherzustellen, dass es genau und relevant bleibt:

Performance Tracking: Überwachungssysteme überwachen die Leistung des Modells. Wenn ein Modell beispielsweise anfängt, ungenaue Vorhersagen zu machen, könnte dies darauf hinweisen, dass sich die Daten, mit denen es arbeitet, im Laufe der Zeit verändert haben (Datendrift).

Protokollierung: Alle Modellaktivitäten werden protokolliert, um eine Aufzeichnung der Eingaben, Ausgaben und Fehler zu erhalten. Dies hilft bei der Fehlersuche und der Identifizierung von Mustern bei der Verwendung des Modells.

Modellpflege

Modelle für maschinelles Lernen müssen regelmäßig gewartet werden, damit sie weiterhin gut funktionieren:

Aktualisierung und Umschulung: MLOps erleichtert die Aktualisierung und Umschulung von Modellen, wenn neue Daten verfügbar werden oder die Leistung nachlässt. Durch regelmäßiges Neutraining wird sichergestellt, dass die Modelle aktuell und genau bleiben und sich an veränderte Datenmuster anpassen. MLOps automatisiert diesen Prozess und macht ihn effizient und weniger fehleranfällig.

Versionierung: Um den Überblick über verschiedene Versionen von Modellen zu behalten, verwendet MLOps Versionierungssysteme wie GitHub, MLflow und DVC. Diese Systeme zeichnen jede Version eines Modells auf, zusammen mit den Daten und dem Code, die zur Erstellung des Modells verwendet wurden.

Datenmanagement

Daten sind das Rückgrat eines jeden maschinellen Lernsystems, und ihre effektive Verwaltung ist ein wesentlicher Bestandteil von MLOps:

Dateneingabe und -speicherung: MLOps verwaltet den Datenfluss aus verschiedenen Quellen in die ML-Pipeline und speichert die Daten in skalierbaren Cloud-Speichern wie [Zilliz Cloud] (https://zilliz.com/cloud) und [Milvus] (https://milvus.io/).

Data Governance: MLOps gewährleistet Datenqualität, Sicherheit und die Einhaltung von Vorschriften. Es stellt auch sicher, dass nur befugte Personen auf die Daten zugreifen können und dass die Datenschutzgesetze eingehalten werden.

Automatisierung

Eines der Hauptziele von MLOps besteht darin, sich wiederholende Aufgaben zu automatisieren und so die Verwaltung von Modellen für maschinelles Lernen im Laufe der Zeit zu erleichtern:

Workflow-Orchestrierung: Automatisierungstools können viele Schritte in der ML-Pipeline übernehmen, von der Datenverarbeitung bis zum Modelltraining und der Bereitstellung. Dadurch wird der Bedarf an manuellen Eingriffen reduziert und die Konsistenz bei der Erstellung und Bereitstellung von Modellen gewahrt.

Continuous Integration/Continuous Deployment (CI/CD): CI/CD-Pipelines helfen Teams bei der kontinuierlichen Erstellung, Prüfung und Bereitstellung von Modellen in einem rationalisierten und automatisierten Ansatz. Mit CI/CD können Modelle schnell aktualisiert, getestet und mit minimaler Verzögerung in Produktion gegeben werden.

Vergleich: MLOps vs. DevOps vs. LLMOps

Die Begriffe [MLOps] (https://zilliz.com/blog/Operationalize-AI-at-Scale-with-Software-MLOps-and-Milvus), [DevOps] (https://zilliz.com/glossary/devops) und [LLMOps] (https://zilliz.com/blog/get-started-with-llmops-build-better-ai-applications) scheinen sich zu ähneln; jedes Verfahren konzentriert sich auf die Verbesserung von Entwicklungsabläufen, aber sie gehen unterschiedliche Herausforderungen an und bieten einzigartige Lösungen im Bereich der Softwareentwicklung und KI.

| Aspect | DevOps | MLOps | LLMOps | |

| Definition | Eine Reihe von Praktiken zur Automatisierung der Softwareentwicklung und des IT-Betriebs. | Erweitert die DevOps-Prinzipien, um den Lebenszyklus von ML-Modellen zu automatisieren. | Konzentriert sich auf die Verwaltung des Lebenszyklus von großen Sprachmodellen (LLMs). | |

| Fokus | Automatisierung von Software Delivery Pipelines (CI/CD), Verbesserung der Zusammenarbeit und Verkürzung des Entwicklungslebenszyklus. | Automatisierung von ML-Workflows von der Datenaufbereitung bis zur Modellbereitstellung und -überwachung. | Optimierung des Einsatzes, der Feinabstimmung und der Verwaltung von LLMs in der Produktion. | |

| Haupttools | - GitLab für CI/CD.- Grafana für die Überwachung.- Docker und Kubernetes für die Container-Orchestrierung. | - Kubeflow und Apache Airflow werden für die Workflow-Automatisierung verwendet.- Scikit-learn und TensorFlow für das Modelltraining. | - Hugging Face Transformers für die Feinabstimmung.- Groß angelegte Inferenz-Tools (Ray Serve, ONNX). | |

| Anwendungsfälle | - Schnelle Bereitstellung von Software-Updates - Verwaltung verteilter Systeme | - Kontinuierliche Überwachung der Modellleistung in der Produktion | - Automatisierte Umschulung und erneute Bereitstellung von ML-Modellen. | Einsatz großer Sprachmodelle für NLP - Feinabstimmung von Modellen für spezielle Bereiche. |

MLOps Metriken

Bei MLOps sind Metriken der Schlüssel zur Messung der Modellleistung und der gesamten ML-Pipeline. Die KPIs in MLOps gehen über die traditionellen ML-Modellmetriken hinaus und umfassen den gesamten Lebenszyklus. Modellgenauigkeit, Präzision, Recall und F1-Score sind nach wie vor grundlegend, aber MLOps führt neue Kennzahlen ein. Die Einsatzhäufigkeit misst, wie oft neue Modelle oder Updates in der Produktion eingesetzt werden und wie agil die ML-Pipeline ist. Die mittlere Wiederherstellungszeit (Mean Time to Recovery, MTTR) misst, wie schnell Probleme in Produktionsmodellen erkannt und behoben werden. Metriken zur Ressourcennutzung messen die Berechnungseffizienz, die für das Kostenmanagement in der Cloud wichtig ist. Metriken zur Daten- und Modelldrift messen, wie gut die Modelle im Laufe der Zeit funktionieren, wenn sich die Eingabedaten ändern. Inferenzlatenz und -durchsatz sind entscheidend für Echtzeitanwendungen und messen die Reaktionszeit und Verarbeitungskapazität. Die Metriken für A/B-Tests vergleichen die Leistung neuer Modelle mit der Leistung bestehender Modelle in der Produktion. Der Automatisierungsgrad der Pipeline misst den Grad des erforderlichen menschlichen Eingriffs; ein höherer Grad ist besser für ausgereifte MLOps. Schließlich stellen die Metriken zur Modellversionierung und Reproduzierbarkeit sicher, dass Experimente und Implementierungen nachverfolgt und repliziert werden können. Diese Metriken geben Ihnen einen vollständigen Überblick über MLOps, sodass Sie Ihre ML-Prozesse und -Ergebnisse kontinuierlich verbessern können.

Vorteile und Herausforderungen von MLOps

MLOps bietet zahlreiche Vorteile, die die Effizienz und Effektivität des maschinellen Lernens verbessern, birgt aber auch einige Herausforderungen, die Unternehmen meistern müssen. Das Verständnis der Vorteile und Herausforderungen ist entscheidend für die erfolgreiche Implementierung von MLOps-Verfahren und die Erzielung optimaler Ergebnisse.

MLOps Vorteile

Automatisierte Pipelines: Reduziert manuelle Eingriffe, sodass sich Datenwissenschaftler und Ingenieure auf ihre Kernaufgaben konzentrieren können.

Schnellere Markteinführung: Optimierte Workflows und Automatisierung ermöglichen schnellere Modell-Iterationen und Release-Zyklen.

Verbesserte Leistung: Durch die kontinuierliche Überwachung und die Umschulungszyklen werden robuste Modelle erstellt, die in dynamischen, realen Szenarien gut funktionieren.

Skalierbarkeit: MLOps-Frameworks ermöglichen den Einsatz und die Verwaltung von Tausenden von Modellen in verschiedenen Umgebungen.

Kontinuierliche Verbesserung: Modelle werden kontinuierlich überwacht und neu trainiert. Dadurch wird sichergestellt, dass sie sich an neue Daten und veränderte Bedingungen anpassen und eine hohe Leistung beibehalten.

MLOps Herausforderungen

Komplexität: Die Implementierung von MLOps erfordert die Einrichtung einer komplexen Infrastruktur und von Arbeitsabläufen, die ressourcenintensiv sind.

Tool-Integration: Die Integration verschiedener Tools für Datenmanagement, Modellschulung, Bereitstellung und Überwachung ist eine Herausforderung.

Modellversionierung und Reproduzierbarkeit: Es kann schwierig sein, den Überblick zu behalten und all die verschiedenen Versionen von Modellen für maschinelles Lernen und die damit verbundenen Abhängigkeiten und Einstellungen zu verwalten. Ein weiteres Problem kann die Reproduktion und Validierung von Ergebnissen in verschiedenen Umgebungen sein.

Kosten: Während MLOps langfristig die Effizienz und Skalierbarkeit verbessern kann, können die anfänglichen Kosten für die Einrichtung eines MLOps-Frameworks hoch sein. Unternehmen müssen in die richtigen Tools, Infrastrukturen und Talente investieren, um den Erfolg ihrer MLOps-Initiativen sicherzustellen.

Zusammenarbeit: MLOps führt gemeinsame Prozesse und Tools ein und fördert die effektive Zusammenarbeit zwischen Dateningenieuren, Wissenschaftlern, Entwicklern und IT-Ingenieuren, was nach wie vor eine große Herausforderung darstellt.

Werkzeuge und Technologien in MLOps

MLOps ist auf verschiedene Tools und Technologien angewiesen, um den Lebenszyklus des maschinellen Lernens zu verwalten. Im Folgenden finden Sie einige der am häufigsten verwendeten MLOps-Tools:

MLflow: Eine Open-Source-Plattform zur Verwaltung des gesamten Lebenszyklus des maschinellen Lernens, einschließlich der Verfolgung von Experimenten, der Modellversionierung und der Bereitstellung.

DVC (Data Version Control):** Ein Open-Source-Versionskontrollsystem für das Datenmanagement, die Automatisierung von ML-Pipelines und die Verwaltung von Experimenten.

Kubeflow: Eine Kubernetes-basierte Plattform für die Bereitstellung, Skalierung und Verwaltung von Modellen für maschinelles Lernen in Produktionsumgebungen.

Apache Airflow: Ein Tool zur Workflow-Automatisierung, das die Verwaltung von Datenpipelines und die Planung von Aufgaben für die Dateneingabe und das Modelltraining unterstützt.

TensorFlow Extended (TFX): Eine End-to-End-Plattform für den Einsatz von Produktionspipelines für maschinelles Lernen mit TensorFlow. [TFX (https://www.tensorflow.org/tfx) bietet Tools für die Datenvalidierung, Modellbereitstellung und kontinuierliches Training.

Vektordatenbanken (Milvus, Zilliz Cloud): In vielen MLOps-Szenarien ist der Umgang mit unstrukturierten Daten wie Bildern, Text oder Audio entscheidend. Hier können Vektordatenbanken hilfreich sein. Sie sind auf die Speicherung und Abfrage von Vektoreinbettungen und numerischen Darstellungen solcher Daten spezialisiert. Milvus ist eine Open-Source-Vektordatenbank, die sich durch die Handhabung großer Datensätze und komplexer Abfragen auszeichnet.

MLOps Trends

Die MLOps-Landschaft verändert sich schnell, und es zeichnen sich einige spannende Trends ab. AutoML (Automated Machine Learning) ist auf dem Vormarsch und automatisiert das Feature-Engineering und die Abstimmung der Hyperparameter. Edge ML wird immer wichtiger; Modelle können auf Edge-Geräten ausgeführt werden, was die Latenzzeit verringert und den Datenschutz erhöht. Föderiertes Lernen ist im Kommen, um Modelle auf dezentralen Geräten zu trainieren und gleichzeitig die Daten geheim zu halten. XAI-Tools (Explainable AI) werden zu MLOps-Pipelines hinzugefügt, um dem wachsenden Bedarf an Modellinterpretierbarkeit und Transparenz gerecht zu werden. Der Schwerpunkt liegt zunehmend auf ML-spezifischen Überwachungstools, die subtile Modellverschlechterungen und Datendrift in Echtzeit erkennen können. LLMs (Large Language Models) werden zu MLOps-Workflows hinzugefügt, um fortgeschrittenere NLP-Aufgaben zu erledigen. Da das Thema Nachhaltigkeit immer wichtiger wird, entstehen grüne MLOps, um die Ressourcennutzung zu optimieren und den CO2-Fußabdruck von ML zu verringern. Diese Trends deuten auf eine Zukunft hin, in der MLOps automatisierter, effizienter, interpretierbar und umweltfreundlicher sein werden.

FAQs über MLOps

- Wofür werden MLOps verwendet?

Machine Learning Operations (MLOps) sind eine Sammlung von Praktiken zur Rationalisierung und Automatisierung der Arbeitsabläufe und Bereitstellungsprozesse von Modellen für maschinelles Lernen (ML). Durch die Einbeziehung von maschinellem Lernen und künstlicher Intelligenz (KI) können Unternehmen komplexe reale Herausforderungen bewältigen und wertvolle Kundenlösungen schaffen.

- Was ist MLOps im Vergleich zu DevOps?

MLOps ist eine datenwissenschaftliche Praxis, die sich auf das schnelle Testen und Bereitstellen von Modellen für maschinelles Lernen konzentriert. DevOps hingegen integriert die Entwicklung und den IT-Betrieb, um die Effizienz, Zuverlässigkeit und Sicherheit der Softwareentwicklung zu verbessern.

- Was ist der Unterschied zwischen MLOps und AIOPs?

AIOps ermöglicht es IT-Betriebs- und Data-Science-Teams, ein vorausschauendes Alarmmanagement zu implementieren, die Datensicherheit zu verbessern und DevOps-Workflows zu unterstützen. MLOps-Lösungen helfen Unternehmen, die Bereitstellung von Machine-Learning-Modellen zu beschleunigen, die Zusammenarbeit zwischen Data-Science- und Operations-Teams zu verbessern und KI-Bemühungen unternehmensweit zu skalieren.

- Ist MLOps gefragt?

In dem Maße, in dem Unternehmen datengesteuerte Lösungen einführen, steigt die Nachfrage nach MLOps-Fachleuten, die maschinelle Lernmodelle effizient bereitstellen und verwalten können, rapide an.

- Welche Sprache ist für MLOps am besten geeignet?

Python ist derzeit die erste Wahl für maschinelles Lernen und MLOps. Seine Beliebtheit rührt von dem umfangreichen Angebot an Tools und Bibliotheken für maschinelles Lernen her, wie z. B. NumPy, TensorFlow, Keras und PyTorch. Diese Bibliotheken erleichtern die Erstellung von Machine-Learning-Modellen und die Bewältigung von Data-Engineering-Aufgaben und vereinfachen so den gesamten Prozess von Machine-Learning-Projekten und MLOps.

Verwandte Ressourcen

Erste Schritte mit Zilliz Cloud](https://zilliz.com/cloud)

Milvus-Dokumentation - Offizielle Dokumentation für Milvus](https://milvus.io/docs/quickstart.md)

MLOps: Best Practices - Ein detaillierter Leitfaden zu den besten Praktiken von MLOps](https://zilliz.com/blog/get-started-with-llmops-build-better-ai-applications)

Erste Schritte mit LLMOps: Aufbau besserer KI-Anwendungen](https://zilliz.com/blog/get-started-with-llmops-build-better-ai-applications)

LLM-Eval: Ein rationalisierter Ansatz zur Auswertung von LLM-Gesprächen](https://zilliz.com/learn/streamlined-approach-to-evaluating-llm-conversations)

- Was ist MLOps?

- Wie funktioniert MLOps?

- Vergleich: MLOps vs. DevOps vs. LLMOps

- MLOps Metriken

- Vorteile und Herausforderungen von MLOps

- Werkzeuge und Technologien in MLOps

- MLOps Trends

- FAQs über MLOps

- Verwandte Ressourcen

Inhalte

Kostenlos starten, einfach skalieren

Testen Sie die vollständig verwaltete Vektordatenbank, die für Ihre GenAI-Anwendungen entwickelt wurde.

Zilliz Cloud kostenlos ausprobieren