Retrieval Augmented Generation (RAG)

Einschränkungen von LLMs

Fehlende domänenspezifische Informationen

LLMs werden nur mit öffentlich verfügbaren Daten trainiert. Daher fehlt ihnen möglicherweise Wissen über domänenspezifische, proprietäre oder private Informationen, die nicht öffentlich zugänglich sind.

Anfällig für Halluzinationen

LLMs können nur Antworten auf der Grundlage der ihnen zur Verfügung stehenden Informationen geben. Sie können falsche oder erfundene Informationen liefern, wenn sie nicht genügend Daten zur Referenz haben.

Kostenintensiv und langsam

LLMs berechnen Gebühren für jedes Token in Abfragen, was zu hohen Kosten führt, insbesondere bei wiederholten Fragen. Darüber hinaus frustrieren Verzögerungen bei der Antwort während der Spitzenzeiten Benutzer, die schnelle Antworten suchen.

Kein Zugriff auf aktuelle Informationen

LLMs werden oft mit veralteten Daten trainiert und aktualisieren ihre Wissensbasis aufgrund hoher Trainingskosten nicht regelmäßig. Zum Beispiel kann das Training von GPT-3 bis zu 1,4 Millionen Dollar kosten.

Token-Limit

LLMs setzen eine Grenze für die Anzahl der Token, die zu Abfrage-Prompts hinzugefügt werden können. Zum Beispiel hat ChatGPT-3 ein Limit von 4.096 Token, während GPT-4 (8K) ein Token-Limit von 8.192 hat.

Unveränderliche Vortrainingsdaten

Die Vortrainingsdaten von LLMs können veraltete oder falsche Informationen enthalten. Leider können solche Daten nicht geändert, korrigiert oder entfernt werden.

Wie Zilliz Cloud LLM-Anwendungen verbessert

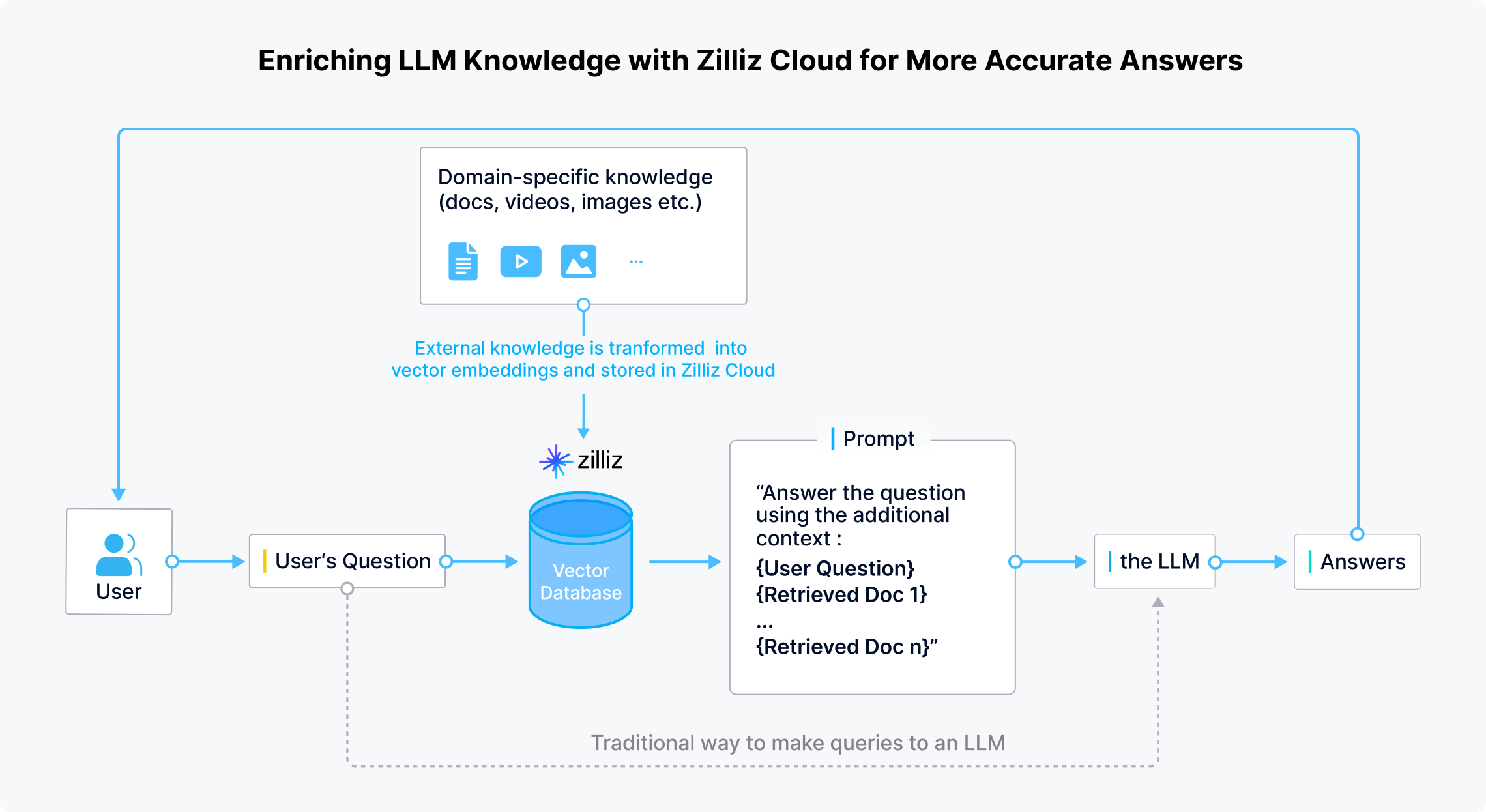

RAG für LLMs: Aktualisierung und Erweiterung der Wissensbasis von LLMs für genauere Antworten

Zilliz Cloud ermöglicht Entwicklern und Unternehmen, domänenspezifische, aktuelle und vertrauliche private Daten sicher außerhalb von LLMs zu speichern. Wenn ein Benutzer eine Frage stellt, verwenden LLM-Anwendungen Embedding-Modelle, um die Frage in Vektoren umzuwandeln. Zilliz Cloud führt dann Ähnlichkeitssuchen durch, um die Top-K-Ergebnisse bereitzustellen, die für diese Frage relevant sind. Schließlich werden diese Ergebnisse mit der ursprünglichen Frage kombiniert, um einen Prompt zu erstellen, der einen umfassenden Kontext für das LLM bietet, um genauere Antworten zu generieren.

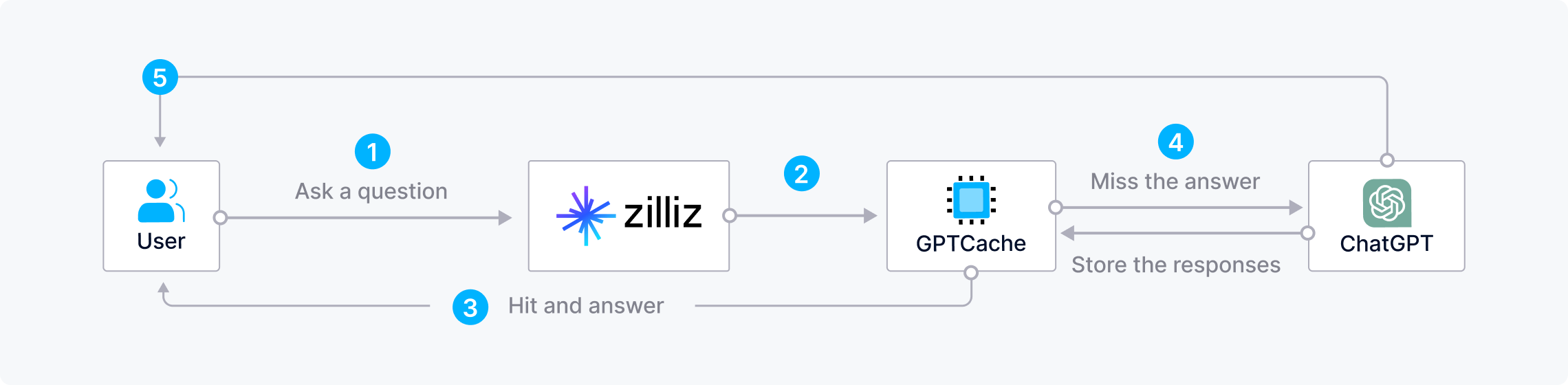

Zeit- und Kostenersparnis durch Kombination von Zilliz Cloud mit GPTCache

Häufiges Stellen wiederholter oder ähnlicher Fragen an LLMs kann kostspielig, ressourcenintensiv und zeitaufwändig sein, insbesondere während der Spitzenzeiten, wenn die Antworten langsam sind. Um Zeit und Geld beim Erstellen von KI-Anwendungen zu sparen, können Entwickler Zilliz Cloud mit GPTCache nutzen, einem Open-Source-Semantic-Cache, der LLM-Antworten speichert. Mit dieser Architektur überprüft Zilliz zunächst GPTCache auf Antworten, wenn ein Benutzer eine Frage stellt. Wenn eine Antwort gefunden wird, gibt Zilliz Cloud diese schnell an den Benutzer zurück. Andernfalls sendet Zilliz Cloud die Abfrage an das LLM für eine Antwort und speichert sie in GPTCache für die zukünftige Verwendung.

Der CVP-Stack

ChatGPT/LLMs + eine Vektordatenbank + Prompt-as-Code

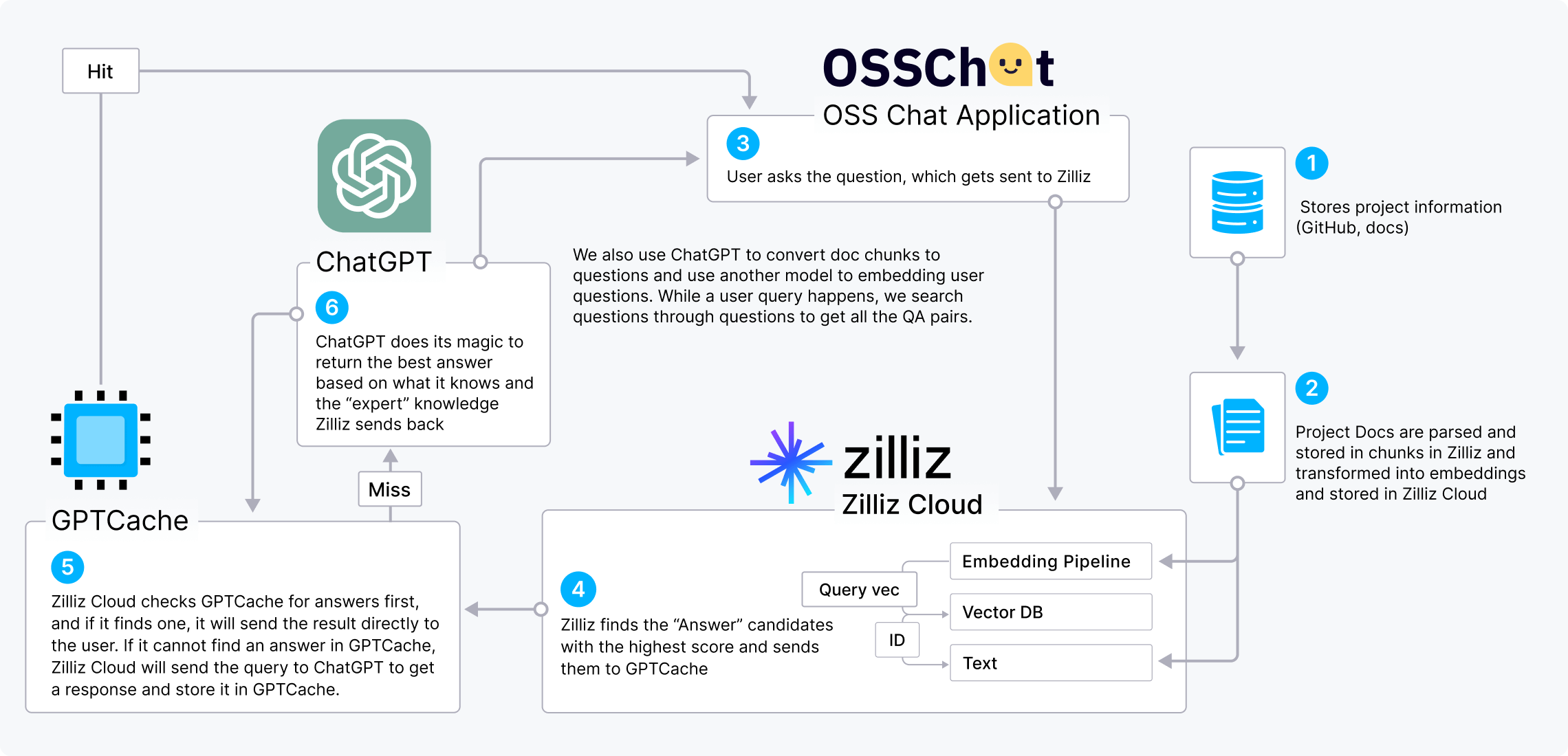

Der CVP-Stack (ChatGPT/LLMs + eine Vektordatenbank + Prompt-as-Code) ist ein zunehmend beliebter KI-Stack, der den Wert von Vektordatenbanken für die LLM-Erweiterung zeigt. Wir können OSS Chat als Beispiel verwenden, um zu demonstrieren, wie der CVP-Stack funktioniert.

OSS Chat ist ein Chatbot, der Fragen zu GitHub-Projekten beantworten kann. Er sammelt und speichert Informationen aus verschiedenen GitHub-Repositories und deren Dokumentationsseiten in Form von Embeddings in Zilliz Cloud. Wenn ein Benutzer OSS Chat nach einem Open-Source-Projekt fragt, führt Zilliz Cloud eine Ähnlichkeitssuche durch, um die topk relevantesten Ergebnisse zu finden. Diese Ergebnisse werden dann mit der ursprünglichen Frage kombiniert, um einen Prompt zu erstellen, der ChatGPT einen breiteren Kontext bietet, was zu genaueren Antworten führt.

Wir können auch GPTCache in den CVP-Stack integrieren, um Kosten zu reduzieren und Antworten zu beschleunigen.

LLM-Projekte, die Milvus & Zilliz Cloud nutzen

Erfahren Sie, wie Entwickler Milvus & Zilliz Cloud nutzen, um ihre generativen KI-Anwendungen zu stärken.

- OSS Chat

- PaperGPT

- NoticeAI

- Search.anything.io

- IkuStudies

- AssistLink AI

Milvus-Integrationen mit beliebten KI-Projekten

OpenAI, LangChain, LlamaIndex und viele andere KI-Pioniere integrieren sich mit Zilliz Cloud, um ihre Retrieval-Fähigkeiten zu erweitern.