Agacer ou fâcher : Choisir le bon outil pour la recherche vectorielle

Dans le monde actuel de l'IA, une recherche vectorielle efficace est essentielle pour les applications qui impliquent des données de haute dimension, telles que le traitement du langage naturel (NLP), la recherche sémantique ou la recherche d'images. Deux puissants outils de recherche vectorielle, Annoy et Faiss, sont populaires dans cet espace, mais le choix entre eux peut s'avérer difficile. Ils offrent tous deux des fonctionnalités intéressantes, mais leurs points forts et leurs cas d'utilisation diffèrent considérablement. Dans ce blog, nous allons explorer ce que chaque technologie offre et vous aider à décider laquelle est la mieux adaptée à vos besoins.

Qu'est-ce que la recherche vectorielle ?

Avant de plonger dans la comparaison, il est utile de clarifier ce qu'est la recherche vectorielle. La recherche vectorielle, ou recherche de similarité vectorielle, consiste à trouver les éléments les plus similaires dans un ensemble de données, représentés sous forme de vecteurs à haute dimension. Ces vecteurs sont souvent générés par des modèles d'apprentissage automatique pour capturer l'essence des données non structurées (par exemple, le sens d'une phrase ou les caractéristiques d'une image).

Contrairement aux bases de données traditionnelles, où les recherches sont basées sur les correspondances exactes ou le filtrage, la recherche vectorielle se concentre sur la similarité. L'objectif est de trouver des vecteurs qui sont "proches" les uns des autres sur la base d'une métrique de distance (telle que la distance euclidienne ou la similarité cosinus). Les recherches vectorielles sont largement adoptées dans de nombreux cas d'utilisation et applications, tels que la recommandation de production, le traitement du langage naturel (NLP), la recherche de similarité d'images et la génération augmentée de recherche (RAG).

De nombreuses solutions sont disponibles sur le marché pour effectuer des recherches vectorielles, notamment :

- Bibliothèques de recherche vectorielle telles que Faiss et Annoy.

- Les bases de données vectorielles spécialisées** telles que Milvus, Zilliz Cloud (Milvus entièrement géré).

- Bases de données vectorielles légères** telles que Chroma et Milvus Lite.

- Bases de données traditionnelles avec des modules complémentaires de recherche vectorielle

Annoy : Vitesse et simplicité pour les données statiques

Annoy](https://zilliz.com/learn/approximate-nearest-neighbor-oh-yeah-ANNOY) (Approximate Nearest Neighbors Oh Yeah) est une bibliothèque open-source développée par Spotify qui est conçue pour une recherche efficace des plus proches voisins (ANN) dans des espaces de haute dimension. Sa fonction principale est de trouver rapidement des éléments qui sont similaires à un élément de requête donné, en se basant sur les vecteurs intégrés (vector embeddings). Annoy est particulièrement utile lorsqu'il s'agit de travailler avec de grands ensembles de données où les correspondances exactes ne sont pas aussi importantes que la recherche rapide de résultats "suffisamment proches". Basé sur les préférences de l'utilisateur, il est souvent utilisé pour construire des moteurs de recommandation qui suggèrent des éléments similaires (comme des chansons, des produits ou des vidéos).

Caractéristiques principales de Annoy :

- Recherche approximative des plus proches voisins : Annoy utilise une méthode basée sur des arbres de projection aléatoires, qui permet une recherche rapide mais qui sacrifie une partie de la précision à la vitesse. Cette méthode convient aux applications où la vitesse est essentielle et où des résultats exacts ne sont pas nécessaires.

- Efficacité de la mémoire : Annoy est optimisé pour travailler efficacement avec la mémoire. Il vous permet de construire l'index en mémoire et de le stocker sur le disque, ce qui permet de traiter de grands ensembles de données même si vous n'avez pas assez de RAM. Cette fonctionnalité est particulièrement utile si la mémoire de votre système est une contrainte.

- Index immuables : Une fois qu'un index est construit dans Annoy, il ne peut pas être modifié. Si le jeu de données change, vous devrez reconstruire l'index entier. Cela en fait un bon choix pour les ensembles de données statiques, où les données ne changent pas fréquemment.

- Stockage sur disque : Annoy peut stocker les index sur le disque, ce qui signifie que vous pouvez interroger de grands ensembles de données sans tout garder en mémoire, ce qui est utile lorsque vous traitez de très grandes données.

- Support linguistique : Annoy est principalement utilisé en Python mais est écrit en C++ pour des raisons de performance.

**Annoy est largement plébiscité pour sa simplicité, sa rapidité et sa facilité d'utilisation, en particulier pour les développeurs qui ont besoin d'un outil de recherche de données statiques rapide.

Faiss : Puissance et flexibilité pour l'IA à grande échelle

Faiss](https://zilliz.com/learn/faiss) (Facebook AI Similarity Search) est une bibliothèque open-source développée par Meta (anciennement Facebook) qui fournit des outils très efficaces pour la recherche rapide de similarités et le regroupement de vecteurs denses. Faiss est conçu pour la recherche du plus proche voisin à grande échelle et peut gérer des recherches approximatives et exactes dans des espaces vectoriels de haute dimension. Faiss est conçu pour traiter d'énormes ensembles de données et se distingue par sa capacité à tirer parti de l'accélération GPU, ce qui permet d'améliorer considérablement les performances des applications à grande échelle. Il est particulièrement adapté aux applications d'IA et d'apprentissage automatique.

Caractéristiques principales de Faiss :

- Recherche approximative et exacte de K-voisins les plus proches (ANN & KNN) : Faiss supporte à la fois les recherches approximatives et exactes du plus proche voisin (NN). Cela vous permet de choisir entre la vitesse et la précision en fonction des besoins spécifiques de votre application.

- Accélération GPU** : L'une des caractéristiques les plus remarquables de Faiss est sa prise en charge de l'accélération GPU. Cela lui permet de s'adapter efficacement aux grands ensembles de données et d'effectuer des recherches plus rapidement que les méthodes basées uniquement sur le CPU.

- Traitement des grands ensembles de données** : Faiss est optimisé pour traiter les ensembles de données trop volumineux pour être stockés en mémoire. Il utilise diverses techniques d'indexation, telles que les [fichiers inversés] (https://zilliz.com/learn/vector-index) et le clustering, pour organiser efficacement les données et effectuer des recherches sur d'énormes collections.

- Stratégies d'indexation multiples** : Faiss prend en charge diverses méthodes d'indexation des vecteurs, telles que l'indexation plate (brute-force), la quantification de produit et le regroupement hiérarchique. Cela permet une certaine flexibilité dans la manière dont les recherches sont effectuées, selon que la vitesse ou la précision est plus importante.

- Support pour les systèmes distribués : Faiss peut effectuer des recherches sur plusieurs machines dans des systèmes distribués, ce qui le rend évolutif pour les applications d'entreprise.

- Intégration avec les frameworks d'apprentissage automatique** : Faiss s'intègre bien avec d'autres cadres d'apprentissage automatique, tels que [PyTorch] (https://zilliz.com/product/integrations/pytorch) et TensorFlow, ce qui facilite son intégration dans les flux de travail d'IA.

Comparaison entre Annoy et Faiss

Pour choisir entre Annoy et Faiss, plusieurs facteurs clés doivent être pris en compte, notamment les méthodologies de recherche, le traitement des données, les performances et l'évolutivité.

Annoy utilise des arbres de projection aléatoires pour la recherche approximative du plus proche voisin. L'accent mis sur la vitesse et l'efficacité de la mémoire en fait un outil idéal pour les charges de travail lourdes en lecture, en particulier lorsque les données sont statiques. Cependant, cette priorité accordée à la vitesse se fait au détriment de la flexibilité. L'index étant immuable, il n'est pas idéal pour les applications nécessitant des mises à jour fréquentes. En revanche, Faiss utilise un éventail plus large d'algorithmes de recherche, allant de la simple recherche du plus proche voisin (k-nearest neighbor) à des techniques de clustering plus complexes. Cette flexibilité vous permet d'ajuster le compromis entre la vitesse et la précision, et est particulièrement utile dans les environnements où l'ensemble des données est en constante évolution.

Faiss est également plus performant qu'Annoy dans la gestion des ensembles de données dynamiques. Alors qu'Annoy nécessite une reconstruction complète de l'index chaque fois que les données changent, Faiss peut mettre à jour ses index de manière incrémentale. Cette caractéristique et son accélération GPU donnent à Faiss un avantage dans les applications à grande échelle et en temps réel où la vitesse et la flexibilité sont essentielles.

Les deux outils sont performants en termes d'évolutivité, mais de manière différente. Annoy est optimisé pour l'efficacité de la mémoire et peut gérer efficacement de grands ensembles de données lorsqu'ils sont stockés sur disque. Cependant, son manque de support pour le calcul distribué ou l'accélération GPU limite sa capacité à s'adapter à des ensembles de données vraiment massifs. En revanche, Faiss a été conçu dans une optique d'évolutivité. Sa prise en charge des GPU et son architecture distribuée en font la meilleure option pour les systèmes d'apprentissage automatique à grande échelle où les performances sont essentielles.

Quand choisir Annoy

Les atouts d'Annoy résident dans sa simplicité et son efficacité. C'est l'outil idéal pour effectuer des recherches rapides et approximatives sur un vaste ensemble de données qui ne changent pas souvent. Son immuabilité le rend idéal pour des applications telles que les moteurs de recommandation, où les données restent essentiellement statiques et où le besoin de mises à jour en temps réel est minime.

Si vous travaillez sur un projet où la rapidité est plus importante que la précision parfaite, et que vous souhaitez un outil facile à configurer et peu gourmand en mémoire, Annoy est un bon choix. Il convient également aux applications fonctionnant dans des environnements à mémoire limitée, car un fonctionnement efficace ne nécessite pas d'énormes quantités de RAM.

Quand choisir Faiss

Faiss offre beaucoup plus de puissance et de flexibilité qu'Annoy, en particulier pour les applications qui nécessitent une grande évolutivité, des mises à jour en temps réel ou un équilibre entre vitesse et précision. Si votre cas d'utilisation implique des systèmes accélérés par le GPU ou si vous avez affaire à des ensembles de données massifs qui dépassent la mémoire disponible, Faiss est le gagnant incontestable. Sa capacité à gérer des recherches exactes et approximatives, ainsi que ses multiples options d'indexation, en font un outil polyvalent adapté à des besoins spécifiques.

Faiss est le bon choix si vous développez des applications telles que des systèmes de recherche d'images, des tâches NLP à grande échelle, ou tout autre projet nécessitant des requêtes en temps réel de haute performance. Bien que la courbe d'apprentissage soit plus raide que celle d'Annoy, la complexité accrue s'accompagne d'avantages significatifs en termes de personnalisation, d'évolutivité et de rapidité.

Comparaison entre les bibliothèques de recherche vectorielle et les bases de données vectorielles spécifiques

Les bibliothèques de recherche vectorielle comme Annoy et Faiss et les bases de données vectorielles spécifiques comme Milvus visent toutes deux à résoudre le problème de la recherche de similarité pour les données vectorielles de haute dimension, mais elles sont conçues avec des objectifs différents. Voici un aperçu des principales différences entre ces deux types de bases de données.

Champ d'application et objectif

- Bibliothèques de recherche vectorielle (Annoy, Faiss, ScaNN et HNSWlib)** : Il s'agit de bibliothèques légères conçues pour être intégrées dans des applications spécifiques afin d'effectuer des recherches sur les plus proches voisins. Elles se concentrent uniquement sur les algorithmes de recherche et exigent généralement du développeur qu'il gère tous les autres aspects, tels que le stockage des données, l'évolutivité et l'infrastructure.

- Les bases de données vectorielles conçues à cet effet, comme Milvus et Zilliz Cloud, sont des systèmes à part entière conçus spécifiquement pour la gestion et la recherche de données vectorielles. Elles offrent une solution plus complète, comprenant le stockage des données, la mise à l'échelle, l'indexation, la réplication et la gestion des requêtes. Ces systèmes sont conçus pour gérer des environnements de production à grande échelle où la recherche vectorielle est au cœur de l'infrastructure.

Feature Set

- Bibliothèques de recherche vectorielle** : Ces bibliothèques se limitent à effectuer des recherches rapides et efficaces sur les plus proches voisins. Elles se concentrent sur l'indexation des vecteurs et la fourniture de fonctionnalités de recherche, mais n'incluent pas de fonctionnalités telles que la persistance des données, les sauvegardes ou la surveillance. Si vous avez besoin de mettre à jour dynamiquement le jeu de données, des bibliothèques comme Annoy peuvent nécessiter une reconstruction complète de l'index, tandis que Faiss prend en charge les mises à jour incrémentielles mais manque de capacités de gestion plus larges.

- Bases de données vectorielles conçues à cet effet : Ces bases de données disposent d'une gamme complète de fonctionnalités de base de données, y compris la persistance des données, la mise à l'échelle horizontale, la réplication, le partage et les fonctionnalités de sauvegarde/restauration. Elles sont conçues pour des cas d'utilisation dynamiques à grande échelle et sont plus faciles à gérer dans un environnement de production. Certaines bases de données vectorielles conçues à cet effet, comme Milvus, prennent également en charge les [recherches hybrides] (https://zilliz.com/blog/a-review-of-hybrid-search-in-milvus) qui combinent la recherche vectorielle et la recherche traditionnelle par mot-clé.

Échelonnabilité

- Bibliothèques de recherche vectorielle** : Bien que les bibliothèques de recherche vectorielle comme Faiss offrent d'excellentes performances, en particulier avec l'accélération GPU, elles ne supportent pas nativement les systèmes distribués. Si vous avez besoin de passer à l'échelle sur plusieurs nœuds ou machines, vous devrez gérer cela manuellement, ce qui peut ajouter de la complexité. La gestion de milliards de vecteurs peut nécessiter un effort d'ingénierie important pour répartir la charge entre les machines, ce qui augmente les coûts d'exploitation et de maintenance.

- Bases de données vectorielles conçues à cet effet : Ces bases de données sont conçues dans un souci d'évolutivité. Les bases de données comme Zilliz Cloud peuvent gérer le sharding, la réplication et l'indexation distribuée dès le départ, ce qui vous permet d'évoluer sans effort au fur et à mesure que votre ensemble de données s'accroît. Elles peuvent gérer des milliards de vecteurs dans un environnement distribué, ce qui les rend idéales pour les applications d'IA au niveau de l'entreprise.

Optimisation des performances

- Bibliothèques de recherche vectorielle** : Les bibliothèques telles que Faiss et Annoy permettent de contrôler directement l'optimisation des performances. Vous pouvez choisir des stratégies d'indexation (par exemple, quantification des produits, arbres de projection aléatoires) et ajuster les algorithmes en fonction des exigences spécifiques de vitesse et de précision. Bien que cela vous donne plus de contrôle, cela nécessite également une compréhension plus approfondie des algorithmes sous-jacents.

- Bases de données vectorielles conçues à cet effet : Ces bases de données automatisent une grande partie du processus d'optimisation des performances. Bien que vous n'ayez pas autant de contrôle sur les stratégies d'indexation, les systèmes gèrent la vitesse d'interrogation, la distribution des données et les optimisations de la gestion de la mémoire. Si les performances sont essentielles et que vous souhaitez vous décharger de la complexité du réglage du système, une base de données vectorielle est une meilleure option.

Facilité d'utilisation et d'installation

- Bibliothèques de recherche vectorielle** : La mise en place de bibliothèques de recherche vectorielle nécessite davantage d'efforts manuels. Vous devrez gérer le stockage des données, l'infrastructure, l'indexation et la mise à l'échelle. Alors que des bibliothèques comme Annoy et Faiss sont relativement faciles à utiliser pour de petits projets, leur mise à l'échelle pour une utilisation en production implique de gérer soi-même l'infrastructure environnante, comme le stockage et l'équilibrage de la charge.

- Bases de données vectorielles conçues à cet effet : Ces bases de données sont conçues pour être plus faciles à mettre en place dans des environnements de production. Les solutions gérées comme Pinecone vous permettent de vous concentrer sur le développement de votre application sans vous soucier de l'infrastructure sous-jacente. Ces systèmes sont également dotés de fonctionnalités intégrées pour la gestion des données, ce qui facilite leur déploiement et leur mise à l'échelle.

Considération des coûts

- Bibliothèques de recherche vectorielle** : Étant donné que ces bibliothèques sont légères et ne nécessitent qu'une configuration minimale, elles ont tendance à avoir des coûts initiaux moins élevés, en particulier si vous avez un petit ensemble de données statiques. Cependant, le coût à long terme peut augmenter si vous devez faire évoluer le système ou traiter des ensembles de données dynamiques, car vous devrez gérer l'infrastructure et les ressources techniques.

- Bases de données vectorielles conçues à cet effet : Les bases de données vectorielles gérées comme Zilliz Cloud peuvent être plus chères en raison des frais généraux opérationnels qu'elles éliminent. Cependant, elles offrent des avantages substantiels à long terme en termes de facilité d'utilisation, d'évolutivité et de maintenance. Si vous travaillez sur une application d'entreprise avec des besoins de recherche vectorielle à grande échelle, le coût d'utilisation d'un service géré est souvent justifié par le temps gagné dans la gestion et la mise en place de l'infrastructure.

Quand choisir chaque solution de recherche vectorielle ?

Choisissez les bibliothèques de recherche vectorielle** si :

- Vous disposez d'un ensemble de données de petite à moyenne taille, relativement statique.

- Vous préférez avoir un contrôle total sur l'indexation et les algorithmes de recherche.

- Vous intégrez la recherche dans un système existant et pouvez gérer l'infrastructure.

Choisissez les bases de données vectorielles conçues à cet effet** si :

- Vous avez besoin de passer à des milliards de vecteurs sur des systèmes distribués.

- Vos données changent fréquemment et nécessitent des mises à jour en temps réel.

- Vous préférez des solutions gérées qui gèrent le stockage, la mise à l'échelle et l'optimisation des requêtes pour vous.

En résumé, choisissez les bibliothèques de recherche vectorielle pour la flexibilité et les applications à petite échelle, et les bases de données vectorielles pour la facilité d'utilisation et les environnements de production à grande échelle.

Évaluer et comparer différentes solutions de recherche vectorielle

Nous avons maintenant appris à faire la différence entre les différentes solutions de recherche vectorielle. Les questions suivantes se posent : comment s'assurer que l'algorithme de recherche renvoie des résultats exacts à la vitesse de l'éclair ? Comment évaluer l'efficacité des différents algorithmes ANN, en particulier à grande échelle ?

Pour répondre à ces questions, nous avons besoin d'un outil d'analyse comparative. De nombreux outils de ce type sont disponibles, mais deux d'entre eux sont considérés comme les plus efficaces : ANN benchmarks et VectorDBBench.

Repères ANN

ANN Benchmarks (Approximate Nearest Neighbor Benchmarks) est un projet open-source conçu pour évaluer et comparer les performances de différents algorithmes d'approximation du plus proche voisin (ANN). Il fournit un cadre standardisé pour l'évaluation comparative de différents algorithmes sur des tâches telles que la recherche vectorielle en haute dimension, permettant aux développeurs et aux chercheurs de mesurer des paramètres tels que la vitesse de recherche, la précision et l'utilisation de la mémoire sur différents ensembles de données. En utilisant ANN-Benchmarks, vous pouvez évaluer les compromis entre vitesse et précision pour des algorithmes tels que ceux trouvés dans des bibliothèques comme Faiss, Annoy, HNSWlib, et d'autres, ce qui en fait un outil précieux pour comprendre quels algorithmes sont les plus performants pour des applications spécifiques.

ANN Benchmarks Dépôt GitHub: https://github.com/erikbern/ann-benchmarks

Site Web de ANN Benchmarks: https://ann-benchmarks.com/

VectorDBBench

VectorDBBench est un outil d'analyse comparative à code source ouvert conçu pour les utilisateurs qui ont besoin de systèmes de stockage et de récupération de données très performants, en particulier les bases de données vectorielles. Cet outil permet aux utilisateurs de tester et de comparer les performances de différents systèmes de bases de données vectorielles tels que Milvus et Zilliz Cloud (Milvus géré) à l'aide de leurs propres ensembles de données, et de déterminer celui qui convient le mieux à leurs cas d'utilisation. VectorDBBench est écrit en Python et sous licence MIT, ce qui signifie que tout le monde peut l'utiliser, le modifier et le distribuer librement.

Dépôt GitHub de VectorDBBench : https://github.com/zilliztech/VectorDBBench

Jetez un coup d'œil rapide aux performances des bases de données vectorielles courantes sur le VectorDBBench Leaderboard.

Techniques et idées sur l'évaluation des bases de données vectorielles :

- Analyse comparative des performances des bases de données vectorielles : techniques et perspectives

- Comparez n'importe quelle base de données vectorielles à une autre (https://zilliz.com/comparison)

Autres ressources sur VectorDB, GenAI et ML

Continuer à lire

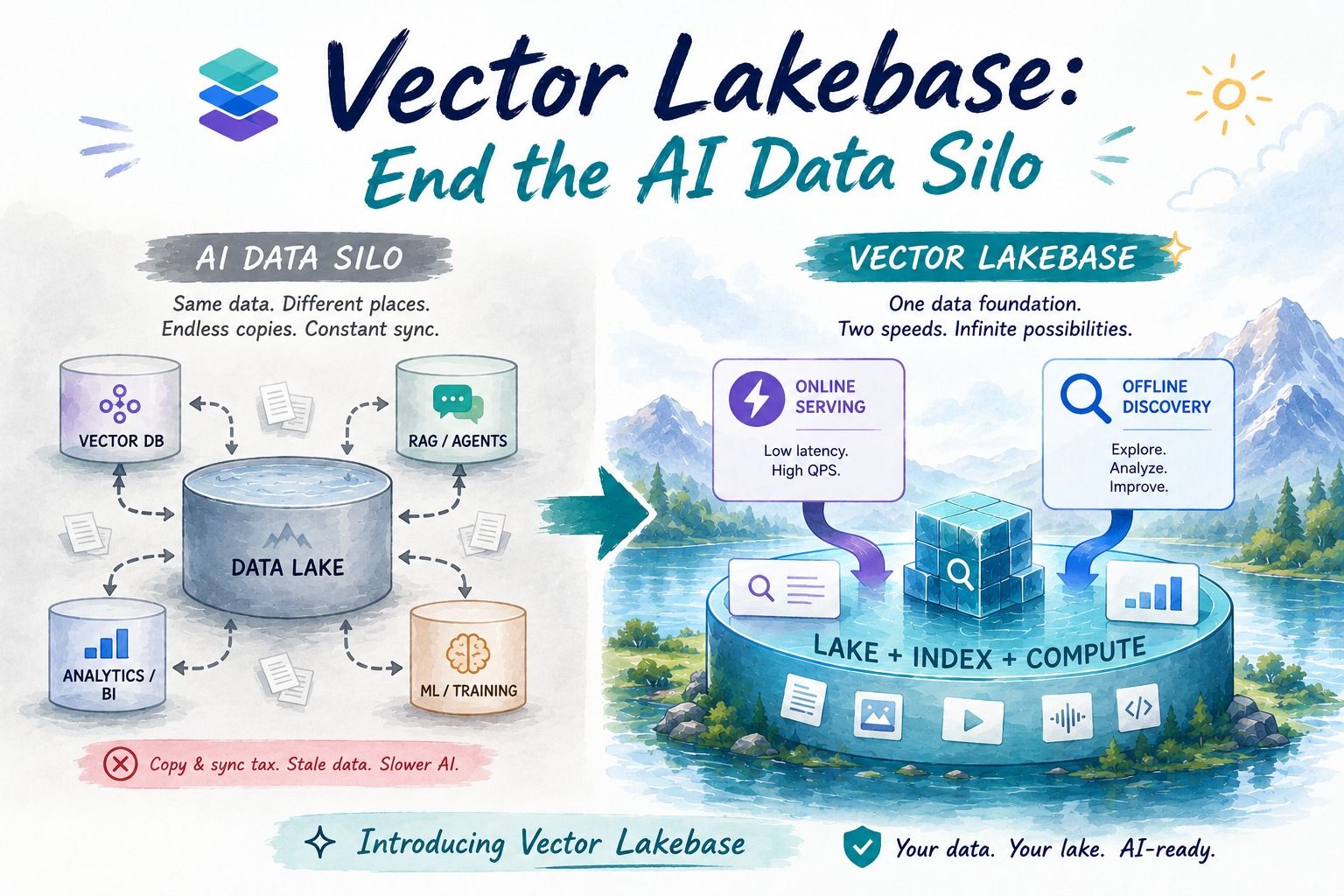

Vector Lakebase: End the AI Data Silo

Learn how Vector Lakebase unifies vector search, data lakes, and AI data operations so teams can serve RAG and agents without copy-and-sync pipelines.

Expanding Our Global Reach: Zilliz Cloud Launches in Azure Central India

Zilliz Cloud expands to Azure Central India. This new region helps customers meet compliance, reduce latency, and optimize cloud costs when building AI applications.

Demystifying the Milvus Sizing Tool

Explore how to use the Sizing Tool to select the optimal configuration for your Milvus deployment.

The Definitive Guide to Choosing a Vector Database

Overwhelmed by all the options? Learn key features to look for & how to evaluate with your own data. Choose with confidence.