Génération Augmentée par Récupération (RAG)

Limitations des LLM

Manque d'informations spécifiques au domaine

Les LLM sont formés uniquement sur des données accessibles au public. Ainsi, ils peuvent manquer de connaissances sur des informations spécifiques au domaine, propriétaires ou privées qui ne sont pas accessibles au public.

Sujet à l'hallucination

Les LLM ne peuvent donner des réponses qu'en fonction des informations qu'ils possèdent. Ils peuvent fournir des informations incorrectes ou fabriquées s'ils n'ont pas assez de données pour référence.

Coûteux et lent

Les LLM facturent chaque jeton dans les requêtes, entraînant des coûts élevés, particulièrement pour des questions répétitives. De plus, les retards de réponse pendant les heures de pointe frustrent également les utilisateurs cherchant des réponses rapides.

Incapacité à accéder à des informations à jour

Les LLM sont souvent formés sur des données obsolètes et ne mettent pas à jour régulièrement leur base de connaissances en raison des coûts élevés de formation. Par exemple, former GPT-3 peut coûter jusqu'à 1,4 million de dollars.

Limite de Jetons

Les LLM fixent une limite sur le nombre de jetons qui peuvent être ajoutés aux invites de requête. Par exemple, ChatGPT-3 a une limite de 4 096 jetons, tandis que GPT-4 (8K) a une limite de jetons de 8 192.

Données de pré-formation immuables

Les données de pré-formation des LLM peuvent contenir des informations obsolètes ou incorrectes. Malheureusement, ces données ne peuvent pas être modifiées, corrigées ou supprimées.

Comment Zilliz Cloud Augmente les Applications LLM

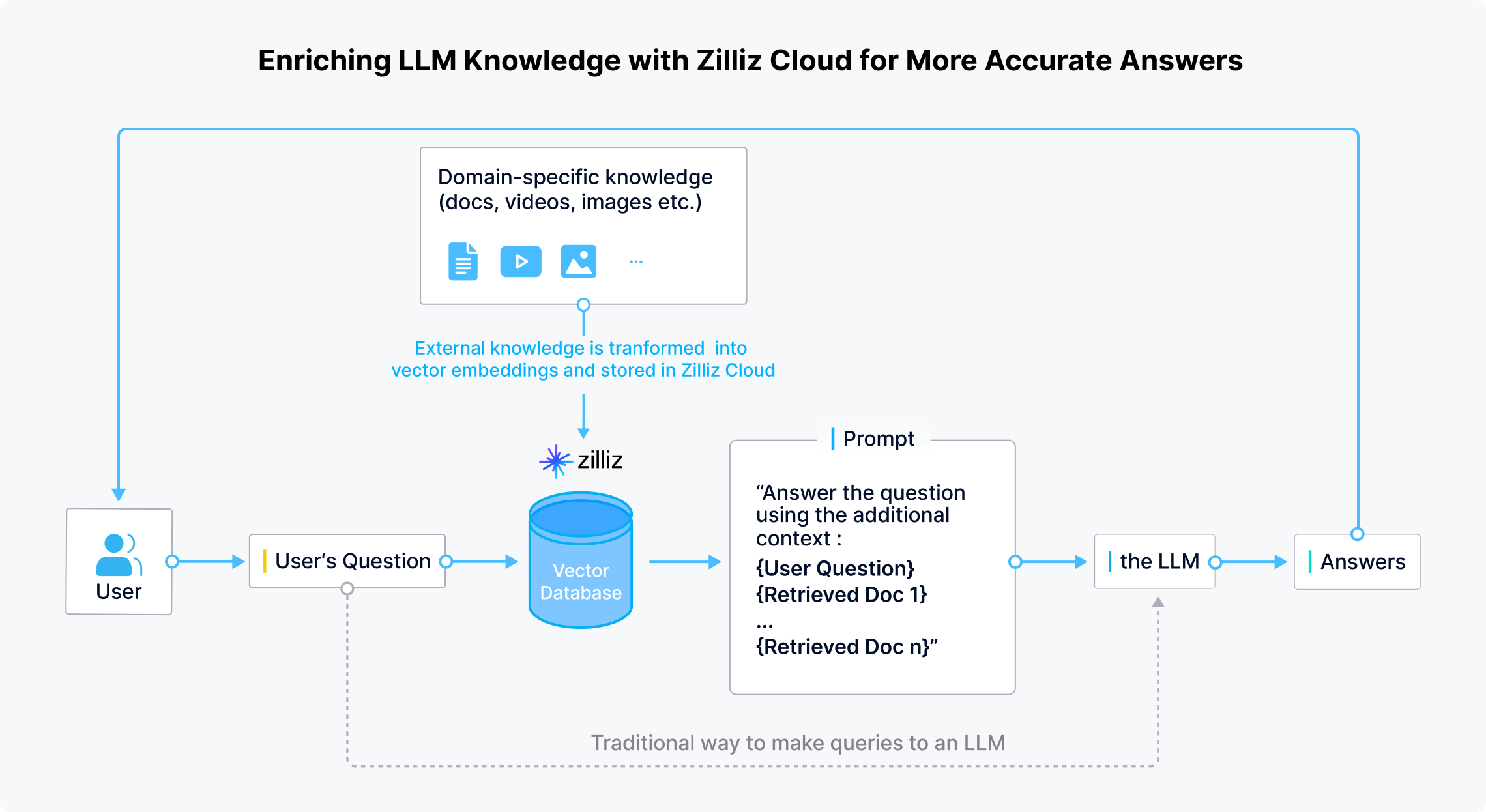

RAG pour LLM : Mise à jour et extension de la base de connaissances des LLM pour des réponses plus précises

Zilliz Cloud permet aux développeurs et aux entreprises de stocker en toute sécurité des données spécifiques au domaine, à jour et confidentielles en dehors des LLM. Lorsqu'un utilisateur pose une question, les applications LLM utilisent des modèles d'embedding pour transformer la question en vecteurs. Zilliz Cloud effectue ensuite des recherches de similarité pour fournir les Top-K résultats pertinents pour cette question. Enfin, ces résultats sont combinés avec la question originale pour créer une invite qui fournit un contexte complet pour que le LLM génère des réponses plus précises.

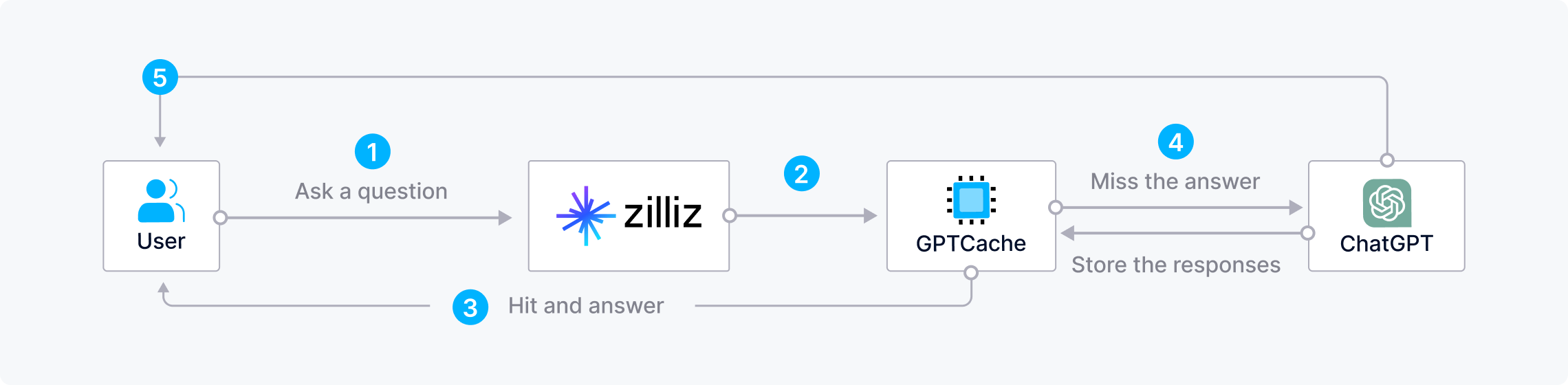

Économiser du temps et des coûts en combinant Zilliz Cloud avec GPTCache

Poser fréquemment aux LLM des questions répétitives ou similaires peut être coûteux, gaspilleur de ressources et chronophage, surtout pendant les heures de pointe où les réponses sont lentes. Pour économiser du temps et de l'argent lors de la construction d'applications d'IA, les développeurs peuvent utiliser Zilliz Cloud avec GPTCache, un cache sémantique open-source qui stocke les réponses des LLM. Avec cette architecture, Zilliz vérifie d'abord GPTCache pour des réponses lorsqu'un utilisateur pose une question. Si elle trouve une réponse, Zilliz Cloud renvoie rapidement la réponse à l'utilisateur. Sinon, Zilliz Cloud envoie la requête au LLM pour une réponse et la stocke dans GPTCache pour une utilisation future.

La Pile CVP

ChatGPT/LLMs + une base de données vectorielle + prompt-as-code

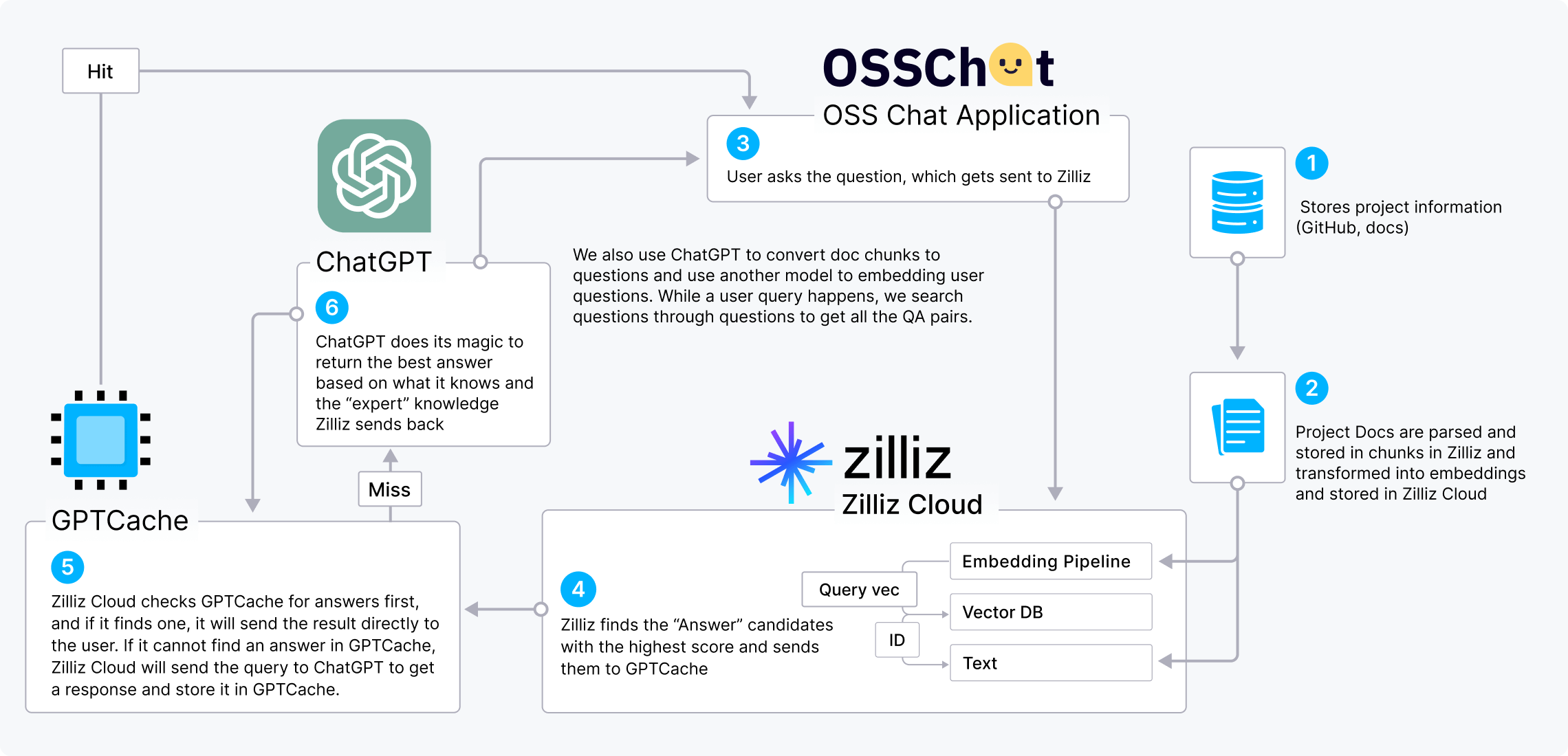

La pile CVP (ChatGPT/LLMs + une base de données vectorielle + prompt-as-code) est une pile d'IA de plus en plus populaire qui montre la valeur des bases de données vectorielles pour l'amélioration des LLM. Nous pouvons utiliser OSS Chat comme exemple pour démontrer comment fonctionne la pile CVP.

OSS Chat est un chatbot qui peut répondre à des questions sur les projets GitHub. Il collecte et stocke des informations provenant de divers dépôts GitHub et de leurs pages de documentation dans Zilliz Cloud sous forme d'embeddings. Lorsqu'un utilisateur interroge OSS Chat sur un projet open-source, Zilliz Cloud effectue une recherche de similarité pour trouver les topk résultats les plus pertinents. Ensuite, ces résultats sont combinés avec la question originale pour créer une invite qui donne à ChatGPT un contexte plus large, ce qui permet d'obtenir des réponses plus précises.

Nous pouvons également intégrer GPTCache dans la pile CVP pour réduire les coûts et accélérer les réponses.

Projets LLM Utilisant Milvus & Zilliz Cloud

Découvrez comment les développeurs utilisent Milvus & Zilliz Cloud pour renforcer leurs applications d'IA générative.

- OSS Chat

- PaperGPT

- NoticeAI

- Search.anything.io

- IkuStudies

- AssistLink AI

Intégrations de Milvus avec des Projets d'IA Populaires

OpenAI, LangChain, LlamaIndex, et bien d'autres pionniers de l'IA s'intègrent avec Zilliz Cloud pour amplifier leurs capacités de récupération.