Что такое обратное распространение?

Что такое обратное распространение?

# Backpropagation в нейронных сетях

Если вы гуляли по Сан-Франциско в последнее время, то заметили, что множество автономных автомобилей от Waymo и Zoox не только ездят по улицам, но и подвозят и высаживают пассажиров в течение всего дня и ночи. Эти автомобили вежливо соблюдают правила дорожного движения, избегают столкновений с другими машинами и умудряются ориентироваться в толпе людей в оживленное время суток. Для людей, не привыкших к такому зрелищу, просто удивительно видеть, как эти армии машин выполняют свою работу!

Автономный автомобиль в Сан-Франциско

Автономный автомобиль в Сан-Франциско

Процесс машинного обучения, называемый обратным распространением, позволяет этим автомобилям ориентироваться в таких сложных ситуациях. Но что же такое обратное распространение и как оно обеспечивает такое сложное поведение?

По своей сути, обратное распространение - это высокоэффективный механизм обучения для искусственных нейронных сетей, в значительной степени опирающийся на функцию активации для определения выхода нейронов. Представьте себе начинающего водителя, который учится ориентироваться на городских улицах. Вначале он может совершать ошибки - слишком резко тормозить, слишком резко поворачивать или неправильно оценивать расстояние. С каждой ошибкой они корректируют свои действия, постепенно совершенствуя свои навыки. Обратное распространение работает аналогичным образом, но с молниеносной скоростью и математической точностью.

В машинном обучении обратное распространение является закулисным учителем, постоянно корректирующим процесс принятия решений системами искусственного интеллекта. Входные данные проходят через слои нейросетевой модели в процессе обучения, влияя на производительность и эффективность процессов обучения и устранения ошибок нейронной сети. Эта техника используется не только в самоуправляемых автомобилях: она является секретным соусом многих приложений ИИ, с которыми мы сталкиваемся ежедневно, - от голосовых помощников, понимающих наш акцент, до рекомендательных систем, которые, кажется, знают наши предпочтения лучше, чем мы сами, и все это благодаря выходному слою, генерирующему прогнозы модели.

В этом посте мы разберем скрытые слои обратного распространения, изучим, как он преобразует исходные данные в интеллектуальные решения. Мы разберем математику, не заблудившись в уравнениях, рассмотрим практический пример, который вы сможете использовать, и даже покажем, как реализовать эту мощную технику с помощью Python.

Если вы начинающий специалист по изучению данных, любопытный энтузиаст техники или просто человек, увлеченный происходящей вокруг нас революцией в области искусственного интеллекта, понимание обратного распространения даст вам ценные знания о механизмах современного ИИ. Итак, давайте заглянем в самое сердце машинного обучения, где числа танцуют с нейронами, создавая интеллектуальные системы, формирующие наш мир.

Что такое алгоритм обратного распространения?

Backpropagation - это алгоритм обратного распространения, играющий решающую роль в обучении нейронных сетей с прямолинейным движением, рабочих лошадок многих приложений ИИ.

Воспринимайте алгоритм обратного распространения как неутомимого тренера, умеющего улучшать данные: Нейронная сеть с прямолинейным движением использует рекуррентное обратное распространение для настройки своих весов и смещений в процессе обучения, обеспечивая оптимальную производительность.

Это не одноразовый процесс, а постоянный цикл совершенствования. После каждого цикла обучения (называемого эпохой) обратное распространение анализирует работу сети и вносит точные коррективы. Это похоже на то, как тренер просматривает видеозаписи игры после каждого матча, корректируя стратегию в режиме реального времени.

Цель алгоритма? Минимизировать "функцию стоимости", сократить разрыв между прогнозами ИИ и реальностью. Для этого он точно настраивает внутренние параметры сети (веса и смещения), подобно механику, который регулирует различные компоненты двигателя для достижения оптимальной производительности.

При обратном распространении используются сложные методы оптимизации, как правило, градиентный спуск или его близкий родственник - стохастический градиентный спуск. Эти методы помогают сети ориентироваться в сложном ландшафте возможных решений, постоянно двигаясь в сторону улучшения производительности.

В своей основе метод обратного распространения использует фундаментальный принцип исчисления: правило цепочки. Этот математический инструмент позволяет алгоритму обходить сложные слои нейронной сети, определяя, какой вклад вносит каждый компонент в общую ошибку. Это сродни прослеживанию реки до ее истоков, когда каждый приток влияет на основной поток.

Сочетая итеративное обучение, умную оптимизацию и математическую точность, обратное распространение превращает нейронные сети из статичных структур в динамичные, самосовершенствующиеся системы. Дело не только в том, чтобы делать прогнозы, но и в том, чтобы постоянно развиваться и делать лучшие прогнозы, расширяя границы возможностей искусственного интеллекта.

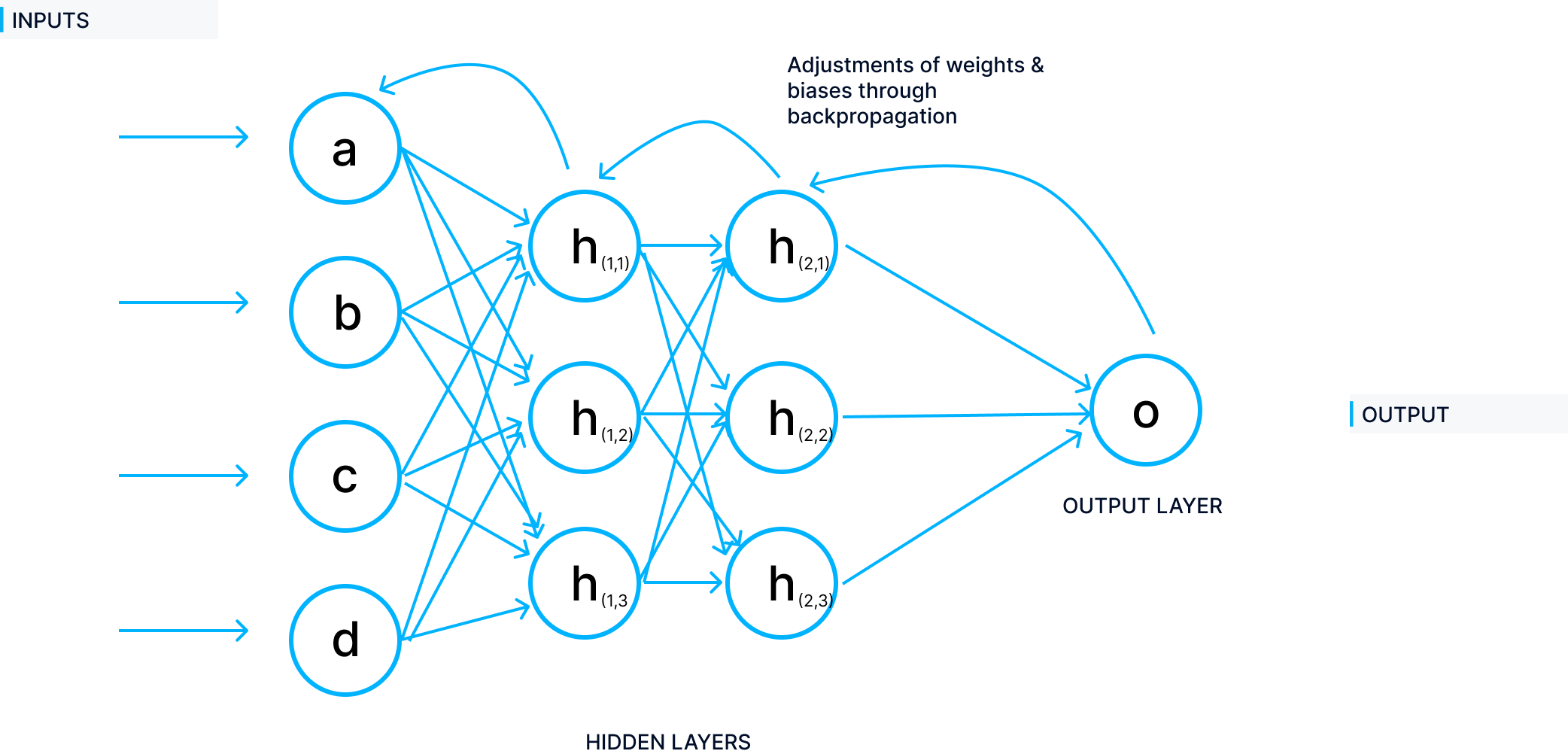

Backpropagation of neural networks

Backpropagation of neural networks

Алгоритмы обратного распространения

С математической точки зрения, обратное распространение - это сложный танец вычислений и оптимизации. В основе ее лежит понимание того, как изменения параметров нейронной сети влияют на ее общую производительность. Процесс начинается с определения функции потерь, количественно определяющей разницу между прогнозами сети и реальными результатами. Эта функция действует как компас, направляя сеть к лучшей производительности. Фидфорвард-процесс проталкивает данные через сеть, при этом каждый нейрон применяет веса и смещения, а затем передает результат через функцию активации.

Здесь на первый план выходит калькуляция: обратное распространение вычисляет частные производные, чтобы определить, какой вклад вносит каждый вес и смещение в общую ошибку. Правило цепочки, фундаментальный принцип исчисления, позволяет эффективно вычислять эти производные на нескольких слоях, вычисляя градиент. Скорость обучения, важнейший гиперпараметр, контролирует, насколько быстро сеть корректирует свои параметры в ответ на эти вычисления. Слишком высокая скорость может привести к тому, что сеть превысит свою оптимальную конфигурацию; слишком низкая - и обучение станет мучительно медленным. Весь этот процесс является итерационным, и каждая эпоха (полный проход через обучающие данные) уточняет параметры сети. Со временем этот математический механизм приводит сеть к конфигурации, которая минимизирует функцию потерь, эффективно обучая ИИ делать все более точные прогнозы.

Понимание алгоритма обратного распространения

Работа алгоритма обратного распространения состоит из двух основных этапов:

1. Передача вперед:

Входные данные поступают в сеть через входной слой.

Каждый нейрон в последующих слоях вычисляет взвешенную сумму своих входов, добавляет смещение и применяет функцию активации.

Информация проходит через сеть, при этом выход каждого слоя становится входом следующего слоя.

Последний слой выдает прогноз сети.

2. Обратный проход:

Сеть вычисляет ошибку между своим предсказанием и реальной целью.

Этот сигнал об ошибке распространяется по сети в обратном направлении.

Для каждого нейрона алгоритм рассчитывает, как изменится ошибка при небольших корректировках весов и смещений.

В этих расчетах используется правило цепочки для определения градиента ошибки относительно каждого параметра.

Веса и смещения корректируются для уменьшения ошибки.

Ключевые компоненты:

- Функции активации: Вводят нелинейность, позволяя сети обучаться сложным моделям. Обычно выбирают ReLU для скрытых слоев и Softmax для классификационных выходов.

- Функция потерь: Измеряет разницу между предсказаниями и фактическими значениями. Среднеквадратичная ошибка часто используется для регрессии, а кросс-энтропия - для классификации.

- Скорость обучения: Определяет размер обновлений весов. Требуется тщательная настройка, чтобы сбалансировать скорость обучения и стабильность.

- Правило цепочки: Позволяет эффективно вычислять градиент на нескольких слоях, помогая сети приписывать конечную ошибку каждому из своих параметров.

Эффективность обратного распространения обусловлена его способностью регулировать множество параметров одновременно, постепенно улучшая предсказания сети в течение нескольких итераций.

Backpropagation

Backpropagation

Пример обратного распространения на практике

Давайте рассмотрим обратное распространение на практическом примере. Представьте, что мы все обучаем нейронные сети с помощью простого ИИ, чтобы предсказать цены на жилье в оживленном районе города. Наша нейронная сеть похожа на новичка-агента по недвижимости, который осваивает канаты оценки недвижимости.

Мы начинаем с базовой архитектуры сети:

Входной слой (считайте, что это глаза и уши агента).

Скрытый слой (мозг агента).

Выходной слой (окончательная оценка цены).

Наш набор данных - это коллекция недавних продаж домов с такими характеристиками, как площадь, количество спален и местоположение.

При прямом и обратном проходе наш агент ИИ рассматривает дом (вводит характеристики). Он делает первоначальные предположения о том, насколько важна каждая характеристика (применяет веса), и добавляет некоторые личные догадки (предубеждения). После некоторых внутренних вычислений (функции активации) получается прогноз цены.

Теперь наступает проверка реальности. Используя функцию потерь, мы сравниваем квадратичную ошибку прогноза ИИ с фактической ценой продажи. Допустим, наш агент завысил цену на 50 000 долларов - это большой промах!

Вот тут-то и вступает в действие обратное распространение. Она, как наставник агента, помогает определить, почему прогноз оказался неверным. Работая в обратном направлении, он вычисляет, насколько каждая часть процесса принятия решения способствовала ошибке.

Основываясь на этом анализе, мы обновляем весовые коэффициенты и смещения. Возможно, наш агент уделял слишком много внимания количеству спален и недостаточно - расположению. Мы вносим небольшие коррективы, чтобы исправить это.

Этот процесс повторяется для многих домов (итерации). Наш агент ИИ становится немного умнее с каждым прогнозом и корректировкой. Со временем его прогнозы начинают приближаться к реальным ценам продажи.

К концу обучения наш ИИ превратился из новичка в опытного оценщика недвижимости, способного делать точные прогнозы цен, основываясь на характеристиках дома. Это и есть обратное распространение в действии - превращение необработанных данных в ценные сведения благодаря постоянному обучению и совершенствованию.

Cross-entropy loss* используется для обучения моделей классификации. Это простая в реализации функция потерь, требующая для точного расчета потерь метки, закодированные в числовых значениях.*

Преимущества обратного распространения в нейронных сетях

Бэкпропагация стала фундаментальным алгоритмом обучения нейронных сетей благодаря нескольким ключевым преимуществам:

Доступность: Алгоритм не требует обширной математической подготовки, что делает его доступным для новичков в машинном обучении. Его простая реализация позволяет легче отлаживать и модифицировать алгоритм.

Универсальность: Backpropagation хорошо адаптируется к различным архитектурам сетей и проблемным областям. Она может эффективно применяться в сетях с прямолинейным движением, конволюционных нейронных сетях и рекуррентных нейронных сетях.

Эффективное обучение: Благодаря прямому вычислению градиентов ошибок, обратное распространение позволяет быстро корректировать веса. Эта эффективность особенно важна для глубоких сетей, где обучение сложным характеристикам может занимать много времени.

Способность к обобщению: Благодаря итеративному обновлению весов обратное распространение помогает сетям выявлять основные закономерности в данных. Это приводит к созданию моделей, которые могут делать точные предсказания на новых, еще не изученных примерах.

Масштабируемость: Алгоритм хорошо работает с различными объемами наборов данных и сложностью сетей. Такая масштабируемость делает его пригодным как для небольших экспериментов, так и для крупномасштабных промышленных приложений.

Эти преимущества способствовали широкому распространению метода обратного распространения в обучении нейронных сетей. Баланс простоты и эффективности делает ее ценным инструментом для разработки моделей машинного обучения в различных приложениях.

Реализация обратного распространения в Python

Существует ряд классных проектов на языке Python, которые помогут вам самостоятельно опробовать метод обратного распространения.

Implementing Backpropagation in Python: Построение нейронной сети с нуля - Андрес Бережной

Как закодировать нейронную сеть с обратным распространением в Python (с нуля)

Приложения обратного распространения

Влияние обратного распространения выходит далеко за пределы теоретического машинного обучения, обеспечивая работу множества приложений ИИ, которые стали неотъемлемой частью нашей повседневной жизни. Некоторые из этих приложений включают:

Автономные транспортные средства: Как уже упоминалось ранее в связи с Waymo и Zoox, самоуправляемые автомобили в значительной степени полагаются на нейронные сети для интерпретации данных датчиков, прогнозирования дорожной обстановки и принятия решений в доли секунды. Обратное распространение позволяет этим автомобилям учиться на каждой поездке, постоянно совершенствуя свою навигацию и протоколы безопасности.

Медицинская диагностика: Системы искусственного интеллекта все чаще помогают медицинским работникам интерпретировать медицинские изображения, такие как рентгеновские, магнитно-резонансные и компьютерные томографы. Обратное распространение позволяет этим системам обучаться на основе обширных баз данных медицинских изображений, часто замечая тонкие аномалии, которые могут ускользнуть от человеческого глаза.

[Обработка естественного языка] (https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models): Помимо голосовых помощников, обратное распространение используется в службах машинного перевода, инструментах анализа настроений и чат-ботах. Эти приложения могут понимать контекст, нюансы и даже сарказм в письменном тексте, преодолевая языковые барьеры и улучшая коммуникацию.

Рекомендательные системы: Потоковые сервисы, такие как Netflix и Spotify, используют нейронные сети для анализа ваших привычек просмотра или прослушивания и предлагают контент, который может вам понравиться. Обратное распространение помогает этим системам учиться на взаимодействии с пользователями, постоянно совершенствуя свои рекомендации.

Робототехника: На производстве и в научных исследованиях роботы используют нейронные сети для обучения сложным задачам, от точной сборки до навигации в непредсказуемой среде. Обратное распространение позволяет этим роботам со временем совершенствовать свои движения и процессы принятия решений.

Эти приложения представляют собой лишь малую часть влияния обратного распространения. По мере того как ИИ продолжает развиваться, этот алгоритм остается в центре инноваций, которые меняют отрасли, продвигают научные исследования и изменяют наше взаимодействие с технологиями.

В этом посте рассматриваются основы обработки естественного языка, которые необходимы для понимания всех современных языковых моделей.

Проблемы и соображения:

Несмотря на то, что обратное распространение произвело революцию в машинном обучении, оно не лишено своих проблем и соображений. Давайте рассмотрим некоторые из ключевых проблем, с которыми сталкиваются исследователи и практики:

Проблема исчезающего градиента: В глубоких нейронных сетях градиенты могут становиться очень маленькими по мере того, как они распространяются обратно по слоям. Это может привести к мучительно медленному обучению или даже к полной остановке обучения для ранних слоев. Это похоже на попытку передать сообщение шепотом через длинную цепочку людей - к тому времени, как оно дойдет до конца, сообщение может быть потеряно.

Проблема исчезающего градиента: Обратная сторона исчезающих градиентов. Эта проблема возникает, когда градиенты становятся очень большими, что приводит к нестабильному обновлению весов сети. Это похоже на то, как небольшое изменение входного сигнала вызывает непропорционально большое изменение выходного сигнала, делая сеть ненадежной.

Ловушки локального минимума: Функция обратного распространения направлена на поиск глобального минимума функции потерь, но она может застрять в локальных минимумах, что приводит к неоптимальным решениям. Представьте, что вы пытаетесь найти самую низкую точку на холмистом ландшафте с завязанными глазами - вы можете подумать, что достигли дна, когда на самом деле вы просто находитесь в небольшом углублении.

Компьютерная интенсивность: Обучение больших нейронных сетей с помощью обратного распространения может быть чрезвычайно дорогостоящим, требуя значительного времени и ресурсов. Это может ограничить доступность глубокого обучения для тех, кто имеет доступ к мощному оборудованию.

Оверфиттинг: Благодаря своей способности к изучению сложных паттернов, сеть, использующая обратное распространение, иногда может слишком хорошо изучить шум в обучающих данных, что приводит к плохому обобщению на новых данных. Это похоже на заучивание ответов на тест вместо понимания основных принципов.

Настройка гиперпараметров: Выбор правильной скорости обучения, размера партии и архитектуры сети может быть скорее искусством, чем наукой, часто требующей длительных экспериментов. Это тонкий баланс - слишком агрессивный, и модель может никогда не сходиться; слишком консервативный, и обучение может занять непрактично много времени.

Недифференцируемые функции активации: Обратное распространение опирается на вычисление градиентов, что становится проблематичным при использовании недифференцируемых функций активации, таких как ступенчатая функция. Это ограничивает типы нейронных архитектур, которые могут быть легко обучены.

Катастрофическое забывание: При обучении на новых данных нейронные сети могут быстро забыть ранее изученную информацию. Это особенно сложно в сценариях, требующих непрерывного обучения.

Проблемы интерпретируемости: Сложная природа глубоких нейронных сетей затрудняет интерпретацию того, почему сеть приняла то или иное решение. Этот "черный ящик" может быть проблематичным в приложениях, требующих прозрачности, таких как здравоохранение или финансы.

Зависимость от данных: Эффективность обратного распространения в значительной степени зависит от качества и количества обучающих данных. В сценариях с ограниченными или необъективными данными алгоритм может не справиться с эффективным обучением или увековечить существующие предубеждения.

Решение этих проблем является активной областью исследований в сообществе машинного обучения. Для смягчения некоторых из этих проблем были разработаны такие методы, как batch normalization, остаточные связи и адаптивные скорости обучения. По мере развития этой области новые инновации продолжают расширять границы возможного с помощью обратного распространения и нейронных сетей.

Будущие последствия:

Заглядывая в будущее ИИ, мы видим, что метод обратного распространения стоит на интересном перепутье. Несмотря на то что она остается краеугольным камнем глубокого обучения, наметившиеся тенденции указывают на эволюцию и революцию. Вот взгляд на то, что может ждать нас в будущем:

Квантовое обратное распространение: С развитием квантовых вычислений исследователи изучают квантовые версии обратного распространения. Потенциально они могут решать проблемы оптимизации экспоненциально быстрее, чем классические методы, открывая двери для обучения гораздо более сложных сетей.

Нейроморфные вычисления: По мере развития аппаратных средств ИИ, которые будут все больше имитировать биологический мозг, мы можем увидеть новые формы обратного распространения, более энергоэффективные и способные обучаться в реальном времени, подобно тому, как наш мозг постоянно адаптируется.

Федеративное обучение: Будущие алгоритмы обратного распространения могут обеспечить более эффективный ИИ с сохранением конфиденциальности, позволяя моделям обучаться на распределенных наборах данных без централизации конфиденциальной информации. Это может произвести революцию в таких областях, как искусственный интеллект в здравоохранении, где конфиденциальность данных имеет первостепенное значение.

Объяснимый ИИ: По мере роста спроса на прозрачность ИИ мы можем увидеть новые методы обратного распространения, которые не только оптимизируют производительность, но и дают более четкое представление о процессе принятия решений нейронными сетями.

Мета-обучение: В будущем обратное распространение может не только оптимизировать параметры модели, но и научиться обучаться. Это может привести к созданию систем искусственного интеллекта, которые будут адаптироваться к новым задачам при минимальном обучении, подобно человеческой интуиции.

Системы непрерывного обучения: Достижения в области обратного распространения могут решить проблему катастрофического забывания, что приведет к созданию систем ИИ, которые будут обучаться непрерывно в течение всего срока эксплуатации, постоянно совершенствуясь и не теряя ранее приобретенных знаний.

Гибридные подходы к обучению: Возможно, обратное распространение будет сочетаться с другими парадигмами обучения, такими как обучение с подкреплением или эволюционные алгоритмы, создавая более надежные и универсальные системы ИИ.

Эмоциональный и социальный интеллект: В будущем методы обратного распространения могут помочь системам ИИ лучше понимать и реагировать на человеческие эмоции, что в перспективе приведет к созданию более эмпатичных и социально интеллектуальных ИИ-помощников.

Адаптация к окружающей среде: Поскольку системы ИИ развертываются в разнообразных и непредсказуемых условиях, новые формы обратного распространения могут обеспечить быструю адаптацию к меняющимся условиям, что крайне важно для таких приложений, как роботы для ликвидации последствий стихийных бедствий или системы мониторинга климата.

Этичное обучение ИИ: Будущие алгоритмы обратного распространения могут включать этические соображения непосредственно в процесс обучения, помогая создавать системы ИИ, которые не только интеллектуальны, но и соответствуют человеческим ценностям и общественным нормам.

Эти потенциальные достижения позволяют предположить, что в будущем алгоритм обратного распространения будет развиваться не только в своей нынешней форме, но и станет движущей силой инноваций в области ИИ, о которых мы только начинаем мечтать. Как и все технологические прогнозы, некоторые из них могут материализоваться, в то время как другие уступят место совершенно непредвиденным событиям. Несомненно лишь то, что принципы, лежащие в основе обратного распространения, будут определять траекторию развития ИИ еще долгие годы.

Междисциплинарная актуальность с векторными базами данных:

Влияние обратного распространения распространяется на множество дисциплин, в которых [векторные базы данных] (https://zilliz.com/learn/what-is-vector-database) играют важную вспомогательную роль:

Когнитивная нейронаука: Моделирование нейронных процессов для понимания человеческого познания.

Вычислительная лингвистика: Революционная обработка и создание языков.

Компьютерное зрение: Улучшение интерпретации изображений для медицинской визуализации и автономных транспортных средств.

Биоинформатика: Предсказание структуры белков и функций генов.

Финансы: Создание прогностических моделей для определения рыночных тенденций и оценки рисков.

Робототехника: Помощь роботам в адаптации к новым условиям.

Материаловедение: Прогнозирование свойств материалов и разработка новых соединений.

Климатология: Создание сложных климатических моделей и анализ погодных условий.

Рекомендательные системы: Уточнение предпочтений пользователей для персонализированной доставки контента.

Кибербезопасность: Обнаружение аномалий и потенциальных угроз в сетевом трафике.

Векторные базы данных расширяют возможности этих приложений благодаря эффективному хранению и извлечению высокоразмерных данных, что крайне важно для нейронных сетей, обучаемых методом обратного распространения. Такая синергия позволяет ускорить обучение, сделать более эффективный вывод и работать с большими и сложными наборами данных.

По мере развития ИИ и машинного обучения междисциплинарные приложения обратного распространения при поддержке векторных баз данных обещают открыть новые горизонты в самых разных областях, от квантовых вычислений до творческих систем ИИ.

- Что такое алгоритм обратного распространения?

- Алгоритмы обратного распространения

- Понимание алгоритма обратного распространения

- Пример обратного распространения на практике

- Преимущества обратного распространения в нейронных сетях

- Реализация обратного распространения в Python

- Приложения обратного распространения

- Проблемы и соображения:

- Будущие последствия:

- Междисциплинарная актуальность с векторными базами данных:

Контент

Начните бесплатно, масштабируйтесь легко

Попробуйте полностью управляемую векторную базу данных, созданную для ваших GenAI приложений.

Попробуйте Zilliz Cloud бесплатно