CalHacks 2023でのZilliz

晴れた日曜日の午後、サンフランシソのメトリオンの中心からこれを書いている。金曜日の午後(10月27日〜29日)から、CalHacksが開催されている。賞金137,650ドルとスポンサー賞があった:

イベント期間中、CalHacksのSlackチャットには1949人が参加した。

世界中から1000人以上の学生がハッキングのために直接集まった。

764名の学生がイベントに正式参加。

240のコンペティション・プロジェクト提出

Zillizのスポンサー賞「Best Use of Milvus」を競う12の優れたプロジェクト。

画像出典:CalHacks 2023.](https://assets.zilliz.com/calhacks_2023_image1_2532997069.png)

私たちはZilliz賞を授与したばかりですが、プロジェクトは革新的で印象的でした!

最優秀Milvus利用賞 - 1位

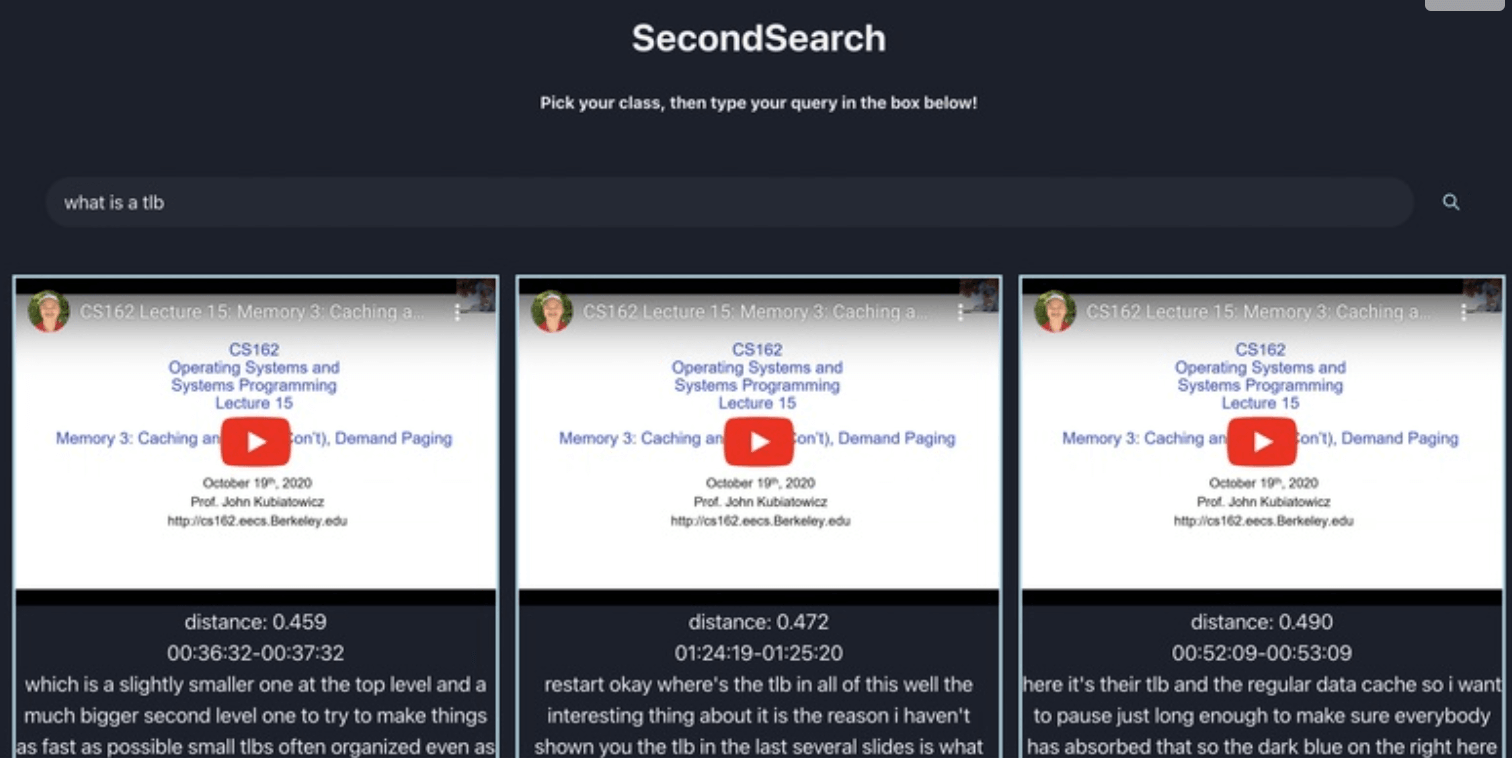

第1位はSecond Searchでした。受賞者

キャサリン・ジン](https://www.linkedin.com/in/catherine-jin/) (BS EECS '25 カリフォルニア大学バークレー校)

カニシュク・ガーグ](https://www.linkedin.com/in/kanishk-garg-7170651b6/) (BS CS '24 テキサス大学ダラス校)

彼らがしたこと:彼らはYoutubeにアップロードされたCS162の講義ビデオを取りました。そして、それらの動画のキャプションテキストを取り出し、テキストを埋め込み、埋め込みベクトルをMilvusに保存した。

ユーザーは知りたいトピックを入力することができる。私は「LRUキャッシュについて説明してください」とタイプした。私の同僚は「Linuxソケットについて説明してください」と入力した。検索は3つのビデオセグメントを返す。それぞれのビデオは、教授が検索されたトピックを説明しているビデオの2つ目にリンクされていた。再生」をクリックするだけで、ビデオのその部分を聞くことができた。さらに、ビデオの下にテキスト要約が表示され、1)ベクトル検索距離メトリック、2)再生中のビデオのタイムスタンプ、3)そのビデオセグメントで教授が話していたことのテキスト要約が表示された。

私たちは、UIがシンプルで使いやすく、リアルタイム感があり(~1秒の応答時間)、機能的で(関連する内容のビデオを表示)、クリエイティブな方法でMilvusを使用し、とても便利だと思いました!このような製品がYouTubeで利用できるようになることを望んでいます!

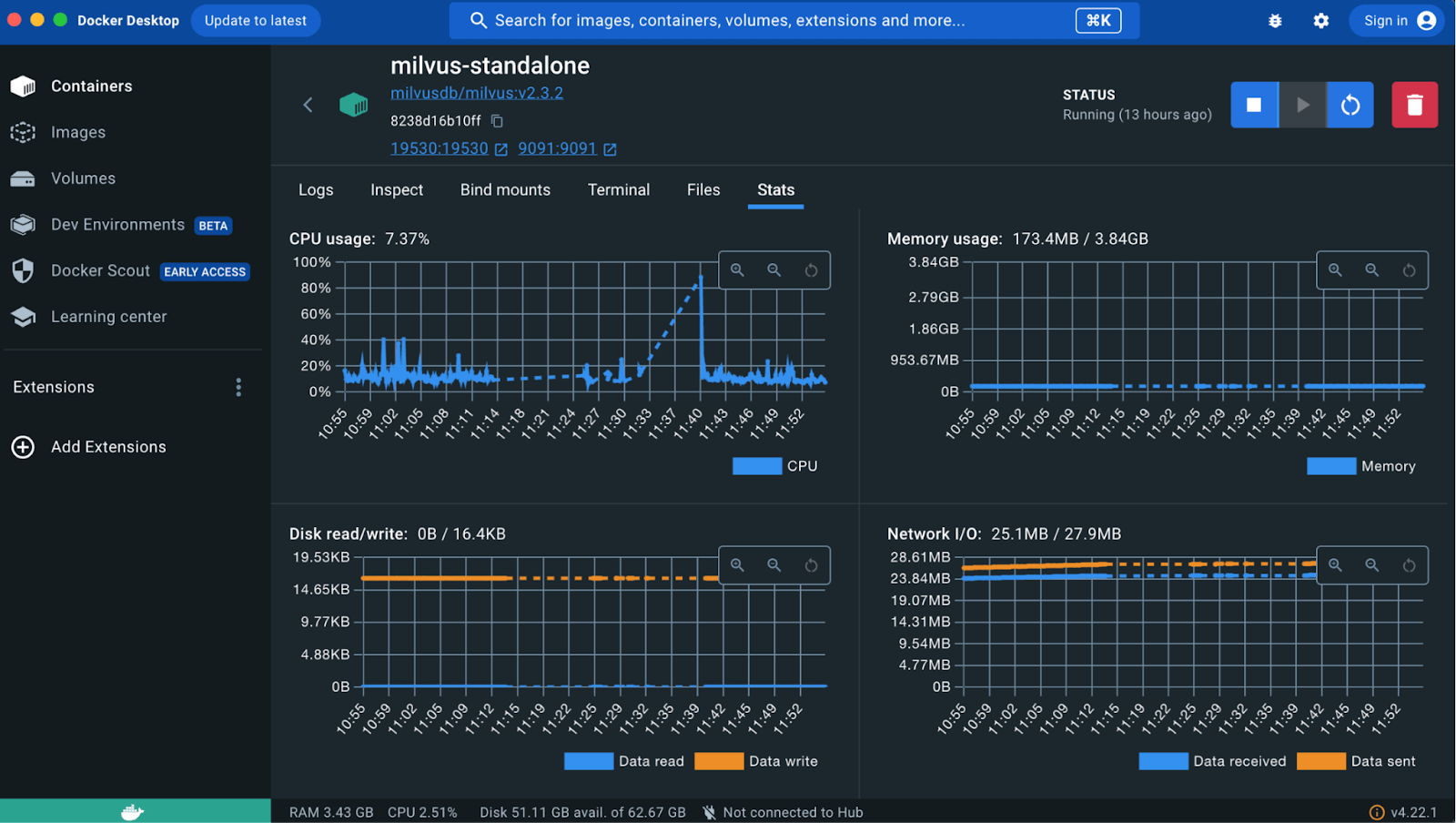

**SecondSearchは、ローカルで動作するMilvusオープンソースのベクターデータベース上に構築され、埋め込みデータを生成するためにOpenAIを使用し、Chakra UIコンポーネントライブラリで構築されたコンパニオンReactフロントエンドで製品を完成させた。バックエンドはFastAPIを使って作られ、MilvusドッカーコンテナはJupyterノートブックを使って配置された。MilvusはZilliz(クラウド)上ではさらに高速だが、ハッカソン中は会場内で無線LANが繋がりにくかった。

ミルバスのベスト・ユース 第2位

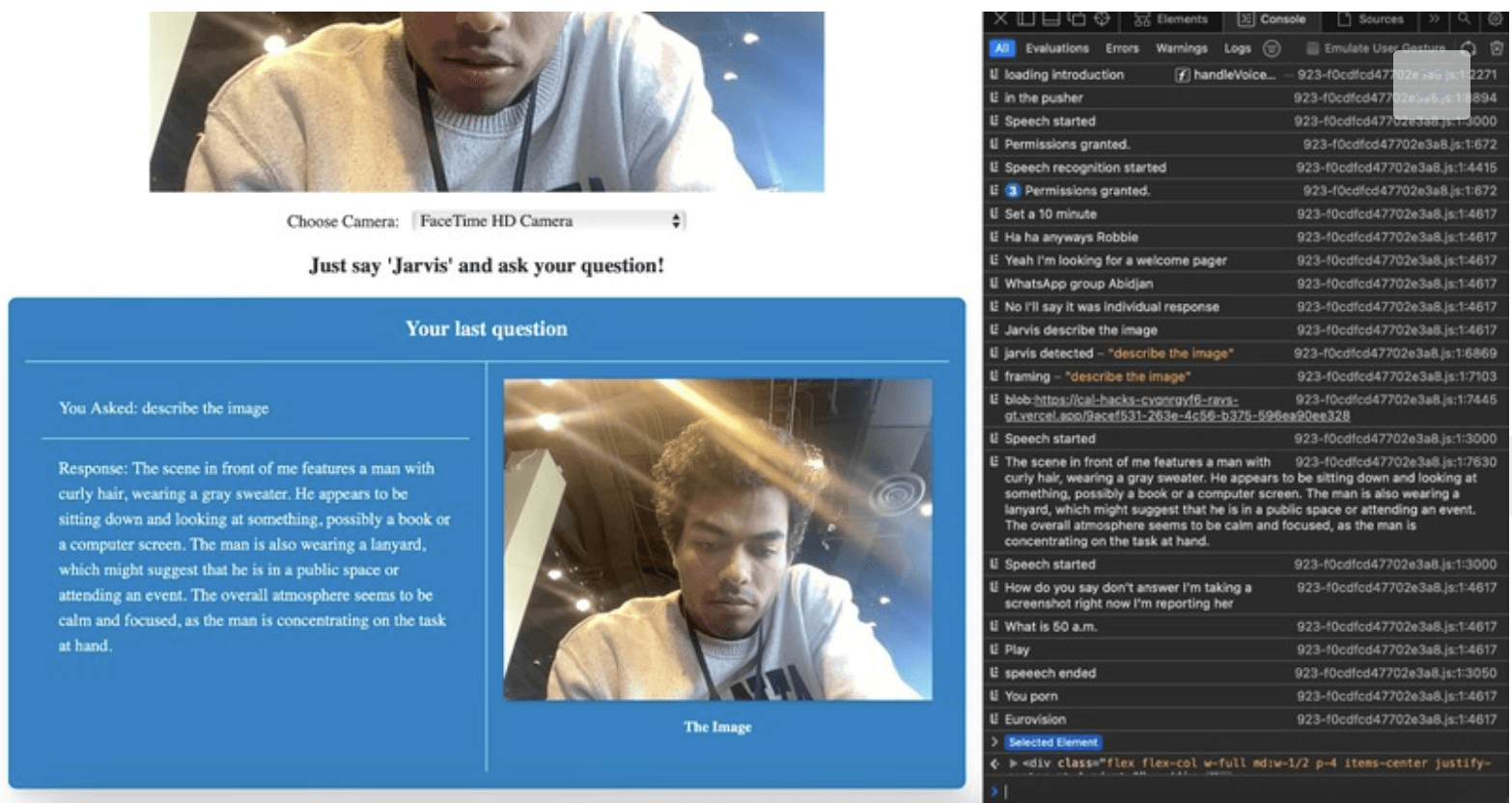

第2位は、プロジェクトJarvis。による

Dhruv Roongta](https://www.linkedin.com/in/dhruv-roongta-421a7b214/) (BS CS '27 ジョージア工科大学)

Arnav Chintawar](https://www.linkedin.com/in/arnav-chintawar/) (BS CS '27 ジョージア工科大学)

シャンタヌ・オベロイ](https://www.linkedin.com/in/shanttanu-oberoi-5a808628a/) (BTech Engineering Physics '26 IIT Bombay)

サヒブ・シン](https://www.linkedin.com/in/sahib-singh-a4289b236/) (BS CS '27 ジョージア工科大学)

彼らが行ったこと:* 彼らは、視覚的に何が起こっているかについてのユーザーの要求や質問に基づいて、カメラが見ているものを説明するシステムを構築した。ユーザーのリクエストは音声からテキストに変換される(Siri/Alexaに似ている)。同時にカメラからの画像もテキストに変換される。最終的に音声合成は、視覚障害者に何が起こっているかを説明することができる。

このモデルは顔の表情を認識し、視覚障害者に社会的な手がかりを提供することができる。ユーザーは、メニューから何を注文するか、複雑な公共交通機関の地図をナビゲートするなど、重要な推論を必要とする質問をすることができる。システムはAmazfitに拡張され、ユーザーはワンプッシュで周囲の説明を得たり、周囲の人々を識別したりできるようになった。

カメラに近づくと、私が眼鏡をかけた女性で、おそらく裁判官であることがわかった。

**Hume、LlaVa、OpenCV、Resnet-50、next.jsを使ってフロントエンドを作り、Amazfitスマートウォッチを使ってZeppOSで構築した。Zilliz(クラウド)を使ってMilvusをオンラインでホストし、画像のデータセットとそのベクトル埋め込みを保存した。Zillizの逆画像検索ツールを使ってID分類ツールを構築するために、各画像を人物として分類した。最小の閾値が設定され、それ以下では人物の身元は認識されない、つまりそのデータはZillizに存在しない。このモデルの推定精度は約95%であった。

Milvusのベストユース - 入選1名

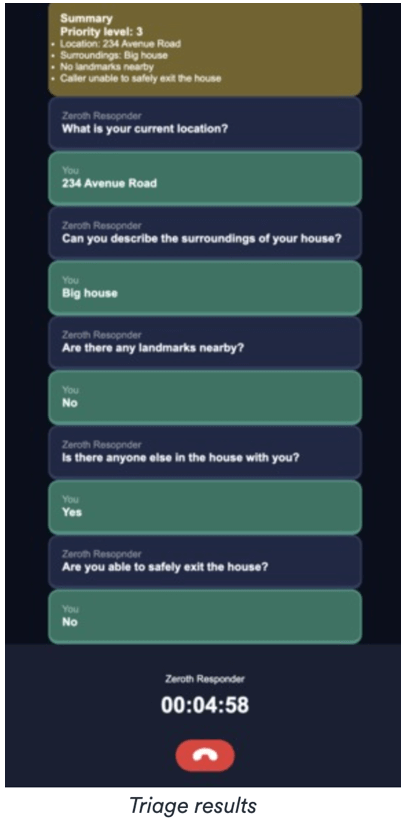

ゼロス・レスポンダー by

レオ・リュー](https://www.linkedin.com/in/leoliu12/) (BS CS '26 U Michigan College of Engineering)

ブライアン・トラヴィス](https://www.linkedin.com/in/brian-z-travis/) (BE CS '25 Uミシガン工科大学)

**911プロトコルに従い、AI911エージェントを構築し、通報者の話に耳を傾け、状況を判断し、フォローアップの質問をし、誰かが緊急の危険にさらされているかどうかを調べ、状況を評価し、分類し、緊急度を割り当てる。この緊急度は、リソース配分の優先順位を決める第0段階として使われる。最近起きたハワイ州ラハイナの火災では、最初の通報から救急隊が出動するまでに45分かかったとされている。

火災に巻き込まれたラハイナの通報者をシミュレートしたデモでは、このシステムは約15秒以内に危険な状況を判断することができた。

calhacks-2023-image4.png

calhacks-2023-image4.png

**911のトレーニングマニュアルのPDFをMilvusのベクトルデータベースに保存し、LLM(OpenAI)と連携してそれを照会し、通報者への応答を作成し、状況を評価する。古典的なRAGパターン。ローカルMilvusサーバーはDocker上で動作し、node.js SDKを使用。フルスタック:クライアント、サーバー、Milvus DBは、Reactの上に構築されたFastAPIとNextJSを使用。

##ベスト・ユース・オブ・Milvus - 入選2作品

メンタルマップ by

アニルド・パイ](https://www.linkedin.com/in/apai25/) (BS EECS '26 カリフォルニア大学バークレー校)

クシャル・コドナド](https://www.linkedin.com/in/kushal-kodnad/) (BS EECS '26 カリフォルニア大学バークレー校)

ルシル・デサイ](https://www.linkedin.com/in/rushil-desai-04/) (BS EECS '26 カリフォルニア大学バークレー校)

Raghav Punnam](https://www.linkedin.com/in/raghav-punnam/) (BS EECS '25 UC Berkeley)

彼らがしたこと:彼らは、あなたの感情や経験をチェックするAIチャットボットを作成しました。各インタラクションは感情分析の対象となり、アプリはユーザーの気分を抽出することができます。各週の終わりに、このアプリケーションはあなたの感情を分析し、週ごとのサマリーを作成し、自己認識を育み、より良い精神的健康を促進するために、あなたの精神的健康についての理解を深めるのを助ける。

https://assets.zilliz.com/calhacks_2023_image7_edae48ca48.png

**彼らは、毎日チャット・インターフェースに対するユーザーの感情的な反応を測定するために、テキストベースの感情分析にHume APIを使用した。BERT Hugging Faceモデルを使用して、ユーザーの反応を高次元ベクトル埋め込みに変換し、Milvusベクトル・データベースを使用して保存し、反応間の類似性検索を容易にした。フロントエンドには、React Nativeを利用してiOSアプリケーションを構築した。フロントエンドのFlask RESTサーバーは、HTTPリクエストの送信に「axios」を使用した。アプリケーションのナビゲーションは、ユーザー・セッションを安全に保存するデータベース・ナビゲーション・ルーターで制御された。

CalHacks](https://www.calhacks.io/)のオーガナイザーの皆さん、ありがとうございました!また、Zillizとのスポンサーシップの経験も素晴らしいものでした(CalHacksスポンサーオーガナイザーのChris Chouと私たちを巻き込んでくれたChris Churiloに感謝します)。

左上:映画館でのワークショップ。右:Zillizのスポンサーテーブルにて。左下:Zillizのスワッグソックス。他の画像ソースはすべて:CalHacks 2023.](https://assets.zilliz.com/calhacks_2023_image6_84637165a7.png)

読み続けて

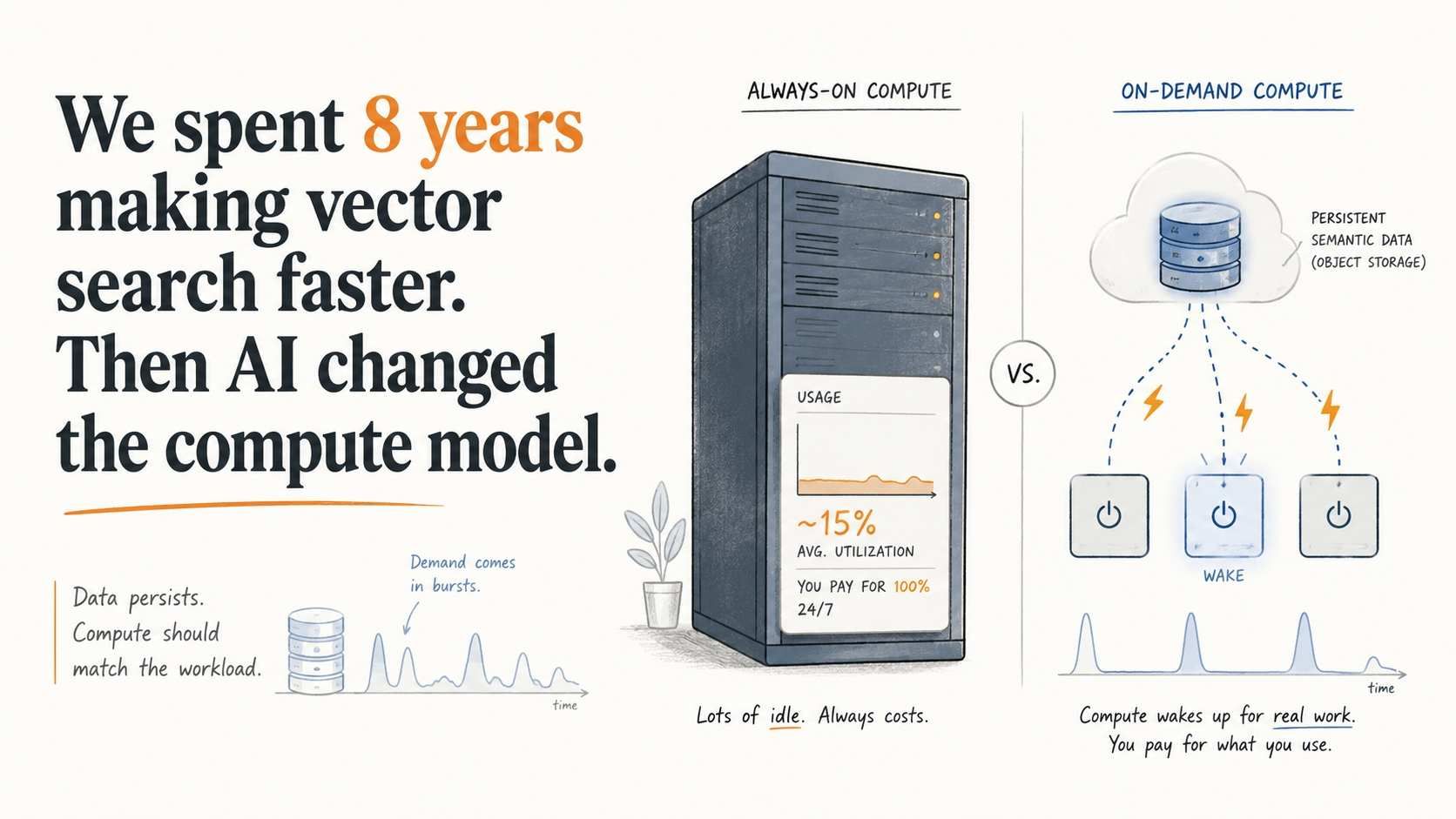

We spent 8 years making vector databases faster. Then we stopped.

Rarely queried embeddings still need to stay searchable. See how Vector Lakebase enables on-demand vector search without always-on compute costs.

Zilliz Named "Highest Performer" and "Easiest to Use" in G2's Summer 2025 Grid® Report for Vector Databases

Zilliz shines in G2's Summer 2025 Grid® Report as both "Highest Performer" and "Easiest to Use," solving the performance-usability dilemma.

What Exactly Are AI Agents? Why OpenAI and LangChain Are Fighting Over Their Definition?

AI agents are software programs powered by AI that can perceive their environment, make decisions, and take actions to achieve a goal—often autonomously.