SuperGLUE: Ein umfassender Benchmark für fortgeschrittene NLP-Auswertung

SuperGLUE: Ein umfassender Benchmark für fortgeschrittene NLP-Auswertung

TL; DR

SuperGLUE (Super General Language Understanding Evaluation) ist ein Benchmark zur Bewertung der Leistung von Modellen zum Verstehen natürlicher Sprache (NLU). Aufbauend auf seinem Vorgänger GLUE führt er anspruchsvollere Aufgaben ein, um die Fähigkeit eines Modells zu bewerten, komplexe linguistische Schlussfolgerungen zu ziehen, wie z. B. die Beantwortung von Fragen, die Auflösung von Koreferenzen und die Inferenz. SuperGLUE umfasst eine Vielzahl von Datensätzen und Metriken und testet Fähigkeiten wie kontextuelles Verständnis, Wissensabfrage und Multi-Task-Lernen. Er wurde entwickelt, um die Grenzen von NLU zu erweitern und spiegelt Aufgaben wider, die dem menschlichen Denken näher kommen. Eine hohe Punktzahl bei SuperGLUE zeigt die Robustheit und Effektivität eines Modells bei der Bewältigung realer sprachlicher Herausforderungen.

Einleitung

Die Verarbeitung natürlicher Sprache (NLP) hat die Art und Weise verändert, wie Maschinen mit Menschen interagieren, von Chatbots bis hin zu Empfehlungssystemen. Modelle wie ELMo, BERT und GPT haben die Grenzen des Sprachverständnisses neu definiert und die Modellierung und das Verständnis menschlicher Sprache verbessert. Diese Veränderungen ebneten den Weg für den GLUE -Benchmark, ein systematisches Bewertungsverfahren, das die Kompetenz von Sprachmodellen bei verschiedenen Aufgaben beurteilt.

Je intelligenter die NLP-Modelle werden, desto schwieriger wird die Aufgabe, die sich uns stellt. Hier setzt ****[SuperGLUE] (https://super.gluebenchmark.com/) an - mit größeren, anspruchsvolleren Zielen stellt es eine neue Reihe von Aufgaben, die auf logischem Denken, Verstehen mit gesundem Menschenverstand und nuancierter kontextbezogener Interpretation basieren. SuperGLUE testet die Fähigkeit eines jeden Modells, schwierige, reale Sprachprobleme zu lösen, und stellt damit die NLP-Modelle auf eine viel härtere Probe.

In diesem Artikel gehen wir auf die einzigartigen Merkmale von SuperGLUE ein, auf die Aufgaben, die es umfasst, und darauf, wie es die Entwicklung von noch anspruchsvolleren und zuverlässigeren NLP-Modellen vorantreibt.

*# Was ist SuperGLUE?

[SuperGLUE] (https://arxiv.org/abs/1905.00537), kurz für Super General Language Understanding Evaluation, ist ein Benchmark, der entwickelt wurde, um zu testen, wie gut NLP-Modelle ein breites Spektrum an komplexen Sprachverstehensaufgaben bewältigen. Es handelt sich im Wesentlichen um eine verbesserte Version von GLUE, die die Messlatte höher legen soll. Während sich GLUE auf einfachere Aufgaben konzentriert, enthält SuperGLUE anspruchsvollere Aufgaben, die tieferes Denken, Wissen über den gesunden Menschenverstand und Verständnis für den Kontext erfordern. Während bei einer GLUE-Aufgabe beispielsweise geprüft wird, ob zwei Sätze semantisch ähnlich sind, müssen bei einer SuperGLUE-Aufgabe wie der Winograd Schema Challenge (WSC) mehrdeutige Pronomen mit Hilfe des gesunden Menschenverstands aufgelöst werden.

SuperGLUE behält zwei der anspruchsvollsten Aufgaben von GLUE (RTE und WNLI) bei und führt sechs völlig neue Aufgaben ein, die darauf abzielen, die Modelle über den einfachen Mustervergleich hinaus zu bringen und semantisches und pragmatisches Wissen zu untersuchen.

Was sind die Ziele von SuperGLUE?

Testing Advanced Reasoning: SuperGLUE geht über die grundlegende Sprachverarbeitung hinaus - es wurde entwickelt, um zu sehen, ob Modelle schlussfolgern, Schlussfolgerungen ziehen und Commonsense-Wissen in komplexen Szenarien nutzen können.

NLP-Fortschritt fördern: Durch die Einführung schwierigerer Aufgaben motiviert SuperGLUE die Forscher, fortschrittlichere und leistungsfähigere maschinelle Lerntechniken zu entwickeln.

Im Gegensatz zu GLUE, das sich auf einfachere Aufgaben konzentriert, bietet SuperGLUE eine realistischere und umfassendere Möglichkeit zu testen, wie Modelle mit komplexen, realen Eingaben arbeiten.

Eine höhere Messlatte für NLP setzen: SuperGLUE wurde mit Blick auf die Zukunft entwickelt - es ist anspruchsvoll genug, dass selbst die besten Modelle von heute noch viel Raum für Verbesserungen haben, was es zu einem wertvollen Werkzeug für die Verfolgung von Fortschritten im NLP macht.

Wie SuperGLUE funktioniert

SuperGLUE bewertet NLP-Modelle, indem es ihre linguistischen Fähigkeiten herausfordert. Diese Aufgaben verlangen von den Modellen mehr als nur die Klassifizierung von Sätzen oder die Vorhersage einzelner Wörter - sie müssen sich mit der Komplexität der realen Welt auseinandersetzen. Dazu gehören die Auflösung von Koreferenzen (herausfinden, welche Wörter oder Phrasen sich auf dieselbe Sache beziehen), das Ziehen logischer Schlüsse aus dem Text und das Verstehen der Beziehungen zwischen Entitäten im Kontext. Bei jeder Aufgabe wird gemessen, wie gut die Modelle die nuancierten und anspruchsvollen Anforderungen der menschlichen Sprache bewältigen.

Detaillierter Überblick über die Aufgaben

SuperGLUE ist eine Obermenge von vielen Aufgaben, die wir in diesem Abschnitt behandeln werden. Davor werden wir verschiedene Bewertungsmetriken sehen, die erforderlich sind, um die Leistung des Modells zu bewerten.

Bewertungsmetriken

SuperGLUE verwendet je nach Aufgabe verschiedene Bewertungsmetriken:

Exakte Übereinstimmung (EM): Wird für Aufgaben verwendet, um zu bewerten, ob die vorhergesagte Antwort genau mit der erwarteten Antwort übereinstimmt.

F1 Score: Misst die Präzision und die Wiedererkennung, wenn mehrere richtige Antworten möglich sind.

Genauigkeit: Der Anteil der richtig vorhergesagten Beispiele, der bei einfacheren Klassifizierungsaufgaben wie BoolQ verwendet wird.

Makro-gemittelter F1-Wert: Ein Durchschnitt der F1-Werte über alle Klassen hinweg, der eine ausgewogene Bewertung auch bei unausgewogenen Klassen gewährleistet.

Abbildung- SuperGLUE Benchmark- Übersichtstabelle der SuperGLUE Aufgaben, einschließlich Korpusgrößen, Metriken und Textquellen für jede Aufgabe..png](https://assets.zilliz.com/Figure_Super_GLUE_Benchmark_Summary_table_of_Super_GLUE_tasks_including_corpus_sizes_metrics_and_text_sources_for_each_task_3ba1fdfde9.png)

Abbildung: SuperGLUE Benchmark: Zusammenfassende Tabelle der SuperGLUE-Aufgaben, einschließlich der Korpusgrößen, Metriken und Textquellen für jede Aufgabe.

Schauen wir uns den detaillierten Überblick über die Aufgaben von SuperGLUE an, um die Tiefe und Vielfalt der Herausforderungen zu verstehen.

- BoolQ (Boolesche Fragen)

BoolQ ist eine binäre Frage-Antwort-Aufgabe, bei der das Modell anhand einer gegebenen Passage bestimmt, ob eine Ja/Nein-Frage wahr ist. Hier sind die Eingabe, die Ausgabe und die Metrik der Aufgabe:

| Input | Output | Metrik |

|---|---|---|

| Eine Passage und eine Ja/Nein-Frage zu dieser Passage. | Ein boolescher Wert (Wahr für Ja, Falsch für Nein). | Genauigkeit |

Hier ist ein Beispiel:

Passage: "Barq's ist ein Erfrischungsgetränk, das Koffein enthält und von Coca-Cola abgefüllt wird."

Frage: "Enthält Barq's Root Beer Koffein?"

Ausgabe: True

- CB (CommitmentBank)

Bei CB wird bewertet, ob eine eingebettete Klausel innerhalb eines Textes wahrscheinlich wahr (entailment), falsch (contradiction) oder unbestimmt (neutral) ist.

| Input | Output | Metrik |

|---|---|---|

| Eine Prämisse und eine Hypothese. | Ein Etikett (Folgerung, neutral oder Widerspruch). | Genauigkeit und makrogemittelter F1. |

Hier ist ein Beispiel:

Premise: "Sie sagte, sie würde vielleicht an der Sitzung teilnehmen."

Hypothese: "Sie wird mit Sicherheit an dem Treffen teilnehmen."

Output: Widerspruch

- COPA (Choice of Plausible Alternatives)

COPA ist eine Aufgabe zum kausalen Schlussfolgern, bei der das Modell die plausibelste Ursache oder Wirkung einer gegebenen Prämisse aus zwei Alternativen bestimmt.

| Input | Output | Metrik |

|---|---|---|

| Eine Prämisse und zwei Alternativen (Ursache/Wirkung). | Die plausiblere Alternative (1 oder 2). | Genauigkeit |

Schauen wir uns ein Beispiel an:

Prämisse: "Das Gras ist nass."

Alternative 1: "Es hat gestern Abend geregnet."

Alternative 2: "Die Sonne hat hell geschienen."

Ausgabe: 1

- MultiRC (Multi-sentence Reading Comprehension)

Bei [MultiRC] (https://paperswithcode.com/dataset/multirc) müssen Fragen zu einem Text beantwortet werden, wobei jede Frage mehrere richtige Antworten haben kann.

| Input | Output | Metrik |

|---|---|---|

| Eine Passage, eine Frage und eine Reihe von möglichen Antworten. | Ein binäres Label (Wahr oder Falsch) für jede Antwort. | F1 und Genaue Übereinstimmung. |

Hier ist ein einfaches Beispiel:

Passage: "Susan lud ihre Freunde zu einer Party ein. Eine ihrer Freundinnen war krank, kam aber später."

Frage: "Hat der kranke Freund die Party besucht?"

Antworten: "Ja", "Nein"

Ausgabe: Ja

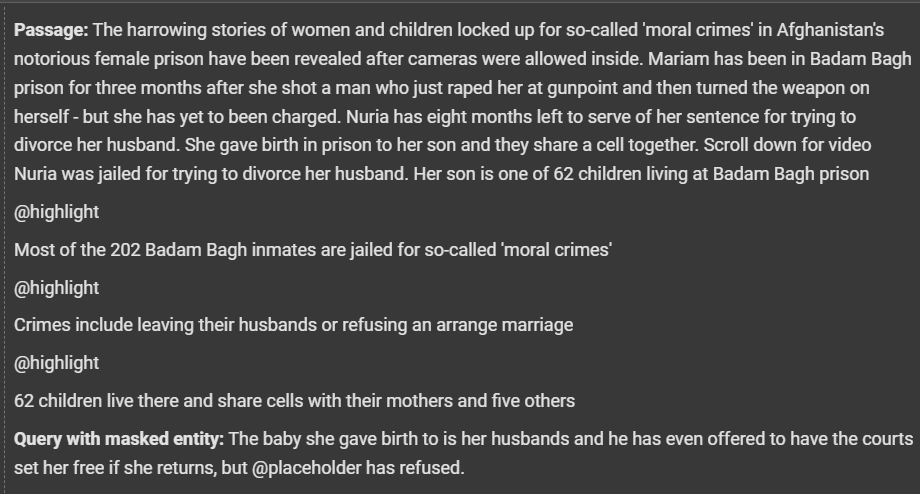

- ReCoRD (Reading Comprehension with Commonsense Reasoning Dataset)

[ReCoRD] (https://paperswithcode.com/dataset/record) ist eine Leseverstehensaufgabe im Cloze-Stil, bei der der gesunde Menschenverstand gefragt ist, um maskierte Einheiten in einem Text vorherzusagen.

| Input | Output | Metrik |

|---|---|---|

| Eine Passage mit maskierten Entitäten und eine Abfrage. | Die richtige Entität aus einer Liste von Kandidaten. | F1 und EM. |

Hier ist ein einfaches Beispiel:

Passage: "Tesla wurde von

Frage: "Wer hat Tesla gegründet?"

Kandidaten: "Elon Musk", "Nikola Tesla", "Thomas Edison"

Ausgabe: Elon Musk

- RTE (Recognizing Textual Entailment)

RTE bestimmt, ob eine Hypothese auf der Grundlage einer gegebenen Prämisse wahr, falsch oder unbestimmt ist.

| Input | Output | Metrik |

|---|---|---|

| Eine Prämisse und eine Hypothese. | Ein Etikett (Folgerung, neutral oder Widerspruch). | Genauigkeit |

Hier ist ein Beispiel:

Prämisse: "Dana Reeve, die Witwe von Christopher Reeve, ist im Alter von 44 Jahren verstorben."

Hypothese: "Dana Reeve war 44 Jahre alt, als sie starb."

Output: Entailment

- WiC (Word-in-Context)

WiC testet die Disambiguierung des Wortsinns, indem es feststellt, ob ein Wort in zwei verschiedenen Kontexten mit der gleichen Bedeutung verwendet wird.

| Input | Output | Metrik |

|---|---|---|

| Zwei Sätze, die das gleiche Zielwort enthalten. | Ein binäres Label (Wahr für denselben Sinn, Falsch für einen anderen Sinn). | Genauigkeit |

Schauen wir uns ein Beispiel an:

Satz 1: "Er nagelte die Bretter an die Wand."

Satz 2: "Das Schachbrett war schön gearbeitet."

Zielwort: "Brett"

Ausgabe: False

- WSC (Winograd Schema Challenge)

WSC ist eine Aufgabe zur Auflösung von Koreferenzen, bei der das Modell den korrekten Referenten eines mehrdeutigen Pronomens mit Hilfe des gesunden Menschenverstands identifiziert.

| Input | Output | Metrik |

|---|---|---|

| Ein Satz, der ein mehrdeutiges Pronomen enthält. | Der richtige Referent. | Genauigkeit |

Hier ist ein Beispiel:

Satz: "Mark hat Ted ein Buch geschenkt, aber es hat ihm nicht gefallen."

Pronomen: "er"

Ausdruck: Ted

Die oben genannten Aufgaben in SuperGLUE stellen NLP-Modelle vor Herausforderungen, die über das reine Sprachverständnis hinausgehen, für das jedes System differenzierte Schlussfolgerungen ziehen und reale Probleme lösen soll. Daher bewertet SuperGLUE das Modell auf der Grundlage von Verständnis, Schlussfolgerungen und der effektiven Anwendung von gesundem Menschenverstand. Es bietet einen umfassenden Bewertungsrahmen, der sowohl die Präzision als auch die Wiederauffindbarkeit von Modellen für verschiedene Sprachverständnis-Herausforderungen erfasst.

Beispiel für die Implementierung

Nachfolgend ein Beispiel für das Laden und die Interaktion mit der SuperGLUE Aufgabe ReCoRD unter Verwendung der Hugging Face Bibliothek:

from datasets import load_dataset

# Lade die ReCoRD Aufgabe von SuperGLUE

dataset = load_dataset("super_glue", "record", trust_remote_code = True

)

# Zugriff auf die Trainingsdaten

train_data = dataset['train']

# Beispiel-Datenpunkt

Beispiel = train_data[0]

print(f "Passage: {example['passage']}")

print(f "Abfrage mit maskierter Entität: {example['query']}")

Die Funktionload_dataset lädt die ReCoRD Aufgabe. Die Eingabe umfasst eine Passage und eine Abfrage mit einer maskierten Entität, die aufgelöst werden muss. Das Modell soll die maskierte Entität korrekt vorhersagen und so seine Fähigkeit unter Beweis stellen, die Passage zu verstehen und vernünftige Schlussfolgerungen zu ziehen.

Abbildung- Ausgabe des implementierten Beispiels.png

Abbildung- Ausgabe des implementierten Beispiels.png

Abbildung: Ausgabe des implementierten Beispiels

SuperGLUE vs. GLUE: Hauptunterschiede

SuperGLUE verbessert GLUE durch die Einführung wesentlich anspruchsvollerer Aufgaben, die das reale Sprachverständnis widerspiegeln.

| Features | GLUE | SuperGLUE |

|---|---|---|

| Aufgabenkomplexität | Grundlegende linguistische Aufgaben (z. B. Stimmungsanalyse) | Komplexe Aufgaben, die logisches Denken und gesunden Menschenverstand erfordern |

| Datensatzsättigung | Leistung nahe dem menschlichen Niveau | Viel Spielraum für Modellverbesserungen |

| Reasoning-Anforderungen | Minimales Reasoning erforderlich | High-Level-Reasoning und Inferenz sind notwendig |

| Aufgabenvielfalt | Hauptsächlich Satzklassifizierungs- und Ähnlichkeitsaufgaben | Beinhaltet QA, Koreferenz und Leseverständnis |

| Real-World Application | Begrenzte Reflexion der realen Welt | Aufgaben, die reale sprachliche Herausforderungen nachahmen sollen |

Vorteile und Herausforderungen von SuperGLUE

SuperGLUE ersetzt die Art und Weise, wie NLP-Modelle bisher bewertet wurden, indem es den Schwerpunkt auf ihre Fähigkeit verlagert, Aufgaben in der realen Welt nuanciert zu lösen, die logisches Denken und erweiterten Kontext erfordern. Diskutieren wir einige konkrete Vorteile, die SuperGLUE für NLP mit sich bringt, und die Herausforderungen, denen sich Forscher gegenübersehen, wenn sie das Potenzial von SuperGLUE voll ausschöpfen wollen.

Vorteile

Tests Reasoning und Commonsense: SuperGLUE enthält Aufgaben, die von den Modellen verlangen, dass sie Commonsense-Wissen nutzen. Zum Beispiel testet die Winograd Schema Challenge (WSC) die Auflösung von Pronomen mit Hilfe von Commonsense, während die COPA-Aufgabe das kausale Denken durch die Wahl der plausibelsten Ursache oder Wirkung in einem gegebenen Szenario bewertet. Durch diese Aufgaben werden die Fähigkeiten der Schüler in realen Szenarien verbessert.

Durch die Einbeziehung komplexerer Aufgaben überwindet SuperGLUE die Sättigung von GLUE, bei der die Modelle bei einfacheren Aufgaben nahezu menschliche Leistungen erzielten, was es weniger effektiv für die Unterscheidung von Fortschritten machte.

Fördert die Erklärbarkeit von Modellen: Die komplexen Aufgaben von SuperGLUE fördern die Entwicklung von Modellen, die gute Leistungen erbringen und besser interpretierbare Ergebnisse liefern, was Forschern hilft zu verstehen, wie und warum Modelle bestimmte Vorhersagen machen.

Reflektiert Probleme der realen Welt: Die Aufgaben von SuperGLUE sind so konzipiert, dass sie die Probleme widerspiegeln, denen Modelle in Anwendungen wie Leseverständnis und Dialogsystemen begegnen. Zum Beispiel testet die ReCoRD-Aufgabe den gesunden Menschenverstand, um fehlende Informationen abzuleiten, während WSC das Auflösen von mehrdeutigen Pronomen evaluiert - wichtige Fähigkeiten für virtuelle Assistenten und KI im Dialog.

Bietet aufschlussreiche Fehleranalysen: SuperGLUE ermöglicht es Forschern zu untersuchen, wie und wo Modelle versagen, indem es verschiedene und anspruchsvolle Aufgaben bereitstellt, die spezifische Schwächen hervorheben. Diese detaillierte Fehleranalyse hilft bei der Identifizierung von Bereichen, in denen Modelle Schwierigkeiten haben, z. B. beim logischen Denken, beim Verstehen von Zusammenhängen oder beim Verstehen von Kontexten, was gezielte Verbesserungen ermöglicht, um die Modelle robuster und zuverlässiger zu machen.

Herausforderungen

Hohe Rechenkosten: Das Training von Modellen auf SuperGLUE kann aufgrund der Komplexität der Aufgaben rechenintensiv sein. Die Verwendung optimierter Architekturen und Cloud-basierter Infrastrukturen kann helfen, den Ressourcenbedarf effektiv zu verwalten.

Komplexe Feinabstimmung: Jede Aufgabe in SuperGLUE kann unterschiedliche Feinabstimmungsstrategien erfordern. Multi-Task-Learning-Ansätze und Transfer-Learning können helfen, diesen Prozess zu rationalisieren. Beim Multi-Task-Lernen wird ein Modell auf verwandte Aufgaben trainiert, um die Generalisierung zu verbessern, während beim Transfer-Lernen das Wissen aus einer Aufgabe zur Verbesserung der Leistung bei einer anderen angewendet wird, wodurch die Notwendigkeit umfangreicher Daten und Schulungen minimiert wird.

Kleine Datensätze: Einige SuperGLUE-Aufgaben verfügen über begrenzte Daten, was das Risiko einer Überanpassung der Modelle während des Trainings erhöht. Diese Herausforderung kann durch den Einsatz von Techniken wie Datenerweiterung zur Schaffung vielfältigerer Trainingsmuster und Regularisierung zur Verbesserung der Modellgeneralisierung angegangen werden.

Überbetonung der Ranglisten: Die Ranglisten zeigen zwar die Leistung des Modells, aber die ausschließliche Konzentration auf diese Ergebnisse kann vom praktischen Wert des Modells ablenken. Eine Verlagerung der Aufmerksamkeit auf reale Anwendungen trägt dazu bei, dass die Modelle in praktischen Szenarien wettbewerbsfähig und wirkungsvoll sind.

Schwieriger Vergleich von Ergebnissen: Die Variabilität von Implementierungen, Hardware und Hyperparametern kann es schwierig machen, die Ergebnisse verschiedener Forschungsgruppen fair zu vergleichen. Durch die Standardisierung von Bewertungsprotokollen, die gemeinsame Nutzung von Codebasen und die Verwendung gemeinsamer Benchmarks können wir konsistentere und fairere Vergleiche erzielen.

Anwendungsfälle für SuperGLUE

SuperGLUE ist ein wichtiger Benchmark, der zur Verbesserung von NLP beiträgt, indem er Modelle mit Aufgaben herausfordert, die auf der Komplexität der realen Welt basieren. Beispiele für solche Anwendungen reichen von der Entwicklung besserer KI und logischer Systeme bis hin zur semantischen Suche.

SuperGLUE hat zahlreiche Anwendungen im NLP und darüber hinaus:

Konversations-KI: SuperGLUE fördert die Entwicklung virtueller Assistenten, indem es Benchmarks bereitstellt, die die Fähigkeit der Modelle testen, nuancierte Anfragen mit besserer Argumentation und gesundem Menschenverstand zu verstehen.

Advanced Reasoning Systems: SuperGLUE unterstützt die Entwicklung von Tools zur Entscheidungsunterstützung, indem es die logischen Schlussfolgerungsfähigkeiten der Modelle bewertet und verbessert.

Leseverständnis: SuperGLUE versetzt NLP-Modelle in die Lage, lange Dokumente genau zu analysieren und zusammenzufassen, indem es sie mit Aufgaben konfrontiert, die ein fortgeschrittenes Verständnis und kontextuelles Verstehen erfordern, und so Forschung und Bildung unterstützt.

Wissensrepräsentation und Inferenz: SuperGLUE hilft beim Aufbau robusterer Wissensgraphen, indem es die Fähigkeit der Modelle testet, Beziehungen zu verstehen und vernünftige Schlussfolgerungen zu ziehen, und unterstützt so Suchmaschinen und Empfehlungssysteme.

Semantische Suche und Vektordatenbanken: SuperGLUE verbessert die Genauigkeit der semantischen Suche, indem es die Modelle in die Lage versetzt, komplexe, groß angelegte Aufgaben der Informationsgewinnung effektiv zu bewältigen.

Tools zur Unterstützung von SuperGLUE

Die fortgeschrittenen Aufgaben und Benchmarks von SuperGLUE haben zur Entwicklung weiterer Tools und Plattformen geführt, die die Implementierung und Bewertung von SuperGLUE erleichtern sollen. Diese Werkzeuge helfen Forschern und Entwicklern, bessere Entscheidungen über den Zugriff auf Daten, das Training von Modellen und die Analyse von Ergebnissen zu treffen.

Schauen wir uns die Tools an, die die Einführung und Interaktion mit SuperGLUE unterstützen und verbessern.

Werkzeuge

Hugging Face Datasets: Bietet eine einfache Möglichkeit, SuperGLUE-Aufgaben zu laden und mit ihnen zu interagieren, was die Modellentwicklung und -prüfung vereinfacht.

TensorFlow-Datensätze: Bietet vorformatierte Versionen von SuperGLUE-Aufgaben, die sich gut mit TensorFlow-basierten Modellen integrieren lassen.

AllenNLP: Liefert Module und Komponenten für NLP-Aufgaben, die das Experimentieren mit SuperGLUE vereinfachen.

KI-Modelle mit SuperGLUE evaluieren und mit RAG erweitern

Benchmarks wie SuperGLUE sind unerlässlich, um die Fähigkeiten von großen Sprachmodellen (LLMs) zu bewerten. Sie bieten einen standardisierten Rahmen, um die Leistung eines Modells über verschiedene Aufgaben hinweg zu messen und erleichtern direkte Vergleiche zwischen Modellen. Durch das Hervorheben von Stärken, wie z. B. logisches Denken, und das Aufzeigen von Schwächen, wie z. B. Schwierigkeiten mit komplexem logischen Denken oder domänenspezifischen Aufgaben, hilft SuperGLUE den Forschern, Bereiche für Verbesserungen zu identifizieren. Diese Erkenntnisse ermöglichen eine Feinabstimmung, die das Verständnis eines Modells und die Fähigkeit zur Generierung von Inhalten verbessert.

Obwohl SuperGLUE für die Verbesserung von LLMs wertvoll ist, ist es kein Allheilmittel. LLMs haben inhärente Beschränkungen, unabhängig davon, wie gut sie bei Benchmarks abschneiden. Sie werden auf statischen, Offline-Datensätzen trainiert und haben keinen Zugang zu Echtzeit- oder domänenspezifischen Informationen. Dies kann zu [Halluzinationen] (https://zilliz.com/glossary/ai-hallucination) führen, bei denen Modelle ungenaue oder erfundene Antworten erzeugen. Diese Unzulänglichkeiten werden noch problematischer, wenn es um proprietäre oder hochspezialisierte Abfragen geht.

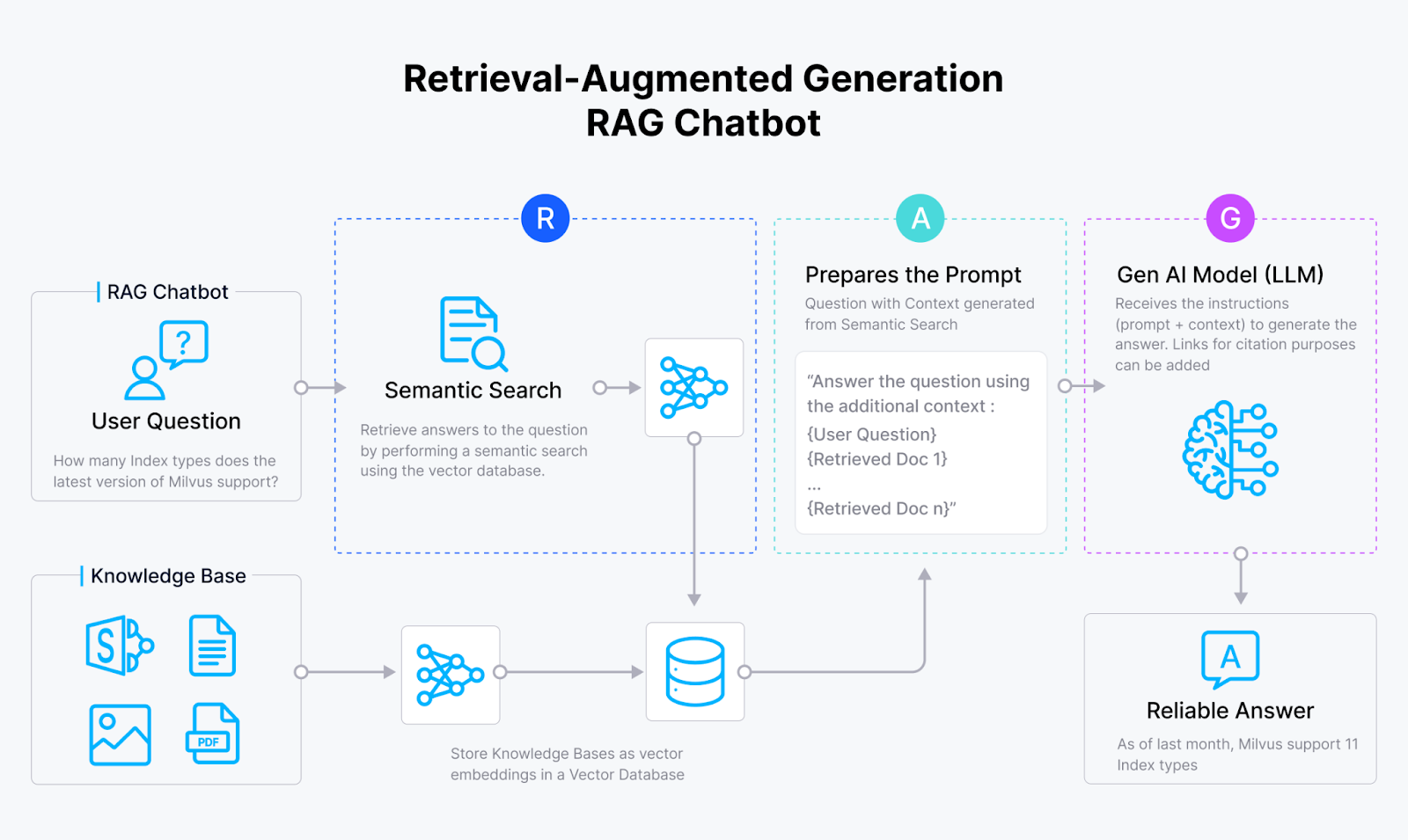

Einführung von RAG: Eine Lösung zur Verbesserung von LLM-Antworten

Um diese Herausforderungen anzugehen, bietet [Retrieval-Augmented Generation (RAG)] (https://zilliz.com/learn/Retrieval-Augmented-Generation) eine leistungsstarke Lösung. RAG verbessert große Sprachmodelle (LLMs) durch die Kombination ihrer generativen Fähigkeiten mit der Fähigkeit, domänenspezifische Informationen aus externen Wissensdatenbanken abzurufen, die in einer Vektordatenbank wie Milvus oder Zilliz Cloud gespeichert sind. Wenn ein Benutzer eine Frage stellt, durchsucht das RAG-System die Datenbank nach relevanten Informationen und verwendet diese Informationen, um eine genauere Antwort zu generieren. Schauen wir uns nun an, wie der RAG-Prozess funktioniert.

Abbildung- RAG Arbeitsablauf.png

Abbildung- RAG Arbeitsablauf.png

Ein RAG-System besteht in der Regel aus drei Hauptkomponenten: einem Einbettungsmodell, einer Vektor-Datenbank und einem LLM.

Das Einbettungsmodell konvertiert Dokumente in Vektoreinbettungen, die in einer Vektordatenbank wie Milvus gespeichert werden.

Wenn ein Benutzer eine Frage stellt, wandelt das System die Anfrage mit demselben Einbettungsmodell in einen Vektor um.

Die Vektordatenbank führt dann eine [Ähnlichkeitssuche] (https://zilliz.com/learn/vector-similarity-search) durch, um die relevantesten Informationen abzurufen. Diese abgerufenen Informationen werden mit der ursprünglichen Frage kombiniert, um eine "Frage mit Kontext" zu bilden, die dann an das LLM gesendet wird.

Der LLM verarbeitet diese angereicherte Eingabe, um eine genauere und kontextrelevante Antwort zu generieren.

Dieser Ansatz überbrückt die Lücke zwischen statischen LLMs und domänenspezifischen Echtzeitanforderungen.

FAQs von SuperGLUE

Was macht SuperGLUE schwieriger als GLUE? SuperGLUE baut auf GLUE auf, indem es Aufgaben zum logischen Denken und zum gesunden Menschenverstand einführt, die weit über die in GLUE enthaltenen Aufgaben hinausgehen.

Welche Modelle schneiden bei SuperGLUE am besten ab? Transformer-basierte Modelle zeichnen sich bei SuperGLUE durch ihren Selbstbeobachtungsmechanismus aus, der Kontext und weitreichende Abhängigkeiten erfasst, umfangreiches Vortraining auf großen Datensätzen, Skalierbarkeit und Anpassungsfähigkeit durch Transferlernen.

- Was sind die rechnerischen Anforderungen für SuperGLUE? Das Training von Modellen auf SuperGLUE erfordert aufgrund der Komplexität der Aufgaben, die eine umfangreiche Rechenleistung für die Feinabstimmung, die Schlussfolgerungen und den effektiven Umgang mit großen Datensätzen erfordern, erhebliche rechnerische Ressourcen.

Kann SuperGLUE auf domänenspezifische Aufgaben angewendet werden? Obwohl der Schwerpunkt auf der Verallgemeinerung liegt, ist eine Anpassung an spezifische Domänen durch zusätzliche Feinabstimmung mit domänenspezifischen Daten möglich.

Wie ist SuperGLUE für moderne KI-Anwendungen relevant? Es setzt einen Standard für die Bewertung von Modellen in realen Anwendungen wie semantische Suche und KI im Dialog.

Verwandte Ressourcen

A Beginner Guide to Natural Language Processing](https://zilliz.com/learn/A-Beginner-Guide-to-Natural-Language-Processing)

20 nützliche offene Datensätze für die Verarbeitung natürlicher Sprache

Was ist RAG? ](https://zilliz.com/learn/Retrieval-Augmented-Generation)

Was sind Vektordatenbanken und wie funktionieren sie? ](https://zilliz.com/learn/what-is-vector-database)

- TL; DR

- Einleitung

- Wie SuperGLUE funktioniert

- SuperGLUE vs. GLUE: Hauptunterschiede

- Vorteile und Herausforderungen von SuperGLUE

- Anwendungsfälle für SuperGLUE

- Tools zur Unterstützung von SuperGLUE

- KI-Modelle mit SuperGLUE evaluieren und mit RAG erweitern

- FAQs von SuperGLUE

- Verwandte Ressourcen

Inhalte

Kostenlos starten, einfach skalieren

Testen Sie die vollständig verwaltete Vektordatenbank, die für Ihre GenAI-Anwendungen entwickelt wurde.

Zilliz Cloud kostenlos ausprobieren