Zilliz Cloud PipelinesとVoyage AIでコード集約型テキストのための優れたRAGを構築する

埋め込みモデルはRetrieval Augmented Generation(RAG)の中核であり、主に検索能力に影響を与え、全体的な応答品質に極めて重要である。膨大なデータコーパスで学習された埋め込みモデルは、あらゆるテキストから意味の数値表現を抽出することができ、様々な情報検索タスクに適している。しかし、どのようなタスクにも優れた埋め込みモデルを学習することは、依然として非常に困難である。様々な埋め込みモデルが利用可能であり、それぞれがユニークな長所と短所を持ち、性質も様々である。

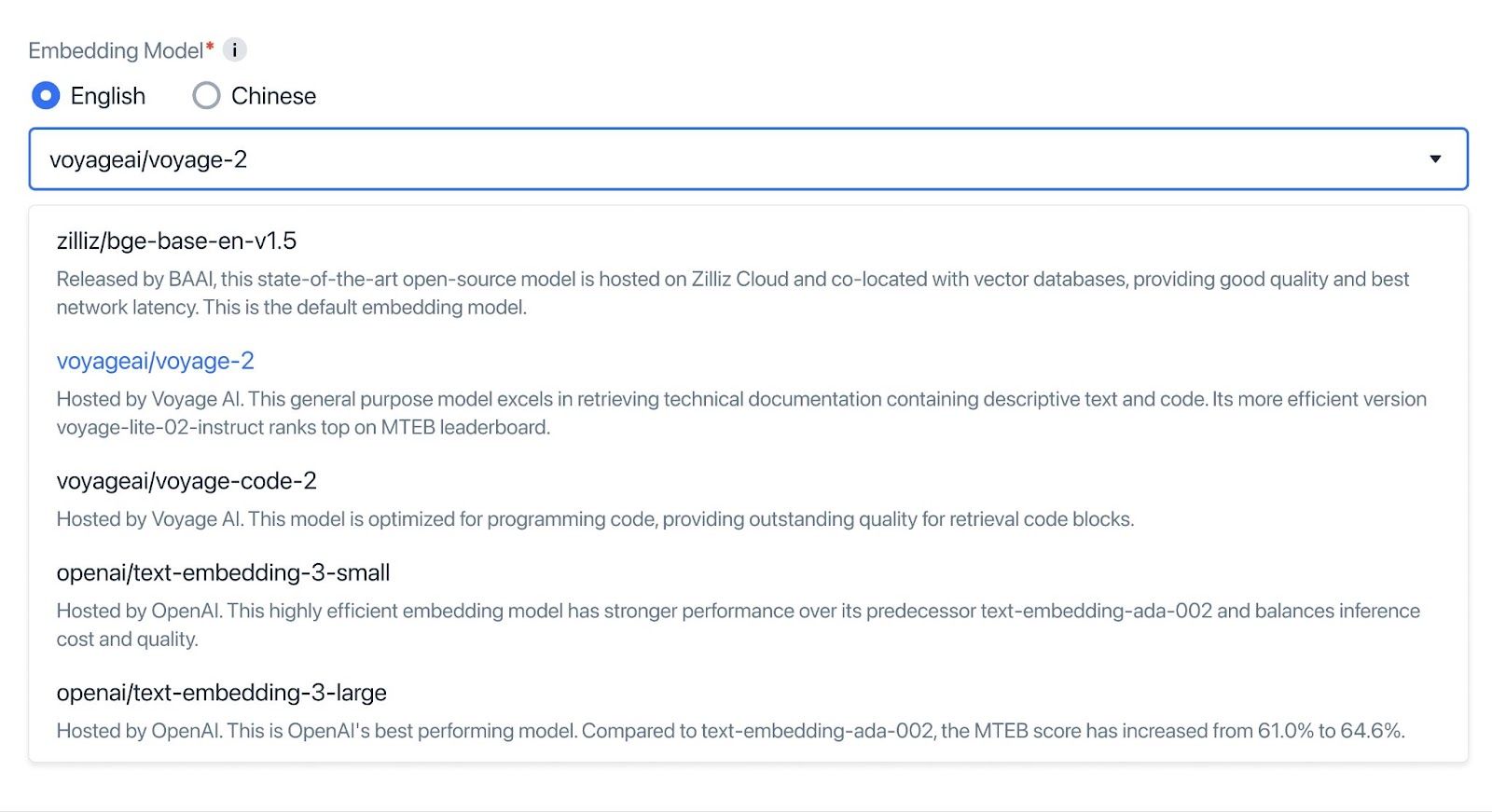

Zilliz Cloud Pipelinesは、利用可能な最良の埋め込みモデルを統合し、検索のためのワンストップ・ソリューションとして提供します。このような柔軟な選択肢により、開発者は特定のユースケースに合わせて最適なモデルを探索し、選択することができる。

本日、Voyage AIのエンベッディングモデルがZilliz Cloud Pipelinesで利用可能になったことを発表できることを嬉しく思います。リリースされたばかりのvoyage-2とvoyage-code-2モデルは、ソースコード、技術文書、一般的なタスクに関する検索タスクで優れた品質を実証しています。例えば、voyage-code-2は報告されているコード集約的なデータセットではOpenAIエンベッディングより14.52%優れており、一般的な目的では3.03%優れている。

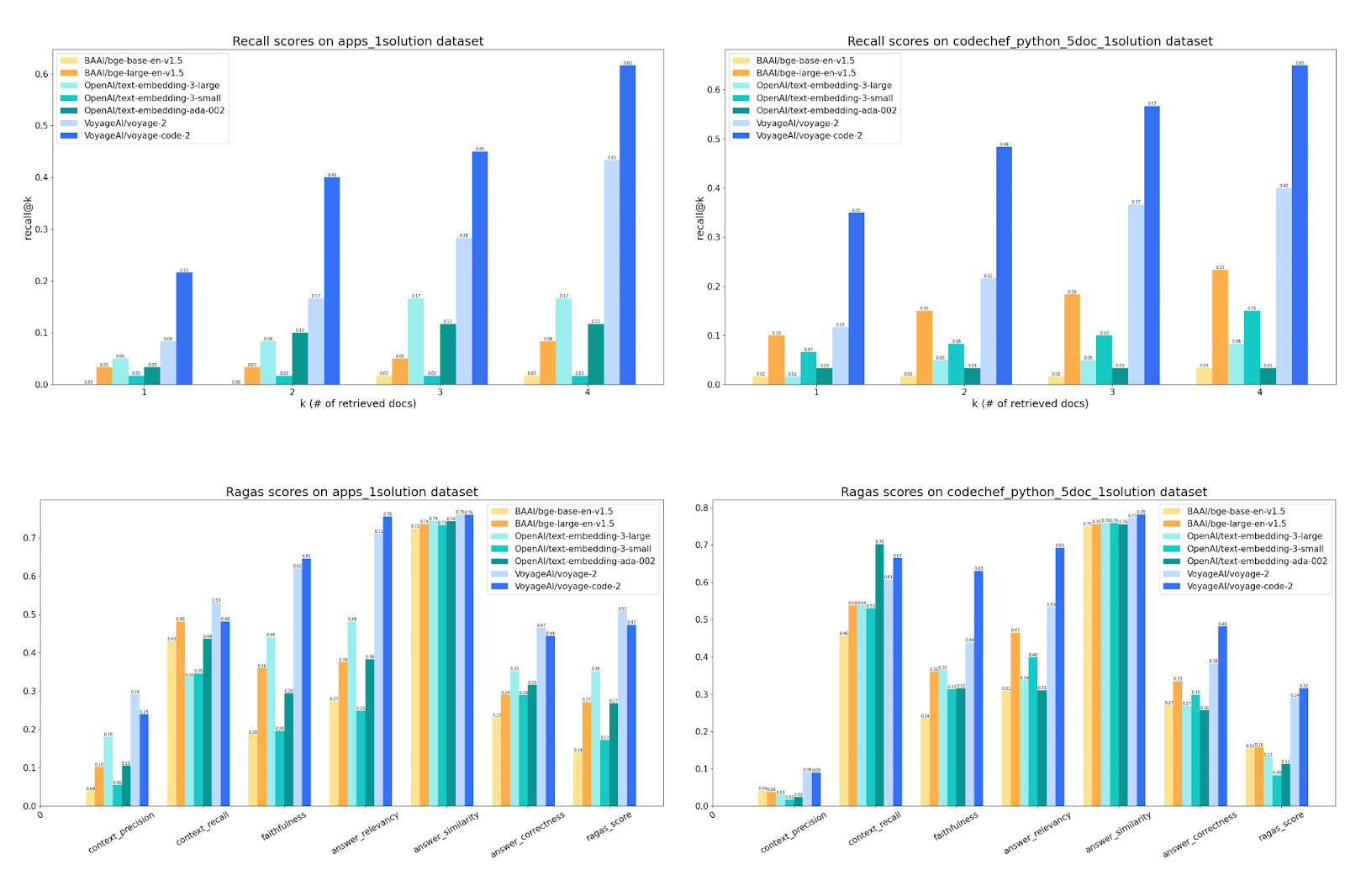

また、Voyage AIと共同で、コード関連のタスクに対して様々なエンベッディングモデルを実装したRAGシステムの有効性を評価しました。使用した言語モデルはGPT4である。我々はAPPSとCodechefデータセットのサブセットでシステムをテストした。これらのデータセットにはコーディングに関する質問が含まれており、各質問はコーパスから正確に1つの正解を持っている。我々は、検索品質を「recall@k」(検索された上位k個の文書で適切な結果を捕捉する確率)で測定する。さらに、RAGパイプラインの評価フレームワークとして有名なRagasを用いてエンドツーエンドの品質も評価する。これは、検索されたテキストの関連性と精度から、最終的な答えの正しさと品質に至るまで、RAGの様々な側面を記述する6つのメトリクスを持っている。Ragas Score」と呼ばれる6つのメトリクスの調和平均は、システムの全体的なパフォーマンスを測定します。各メトリクスの詳細についてはMilvusのドキュメントページをご覧ください。

コードデータセット上の一般的な埋め込みモデル間で検索と総合スコアを比較する。

上の2つの図は、voyages-2とvoyage-code-2モデルが他のモデルよりも検索能力が著しく優れていることを示している。スコア "Recall@k "は、上位k個の結果を検索するとき、返されたk個の結果にグランドトゥル スが含まれている可能性があることを示す。例えば、apps_1solution データセットでは、voyage-code-2 は 62% のケースでトップ 4 の結果にグランドトゥルースを含むが、bge-base-en-v1.5 は 2% のケースでしかそれを達成できない。これらのテストは、voyage-code-2 がコード関連のタスクにおいて、最適化されていない埋め込みモデルよりもはるかに優れた性能を発揮することを示している。

エンド・ツー・エンドのRAG解答に関しては、想起の向上は、最もパフォーマンスの高い代替案と比較して、解答の正しさとRagas Scoreにおいて10ポイント以上の利得につながる。特に、コンテキストプレシジョンとコンテキストリコールは、検索フェーズの効果を測定します。Voyageモデルは、特にContext Precisionにおいて、他の選択肢を大きく上回る。生成された回答の品質を測定する忠実性と回答の関連性では、Voyageは5%以上のポイントで他のモデルを上回っています。この結果は、より良い検索品質がより良いRAGパイプライン生成につながることを示している。解答の類似性と解答の正しさは、生成された解答とグランドトゥルースの間の意味的類似性の評価に関係する。答えの正しさでは、Voyageに基づくRAGが再び明らかに優位に立ち、他のものを5ポイント以上上回っている。

RAGは、コーディング問題やソフトウェア開発に関する質問回答ボットの主要なアプローチとなっている。これらのアプリケーションは、コード関連の検索タスクに秀でた高品質のVoyageモデルからさらに多くの恩恵を受けることができる。検索品質の向上は、コードや技術文書から関連情報をより的確に探し出すことにつながり、より正確な回答やより良いユーザーエクスペリエンスにつながります。

Zilliz Cloud Pipelinesでは、埋め込みモデルとしてvoyages-2とvoyage-code-2を選択できるようになり、DevOpsやMLインフラの管理を気にすることなく、コード関連のタスクで最高の検索品質を達成できるようになりました。一番の利点は、https://cloud.zilliz.com/signupからサインアップすることで無料で始めることができ、簡単かつ正確にRAGアプリケーションを構築できることです!

読み続けて

Build for the Boom: Why AI Agent Startups Should Build Scalable Infrastructure Early

Explore strategies for developing AI agents that can handle rapid growth. Don't let inadequate systems undermine your success during critical breakthrough moments.

Balancing Precision and Performance: How Zilliz Cloud's New Parameters Help You Optimize Vector Search

Optimize vector search with Zilliz Cloud’s level and recall features to tune accuracy, balance performance, and power AI applications.

Vector Databases vs. Document Databases

Use a vector database for similarity search and AI-powered applications; use a document database for flexible schema and JSON-like data storage.