Chain of Thought Prompting: AI Schritt für Schritt zum Denken anleiten

Chain of Thought Prompting: AI Schritt für Schritt zum Denken anleiten

Was ist Chain-of-Thought Prompting?

Chain-of-Thought (CoT) ist eine Prompt-Engineering Technik, die großen Large Language Models (LLMs) dabei hilft, komplexe Probleme in kleinere, einfachere Schritte zu zerlegen. Anstatt eine direkte Antwort zu geben, geht das Modell durch eine Abfolge von Gedanken oder Überlegungen, so wie ein Mensch ein Problem Schritt für Schritt lösen könnte.

Wie funktioniert Chain-of-Thought Prompting?

Gedankenketten-Prompting funktioniert, indem KI-Modelle angeleitet werden, komplexe Probleme Schritt für Schritt anzugehen. Diese Methode basiert auf sequentiellem Denken; jeder Schritt baut auf dem vorhergehenden auf. Nehmen wir zum Beispiel an, dem Modell wird ein schwieriges mathematisches Problem gestellt. Anstatt sofort die endgültige Antwort zu geben, arbeitet es sich zunächst durch kleinere Berechnungen oder logische Schritte, die zu einem genaueren Endergebnis führen. Dieser Prozess der Aufschlüsselung des Problems hilft dem Modell, die richtige Antwort zu finden und zu verstehen, wie es dazu gekommen ist, was die Qualität der Antwort insgesamt verbessert.

Praktisches Beispiel: Vor und nach der Aufforderung zur Denkkette

Lassen Sie uns die Funktionsweise von CoT anhand eines praktischen Beispiels erläutern. Die beiden Prompts zeigen, wie sich die Gedankenkettensteuerung auf die Reaktion des KI-Modells auswirkt.

1. Aufforderung vor CoT

Kategorisieren Sie die folgenden Nutzerbewertungen als 'Positiv', 'Negativ' oder 'Neutral':

_"Das Produkt kam spät an, funktioniert aber gut.

"Absolut fantastischer Service und Qualität!"

"Die Farbe hat mir nicht gefallen, aber der Kundendienst war hilfreich."

"Schreckliche Erfahrung. Würde ich nicht empfehlen."

"Es ist okay, erfüllt seinen Zweck."

Antwort:

Aufforderung ohne COT.png

Aufforderung ohne COT.png

Abbildung: Eingabeaufforderung ohne CoT

Analyse:

In der naiven Eingabeaufforderung liefert das Modell eine einfache Ausgabe, in der jede Bewertung einfach kategorisiert wird, ohne zu erklären, wie es zu jeder Entscheidung gekommen ist. Es zeigt dem Benutzer weder die Gründe für die Kategorisierung noch gibt es Aufschluss darüber, welche spezifischen Wörter oder Ausdrücke als positiv oder negativ eingestuft wurden. Die Ausgabe ist korrekt, aber es fehlt ihr an Tiefe und Transparenz.

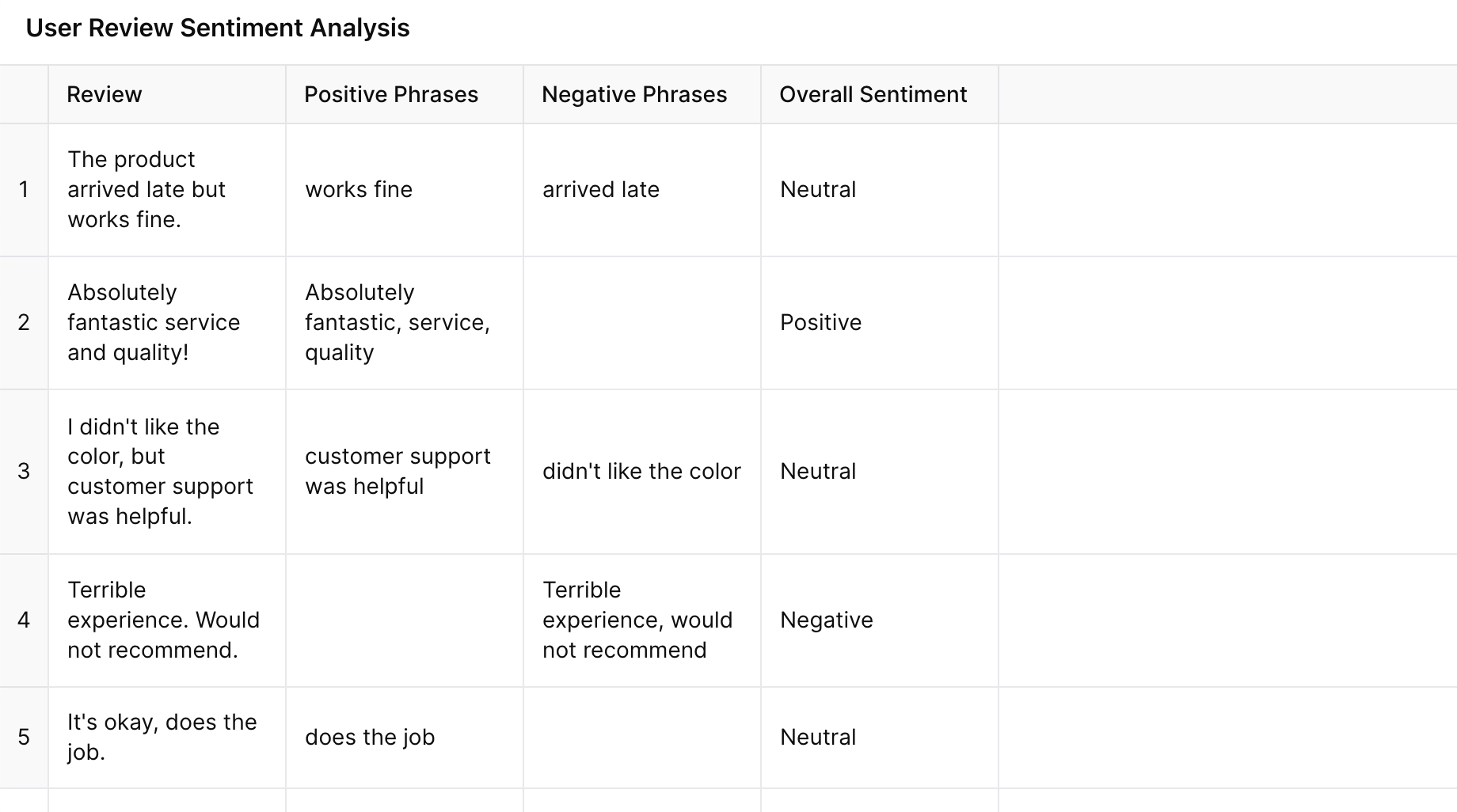

2. Aufforderung nach CoT

- Bitte kategorisieren Sie die folgenden Nutzerbewertungen als "Positiv", "Negativ" oder "Neutral". Gehen Sie bei jeder Bewertung wie folgt vor:_

Lesen Sie die Bewertung sorgfältig durch.

Identifizieren Sie alle positiven Wörter oder Sätze.

Identifizieren Sie alle negativen Wörter oder Sätze.

Beurteilen Sie die Gesamtstimmung anhand der positiven und negativen Elemente.

Ordnen Sie die entsprechende Kategorie zu.

Bei der Ausgabe alle Informationen in einer Tabelle darstellen.

Fahren Sie mit jeder Überprüfung fort:_

"Das Produkt kam spät an, funktioniert aber gut.

"Absolut fantastischer Service und Qualität!"

"Die Farbe hat mir nicht gefallen, aber der Kundendienst war hilfreich."

"Schreckliche Erfahrung. Würde ich nicht empfehlen."

"Es ist okay, erfüllt seinen Zweck."

Antwort:

Aufforderung mit CoT

Aufforderung mit CoT

Abbildung: Eingabeaufforderung mit CoT

Auswertung:

Das Modell erläutert seine Argumentation, indem es positive und negative Ausdrücke in jeder Bewertung identifiziert und dem Benutzer ein klares Verständnis der Entscheidung vermittelt.

Es wird eine Tabelle erstellt, die nicht nur die endgültige Kategorie auflistet, sondern auch die wichtigsten Gefühlsausdrücke für jede Bewertung anzeigt, wodurch die Ausgabe strukturierter und transparenter wird.

Gedankenketten-Varianten mit Prompt-Beispielen

Hier finden Sie verschiedene Arten von Gedankenketten mit praktischen Beispielen für jede Art von Eingabeaufforderung:

1. Standard-Gedankenketten-Prompting

Bei dieser Art der Gedankenkette wird das Modell aufgefordert, jeden Teil des Problems Schritt für Schritt zu durchdenken.

Beispiel für eine Aufforderung:

Ein Zug, der mit 60 Meilen pro Stunde fährt, muss 180 Meilen zurücklegen. Wie lange braucht er für diese Strecke? Gehen wir es Schritt für Schritt durch.**

Erwartete Modellreaktion:

"Der Zug fährt mit 60 Meilen pro Stunde."

"Die zurückzulegende Entfernung beträgt 180 Meilen."

"Um die Zeit zu ermitteln, müssen wir die Entfernung durch die Geschwindigkeit teilen: 180 ÷ 60 = 3."

"Es wird also 3 Stunden dauern, um das Ziel zu erreichen."

2. Gedankenkettenanregung in wenigen Augenblicken

Bei einem "few-shot CoT" werden dem Modell einige Beispiele gegeben, bevor es aufgefordert wird, ein neues Problem zu lösen.

Beispiel für eine Aufforderung:

"Hier ist ein Beispiel: Wie hoch ist die Geschwindigkeit, wenn ein Auto in 2 Stunden 100 Meilen zurücklegt? Die Geschwindigkeit beträgt 100 ÷ 2 = 50 Meilen pro Stunde.

Hier ist ein weiteres Beispiel: Wenn ein Flugzeug 600 Meilen in 3 Stunden zurücklegt, beträgt die Geschwindigkeit 600 ÷ 3 = 200 Meilen pro Stunde.

Wenn nun ein Radfahrer in 3 Stunden 90 Meilen zurücklegt, wie hoch ist dann seine Geschwindigkeit?"

Erwartete Modellantwort:

"Die Entfernung beträgt 90 Meilen und die Zeit 3 Stunden."

"Um die Geschwindigkeit zu ermitteln, dividieren wir 90 durch 3."

"90 ÷ 3 = 30 Meilen pro Stunde."

3. Selbstkonsistente Gedankenkette

Das Modell erzeugt mehrere Argumentationspfade und wählt die konsistenteste Antwort aus.

Beispiel:

Wenn eine Person 6 Äpfel für 12 $ kauft, wie viel kostet dann jeder Apfel? Versuchen wir, dieses Problem auf verschiedene Arten zu lösen, und vergleichen wir die Antworten."_ Erwartete Modellantwort:

Weg 1:

- "Die Gesamtkosten betragen 12 $ und es gibt 6 Äpfel."

- "$12 ÷ 6 = $2 pro Apfel." Weg 2:

- "Wenn 6 Äpfel $12 kosten, dann kostet jeder Apfel $2, weil $12 geteilt durch 6 gleich $2 ist." Endgültige Antwort: "Beide Methoden führen zu demselben Ergebnis, also sind die Kosten pro Apfel $2."

4. Interaktive Gedankenkette

Bei dieser Variante bittet das Modell bei Bedarf um Klärung oder zusätzliche Informationen.

Aufforderungsbeispiel:

Sie haben insgesamt 50 Dollar und möchten ein paar Bücher kaufen. Jedes Buch kostet 7 Dollar. Wie viele Bücher können Sie kaufen, und wie viel Geld bleibt dann noch übrig? Bitte fragen Sie nach, wenn Sie weitere Informationen benötigen, bevor Sie die Aufgabe lösen." _

Erwartete Modellantwort:

1. "Sind die Steuern im Buchpreis enthalten, oder sind es nur 7 Dollar pro Buch?"

(Wenn der Benutzer bestätigt, dass es sich um 7 $ pro Buch ohne Steuern handelt)

2. "Also gut, ohne Steuern, $50 geteilt durch $7 ergibt ungefähr 7 Bücher. Da 7 × 7 gleich 49 ist."

3. "Nach dem Kauf von 7 Büchern hast du noch $1 übrig."

5. Multi-Agenten-Gedankenkette

In diesem Fall arbeiten mehrere KI-Agenten zusammen, um das Problem zu lösen, indem sie verschiedene Teile in Angriff nehmen.

Vorschlagsbeispiel:

Es gehen 45 Schüler und 9 Lehrer auf einen Ausflug. Wenn jeder Bus 15 Personen aufnehmen kann, wie viele Busse werden dann benötigt? Lassen Sie einen Agenten die Gesamtzahl der Personen berechnen, einen anderen Agenten die Division berechnen und einen dritten Agenten die Lösung überprüfen."

Erwartete Modellantwort:

Agent 1: "Die Gesamtzahl der Personen ist 45 Schüler + 9 Lehrer = 54 Personen."

Agent 2: "Wir teilen 54 Personen durch 15 pro Bus: 54 ÷ 15 = 3,6, d.h. wir brauchen 4 Busse."

Agent 3: "Die Gesamtzahl der Personen und die Berechnung sind korrekt." Wir brauchen 4 Busse."

6. Rekursive Gedankenkette

Das Modell überprüft seine eigenen Überlegungen und ändert die Schritte, wenn nötig. Vorschlagsbeispiel: "_Mit 120 Dollar in der Hand geben Sie 45 Dollar für Lebensmittel, 30 Dollar für Benzin und 20 Dollar für Unterhaltung aus. Wie viel Geld haben Sie noch übrig? Bitte überprüfen Sie Ihre Berechnungen." Erwartete Modellantwort:

- "Ich beginne mit 120 Dollar."

- "$120 - $45 = $75."

- "$75 - $30 = $45."

- "$45 - $20 = $25."

- "Überprüfen: $120 - $45 = $75, dann $75 - $30 = $45, und schließlich $45 - $20 = $25. Die Antwort ist $25."

Wann sollte man die Gedankenkette verwenden?

Chain-of-Thought Prompting eignet sich für Aufgaben, die eine mehrstufige Argumentation, logisches Denken oder eine sorgfältige Analyse erfordern. Im Folgenden sind einige Szenarien aufgeführt, in denen CoT nützlich sein kann:

Mathematische Probleme oder Berechnungen: Wenn die Aufgabe mehrere Operationen oder Berechnungen beinhaltet, führt CoT das Modell durch jeden Schritt. Das Lösen von Wortproblemen oder komplexen arithmetischen Aufgaben erfordert beispielsweise, dass die Informationen in kleinere, überschaubare Teile zerlegt werden, bevor Berechnungen durchgeführt werden.

Logisches Denken und Deduktion: CoT eignet sich hervorragend für Aufgaben, bei denen das Modell Informationen Schritt für Schritt analysieren muss, z. B. bei der Entscheidungsfindung auf der Grundlage mehrerer Faktoren oder beim Lösen eines Rätsels mit logischen Schritten.

Mehrstufiges Problemlösen: Aufgaben wie das Ausbalancieren eines Budgets, das Befolgen eines Rezepts oder das Lösen eines technischen Problems erfordern oft mehrere Schritte. CoT hilft dem Modell, diese Schritte in der richtigen Reihenfolge zu befolgen.

Beantwortung komplexer Fragen: CoT kann das Modell durch die Argumentation leiten, die erforderlich ist, um eine genauere und detailliertere Antwort auf komplexe Fragen in Wissenschaft, Recht oder Philosophie zu geben. Anstatt zu raten, analysiert es die Fakten und die Logik, die für eine fundierte Antwort erforderlich sind.

Weitere Verbesserung der Gedankenkettenanregung

Um die Effektivität des Prompts weiter zu verbessern, können einige andere Techniken kombiniert werden, um das Denken zu steuern. Zum Beispiel:

Klare, strukturierte Aufforderungen: Die Qualität der Aufforderungen hat einen erheblichen Einfluss auf das logische Denken. Die Aufforderungen sollten so gestaltet sein, dass sie die CoT unterstützen, um Probleme in logische Schritte zu zerlegen. Je strukturierter und detaillierter die Aufforderung ist, desto besser kann das Modell dem Argumentationsprozess folgen.

Kombination von CoT mit Few-Shot-Learning: Few-Shot-Learning, bei dem das Modell einige Beispiele für die Lösung von Problemen gibt, kann die CoT verbessern. Indem man dem Modell mehrere ähnliche Fälle zeigt, in denen schrittweise argumentiert wurde, kann es besser verstehen, wie man an neue Aufgaben herangeht.

Selbstreflexion und Überprüfung: Eine Möglichkeit zur Verbesserung der CoT besteht darin, das Modell aufzufordern, seine eigene Argumentation zu überprüfen. Nach der Generierung einer Antwort kann das Modell aufgefordert werden, seine Schritte zu überprüfen, um zu sehen, ob sie sinnvoll sind. Dies hilft, logische Fehler oder Lücken zu erkennen, bevor die endgültige Antwort gegeben wird.

Einbeziehung der Selbstkonsistenz: Bei der Selbstkonsistenz handelt es sich um eine Methode, bei der das Modell mehrere Argumentationspfade erzeugt und diese dann vergleicht, um festzustellen, ob sie zur gleichen Schlussfolgerung führen. Wenn mehrere Wege übereinstimmen, ist es wahrscheinlicher, dass das Modell die richtige Antwort gefunden hat. Das Modell kann zum Beispiel aufgefordert werden, ein Problem auf zwei verschiedene Arten zu lösen, und dann kann die konsistenteste Antwort über die verschiedenen Ansätze hinweg ausgewählt werden.

Einschränkungen der Gedankenkettenanregung

Obwohl Chain-of-Thought Prompting ein leistungsfähiger Ansatz zur Verbesserung des KI-Schlussfolgerns ist, hat er einige Einschränkungen, die seine Wirksamkeit in bestimmten Szenarien beeinträchtigen können.

1. Fehleranfälligkeit bei der Argumentation: CoT hängt davon ab, dass das Modell einem logischen, schrittweisen Prozess folgt. Wenn das Modell jedoch in einem Schritt einen Fehler macht, kann sich dieser Fehler auf die endgültige Antwort auswirken.

2. Mehraufwand an Zeit und Ressourcen: CoT erfordert mehr Rechenressourcen, da das Modell jeden Schritt durchdenken muss, anstatt eine direkte Antwort zu geben. Dies kann den Prozess langsamer und ressourcenintensiver machen, insbesondere bei komplexen oder mehrstufigen Problemen. In Situationen, in denen Geschwindigkeit eine Priorität ist, ist CoT möglicherweise nicht ideal.

4. Abhängigkeit von gut gestalteten Aufforderungen: Die Wirksamkeit von CoT hängt stark von der Qualität der Aufforderungen ab. Wenn die Eingabeaufforderung nicht klar oder gut strukturiert ist, könnte das Modell Schwierigkeiten haben, das Problem zu durchdenken. Die Ausarbeitung dieser Aufforderungen erfordert Mühe und Fachwissen.

5. Begrenzte Verallgemeinerung auf unbekannte Aufgaben: CoT ist sehr effektiv bei Aufgaben, die es schon einmal gesehen hat oder die früheren Aufgaben sehr ähneln. Wenn das Modell jedoch mit unbekannten Problemen oder Aufgaben konfrontiert wird, die nicht aus den Trainingsdaten stammen, kann es Schwierigkeiten haben, CoT effektiv anzuwenden, da es sich auf gelernte Denkmuster stützt.

6. Risiko der Überanpassung an die Aufforderungsstruktur: Mit der Zeit könnte sich ein Modell, das für die Anwendung von CoT trainiert wurde, zu sehr auf bestimmte Aufforderungen verlassen, wodurch die Flexibilität eingeschränkt wird. Eine [Überanpassung] (https://zilliz.com/learn/understanding-regularization-in-nueral-networks) könnte erwarten, dass Probleme immer in einem bestimmten Format präsentiert werden, wodurch es für das Modell schwieriger wird, sich an neue oder anders formulierte Aufgaben anzupassen.

Real-World Use Cases of Chain-of-Thought Prompting

Chain-of-Thought Prompting hat eine Vielzahl von praktischen Anwendungen in verschiedenen Bereichen. Hier sind einige der wichtigsten realen Anwendungsfälle, bei denen CoT von großem Nutzen sein kann:

1. Mathematische Problemlösung

CoT ist äußerst nützlich für den Mathematikunterricht und für Nachhilfeplattformen. Schüler können den Prozess verstehen, indem sie mathematische Probleme in kleinere, logische Schritte zerlegen, anstatt nur die endgültige Antwort zu erhalten. Es ist auch hilfreich für fortgeschrittene Berechnungen in Bereichen wie Algebra, Kalkül und Statistik.

2. Juristische Argumentation und Vertragsanalyse

In Rechtssystemen hilft CoT KI-Systemen bei der Bewertung von Rechtsdokumenten, der Analyse von Klauseln und der Erstellung von Rechtsratschlägen, indem sie systematisch jeden Punkt in einem Vertrag oder Fall durchgehen. Sie kann auch Schritt für Schritt [juristische Argumentation] (https://zilliz.com/blog/simplifying-legal-research-with-rag-milvus-ollama) erklären, was KI in juristischen Prozessen transparenter und vertrauenswürdiger macht.

3. Kundensupport und Fehlerbehebung

CoT hilft KI-gesteuerten Chatbots oder Support-Systemen, Nutzer durch schrittweise Fehlerbehebungsprozesse zu führen. Dies ist nützlich bei technischen Problemen, bei denen der Benutzer Anweisungen oder Diagnoseschritte befolgen muss, um ein Problem zu lösen.

4. Medizinische Diagnose und Entscheidungshilfe

CoT kann Ärzten oder medizinischem Fachpersonal bei der Analyse von Symptomen, Testergebnissen und der Krankengeschichte helfen, um mögliche Diagnosen oder Behandlungen vorzuschlagen und zu erklären, wie die einzelnen Schlussfolgerungen zustande kommen.

5. Beantwortung komplexer Fragen

CoT ist äußerst effektiv bei der Beantwortung komplexer Fragen, die mehr als nur das Abrufen eines Fakts erfordern. Bei Fragen in Bereichen wie Geschichte, Wissenschaft oder Recht kann CoT KI-Systemen helfen, detaillierte, mehrstufige Antworten zu geben, die die Argumentation der Antwort erklären.

6. Spielstrategie und Rätsellösung

In Spielen werden Strategien durch die Berücksichtigung mehrerer Schritte in einer Sequenz entwickelt. CoT zerlegt komplexe Strategien in Spiel- oder Rätselszenarien in kleinere, durchdachte Züge, die zu einer besseren Entscheidungsfindung und einem besseren Spielverlauf bei Spielen wie Schach, Go oder Rätselspielen führen.

Wie kann Milvus die Effizienz von Chain-of-Thought Prompting steigern?

Milvus, eine Open-Source-Vektordatenbank, die von Zilliz entwickelt wurde, ist darauf ausgelegt, unstrukturierte Daten wie Bilder, Texte und Videos effizient zu speichern und abzurufen. Während sich Chain-of-Thought prompting auf die Verbesserung der Denkfähigkeiten von KI-Modellen konzentriert, verbessert Milvus die Art und Weise, wie diese Modelle große Vektordaten verwalten und verarbeiten.

- Effizientes Data Retrieval für komplexes Reasoning: CoT setzt voraus, dass KI-Modelle Zugang zu relevanten Informationen für schrittweises Reasoning haben. Milvus ist ein effizientes Backend, das große Mengen von Vektordaten (wie Texteinbettungen) speichert und einen schnellen Abruf ermöglicht. Dadurch können die KI-Modelle bei jedem Schritt des Schlussfolgerungsprozesses ohne Verzögerung auf die benötigten Daten zugreifen.

Unterstützung groß angelegter Anwendungen: CoT-Aufforderungen erfordern in vielen realen Fällen die Verarbeitung umfangreicher Datensätze für mehrstufige Schlussfolgerungen. Milvus ermöglicht es KI-Modellen, mit großen Datensätzen zu arbeiten, ohne Kompromisse bei der Geschwindigkeit oder Leistung einzugehen.

Optimierte Ähnlichkeitssuche: Milvus ist für eine schnelle [semantische Suche] (https://zilliz.com/glossary/semantic-search) und [Ähnlichkeitssuche] (https://zilliz.com/learn/vector-similarity-search) ausgelegt, was die CoT verbessert, da die KI schnell auf semantisch verwandte Daten zugreifen kann. Dies beschleunigt den Denkprozess, da das Modell bei der Lösung von mehrstufigen Problemen relevante Informationen genauer und effizienter abrufen kann.

Schlussfolgerung

Zusammenfassend lässt sich sagen, dass Chain-of-Thought Prompting KI-Modelle bei der Lösung komplexer Probleme unterstützt, indem sie diese in logische Schritte zerlegt und so die Genauigkeit und Klarheit verbessert. Milvus verbessert diesen Prozess, indem es einen schnellen Zugriff auf große Mengen unstrukturierter Daten ermöglicht, so dass die KI bei jedem Schritt relevante Informationen abrufen kann. CoT und Milvus bieten praktische Lösungen für die Bewältigung komplexer Aufgaben in Bereichen wie Forschung, Kundensupport und Finanzanalyse und machen KI in realen Anwendungen effektiver und zuverlässiger.

FAQ zum Chain-of-Thought Prompting

Wie verbessert Chain-of-Thought Prompting das KI-Schlussfolgern?

Chain-of-Thought Prompting verbessert das KI-Schlussfolgern, indem es das Modell Schritt für Schritt durch Probleme führt. Diese Methode ermutigt das Modell, komplexe Aufgaben in kleinere, überschaubare Teile zu zerlegen, wodurch Fehler reduziert und die Genauigkeit erhöht werden.

Wann sollte Chain-of-Thought Prompting eingesetzt werden?

CoT eignet sich am besten für Aufgaben, die ein mehrstufiges Denken, eine tiefgehende logische Analyse oder eine komplexe Problemlösung erfordern. Beispiele hierfür sind mathematische Probleme, logische Schlussfolgerungen, technische Fehlersuche und vielschichtige Entscheidungsprozesse.

Was sind die wichtigsten Vorteile von Chain-of-Thought Prompting?

Zu den wichtigsten Vorteilen von CoT gehören eine höhere Genauigkeit, eine bessere Bewältigung komplexer Probleme, eine geringere Fehlerquote, eine verbesserte Modelltransparenz und ein strukturierter Ansatz, der KI-Schlussfolgerungen verständlicher und zuverlässiger macht.

- Wie verbessert Milvus die Effizienz von Chain-of-Thought Prompting?

Milvus verbessert das CoT-Prompting durch effizientes Speichern und Abrufen umfangreicher unstrukturierter Daten, wie z. B. Texte und Bilder. Es ermöglicht KI-Modellen den schnellen Zugriff auf relevante Daten in jeder Argumentationsphase für eine reibungslose und schnelle Leistung bei komplexen, mehrstufigen Aufgaben.

- Wie unterscheidet sich Chain-of-Thought Prompting von herkömmlichen KI-Antworten?

Herkömmliche KI-Antworten versuchen oft, direkt eine Antwort zu geben, ohne den Denkprozess im Detail zu beschreiben. Beim Chain-of-Thought Prompting hingegen erklärt das Modell seine Überlegungen Schritt für Schritt, bietet Transparenz und folgt einer logischen Progression zur Lösung.

Verwandte Ressourcen

- Was ist Chain-of-Thought Prompting?

- Wie funktioniert Chain-of-Thought Prompting?

- Gedankenketten-Varianten mit Prompt-Beispielen

- Wann sollte man die Gedankenkette verwenden?

- Weitere Verbesserung der Gedankenkettenanregung

- Einschränkungen der Gedankenkettenanregung

- Real-World Use Cases of Chain-of-Thought Prompting

- Wie kann Milvus die Effizienz von Chain-of-Thought Prompting steigern?

- Schlussfolgerung

- FAQ zum Chain-of-Thought Prompting

- Verwandte Ressourcen

Inhalte

Kostenlos starten, einfach skalieren

Testen Sie die vollständig verwaltete Vektordatenbank, die für Ihre GenAI-Anwendungen entwickelt wurde.

Zilliz Cloud kostenlos ausprobieren