Master Fine Tuning in Deep Learning: Techniken und Tipps

Master Fine Tuning in Deep Learning: Techniken und Tipps

Die Feinabstimmung beim Deep Learning verfeinert bereits trainierte Modelle für bestimmte Aufgaben und spart Zeit und Ressourcen. Hier erfahren Sie, was Feinabstimmung ist, warum sie wichtig ist und wie man sie durchführt.

Kurze Zusammenfassung

Feinabstimmung ist eine Schlüsseltechnik beim Deep Learning, mit der vortrainierte Modelle für bestimmte Aufgaben optimiert und durch die Nutzung vorhandenen Wissens effizienter und genauer gemacht werden.

Merkmalsextraktion und vollständige Feinabstimmung sind die beiden Ansätze für die Feinabstimmung, die je nach Aufgabe und Ressourcen ihre eigenen Vorteile haben.

Die Feinabstimmung erfordert eine sorgfältige Datenvorbereitung, die Auswahl der richtigen vortrainierten Modelle, Parameterabstimmung und iterative Validierung, damit das Modell in realen Anwendungen funktioniert.

Feinabstimmung: Techniken und bewährte Praktiken

Eine Illustration, die verschiedene Feinabstimmungstechniken beim Deep Learning zeigt

Eine Illustration, die verschiedene Feinabstimmungstechniken beim Deep Learning zeigt

Die Feinabstimmung verbessert vortrainierte Modelle für spezielle Anwendungen, indem ihre Parameter für bestimmte Aufgaben angepasst werden. Im Gegensatz zum Training von Modellen von Grund auf nutzt diese Methode das vorhandene Wissen innerhalb des vortrainierten Modells, was es effizienter und oft auch effektiver macht. Der Feinabstimmungsprozess kann grob in überwachte Feinabstimmung und verstärkendes Lernen durch menschliches Feedback (RLHF) unterteilt werden. Bei richtiger Anwendung können diese Verfahren große Sprachmodelle (LLMs) wirklich verbessern.

Die Auswahl des richtigen vortrainierten Modells ist wichtig, wobei die Modellgröße, die Trainingsdaten und die Leistung bei relevanten Aufgaben zu berücksichtigen sind. In Bereichen wie der personalisierten Medizin kann die Feinabstimmung beispielsweise Gesundheitsrisiken vorhersagen und Behandlungspläne auf der Grundlage spezifischer medizinischer Aufzeichnungen und Daten anpassen.

Der Schlüssel zur Feinabstimmung ist das Verständnis der Modellarchitektur und ihrer Anpassung an neue Aufgaben. Dieser Prozess optimiert nicht nur die Modelle für bestimmte Anforderungen, sondern verbessert auch ihre Gesamtleistung und ihren Nutzen.

Einleitung

Die Feinabstimmung ist ein wichtiger Bestandteil des Deep Learning. Dabei wird ein vorab trainiertes Modell für eine bestimmte Aufgabe mit einem kleineren Datensatz feinabgestimmt. Die Anpassung von Teilen des Modells an neue, aufgabenspezifische Daten erhöht die Genauigkeit und Effizienz.

Dies ist nützlich, weil es im Vergleich zum Trainieren eines Modells von Grund auf Zeit spart und oft bessere Ergebnisse liefert, indem es das in das vortrainierte Modell eingebettete Wissen nutzt.

Feinabstimmung verstehen

Ein Diagramm zur Veranschaulichung des Feinabstimmungsprozesses beim Deep Learning](https://assets.zilliz.com/A_diagram_illustrating_the_fine_tuning_process_in_deep_learning_4ee959827e.png)

Die Feinabstimmung verbessert vortrainierte Modelle für bestimmte Aufgaben und steigert ihre Effektivität in bestimmten Anwendungen. Es wird oft als eine Verfeinerung des Transfer-Lernens angesehen und nutzt vortrainierte Modelle zur Aufgabenspezialisierung. Um das Potenzial der Feinabstimmung voll ausschöpfen zu können, ist es wichtig, die Feinabstimmung, einschließlich ihrer Methoden und wichtigsten Vorteile, zu verstehen.

Die Methoden der Feinabstimmung können in zwei große Kategorien eingeteilt werden. Dies sind die überwachte Feinabstimmung und das Verstärkungslernen durch menschliches Feedback (RLHF). Die Auswahl des geeigneten vortrainierten Modells ist entscheidend für die Anpassung an die Anforderungen der Zielaufgabe, die Gewährleistung einer nahtlosen Integration und die Maximierung der Anpassungsfähigkeit.

Dabei sind Faktoren wie Modellgröße, Trainingsdaten und Leistung bei relevanten Aufgaben sorgfältig zu berücksichtigen. Dieser Abschnitt befasst sich mit der Definition, der Bedeutung und den Funktionsmechanismen der Feinabstimmung.

Definition und Bedeutung

Feinabstimmung ist eine Technik zur Anpassung der Parameter eines trainierten Modells, um die Leistung bei einer bestimmten Aufgabe zu verbessern. Im Zusammenhang mit Sprachmodellen geht es darum, die Parameter eines trainierten Modells so zu verändern, dass sie besser zu einer bestimmten Domäne oder Aufgabe passen. Diese Methode ermöglicht es den Modellen, ihre ursprünglichen Fähigkeiten beizubehalten und sich gleichzeitig an spezielle Anwendungsfälle anzupassen, wodurch ihre Leistung verbessert wird.

Bei der Feinabstimmung werden vorab trainierte Modelle so angepasst, dass sie sich auf bestimmte Aufgaben konzentrieren, wodurch ihre Spezialisierung und Leistung verbessert werden. Diese Methode ist besonders vorteilhaft bei großen, aufgabenspezifischen Datensätzen, vor allem, wenn sie sich erheblich von dem vor dem Training erstellten gesamten Datensatz unterscheiden. Sie ermöglicht eine effiziente Anpassung mit begrenzten Daten und optimiert die vortrainierten Erkenntnisse für bestimmte Anwendungen.

Bei der Feinabstimmung wird das vorhandene Wissen aus vortrainierten Modellen genutzt, um bessere Ergebnisse bei speziellen Aufgaben zu erzielen. Dieser Ansatz ist effizient und kosteneffektiv und reduziert den Bedarf an umfangreichem Neutraining. Die Feinabstimmung trägt auch dazu bei, dass Modelle besser auf neue Daten verallgemeinert werden können, was für zuverlässige Ergebnisse in der Praxis entscheidend ist.

Wie funktioniert Fine Tuning?

Die Feinabstimmung beginnt oft damit, dass die ersten Schichten eines vortrainierten Modells eingefroren werden und sich die Anpassungen auf die späteren Schichten konzentrieren, um das Modell für neue Aufgaben zu spezialisieren. Auf diese Weise bleibt das in den ersten Schichten eingebettete allgemeine Wissen erhalten, während die Anpassung an aufgabenspezifische Daten möglich ist. Beim Retraining wird in der Regel eine niedrigere Lernrate verwendet, wobei die meisten Parameter unverändert bleiben, während die letzten Schichten angepasst werden.

Das Ziel besteht darin, vortrainierte Modelle an bestimmte Bereiche anzupassen, indem bestimmte Schichten auf der Grundlage aufgabenspezifischer Daten eingestellt werden. Durch die Feinabstimmung nur der späteren Schichten nutzt das Modell sein vorhandenes allgemeines Wissen und spezialisiert sich gleichzeitig auf die jeweilige Aufgabe. Dieser Prozess ist von entscheidender Bedeutung, um eine hohe Leistung in bestimmten Anwendungen ohne umfangreiche Nachschulung zu erreichen.

Die Feinabstimmung erfordert ein tiefes Verständnis der Modellarchitektur und der spezifischen Aufgabenanforderungen. Der Prozess ist iterativ und umfasst mehrere Trainings- und Validierungsrunden, um eine gute Anpassung an neue Daten zu gewährleisten. Diese Methode verbessert die Leistung und Effizienz des Modells bei der Bewältigung spezieller Aufgaben.

Vorteile

Die Feinabstimmung macht die Modelle effizienter, so dass Sie mit weniger Ressourcen bessere Modelle erstellen können als bei einem Training von Grund auf. Sie konvergiert in der Regel schneller und ist leistungsfähiger. Die Verwendung von vortrainierten Modellen reduziert die Rechenkosten für das Training.

Der Hauptvorteil der Feinabstimmung eines vorhandenen Modells besteht darin, dass man mit weniger Beispielen eine ähnliche Leistung erzielen kann, so dass es gut geeignet ist, Modelle an bestimmte Aufgaben ohne große Datensätze anzupassen. Die Kosteneffizienz ist ein weiterer großer Vorteil der Verwendung vorhandener Modelle zur Verbesserung neuer Aufgaben ohne erneutes Training.

Kurz gesagt, die Feinabstimmung ist gut für Leistung, Effizienz und Kosten. Sie ermöglicht es, mit minimalen Ressourcen bessere Modelle zu erstellen und ist daher in vielen realen Anwendungen das Mittel der Wahl. Die Feinabstimmung macht das Modell effizienter und senkt die Trainingskosten, so dass sie eine praktische Lösung zur Anpassung der Modelle an Ihre Bedürfnisse darstellt.

Primäre Ansätze für die Feinabstimmung

Eine Infografik, die die primären Ansätze zur Feinabstimmung beim maschinellen Lernen zusammenfasst

Eine Infografik, die die primären Ansätze zur Feinabstimmung beim maschinellen Lernen zusammenfasst

Die Feinabstimmung optimiert vortrainierte Modelle für eine bestimmte Aufgabe, ist besser als ein Training von Grund auf und ist für die Anpassung neuronaler Netze an eine Aufgabe ohne erneutes Training unerlässlich. Es gibt zwei Möglichkeiten der Feinabstimmung, die Merkmalsextraktion und die vollständige Feinabstimmung, die jeweils ihre eigenen Anwendungsfälle haben.

Bei der Merkmalsextraktion werden nur die letzten Schichten eines vortrainierten Modells feinabgestimmt, bei der vollständigen Feinabstimmung werden alle Schichten für eine neue Aufgabe feinabgestimmt. Beide sind wichtig für eine hohe Leistung in bestimmten Anwendungsfällen. In diesem Abschnitt werden diese beiden Ansätze, der Prozess und die Vorteile behandelt.

Merkmalsextraktion

Der Ansatz der Merkmalsextraktion bei der Feinabstimmung großer Sprachmodelle (LLMs) verwendet das vortrainierte Modell als festen Merkmalsextraktor, wobei nur die letzten Schichten auf aufgabenspezifischen Daten trainiert werden. Bei dieser Methode werden die letzten Schichten neu trainiert, während der Rest des Modells unverändert bleibt, so dass sie schneller und effizienter ist.

Bei [NLP-Aufgaben] (https://zilliz.com/learn/popular-datasets-for-natural-language-processing) wie Sentiment-Analyse und Texterstellung kann die Merkmalsextraktion die Modellleistung verbessern, indem das allgemeine Wissen des vortrainierten Modells genutzt wird und sich auf aufgabenspezifische Anpassungen konzentriert wird. Dies ist in Bereichen nützlich, in denen die Trainingsdaten begrenzt sind, aber aufgabenspezifische Merkmale wichtig sind.

Vollständige Feinabstimmung

Die vollständige Feinabstimmung bietet eine tiefere Modellanpassung durch Anpassung aller Schichten an den spezifischen Datensatz. Diese Methode ermöglicht es dem Modell, umfassend aus aufgabenspezifischen Daten zu lernen, was zu einer besseren Leistung und höheren Genauigkeit führt. Im Gegensatz zur Merkmalsextraktion wird bei der vollständigen Feinabstimmung das gesamte Modell neu trainiert, so dass es sich besser an neue Aufgaben anpassen lässt.

Die vollständige Feinabstimmung erfordert mehr Rechenressourcen und Zeit, führt aber oft zu einem Modell, das bei bestimmten Aufgaben hervorragende Leistungen erbringt. Dies ist besonders nützlich für große Sprachmodelle (LLMs), die gründlich angepasst werden müssen, um die besten Ergebnisse zu erzielen.

Durch die Anpassung aller Schichten kann das Modell neues Wissen vollständig integrieren und seine Leistung bei der Zielaufgabe verbessern.

Feinabstimmungstechniken

Bei der Feinabstimmung werden bereits trainierte Modelle für bestimmte Aufgaben angepasst, ohne bei Null zu beginnen. Es gibt verschiedene Feinabstimmungstechniken für unterschiedliche Szenarien und Anwendungsfälle. In diesem Abschnitt werden Techniken wie die überwachte Feinabstimmung, das Verstärkungslernen durch menschliches Feedback (RLHF) und die Low-Rank-Adaptation (LoRA) behandelt.

Diese Techniken dienen dazu, die Leistung des Modells bei bestimmten Aufgaben zu verbessern, indem das Wissen in vortrainierten Modellen genutzt wird. Das Verständnis dieser Techniken und ihrer Anwendungen wird Ihnen helfen, die richtige Technik für Ihren Bereich zu wählen. In diesem Abschnitt wird auf jede Technik eingegangen und der Prozess und die Vorteile erklärt.

Überwachtes Fine Tuning

Bei der überwachten Feinabstimmung werden Modelle auf markierten Daten trainiert, um sie für bestimmte Aufgaben zu verbessern. Dabei werden aufgabenspezifische markierte Daten verwendet, um korrekte Antworten vorherzusagen. Das [Hyperparameter-Tuning] (https://zilliz.com/glossary/hyperparameter-tuning) ist der Schlüssel, um die richtigen Modellkonfigurationen für bessere Ergebnisse zu erhalten.

Dies ist ressourceneffizient und ermöglicht eine Anpassung mit begrenzten Daten, anstatt völlig neue Datensätze zu benötigen. Die Feinabstimmung kann das Modelltraining beschleunigen, da es von einem gut informierten Zustand ausgeht und nicht bei Null anfängt. Durch die Anpassung eines vortrainierten LLM, um das Beste aus den vorhandenen beschrifteten Daten herauszuholen, führt die überwachte Feinabstimmung zu großen Verbesserungen der Robustheit, Genauigkeit und Relevanz des Modells, insbesondere wenn beschriftete Daten knapp sind.

Insgesamt ist die überwachte Feinabstimmung der Schlüssel zur Verbesserung der Modellleistung bei bestimmten Aufgaben durch die effiziente Nutzung von gelabelten Daten. Dies ist besonders nützlich für große Sprachmodelle (LLMs), bei denen die Feinabstimmung einen sorgfältigen Umgang mit gelabelten Daten erfordert, um die besten Ergebnisse zu erzielen.

Reinforcement Learning from Human Feedback (RLHF)

Reinforcement Learning from Human Feedback (RLHF) ist eine Methode zum Trainieren von Sprachmodellen. Es stützt sich auf die Interaktion mit menschlichem Feedback. Menschliches Feedback in RLHF wird kontinuierlich eingespeist, um die Genauigkeit und Relevanz von Modellen zur Verarbeitung natürlicher Sprache zu verbessern. Die Belohnungsmodellierung in RLHF umfasst die Erzeugung von Ausgaben, die von menschlichen Bewertern bewertet werden.

Proximal Policy Optimization (PPO) ist ein iterativer Algorithmus in RLHF, der die Modellpolitik aktualisiert, um die Belohnungen bei gleichzeitiger Stabilität zu maximieren. RLHF verfeinert die Modellausgaben durch menschliche Bewertungen, um das große Sprachmodell hinsichtlich Genauigkeit und Relevanz zu verbessern. Dies ist der Schlüssel zur Feinabstimmung großer Sprachmodelle (LLMs), um besser auf menschliche Eingaben zu reagieren.

Menschliches Feedback beim Training ermöglicht es den Modellen, kontextuell relevante Antworten zu erzeugen. Dies ist bei Anwendungen nützlich, bei denen die Ergebnisse sehr genau und relevant sein müssen. RLHF ermöglicht die Feinabstimmung von Modellen für höhere Genauigkeit und bessere Leistung bei bestimmten Aufgaben.

Low-Rank Adaptation (LoRA)

Low-Rank Adaptation (LoRA) ist eine Technik zur effizienten Feinabstimmung unter Verwendung von Low-Rank-Matrizen und einem adapterbasierten Ansatz. Diese Methode ermöglicht eine umfangreiche Modellanpassung mit minimalen Parameteranpassungen und ist daher sehr effizient. Durch die Verwendung von Low-Rank-Matrizen kann LoRA eine ähnliche Leistung wie bei der vollständigen Feinabstimmung erzielen, während deutlich weniger Rechenressourcen benötigt werden.

Bei Modellen mit Milliarden von Parametern kann LoRA eine Feinabstimmung des Basismodells mit nur einigen Millionen Parametern vornehmen, was eine erhebliche Reduzierung der Ressourcenanforderungen bedeutet. Dies macht LoRA zu einer attraktiven Option für die Feinabstimmung großer Modelle, da es im Vergleich zur Feinabstimmung eines vollständigen Modells eine ähnliche Leistung bei geringerem Platzbedarf bietet. Durch die Konzentration auf die wirksamsten Parameteranpassungen gewährleistet LoRA eine effiziente Modellanpassung.

Die Effizienz von LoRA macht es besonders nützlich, wenn die Rechenressourcen begrenzt sind, aber eine hohe Leistung erforderlich ist. Diese Technik ermöglicht eine wirksame Feinabstimmung ohne großen Rechenaufwand, was sie für viele reale Anwendungen zu einer praktischen Wahl macht. Durch den Einsatz von Low-Rank-Matrizen bietet LoRA einen ausgewogenen Ansatz für die Feinabstimmung großer Modelle, der eine hohe Genauigkeit bei geringerem Ressourcenverbrauch ermöglicht.

Best Practices für die Feinabstimmung

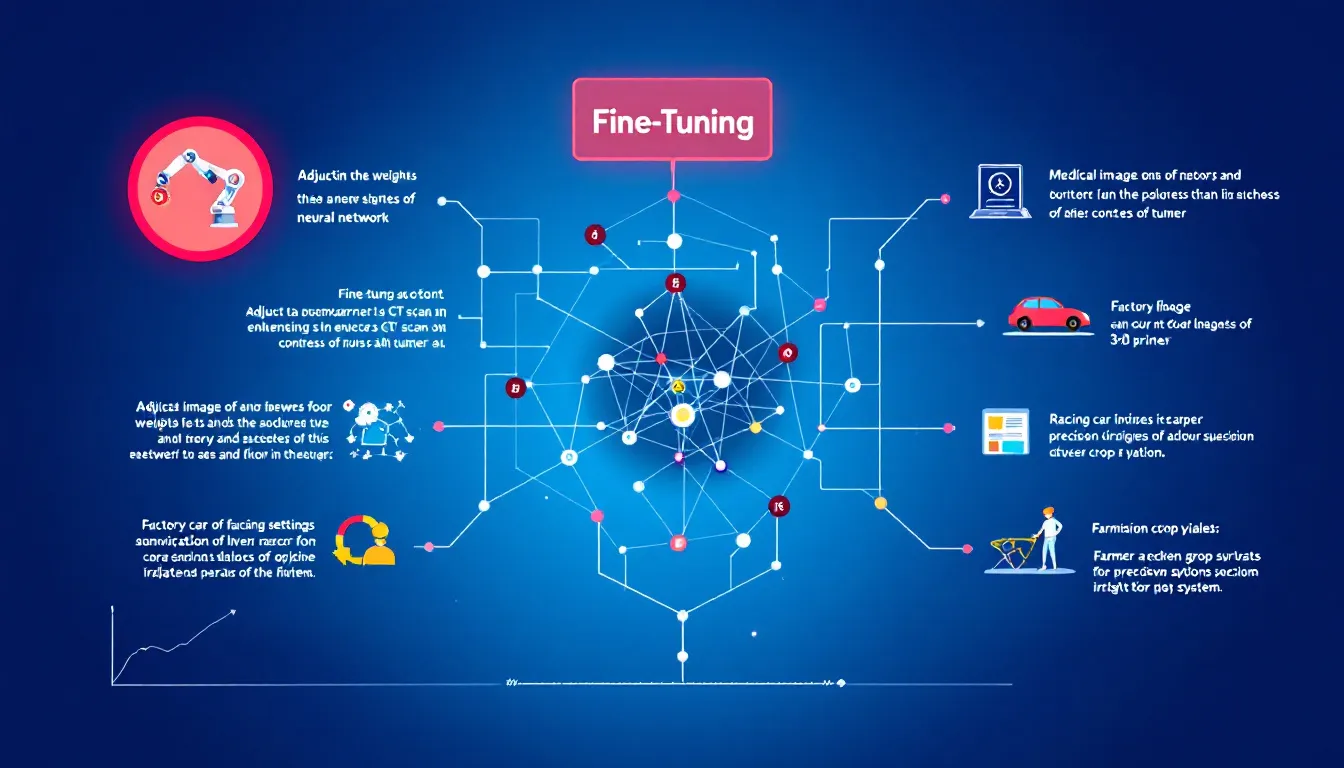

Ein visueller Leitfaden zu den besten Praktiken für die Feinabstimmung beim Deep Learning

Ein visueller Leitfaden zu den besten Praktiken für die Feinabstimmung beim Deep Learning

Eine effektive Feinabstimmung erfordert ein umfassendes Verständnis der Architektur des Modells und der Nuancen des Datensatzes. In diesem Abschnitt werden bewährte Verfahren beschrieben, die sicherstellen, dass Modelle effizient und effektiv an neue Aufgaben angepasst werden. Zu den Praktiken gehören die Datenvorbereitung, die Auswahl der richtigen vortrainierten Modelle, die Abstimmung der Parameter sowie die Validierung und Iteration des Modells.

Die Einhaltung dieser Best Practices kann die Leistung und Zuverlässigkeit der feinabgestimmten Modelle erheblich verbessern. Durch einen strukturierten Ansatz wird sichergestellt, dass der Feinabstimmungsprozess für die besten Ergebnisse optimiert wird. Dieser Abschnitt bietet detaillierte Einblicke in die einzelnen Praktiken und hebt ihre Bedeutung für den Feinabstimmungsprozess hervor.

Datenvorbereitung

Die Datenvorbereitung ist für die Feinabstimmung von entscheidender Bedeutung und wirkt sich direkt auf die Leistung und Zuverlässigkeit des Modells aus. Zu den Aufgaben gehören die Aufbereitung und Vorverarbeitung des Datensatzes, die Bereinigung von Daten, die Behandlung fehlender Werte und die Formatierung von Text. Für den Trainingserfolg ist es entscheidend, dass der Datensatz ausgewogen und repräsentativ für die Aufgabe ist.

Die Feinabstimmung von Dialogmodellen mit spezifischen Datensätzen kann die Genauigkeit von Kundendienst-Chatbots erheblich verbessern, was die Auswirkungen qualitativ hochwertiger Daten auf eine vergleichbare Leistung belegt. Eine sorgfältige Vorbereitung der Trainingsdaten stellt sicher, dass das Modell mit relevanten und repräsentativen Beispielen konfrontiert wird, was zu einer besseren Leistung führt.

Dieser Schritt ist unerlässlich, um eine hohe Genauigkeit und Zuverlässigkeit der fein abgestimmten Modelle zu erreichen.

Auswahl der vorbereiteten Modelle

Die Auswahl des richtigen vortrainierten Modells ist von entscheidender Bedeutung, da sie die Geschwindigkeit und das Ergebnis des Trainingsprozesses beeinflusst. Die Wahl des Modells wirkt sich auf die Trainingsgeschwindigkeit und die endgültige Leistung aus. Berücksichtigen Sie bei der Auswahl eines vorgefertigten Modells die Modellarchitektur, die Trainingsdaten und die Leistung bei verwandten Aufgaben.

Durch die Wahl eines Modells, das der Zielaufgabe entspricht, können Praktiker sicherstellen, dass die Feinabstimmung effizient und effektiv ist. Die Wahl eines vortrainierten natürlichen Sprachmodells oder eines Modells, das mit ähnlichen Daten trainiert wurde, führt beispielsweise zu einer schnelleren Konvergenz und einer besseren Leistung bei der jeweiligen Aufgabe.

Dies ist der Schlüssel zur Feinabstimmung und zur Erzielung der besten Ergebnisse.

Feinabstimmung der Parameter

Zu den wichtigsten Parametern für die Feinabstimmung gehören Lernrate, Epochen und Stapelgröße. Eine dynamische Anpassung der Lernrate während des Trainings kann zu einer besseren Konvergenz führen. Eine vollständige Feinabstimmung erfordert mehr Rechenressourcen und dauert länger als die Merkmalsextraktion, was sich auf die Auswahl der Epochen und der Stapelgröße auswirkt.

Die Feinabstimmung ermöglicht effizientere Modelle für bestimmte Anwendungsfälle, indem diese Parameter sorgfältig eingestellt werden. Durch die Optimierung der Lernrate, der Epochen und der Stapelgröße können Praktiker sicherstellen, dass sich das Modell gut an die neue Aufgabe anpasst und eine hohe Leistung erzielt.

Dieser Schritt ist der Schlüssel zur Feinabstimmung von Modellen und zur Erzielung der bestmöglichen Ergebnisse.

Validierung und Modell-Iteration

Die Validierung im Feinabstimmungsprozess besteht in der Bewertung des Modells anhand einer Validierungsgruppe. Bei der Modelliteration wird das Modell auf der Grundlage der Evaluierungsergebnisse verfeinert, um eine kontinuierliche Verbesserung zu gewährleisten. Während der Validierung werden Metriken wie Genauigkeit, Verlust, Präzision und Rückruf überwacht, um die Leistung des Modells zu bewerten.

Die Validierung gibt Aufschluss über die Leistung und die verbesserungswürdigen Bereiche des fein abgestimmten Modells. Kreuzvalidierungstechniken liefern zuverlässigere Schätzungen der Leistung eines Modells und gewährleisten, dass das Modell gut auf neue Daten verallgemeinert werden kann.

Durch Iteration des Modells auf der Grundlage der Validierungsergebnisse können Praktiker sicherstellen, dass das fein abgestimmte Modell die bestmögliche Leistung erzielt.

Reale Anwendungen der Feinabstimmung

Beispiele für reale Anwendungen der Feinabstimmung in verschiedenen Bereichen

Beispiele für reale Anwendungen der Feinabstimmung in verschiedenen Bereichen

Feinabstimmung wird heute von vielen Unternehmen eingesetzt. Sie wollen vortrainierte Modelle für ihre Anwendungsfälle verwenden. Einige Beispiele aus der Praxis für die Feinabstimmung sind Stimmungsanalyse, Chatbots und Textzusammenfassung. Die Feinabstimmung von Modellen für bestimmte Aufgaben führt zu einer besseren Modellgenauigkeit und Geschwindigkeit.

Feinabstimmung ist vielseitig, daher werden wir uns verschiedene Beispiele aus der Praxis ansehen, um die Auswirkungen und Vorteile der Feinabstimmung in verschiedenen Branchen zu erkennen.

Anhand dieser Beispiele können Praktiker den Wert der Feinabstimmung für die Modellleistung und den Nutzen schätzen.

Sentiment-Analyse

Die Feinabstimmung verbessert die Stimmungsanalyse, indem sie es vortrainierten Sprachmodellen ermöglicht, sich an die jeweilige Sprache und den jeweiligen Kontext anzupassen, um Stimmungen besser zu erkennen. Durch die Feinabstimmung vortrainierter Modelle können Unternehmen die Stimmungsanalyse so anpassen, dass sie die Nuancen ihrer Branche oder Zielgruppe erfasst. Durch die Verwendung von bereichsspezifischem Vokabular und Phrasen können fein abgestimmte Modelle die allgemeinen Stimmungsanalyse-Tools übertreffen.

Eine verbesserte Stimmungsanalyse durch Feinabstimmung hilft beim Reputationsmanagement durch die Analyse von Kundenfeedback und -stimmung in Echtzeit. Unternehmen können eine fein abgestimmte Stimmungsanalyse nutzen, um proaktiv auf Kundenanliegen zu reagieren und so ihren allgemeinen Ruf zu verbessern. Dies führt zu fundierteren Geschäftsentscheidungen, da sie tiefere Einblicke in Kundenmeinungen und Markttrends erhalten.

Chatbots und konversationelle KI

Feinabstimmung ist der Schlüssel zur Schaffung kontextbezogener und ansprechender Konversationen für Chatbots. Fein abgestimmte Chatbots schaffen kontextbezogene und ansprechende Konversationen und Benutzerinteraktionen. Im E-Commerce helfen fein abgestimmte Chatbots bei Produktfragen und Empfehlungen. Sie helfen auch, Transaktionen zu erleichtern.

Im Finanzwesen geben fein abgestimmte Chatbots persönliche Finanzberatung und helfen bei der Kontoführung. Im Gesundheitswesen beantworten fein abgestimmte Chatbots detaillierte medizinische Fragen und leisten Unterstützung.

Fein abgestimmte Modelle können Inhalte sozialer Medien analysieren und Einblicke in die öffentliche Meinung und Markenwahrnehmung geben. Diese wenigen Beispiele zeigen, wie die Feinabstimmung in der KI einen Unterschied machen kann.

Text-Zusammenfassung

Fein abgestimmte Zusammenfassungsmodelle reduzieren lange Forschungsarbeiten auf verdaulichere und verständlichere Inhalte. Sie sind auch für die Reduzierung langer Berichte und Geschäftsdokumente nützlich. Durch die Feinabstimmung von Zusammenfassungsmodellen können Sie Zusammenfassungen von langen Nachrichtenartikeln erstellen und sicherstellen, dass die wichtigen Informationen erfasst werden.

Dies ist besonders nützlich für Aufgaben, bei denen ein schneller Zugriff auf zusammengefasste Informationen erforderlich ist, wie in Nachrichtenagenturen und Forschungseinrichtungen. Durch die Feinabstimmung können sich Zusammenfassungsmodelle an bestimmte Aufgaben und Bereiche anpassen und prägnante und genaue Zusammenfassungen ungesehener Daten liefern, die in vielen beruflichen Kontexten äußerst wertvoll sind.

Dadurch wird der Nutzen von Textzusammenfassungsmodellen bei der effizienten Verarbeitung großer Textmengen erhöht.

Vergleich der Feinabstimmung mit anderen Techniken

Die Feinabstimmung ist großartig, aber wir sollten sie mit anderen Methoden des maschinellen Lernens vergleichen, um ihre Stärken und Schwächen zu erkennen. In diesem Abschnitt wird untersucht, wie die Feinabstimmung im Vergleich zu Transfer Learning und Retrieval Augmented Generation (RAG) abschneidet.

Am Ende dieses Abschnitts werden Sie wissen, welche Methode Sie für Ihren Anwendungsfall verwenden sollten. In diesem Abschnitt werden die Unterschiede und Überschneidungen zwischen Feinabstimmung und anderen Ansätzen aufgezeigt.

Transfer Learning vs. Feinabstimmung

Beim Transfer-Lernen wird ein zuvor trainiertes Modell als Ausgangspunkt verwendet, um es an aufgabenspezifische Daten anzupassen. Feinabstimmung ist eine spezifische Anpassung eines Modells, Transferlernen ist ein breiteres Konzept der Anwendung von Wissen aus einer Aufgabe auf eine verwandte Aufgabe. Beide sind wichtig für die Verwendung von vortrainierten Modellen für spezielle Aufgaben, aber sie unterscheiden sich in Ansatz und Anwendung.

Beim Transferlernen wird allgemeines Wissen von einer Aufgabe auf eine andere übertragen, während bei der Feinabstimmung die Fähigkeit eines Modells für einen bestimmten Anwendungsfall durch Anpassung seiner Parameter optimiert wird. Die Feinabstimmung erfordert mehr Daten, die für die neue Aufgabe spezifisch sind, während das Transferlernen mit kleineren Datensätzen arbeiten kann, indem es vorhandenes Wissen nutzt.

Das Verständnis dieser Unterschiede ist entscheidend für die Auswahl des richtigen Ansatzes für bestimmte Aufgaben.

Retrieval Augmented Generation (RAG)

Retrieval Augmented Generation (RAG) kombiniert vortrainierte Modelle mit externen Datenquellen, die in [Einbettungen] (https://zilliz.com/learn/what-are-binary-vector-embedding) umgewandelt und in einer Vektordatenbank gespeichert werden, um die Relevanz der Ausgabe zu erhöhen. RAG füllt die Wissenslücken, indem es Echtzeitdaten in den Generierungsprozess einbringt. Dadurch können große Sprachmodelle genauere Antworten geben, indem sie auf die neuesten Informationen aus mehreren Quellen zugreifen.

RAG kann Vertrauen beim Benutzer aufbauen, indem es Quellen zitiert, genau wie beim akademischen Schreiben.

Durch die Kombination eines LLM mit einer kuratierten Datenbank ermöglicht RAG großen Sprachmodellen, genauere und kontextbezogene Antworten zu geben. Dies macht das Hinzufügen neuer Wissensdatenbanken zu KI-Modellen einfach, so dass Entwickler einfach neue Datenquellen einfügen können.

Zusammenfassung

Die Feinabstimmung ist eine leistungsstarke Technik des maschinellen Lernens, mit der vortrainierte Modelle für bestimmte Aufgaben verbessert werden können. Wenn man den Prozess, die Techniken und die besten Praktiken der Feinabstimmung versteht, kann man sie nutzen, um Modelle zu erstellen, die den eigenen Anforderungen entsprechen. Von der Datenvorbereitung bis zur Validierung ist jeder Schritt im Feinabstimmungsprozess wichtig. Durch den Vergleich von Fine Tuning mit anderen Techniken wie Transfer Learning und RAG können Praktiker entscheiden, was für ihre Aufgaben am besten geeignet ist. Feinabstimmung ist ein praktisches, effizientes und kostengünstiges Verfahren zur Verbesserung der Modellleistung und damit ein wertvolles Werkzeug für Deep Learning.

Häufig gestellte Fragen

Was ist Feinabstimmung beim Deep Learning?

Feinabstimmung beim Deep Learning ist die Verfeinerung eines vortrainierten Modells für eine bestimmte Aufgabe, indem seine Parameter mit einem kleineren, aufgabenspezifischen Trainingsdatensatz angepasst werden, um so seine Leistung für diese spezielle Anwendung zu verbessern.

Was sind die wichtigsten Ansätze für die Feinabstimmung?

Die wichtigsten Ansätze für die Feinabstimmung sind die Merkmalsextraktion, bei der nur die letzten Schichten angepasst werden, und die vollständige Feinabstimmung, bei der alle Schichten des Modells angepasst werden. Die Wahl des richtigen Ansatzes hängt von Ihren spezifischen Anforderungen und Ihrem Datensatz ab.

Wie unterscheidet sich die überwachte Feinabstimmung von RLHF?

Die überwachte Feinabstimmung konzentriert sich auf das Training von Modellen mit gelabelten Daten für bestimmte Aufgaben, während RLHF menschliches Feedback nutzt, um die Modellleistung im Laufe der Zeit zu verbessern. Diese Unterscheidung verdeutlicht die unterschiedlichen Ansätze zur Verbesserung der KI-Fähigkeiten.

Was sind die besten Methoden für die Feinabstimmung von Modellen?

Für eine wirksame Feinabstimmung von Modellen sollten Sie sich auf eine gründliche Datenvorbereitung konzentrieren, ein geeignetes vortrainiertes Modell auswählen und die wichtigsten Parameter sorgfältig anpassen, während Sie sie anhand von Leistungskennzahlen validieren und iterieren. Diese Schritte werden die Genauigkeit und Effizienz Ihres Modells verbessern.

Was sind einige praktische Anwendungen der Feinabstimmung?

Die Feinabstimmung wird in der Stimmungsanalyse, bei Chatbots und bei der Textzusammenfassung effektiv eingesetzt, um die Genauigkeit und Relevanz in diesen Bereichen zu verbessern. Die Verwendung fein abgestimmter Modelle kann die Leistung von KI-Anwendungen beim Verstehen und Generieren menschenähnlicher Antworten erheblich verbessern.

- Kurze Zusammenfassung

- Feinabstimmung: Techniken und bewährte Praktiken

- Einleitung

- Feinabstimmung verstehen

- Primäre Ansätze für die Feinabstimmung

- Feinabstimmungstechniken

- Best Practices für die Feinabstimmung

- Reale Anwendungen der Feinabstimmung

- Vergleich der Feinabstimmung mit anderen Techniken

- Zusammenfassung

- Häufig gestellte Fragen

Inhalte

Kostenlos starten, einfach skalieren

Testen Sie die vollständig verwaltete Vektordatenbank, die für Ihre GenAI-Anwendungen entwickelt wurde.

Zilliz Cloud kostenlos ausprobieren