Was ist Backpropagation?

Was ist Backpropagation?

Backpropagation in neuronalen Netzen

Wenn Sie in letzter Zeit durch San Francisco spaziert sind, werden Sie feststellen, dass viele autonome Fahrzeuge von Waymo und Zoox nicht nur auf den Straßen unterwegs sind, sondern auch Tag und Nacht Fahrgäste aufnehmen und absetzen. Diese Fahrzeuge halten sich höflich an die Verkehrsregeln, vermeiden Pannen mit anderen Autos und schaffen es, sich in den Menschenmassen zu den Stoßzeiten zurechtzufinden. Für Menschen, die diesen Anblick nicht gewohnt sind, ist es erstaunlich, diese Heerscharen von Fahrzeugen bei ihrer Arbeit zu sehen!

Autonomes Auto in San Francisco

Autonomes Auto in San Francisco

Ein Verfahren des maschinellen Lernens namens Backpropagation ermöglicht es diesen Fahrzeugen, sich in diesen komplexen Situationen zurechtzufinden. Aber was genau ist Backpropagation, und wie ermöglicht sie ein so ausgeklügeltes Verhalten?

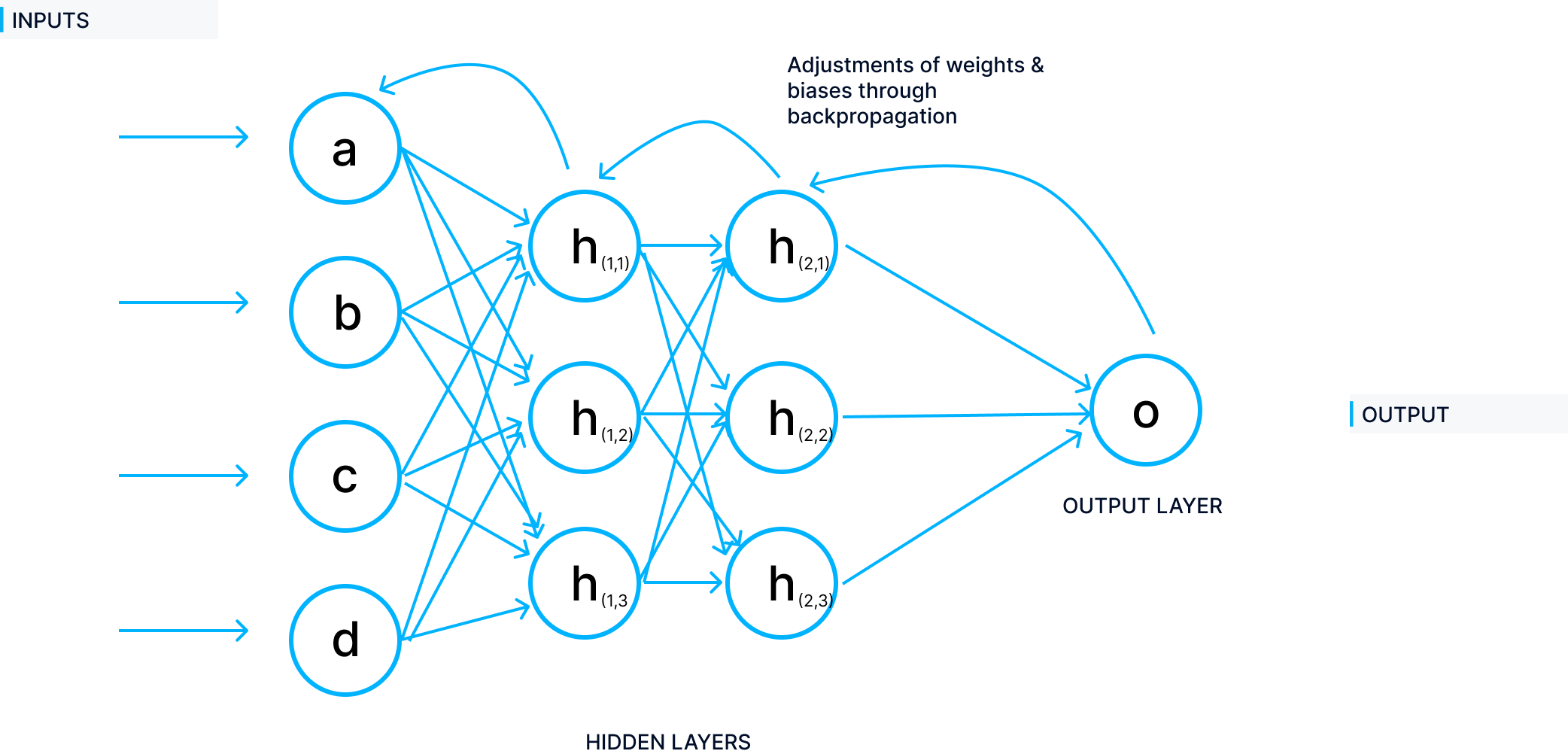

Im Kern ist die Backpropagation ein hocheffizienter Lernmechanismus für künstliche neuronale Netze, der sich stark auf die Aktivierungsfunktion stützt, um die Ausgabe der Neuronen zu bestimmen. Stellen Sie sich einen Fahranfänger vor, der lernt, sich auf den Straßen der Stadt zurechtzufinden. Zu Beginn macht er vielleicht Fehler - er bremst zu stark, biegt zu scharf ab oder schätzt Abstände falsch ein. Mit jedem Fehler passen sie ihre Handlungen an und verbessern so allmählich ihre Fähigkeiten. Backpropagation funktioniert auf ähnliche Weise, aber blitzschnell und mit mathematischer Präzision.

Beim maschinellen Lernen ist Backpropagation der Lehrer im Hintergrund, der den Entscheidungsprozess von KI-Systemen ständig verfeinert. Die Eingabedaten fließen während des Trainingsprozesses durch die Schichten des neuronalen Netzwerkmodells und wirken sich auf die Leistung und Effizienz der Trainings- und Fehleranpassungsprozesse des neuronalen Netzwerks aus. Diese Technik ist nicht nur auf selbstfahrende Autos beschränkt; sie ist die geheime Soße hinter vielen KI-Anwendungen, denen wir täglich begegnen - von Sprachassistenten, die unsere Akzente verstehen, bis hin zu Empfehlungssystemen, die unsere Vorlieben besser zu kennen scheinen als wir selbst, und das alles dank der Ausgabeschicht, die die Vorhersagen des Modells erstellt.

In diesem Beitrag werden wir die verborgenen Schichten der Backpropagation entschlüsseln und untersuchen, wie sie Rohdaten in intelligente Entscheidungen umwandelt. Wir werden die Mathematik aufschlüsseln, ohne uns in Gleichungen zu verlieren, ein praktisches Beispiel durchgehen, mit dem Sie sich identifizieren können, und Ihnen sogar zeigen, wie Sie diese leistungsstarke Technik mit Python implementieren können.

Egal, ob Sie ein angehender Datenwissenschaftler, ein neugieriger Technikenthusiast oder einfach jemand sind, der von der KI-Revolution um uns herum fasziniert ist, das Verständnis der Backpropagation wird Ihnen wertvolle Einblicke in die Maschinerie der modernen KI geben. Lassen Sie uns also in das Herz des maschinellen Lernens eintauchen, wo Zahlen mit Neuronen tanzen, um die intelligenten Systeme zu schaffen, die unsere Welt gestalten.

Was ist der Backpropagation-Algorithmus?

Backpropagation ist ein Backpropagation-Algorithmus, der für das Training von neuronalen Feedforward-Netzwerken, den Arbeitspferden vieler KI-Anwendungen, entscheidend ist.

Stellen Sie sich Backpropagation als einen unermüdlichen Trainer vor, der ein Händchen für datengesteuerte Verbesserungen hat: Ein neuronales Feedforward-Netzwerk nutzt die rekurrente Backpropagation, um seine Gewichte und Verzerrungen während des Trainings anzupassen und so eine optimale Leistung zu gewährleisten.

Es handelt sich dabei nicht um einen einmaligen Prozess, sondern um einen ständigen Zyklus der Verfeinerung. Bei jeder Trainingsrunde (einer so genannten Epoche) analysiert die Backpropagation die Leistung des Netzwerks und nimmt präzise Anpassungen vor. Das ist wie bei einem Trainer, der nach jedem Spielzug das Spielmaterial überprüft und die Strategien in Echtzeit optimiert.

Das Ziel des Algorithmus? Die "Kostenfunktion" zu minimieren, d. h. die Lücke zwischen den Vorhersagen der KI und der Realität zu verringern. Dies geschieht durch die Feinabstimmung der internen Parameter des Netzwerks (Gewichte und Verzerrungen), ähnlich wie bei einem Mechaniker, der die verschiedenen Komponenten eines Motors auf optimale Leistung einstellt.

Bei der Backpropagation werden ausgeklügelte Optimierungstechniken eingesetzt, in der Regel der Gradientenabstieg oder sein enger Verwandter, der stochastische Gradientenabstieg. Diese Methoden helfen dem Netz, sich in der komplexen Landschaft möglicher Lösungen zurechtzufinden, wobei es sich stets in Richtung einer besseren Leistung bewegt.

Im Kern macht sich die Backpropagation ein grundlegendes Prinzip der Kalkulation zunutze: die Kettenregel. Dieses mathematische Werkzeug ermöglicht es dem Algorithmus, die komplexen Schichten des neuronalen Netzes zu durchlaufen und zu bestimmen, wie jede Komponente zum Gesamtfehler beiträgt. Es ist so, als würde man einen Fluss bis zu seiner Quelle zurückverfolgen und verstehen, wie jeder Nebenfluss den Hauptstrom beeinflusst.

Durch die Kombination von iterativem Lernen, intelligenter Optimierung und mathematischer Präzision verwandelt die Backpropagation neuronale Netze von statischen Strukturen in dynamische, selbstverbessernde Systeme. Es geht nicht nur darum, Vorhersagen zu treffen, sondern auch darum, sich ständig weiterzuentwickeln, um bessere Vorhersagen zu treffen und die Grenzen der künstlichen Intelligenz zu erweitern.

Backpropagation neuronaler Netze

Backpropagation neuronaler Netze

Backpropagation-Algorithmen

Mathematisch gesehen ist Backpropagation ein raffinierter Tanz aus Kalkül und Optimierung. Im Kern geht es darum zu verstehen, wie sich Änderungen an den Parametern eines neuronalen Netzes auf seine Gesamtleistung auswirken. Der Prozess beginnt mit einer Verlustfunktion, die den Unterschied zwischen den Vorhersagen des Netzwerks und den tatsächlichen Ergebnissen quantifiziert. Diese Funktion dient als Kompass, der das Netzwerk zu einer besseren Leistung führt. Der Feedforward-Prozess schiebt die Daten durch das Netzwerk, wobei jedes Neuron Gewichte und Verzerrungen anwendet, bevor das Ergebnis durch eine Aktivierungsfunktion geleitet wird.

Hier steht die Mathematik im Mittelpunkt: Backpropagation berechnet partielle Ableitungen, um zu bestimmen, wie jedes Gewicht und jede Vorspannung zum Gesamtfehler beiträgt. Mit der Kettenregel, einem grundlegenden Prinzip der Infinitesimalrechnung, können diese Ableitungen effizient über mehrere Schichten hinweg berechnet werden, um den Gradienten zu ermitteln. Die Lernrate, ein wichtiger Hyperparameter, steuert, wie schnell das Netz seine Parameter als Reaktion auf diese Berechnungen anpasst. Ist sie zu hoch, kann das Netz über seine optimale Konfiguration hinausschießen; ist sie zu niedrig, wird das Lernen schmerzhaft langsam. Dieser gesamte Prozess ist iterativ, wobei jede Epoche (ein vollständiger Durchlauf durch die Trainingsdaten) die Parameter des Netzes verfeinert. Mit der Zeit treibt diese mathematische Maschinerie das Netzwerk zu einer Konfiguration, die die Verlustfunktion minimiert, und bringt der KI so bei, immer genauere Vorhersagen zu treffen.

Den Backpropagation-Algorithmus verstehen

Backpropagation funktioniert in zwei Hauptphasen:

1. Vorwärtspass:

Die Eingabedaten gelangen über die Eingabeschicht in das Netzwerk.

Jedes Neuron in den nachfolgenden Schichten berechnet eine gewichtete Summe seiner Eingaben, fügt eine Vorspannung hinzu und wendet eine Aktivierungsfunktion an.

Die Informationen fließen durch das Netzwerk, wobei die Ausgabe jeder Schicht die Eingabe der nächsten Schicht wird.

Die letzte Schicht erzeugt die Vorhersage des Netzwerks.

2. Rückwärtspass:

Das Netz berechnet den Fehler zwischen seiner Vorhersage und dem tatsächlichen Ziel.

Dieses Fehlersignal pflanzt sich rückwärts durch das Netz fort.

Für jedes Neuron berechnet der Algorithmus, wie sich der Fehler bei kleinen Anpassungen der Gewichte und Verzerrungen verändern würde.

Diese Berechnungen verwenden die Kettenregel, um den Gradienten des Fehlers in Bezug auf jeden Parameter zu bestimmen.

Gewichte und Verzerrungen werden angepasst, um den Fehler zu verringern.

Schlüsselkomponenten:

- Aktivierungsfunktionen: Führen Nichtlinearität ein und ermöglichen es dem Netz, komplexe Muster zu lernen. Üblich sind ReLU für versteckte Schichten und Softmax für Klassifizierungsausgaben.

- Verlustfunktion: Misst die Differenz zwischen Vorhersagen und tatsächlichen Werten. Der mittlere quadratische Fehler wird häufig für die Regression verwendet, während die Kreuzentropie für die Klassifizierung üblich ist.

- Lernrate: Bestimmt die Größe der Gewichtungsaktualisierungen. Sie muss sorgfältig abgestimmt werden, um ein Gleichgewicht zwischen Lerngeschwindigkeit und Stabilität herzustellen.

- Kettenregel: Ermöglicht eine effiziente Gradientenberechnung über mehrere Schichten hinweg und hilft dem Netz, den endgültigen Fehler jedem seiner Parameter zuzuordnen.

Die Effektivität der Backpropagation beruht auf der Fähigkeit, zahlreiche Parameter gleichzeitig anzupassen und so die Vorhersagen des Netzes über mehrere Iterationen schrittweise zu verbessern.

Backpropagation

Backpropagation

Ein Beispiel für Backpropagation in der Praxis

Lassen Sie uns die Backpropagation anhand eines praktischen Beispiels zum Leben erwecken. Stellen Sie sich vor, wir trainieren alle neuronale Netze mit einer einfachen KI, um die Hauspreise in einem belebten Stadtviertel vorherzusagen. Unser neuronales Netz ist wie ein neuer Immobilienmakler, der die Grundlagen der Immobilienbewertung erlernt.

Wir beginnen mit einer grundlegenden Netzwerkarchitektur:

Eine Eingabeschicht (sozusagen die Augen und Ohren des Maklers).

Eine versteckte Schicht (das Gehirn des Agenten).

Eine Ausgabeschicht (die endgültige Preisschätzung).

Bei unserem Datensatz handelt es sich um eine Sammlung von Hausverkäufen der letzten Zeit mit Merkmalen wie Quadratmeterzahl, Anzahl der Schlafzimmer und Lage.

Beim Vorwärts- und Rückwärtsdurchlauf sieht sich unser KI-Agent ein Haus an (gibt die Merkmale ein). Er stellt erste Vermutungen darüber an, wie wichtig jedes Merkmal ist (wendet Gewichte an) und fügt einige persönliche Vermutungen hinzu (Vorurteile). Nach einigen internen Berechnungen (Aktivierungsfunktionen) wird dann eine Preisvorhersage erstellt.

Jetzt kommt der Realitätscheck. Mithilfe einer Verlustfunktion vergleichen wir den quadratischen Fehler der KI-Vorhersage mit dem tatsächlichen Verkaufspreis. Nehmen wir an, unser Agent hat sich um 50.000 $ verschätzt - das ist ein großer Fehler!

An dieser Stelle kommt Backpropagation ins Spiel. Sie ist so etwas wie der Mentor des Agenten, der herausfindet, warum die Vorhersage falsch war. Indem sie rückwärts arbeitet, berechnet sie, wie viel jeder Teil des Entscheidungsprozesses zu dem Fehler beigetragen hat.

Auf der Grundlage dieser Analyse aktualisieren wir die Gewichtungen und Verzerrungen. Vielleicht hat unser Agent zu viel Wert auf die Anzahl der Schlafzimmer gelegt und nicht genug auf die Lage. Wir nehmen kleine Anpassungen vor, um dies zu korrigieren.

Dieser Prozess wiederholt sich für viele Häuser (Iterationen). Unser KI-Agent wird mit jeder Vorhersage und Korrektur ein wenig schlauer. Mit der Zeit nähern sich seine Vorhersagen den tatsächlichen Verkaufspreisen an.

Am Ende des Trainings hat sich unsere KI von einem Anfänger in einen versierten Immobilienbewerter verwandelt, der in der Lage ist, genaue Preisvorhersagen auf der Grundlage der Merkmale eines Hauses zu treffen. Das ist Backpropagation in Aktion - die Umwandlung von Rohdaten in wertvolle Erkenntnisse durch kontinuierliches Lernen und Verfeinern.

Der Cross-Entropie-Verlust* wird für das Training von Klassifizierungsmodellen verwendet. Es handelt sich um eine einfach zu implementierende Verlustfunktion, die für eine genaue Verlustberechnung in numerischen Werten kodierte Bezeichnungen erfordert.

Vorteile der Backpropagation in neuronalen Netzen

Backpropagation hat sich aufgrund mehrerer wichtiger Vorteile zu einem grundlegenden Algorithmus für das Training neuronaler Netze entwickelt:

Zugänglichkeit: Der Algorithmus erfordert kein umfangreiches mathematisches Hintergrundwissen, so dass er auch für Neulinge im Bereich des maschinellen Lernens zugänglich ist. Seine unkomplizierte Implementierung erleichtert die Fehlersuche und Modifikation.

Vielseitigkeit: Backpropagation passt sich gut an verschiedene Netzwerkarchitekturen und Problembereiche an. Sie kann effektiv in Feedforward-Netzen, neuronalen Faltungsnetzen und rekurrenten neuronalen Netzen eingesetzt werden.

Effizientes Lernen: Durch die direkte Berechnung von Fehlergradienten ermöglicht die Backpropagation schnelle Gewichtsanpassungen. Diese Effizienz ist besonders wertvoll in tiefen Netzen, in denen das Lernen komplexer Merkmale zeitaufwändig sein kann.

Verallgemeinerungsfähigkeit: Durch iterative Gewichtungsaktualisierungen hilft Backpropagation den Netzen, die zugrunde liegenden Muster in den Daten zu erkennen. Dies führt zu Modellen, die bei neuen, ungesehenen Beispielen genaue Vorhersagen machen können.

Skalierbarkeit: Der Algorithmus ist für verschiedene Datensatzgrößen und Netzwerkkomplexitäten gut geeignet. Diese Skalierbarkeit macht ihn sowohl für kleine Experimente als auch für groß angelegte industrielle Anwendungen geeignet.

Diese Vorteile haben dazu beigetragen, dass die Backpropagation beim Training neuronaler Netze weit verbreitet ist. Ihre Ausgewogenheit zwischen Einfachheit und Effektivität macht sie zu einem wertvollen Werkzeug für die Entwicklung von Modellen des maschinellen Lernens für verschiedene Anwendungen.

Backpropagation-Implementierung in Python

Es gibt eine Reihe von coolen Python-Projekten, mit denen Sie Backpropagation selbst ausprobieren können.

Implementierung von Backpropagation in Python: Aufbau eines neuronalen Netzes von Grund auf - Andres Berejnoi

- [Blog](https://medium.com/@andresberejnoi/how-to-implement-backpropagation-with-numpy-andres-berejnoi-e7c14f2e683a#id_token=eyJhbGciOiJSUzI1NiIsImtpZCI6IjQ1MjljNDA5Zjc3YTEwNmZiNjdlZTFhODVkMTY4ZmQyY2ZiN2MwYjciLCJ0eXAiOiJKV1QifQ.eyJpc3MiOiJodHRwczovL2FjY291bnRzLmdvb2dsZS5jb20iLCJhenAiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJhdWQiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJzdWIiOiIxMTYzNTE3ODI0NjM1NzcyOTgwMDIiLCJlbWFpbCI6ImNocmlzLmNodXJpbG9AZ21haWwuY29tIiwiZW1haWxfdmVyaWZpZWQiOnRydWUsIm5iZiI6MTcyMzE4MTkzNiwibmFtZSI6IkNocmlzIENodXJpbG8iLCJwaWN0dXJlIjoiaHR0cHM6Ly9saDMuZ29vZ2xldXNlcmNvbnRlbnQuY29tL2EvQUNnOG9jSTYxYU12cG9ITVdSM2NZeXdMOXcxTXZkM2ZORjY3TlB3RkduQkNvcUtUN0gtd3F2d0M9czk2LWMiLCJnaXZlbl9uYW1lIjoiQ2hyaXMiLCJmYW1pbHlfbmFtZSI6IkNodXJpbG8iLCJpYXQiOjE3MjMxODIyMzYsImV4cCI6MTcyMzE4NTgzNiwianRpIjoiMTc1MmFhNjg2MjBkYmE5YzQ4MGExNWU4MDYwZjg3ZGU4M2UxZDBjMiJ9.TsKPdiNBLBFCdEek6Nc-i5yLVkArKch2P1oXJDRsyD

Wie man ein neuronales Netz mit Backpropagation in Python programmiert (von Grund auf)

Backpropagation Anwendungen

Der Einfluss der Backpropagation geht weit über das theoretische maschinelle Lernen hinaus und ermöglicht eine Vielzahl von KI-Anwendungen, die aus unserem täglichen Leben nicht mehr wegzudenken sind. Einige dieser Anwendungen sind:

Autonome Fahrzeuge: Wie bereits bei Waymo und Zoox erwähnt, stützen sich selbstfahrende Autos in hohem Maße auf neuronale Netze, um Sensordaten zu interpretieren, Verkehrsmuster vorherzusagen und Entscheidungen in Sekundenbruchteilen zu treffen. Durch Backpropagation können diese Fahrzeuge aus jeder Fahrt lernen und ihre Navigations- und Sicherheitsprotokolle kontinuierlich verbessern.

Medizinische Diagnose: KI-Systeme unterstützen zunehmend medizinisches Fachpersonal bei der Interpretation von medizinischen Bildern wie Röntgenaufnahmen, MRTs und CT-Scans. Dank Backpropagation können diese Systeme aus riesigen Datenbanken mit medizinischen Bildern lernen und oft subtile Anomalien erkennen, die dem menschlichen Auge entgehen könnten.

[Verarbeitung natürlicher Sprache] (https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models): Über Sprachassistenten hinaus unterstützt Backpropagation maschinelle Übersetzungsdienste, Tools zur Stimmungsanalyse und Chatbots. Diese Anwendungen sind in der Lage, Kontext, Nuancen und sogar Sarkasmus in geschriebenen Texten zu verstehen, Sprachbarrieren zu überbrücken und die Kommunikation zu verbessern.

Empfehlungssysteme: Streaming-Dienste wie Netflix und Spotify nutzen neuronale Netze, um Ihre Seh- oder Hörgewohnheiten zu analysieren und Ihnen Inhalte vorzuschlagen, die Ihnen gefallen könnten. Mithilfe von Backpropagation lernen diese Systeme aus den Interaktionen der Nutzer und verfeinern ihre Empfehlungen kontinuierlich.

Robotik: In der Fertigung und Forschung verwenden Roboter neuronale Netze, um komplexe Aufgaben zu erlernen, von präzisen Montagevorgängen bis hin zur Navigation in unvorhersehbaren Umgebungen. Mit Backpropagation können diese Roboter ihre Bewegungen und Entscheidungsprozesse im Laufe der Zeit verfeinern.

Diese Anwendungen stellen nur einen Bruchteil des Einflusses von Backpropagation dar. Im Zuge der Weiterentwicklung der künstlichen Intelligenz steht dieser Algorithmus weiterhin im Mittelpunkt von Innovationen, die Branchen umgestalten, die wissenschaftliche Forschung vorantreiben und unsere Interaktion mit der Technologie verändern.

*Dieser Beitrag behandelt Grundlagen der natürlichen Sprachverarbeitung, die für das Verständnis aller heutigen Sprachmodelle unerlässlich sind.

Herausforderungen und Überlegungen:

Obwohl die Backpropagation das maschinelle Lernen revolutioniert hat, ist sie nicht ohne Herausforderungen und Überlegungen. Lassen Sie uns einige der wichtigsten Probleme untersuchen, mit denen Forscher und Praktiker zu kämpfen haben:

Problem des schwindenden Gradienten: In tiefen neuronalen Netzen können die Gradienten extrem klein werden, wenn sie durch die Schichten zurückverfolgt werden. Dies kann zu einem schmerzhaft langsamen Lernen oder sogar zu einem völligen Stillstand des Trainings in den früheren Schichten führen. Es ist so, als würde man versuchen, eine Nachricht durch eine lange Menschenkette zu flüstern - bis sie das Ende erreicht, könnte die Nachricht verloren sein.

Explodierendes Gradientenproblem: Dies ist die Kehrseite der verschwindenden Gradienten und tritt auf, wenn die Gradienten extrem groß werden, was zu instabilen Aktualisierungen der Netzgewichte führt. Dies ist vergleichbar mit einer kleinen Änderung der Eingabe, die eine unverhältnismäßig große Änderung der Ausgabe verursacht, wodurch das Netzwerk unzuverlässig wird.

Lokale Minima-Fallen: Backpropagation zielt darauf ab, das globale Minimum der Verlustfunktion zu finden, aber es kann in lokalen Minima stecken bleiben, was zu suboptimalen Lösungen führt. Stellen Sie sich vor, Sie versuchen mit verbundenen Augen den tiefsten Punkt in einer Hügellandschaft zu finden - Sie könnten denken, dass Sie den Boden erreicht haben, obwohl Sie sich eigentlich nur in einer kleinen Senke befinden.

Berechnungsintensität: Das Training großer neuronaler Netze mit Backpropagation kann extrem rechenintensiv sein und erfordert viel Zeit und Ressourcen. Dies kann den Zugang zum Deep Learning auf diejenigen beschränken, die Zugang zu leistungsstarker Hardware haben.

Overfitting: Aufgrund seiner Fähigkeit, komplexe Muster zu lernen, kann ein Netzwerk, das Backpropagation verwendet, manchmal das Rauschen in den Trainingsdaten zu gut lernen, was zu einer schlechten Generalisierung auf neue Daten führt. Es ist, als würde man die Antworten auf einen Test auswendig lernen, anstatt die zugrunde liegenden Prinzipien zu verstehen.

Hyperparameter-Abstimmung: Die Wahl der richtigen Lernrate, Stapelgröße und Netzwerkarchitektur kann mehr Kunst als Wissenschaft sein und erfordert oft umfangreiche Experimente. Es ist ein empfindliches Gleichgewicht - zu aggressiv, und das Modell könnte nie konvergieren; zu konservativ, und das Training könnte eine unpraktisch lange Zeit dauern.

Nicht-differenzierbare Aktivierungsfunktionen: Backpropagation beruht auf der Berechnung von Gradienten, was bei nicht-differenzierbaren Aktivierungsfunktionen wie der Stufenfunktion problematisch wird. Dies schränkt die Arten von neuronalen Architekturen ein, die leicht trainiert werden können.

Katastrophales Vergessen: Beim Training auf neue Daten können neuronale Netze zuvor gelernte Informationen schnell vergessen. Dies ist eine besondere Herausforderung in Szenarien, die kontinuierliches Lernen erfordern.

Probleme der Interpretierbarkeit: Aufgrund der Komplexität tiefer neuronaler Netze ist es schwierig zu interpretieren, warum ein Netz eine bestimmte Entscheidung getroffen hat. Diese "Blackbox"-Natur kann bei Anwendungen, die Transparenz erfordern, wie im Gesundheits- oder Finanzwesen, problematisch sein.

Datenabhängigkeit: Die Effektivität von Backpropagation hängt stark von der Qualität und Quantität der Trainingsdaten ab. In Szenarien mit begrenzten oder voreingenommenen Daten kann der Algorithmus Schwierigkeiten haben, effektiv zu lernen, oder er kann bestehende Voreingenommenheiten verewigen.

Die Bewältigung dieser Herausforderungen ist ein aktives Forschungsgebiet in der Gemeinschaft des maschinellen Lernens. Techniken wie [Batch-Normalisierung] (https://zilliz.com/learn/layer-vs-batch-normalization-unlocking-efficiency-in-neural-networks), Restverbindungen und adaptive Lernraten wurden entwickelt, um einige dieser Probleme zu entschärfen. Mit den Fortschritten auf diesem Gebiet werden durch neue Innovationen die Grenzen dessen, was mit Backpropagation und neuronalen Netzen möglich ist, weiter verschoben.

Zukünftige Implikationen:

Wenn wir in die Zukunft der KI blicken, steht Backpropagation an einem faszinierenden Scheideweg. Sie ist zwar nach wie vor ein Eckpfeiler des Deep Learning, aber die sich abzeichnenden Trends deuten auf eine Landschaft hin, die sowohl Evolution als auch Revolution bedeutet. Hier ein kleiner Einblick in die Zukunft:

Quantum-Backpropagation: Mit dem Aufkommen von Quantencomputern erforschen Forscher Quantenversionen der Backpropagation. Diese könnten Optimierungsprobleme potenziell exponentiell schneller lösen als klassische Methoden und so die Möglichkeit eröffnen, weitaus komplexere Netzwerke zu trainieren.

Neuromorphes Rechnen: In dem Maße, wie sich die KI-Hardware weiterentwickelt, um biologische Gehirne besser zu imitieren, könnten neue Formen der Backpropagation entstehen, die energieeffizienter sind und in Echtzeit lernen können, ähnlich wie sich unser Gehirn kontinuierlich anpasst.

Föderiertes Lernen: Künftige Backpropagation-Algorithmen könnten eine bessere Wahrung der Privatsphäre bei der KI ermöglichen, so dass Modelle aus verteilten Datensätzen lernen können, ohne dass sensible Informationen zentralisiert werden. Dies könnte Bereiche wie die KI im Gesundheitswesen revolutionieren, in denen der Schutz der Daten von größter Bedeutung ist.

Erklärbare KI: Da die Nachfrage nach KI-Transparenz wächst, könnten wir neue Backpropagationstechniken sehen, die nicht nur die Leistung optimieren, sondern auch klarere Einblicke in den Entscheidungsfindungsprozess neuronaler Netze bieten.

Meta-Lernen: In Zukunft könnte Backpropagation nicht nur die Modellparameter optimieren, sondern auch lernen, wie man lernt. Dies könnte zu KI-Systemen führen, die sich mit minimalem Training an neue Aufgaben anpassen, ähnlich wie die menschliche Intuition.

Kontinuierlich lernende Systeme: Fortschritte bei der Backpropagation könnten das Problem des katastrophalen Vergessens lösen und zu KI-Systemen führen, die während ihrer gesamten Betriebsdauer kontinuierlich lernen und sich ständig verbessern, ohne zuvor erworbenes Wissen zu verlieren.

Hybride Lernansätze: Es ist denkbar, dass die Backpropagation mit anderen Lernparadigmen, wie dem Verstärkungslernen oder evolutionären Algorithmen, kombiniert wird, um robustere und vielseitigere KI-Systeme zu schaffen.

Emotionale und soziale Intelligenz: Künftige Backpropagationstechniken könnten KI-Systemen helfen, menschliche Emotionen besser zu verstehen und darauf zu reagieren, was zu einfühlsameren und sozial intelligenteren KI-Assistenten führen könnte.

Umweltanpassungn: Da KI-Systeme in unterschiedlichen und unvorhersehbaren Umgebungen eingesetzt werden, könnten neue Formen der Backpropagation eine schnelle Anpassung an sich ändernde Bedingungen ermöglichen, was für Anwendungen wie Katastrophenschutzroboter oder Klimaüberwachungssysteme entscheidend ist.

Ethisches KI-Training: Künftige Backpropagation-Algorithmen könnten ethische Überlegungen direkt in den Lernprozess einbeziehen und so dazu beitragen, KI-Systeme zu schaffen, die nicht nur intelligent sind, sondern auch mit menschlichen Werten und gesellschaftlichen Normen in Einklang stehen.

Diese potenziellen Fortschritte deuten auf eine Zukunft hin, in der sich die Backpropagation über ihre derzeitige Form hinaus weiterentwickelt und die KI-Innovation auf eine Art und Weise vorantreibt, die wir uns gerade erst vorzustellen beginnen. Wie bei allen technologischen Vorhersagen können sich einige von ihnen bewahrheiten, während andere völlig unvorhergesehene Entwicklungen nach sich ziehen. Sicher ist jedoch, dass die Prinzipien der Backpropagation die Entwicklung der KI in den kommenden Jahren weiter prägen werden.

Interdisziplinäre Relevanz mit Vektordatenbanken:

Der Einfluss von Backpropagation erstreckt sich über zahlreiche Disziplinen, wobei Vektordatenbanken eine entscheidende Rolle spielen:

Kognitive Neurowissenschaften: Simulation neuronaler Prozesse zum Verständnis der menschlichen Kognition.

Computergestützte Linguistik: Revolutionierung der Sprachverarbeitung und -erzeugung.

Computer Vision: Verbesserte Bildinterpretation für medizinische Bildgebung und autonome Fahrzeuge.

Bioinformatik: Vorhersage von Proteinstrukturen und Genfunktionen.

Finanzen: Entwicklung von Vorhersagemodellen für Markttrends und Risikobewertung.

Robotik: Unterstützung von Robotern bei der Anpassung an neue Umgebungen.

Werkstoffkunde: Vorhersage von Materialeigenschaften und Entwicklung neuer Verbindungen.

Klimawissenschaft: Erstellung komplexer Klimamodelle und Analyse von Wettermustern.

Empfehlungssysteme: Verfeinerung der Benutzerpräferenzen für die Bereitstellung personalisierter Inhalte.

Cybersecurity: Erkennung von Anomalien und potenziellen Bedrohungen im Netzverkehr.

Vektordatenbanken verbessern diese Anwendungen, indem sie hochdimensionale Daten effizient speichern und abrufen, was für neuronale Netze, die mittels Backpropagation trainiert werden, entscheidend ist. Diese Synergie ermöglicht ein schnelleres Training, effizientere Schlussfolgerungen und die Arbeit mit größeren, komplexeren Datensätzen.

Während sich KI und maschinelles Lernen weiterentwickeln, versprechen die interdisziplinären Anwendungen der Backpropagation, unterstützt durch Vektordatenbanken, neue Grenzen in einer wachsenden Anzahl von Bereichen zu eröffnen, vom Quantencomputing bis zu kreativen KI-Systemen.

- Backpropagation in neuronalen Netzen

- Was ist der Backpropagation-Algorithmus?

- Backpropagation-Algorithmen

- Den Backpropagation-Algorithmus verstehen

- Ein Beispiel für Backpropagation in der Praxis

- Vorteile der Backpropagation in neuronalen Netzen

- Backpropagation-Implementierung in Python

- Backpropagation Anwendungen

- Herausforderungen und Überlegungen:

- Zukünftige Implikationen:

- Interdisziplinäre Relevanz mit Vektordatenbanken:

Inhalte

Kostenlos starten, einfach skalieren

Testen Sie die vollständig verwaltete Vektordatenbank, die für Ihre GenAI-Anwendungen entwickelt wurde.

Zilliz Cloud kostenlos ausprobieren