Cadeia de pensamento: Orientar a IA para pensar passo a passo

Cadeia de pensamento: Orientar a IA para pensar passo a passo

O que é o Prompting de Cadeia de Pensamento?

Chain-of-thought (CoT) é uma técnica de prompt engineering que ajuda grandes Large Language Models (LLMs) a dividir problemas complexos em etapas menores e mais fáceis. Em vez de dar uma resposta direta, o modelo percorre uma sequência de pensamentos ou raciocínios, tal como uma pessoa pode resolver um problema passo a passo.

Como funciona o Prompting de Cadeia de Pensamento?

O prompting de cadeia de pensamento funciona guiando [modelos de IA] (https://zilliz.com/glossary/foundation-models) para resolver problemas complexos passo a passo. Este método baseia-se no raciocínio sequencial; cada passo baseia-se no anterior. Por exemplo, suponhamos que o modelo é confrontado com um problema de matemática difícil. Em vez de tentar dar a resposta final de imediato, começa por trabalhar com cálculos mais pequenos ou passos lógicos, conduzindo a um resultado final mais exato. Este processo de decomposição do problema ajuda o modelo a obter a resposta correta e a compreender como chegou a essa resposta, melhorando a qualidade geral da resposta.

Exemplo prático: Antes e depois da solicitação de cadeia de raciocínio

Vamos compreender como funciona o CoT através de um exemplo em ação. Os dois prompts mostram como a solicitação de cadeia de raciocínio afeta a resposta do modelo de IA.

1. Aviso antes de CoT

Categorize os seguintes comentários de utilizadores como 'Positivos', 'Negativos' ou 'Neutros':

"O produto chegou tarde, mas funciona bem."

"Serviço e qualidade absolutamente fantásticos!"

Não gostei da cor, mas o apoio ao cliente foi prestável."_

"Experiência terrível. Não recomendo."

"Não é mau, faz o trabalho."

Resposta:

Prompt sem COT.png

Prompt sem COT.png

Figura: Prompt sem CoT

**Análise

No prompt ingénuo, o modelo fornece um resultado básico em que cada revisão é simplesmente categorizada sem explicar como chegou a cada decisão. Não mostra ao utilizador o raciocínio por trás da categorização nem fornece informações sobre que palavras ou frases específicas foram consideradas positivas ou negativas. O resultado é correto, mas carece de profundidade e transparência.

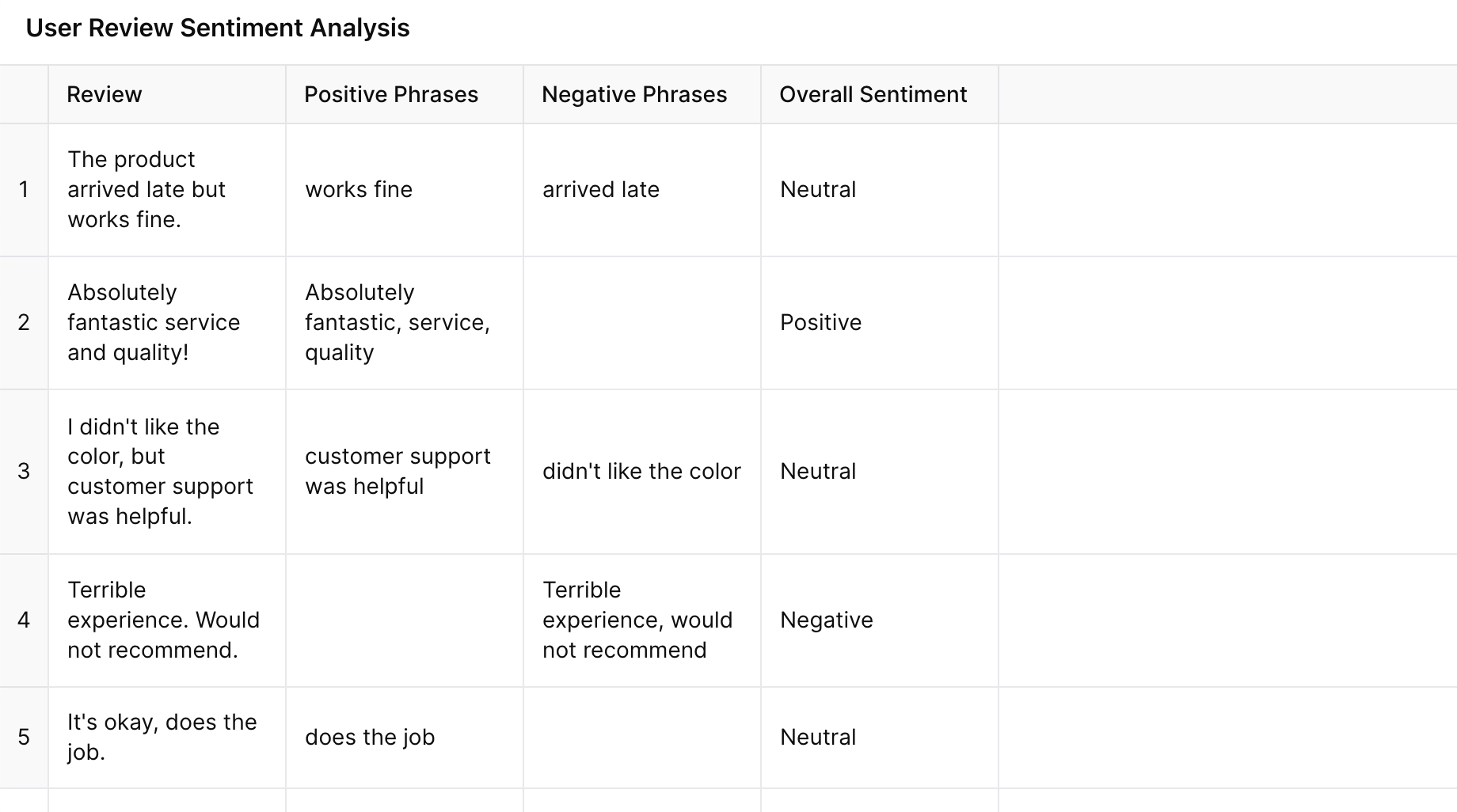

2. Aviso após CoT

- Categorize os seguintes comentários de utilizadores como "Positivos", "Negativos" ou "Neutros". Para cada comentário, siga estes passos:

_Leia a crítica com atenção.

Identifique quaisquer palavras ou frases positivas.

Identifique as palavras ou frases negativas.

Avaliar o sentimento global com base nos elementos positivos e negativos.

Atribuir a categoria adequada.

Na saída, apresente toda a informação numa tabela.

Proceder com cada revisão:

"O produto chegou tarde mas funciona bem."

"Serviço e qualidade absolutamente fantásticos!"

Não gostei da cor, mas o apoio ao cliente foi prestável."_

"Experiência terrível. Não recomendo."

Não é mau, cumpre a função.

Resposta:

Prompt com CoT

Prompt com CoT

Figura: Prompt com CoT

**Análise

O modelo explica o seu raciocínio identificando frases positivas e negativas em cada avaliação, dando ao utilizador uma compreensão clara da decisão.

É gerada uma tabela que não só lista a categoria final, mas também mostra as frases de sentimento chave para cada avaliação, tornando o resultado mais estruturado e transparente.

Variantes da cadeia de pensamento com exemplos de sugestões

Aqui estão os diferentes tipos de estímulos da Cadeia de Pensamento com exemplos práticos de estímulos para cada um:

1. Padrão da Cadeia de Pensamento

Este tipo de cadeia de pensamentos pede ao modelo para pensar em cada parte do problema, passo a passo.

Exemplo de dica:

_Um comboio que se desloca a 60 milhas por hora tem de percorrer 180 milhas. Quanto tempo é que vai demorar a completar a viagem? Vamos fazer isto passo a passo.

Resposta esperada do modelo:

"O comboio está a viajar a 60 milhas por hora."

"A distância a percorrer é de 180 milhas."

"Para saber o tempo, temos de dividir a distância pela velocidade: 180 ÷ 60 = 3."

"Portanto, serão necessárias 3 horas para chegar ao destino."

2. Prompting de cadeia de pensamento de poucos disparos

Numa CoT de poucas tentativas, o modelo recebe alguns exemplos antes de lhe ser pedido que resolva um novo problema.

Exemplo de Prompt:

_"Aqui está um exemplo: Qual é a velocidade de um carro que percorre 100 quilómetros em 2 horas? A velocidade é 100 ÷ 2 = 50 milhas por hora.

Aqui está outro exemplo: Se um avião percorrer 600 milhas em 3 horas, a velocidade é 600 ÷ 3 = 200 milhas por hora.

Agora, utilizando os mesmos passos, se um ciclista percorrer 90 milhas em 3 horas, qual é a sua velocidade?

**Resposta esperada do modelo

"A distância é de 90 milhas, e o tempo é de 3 horas".

"Para encontrar a velocidade, dividimos 90 por 3."

"90 ÷ 3 = 30 milhas por hora."

3. Cadeia de pensamento de autoconsistência

O modelo gera vários caminhos de raciocínio e escolhe a resposta mais consistente.

**Exemplo de introdução

"Se uma pessoa comprar 6 maçãs por $12, quanto é que custa cada maçã? Vamos tentar resolver este problema de formas diferentes e comparar as respostas." Resposta esperada do modelo:

Caminho 1:

- "O custo total é $12, e há 6 maçãs."

- "$12 ÷ 6 = $2 por maçã." Caminho 2:

- "Se 6 maçãs custam $12, então cada maçã custa $2 porque $12 dividido por 6 é igual a $2." Resposta final: "Ambos os métodos conduzem ao mesmo resultado, pelo que o custo por maçã é $2."

4. Cadeia de pensamento interactiva

Nesta variante, o modelo pede esclarecimentos ou informações adicionais quando necessário.

Exemplo de prompt:

"Tens um total de 50 dólares e queres comprar alguns livros. Cada livro custa 7 dólares. Quantos livros pode comprar e quanto dinheiro é que vai sobrar? Por favor, pergunte se precisa de mais informações antes de resolver."

Resposta esperada do modelo:

1. "Há impostos incluídos no preço do livro, ou é apenas $7 por livro?"

(Se o utilizador confirmar que é $7 por livro sem impostos)

2. "Muito bem, sem impostos, $50 a dividir por $7 dá cerca de 7 livros. Como 7 × 7 é igual a 49."

3. "Terás $1 de sobra depois de comprares 7 livros."

5. Cadeia de pensamento de múltiplos agentes

Neste caso, vários agentes de IA trabalham juntos para resolver o problema, abordando diferentes partes.

Exemplo de prompt:

"Há 45 alunos e 9 professores a viajar. Se cada autocarro tem capacidade para 15 pessoas, quantos autocarros são necessários? Vamos fazer com que um agente calcule o número total de pessoas, outro agente calcule a divisão e um terceiro agente verifique a solução."

Resposta esperada do modelo:

Agente 1: "O número total de pessoas é 45 alunos + 9 professores = 54 pessoas."

Agente 2: "Dividimos 54 pessoas por 15 por autocarro: 54 ÷ 15 = 3,6, o que significa que precisamos de 4 autocarros."

Agente 3: "O número total de pessoas e o cálculo estão corretos." Precisamos de 4 autocarros."

6. Cadeia de pensamento recursiva

O modelo verifica o seu próprio raciocínio e revê os passos se necessário. Exemplo de proposta: "Com \$120 na mão, gastas $45 em compras, $30 em gasolina e $20 em entretenimento. Quanto dinheiro é que te resta? Por favor, verifique os seus cálculos à medida que avança." Resposta esperada do modelo:

- "Começando com $120."

- "$120 - $45 = $75."

- "$75 - $30 = $45."

- "$45 - $20 = $25."

- "A verificar: $120 - $45 = $75, depois $75 - $30 = $45, e finalmente $45 - $20 = $25. A resposta é $25."

Quando usar o estímulo da cadeia de raciocínio

A sugestão de cadeia de pensamento é adequada para tarefas que requerem raciocínio em várias etapas, pensamento lógico ou análise cuidadosa. Abaixo estão alguns cenários em que o CoT pode ser útil:

Problemas matemáticos ou cálculos: Quando a tarefa envolve várias operações ou cálculos, CoT guia o modelo através de cada passo. Por exemplo, a resolução de problemas de palavras ou de aritmética complexa requer a decomposição da informação em partes mais pequenas e manejáveis antes de efetuar os cálculos.

Raciocínio lógico e dedução: O CoT é excelente para tarefas em que o modelo tem de analisar a informação passo a passo, quer seja para tomar uma decisão com base em vários factores ou para resolver um puzzle que envolva passos lógicos.

Resolução de problemas em várias etapas: Tarefas como equilibrar um orçamento, seguir uma receita ou resolver um problema técnico requerem frequentemente várias etapas. CoT ajuda o modelo a seguir estes passos na ordem correta.

Resposta a perguntas complexas: CoT pode guiar o modelo através do raciocínio necessário para dar uma resposta mais precisa e detalhada quando lhe são colocadas perguntas complexas em ciência, direito ou filosofia. Em vez de adivinhar, analisa os factos e a lógica necessários para formar uma resposta sólida.

Melhorar ainda mais a solicitação de cadeia de raciocínio

Para aumentar ainda mais a eficácia da pergunta, algumas outras técnicas podem ser combinadas para lidar com o raciocínio. Por exemplo:

Fornecer pistas claras e estruturadas: A qualidade da pista tem um impacto significativo no raciocínio. As instruções devem ser concebidas de forma a melhorar o CoT para dividir os problemas em passos lógicos. Quanto mais estruturado e pormenorizado for o aviso, melhor o modelo seguirá o processo de raciocínio.

Combinar a CoT com a Aprendizagem de Poucas Oportunidades: A aprendizagem de poucas oportunidades, em que o modelo dá alguns exemplos de raciocínio através de problemas, pode melhorar a CoT. Ao mostrar ao modelo vários casos semelhantes em que foi utilizado o raciocínio passo-a-passo, ele pode compreender melhor como abordar novas tarefas.

Autorreflexão e verificação: Uma forma de melhorar o CoT é levar o modelo a verificar o seu próprio raciocínio. Depois de gerar uma resposta, o modelo pode ser convidado a rever os seus passos para ver se fazem sentido. Isto ajuda a detetar quaisquer erros lógicos ou lacunas antes de dar a resposta final.

Auto-consistência incorporada: A auto-consistência é um método em que o modelo gera vários caminhos de raciocínio e depois compara-os para ver se levam à mesma conclusão. Se os vários caminhos estiverem de acordo, é mais provável que o modelo tenha chegado à resposta correta. Por exemplo, pode ser pedido ao modelo que resolva um problema de duas formas diferentes e, em seguida, pode ser selecionada a resposta mais consistente entre as diferentes abordagens.

Limitações do estímulo da cadeia de raciocínio

Embora a solicitação da cadeia de raciocínio seja uma abordagem poderosa para melhorar o raciocínio da IA, ela tem algumas limitações que podem afetar sua eficácia em determinados cenários.

1. Suscetibilidade a erros de raciocínio: A CoT depende de o modelo seguir um processo lógico, passo a passo. No entanto, se o modelo cometer um erro numa etapa, esse erro pode ser transferido para a resposta final.

2. Sobrecarga de tempo e recursos: A CoT requer mais recursos computacionais porque o modelo tem de pensar em cada passo em vez de dar uma resposta direta. Isto pode tornar o processo mais lento e mais intensivo em recursos, especialmente para problemas complexos ou com várias etapas. Em situações em que a velocidade é uma prioridade, o CoT pode não ser o ideal.

**4. A eficácia do CoT depende muito da qualidade das instruções fornecidas. Se o prompt não for claro ou bem estruturado, o modelo pode ter dificuldade em raciocinar sobre o problema. A elaboração destas instruções requer esforço e experiência.

5. Generalização limitada a tarefas desconhecidas: A CoT é altamente eficaz para tarefas que já viu antes ou que se assemelham muito a tarefas anteriores. No entanto, quando confrontado com problemas ou tarefas desconhecidas, fora dos seus dados de treino, o modelo pode ter dificuldade em aplicar CoT de forma eficaz, uma vez que se baseia em padrões de raciocínio aprendidos.

6. Risco de sobreajuste à estrutura das instruções: Com o tempo, um modelo treinado para usar CoT pode tornar-se demasiado dependente de instruções específicas, limitando a flexibilidade. O Overfitting pode esperar que os problemas sejam sempre apresentados num determinado formato, tornando mais difícil para o modelo adaptar-se a tarefas novas ou com formulações diferentes.

Casos de utilização no mundo real de instruções de cadeia de pensamento

A indução em cadeia de pensamento tem uma vasta gama de aplicações práticas em vários domínios. Eis alguns dos principais casos de utilização no mundo real em que a CoT pode ser altamente benéfica:

1. Resolução de problemas matemáticos

O CoT é extremamente útil no ensino da matemática e nas plataformas de tutoria. Os alunos podem entender o processo, dividindo os problemas de matemática em etapas menores e lógicas, em vez de apenas obter a resposta final. Também é útil para cálculos avançados em áreas como álgebra, cálculo e estatística.

2. Raciocínio jurídico e análise de contratos

Nos sistemas jurídicos, o CoT ajuda os sistemas de IA a avaliar documentos jurídicos, analisar cláusulas e gerar aconselhamento jurídico, percorrendo sistematicamente cada ponto de um contrato ou caso. Também pode explicar passo a passo o [raciocínio jurídico] (https://zilliz.com/blog/simplifying-legal-research-with-rag-milvus-ollama), o que torna a IA mais transparente e fiável nos processos jurídicos.

3. Apoio ao cliente e resolução de problemas

A CoT ajuda os chatbots ou sistemas de apoio orientados por IA a guiar os utilizadores através de processos de resolução de problemas passo a passo. Isto é útil para questões técnicas, em que o utilizador tem de seguir instruções ou passos de diagnóstico para resolver um problema.

4. Diagnóstico médico e apoio à decisão

O CoT pode ajudar médicos ou profissionais de saúde a analisar sintomas, resultados de testes e histórico médico para sugerir possíveis diagnósticos ou tratamentos, explicando como cada conclusão é alcançada.

5. Resposta a perguntas complexas

O CoT é altamente eficaz na resposta a perguntas complexas que requerem mais do que apenas a recuperação de um facto. Para perguntas em domínios como a história, a ciência ou o direito, o CoT pode ajudar os sistemas de IA a fornecer respostas detalhadas e em várias etapas, explicando o raciocínio da resposta.

6. Estratégia de jogo e resolução de puzzles

Nos jogos, as estratégias são geradas considerando vários passos numa sequência. O CoT decompõe estratégias complexas em cenários de jogos ou de resolução de puzzles em movimentos mais pequenos e ponderados que conduzem a uma melhor tomada de decisões e jogabilidade em jogos como o xadrez, Go ou jogos baseados em puzzles.

Como é que o Milvus pode aumentar a eficiência da solicitação de cadeia de pensamento?

O Milvus, uma base de dados vetorial de código aberto desenvolvida por Zilliz, foi concebido para armazenar e recuperar dados não estruturados de forma eficiente, como imagens, texto e vídeo. Enquanto o estímulo da cadeia de pensamento se centra na melhoria das capacidades de raciocínio dos modelos de IA, o Milvus melhora a forma como estes modelos gerem e processam dados vectoriais em grande escala.

- Recuperação eficiente de dados para raciocínios complexos: A CoT depende do facto de os modelos de IA terem acesso a informações relevantes para raciocinarem passo a passo. O Milvus é um backend eficiente, que armazena grandes quantidades de dados vectoriais (como texto incorporado) e permite uma recuperação rápida. Isto permite que os modelos de IA acedam aos dados de que necessitam em cada etapa do processo de raciocínio sem atrasos.

Apoio a aplicações de grande escala: Os pedidos de CoT requerem o tratamento de conjuntos de dados extensos para raciocínio em várias etapas em muitos casos do mundo real. A utilização do Milvus em muitos casos reais permite que os modelos de IA trabalhem com grandes conjuntos de dados sem comprometer a velocidade ou o desempenho.

Pesquisas de semelhança optimizadas: O Milvus foi concebido para [pesquisas semânticas] (https://zilliz.com/glossary/semantic-search) e [pesquisas de semelhança] rápidas (https://zilliz.com/learn/vetor-similarity-search), o que melhora a CoT ao permitir que a IA aceda rapidamente a dados semanticamente relacionados. Isto acelera o processo de raciocínio, uma vez que o modelo pode obter informações relevantes de forma mais precisa e eficiente ao resolver problemas em várias etapas.

Conclusão

Em resumo, o Chain-of-Thought Prompting ajuda os modelos de IA a resolver problemas complexos, dividindo-os em passos lógicos, melhorando a precisão e a clareza. O Milvus melhora este processo ao permitir o acesso rápido a grandes quantidades de dados não estruturados, para que a IA possa obter informações relevantes à medida que avança em cada passo. A CoT e a Milvus oferecem soluções práticas para lidar com tarefas complexas em áreas como a investigação, o apoio ao cliente e a análise financeira, tornando a IA mais eficaz e fiável em aplicações do mundo real.

FAQs sobre a solicitação de cadeia de raciocínio

Como é que o Chain-of-Thought Prompting melhora o raciocínio da IA?

A solicitação de cadeia de raciocínio melhora o raciocínio da IA ao orientar o modelo através de problemas passo a passo. Esse método incentiva o modelo a dividir tarefas complexas em partes menores e gerenciáveis, reduzindo erros e aumentando a precisão.

- Quando deve ser usado o prompt de cadeia de raciocínio?

O CoT é melhor utilizado para tarefas que requerem raciocínio em várias etapas, análise lógica profunda ou resolução de problemas complexos. Os exemplos incluem problemas de matemática, deduções lógicas, resolução de problemas técnicos e processos de tomada de decisão multifacetados.

- Quais são os principais benefícios do Chain-of-Thought Prompting?

Os principais benefícios do CoT incluem maior precisão, melhor tratamento de problemas complexos, redução de erros, maior transparência do modelo e uma abordagem estruturada que torna o raciocínio de IA mais compreensível e fiável.

- Como é que o Milvus melhora a eficiência do Chain-of-Thought Prompting?

O Milvus melhora a solicitação de CoT ao armazenar e recuperar de forma eficiente dados não estruturados em grande escala, como texto e imagens. Permite que os modelos de IA acedam rapidamente a dados relevantes em cada fase de raciocínio para um desempenho suave e rápido em tarefas complexas e com várias etapas.

- Como é que o Chain-of-Thought Prompting difere das respostas de IA tradicionais?

As respostas tradicionais de IA tentam frequentemente fornecer uma resposta direta sem detalhar o processo de raciocínio. Por outro lado, o Chain-of-Thought Prompting orienta o modelo na explicação de seu raciocínio passo a passo, oferece transparência e segue uma progressão lógica em direção à solução.

Recursos relacionados

Geração de mensagens de texto para imagem com o Milvus](https://zilliz.com/blog/llm-powered-text-to-image-prompt-generation-with-milvus)

ChatGPT+ Base de dados vetorial + prompt-as-code - A pilha CVP](https://zilliz.com/blog/ChatGPT-VectorDB-Prompt-as-code)

- O que é o Prompting de Cadeia de Pensamento?

- Como funciona o Prompting de Cadeia de Pensamento?

- Variantes da cadeia de pensamento com exemplos de sugestões

- Quando usar o estímulo da cadeia de raciocínio

- Melhorar ainda mais a solicitação de cadeia de raciocínio

- Limitações do estímulo da cadeia de raciocínio

- Casos de utilização no mundo real de instruções de cadeia de pensamento

- Como é que o Milvus pode aumentar a eficiência da solicitação de cadeia de pensamento?

- Conclusão

- FAQs sobre a solicitação de cadeia de raciocínio

- Recursos relacionados

Conteúdo

Comece grátis, escale facilmente

Experimente o banco de dados totalmente gerenciado, construído para seus aplicativos GenAI.

Experimente o Zilliz Cloud grátis