Geração Aumentada por Recuperação (RAG)

Limitações de LLMs

Falta de informações específicas de domínio

Os LLMs são treinados exclusivamente com dados publicamente disponíveis. Portanto, podem não ter conhecimento de informações específicas de domínio, proprietárias ou privadas que não estão acessíveis ao público.

Propensão à alucinação

Os LLMs só podem fornecer respostas com base nas informações que possuem. Eles podem fornecer informações incorretas ou fabricadas se não tiverem dados suficientes para consultar.

Custoso e lento

Os LLMs cobram por cada token nas consultas, resultando em altos custos, especialmente para perguntas repetitivas. Além disso, os atrasos nas respostas durante os períodos de pico também frustram os usuários que buscam respostas rápidas.

Falha ao acessar informações atualizadas

Os LLMs frequentemente são treinados com dados desatualizados e não atualizam sua base de conhecimento regularmente devido aos altos custos de treinamento. Por exemplo, treinar o GPT-3 pode custar até 1,4 milhão de dólares.

Limite de tokens

Os LLMs impõem um limite no número de tokens que podem ser adicionados às consultas. Por exemplo, o ChatGPT-3 tem um limite de 4.096 tokens, enquanto o GPT-4 (8K) tem um limite de tokens de 8.192.

Dados de pré-treinamento imutáveis

Os dados de pré-treinamento dos LLMs podem conter informações desatualizadas ou incorretas. Infelizmente, esses dados não podem ser modificados, corrigidos ou removidos.

Como o Zilliz Cloud Aumenta os Aplicativos LLM

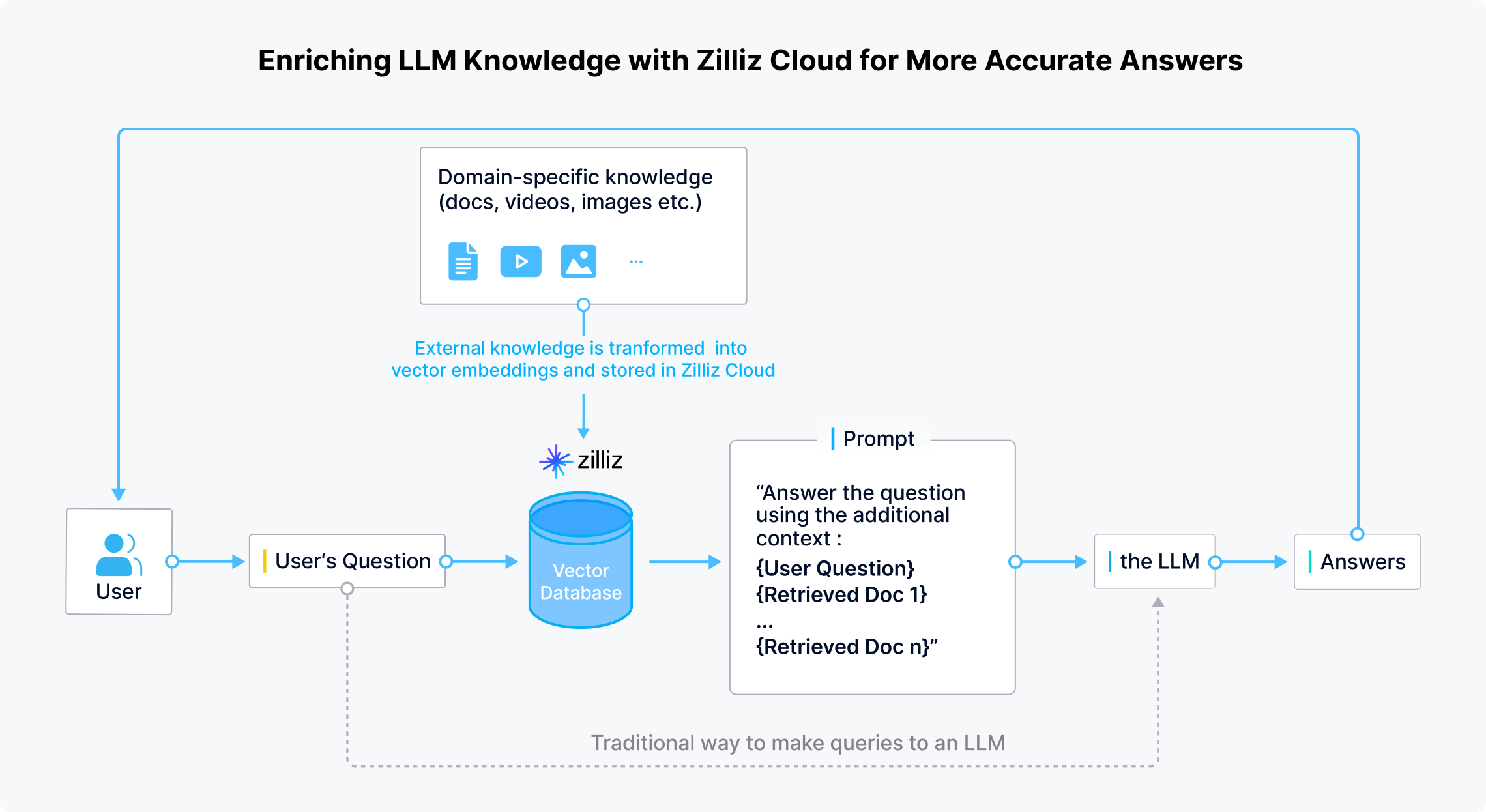

RAG para LLMs: Atualizando e expandindo a base de conhecimento dos LLMs para respostas mais precisas

O Zilliz Cloud permite que desenvolvedores e empresas armazenem com segurança dados privados, atualizados e específicos de domínio fora dos LLMs. Quando um usuário faz uma pergunta, os aplicativos LLM utilizam modelos de embeddings para transformar a pergunta em vetores. O Zilliz Cloud então realiza buscas de similaridade para fornecer os melhores resultados relevantes para essa pergunta. Por fim, esses resultados são combinados com a pergunta original para criar um prompt que fornece um contexto abrangente para o LLM gerar respostas mais precisas.

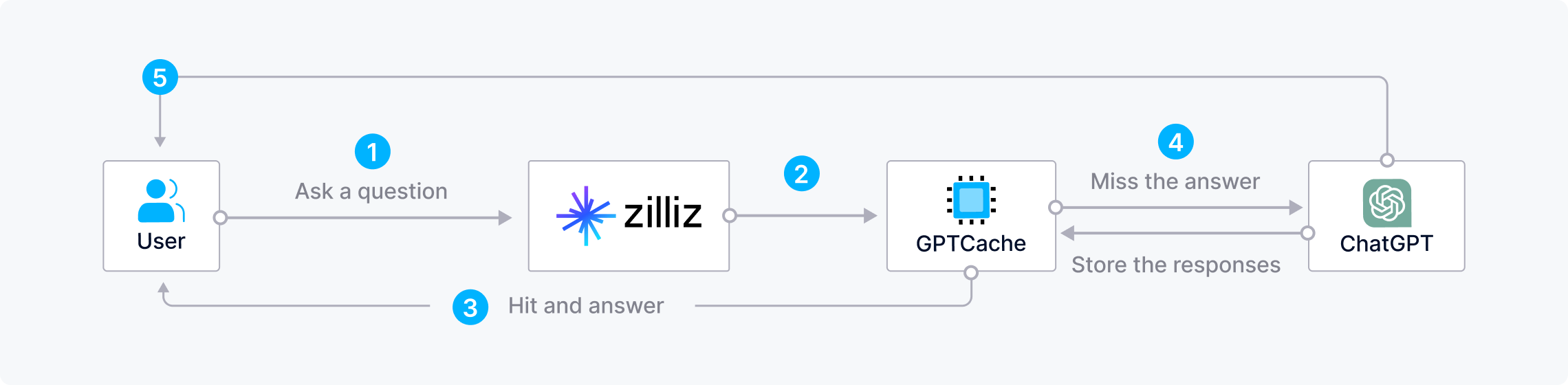

Economizando tempo e custos ao combinar Zilliz Cloud com GPTCache

Fazer perguntas repetitivas ou semelhantes aos LLMs pode ser custoso, desperdiçar recursos e consumir tempo, especialmente durante os períodos de pico quando as respostas são lentas. Para economizar tempo e dinheiro ao construir aplicativos de IA, os desenvolvedores podem utilizar Zilliz Cloud com GPTCache, um cache semântico de código aberto que armazena as respostas do LLM. Com essa arquitetura, o Zilliz primeiro verifica o GPTCache em busca de respostas quando um usuário faz uma pergunta. Se encontrar uma resposta, o Zilliz Cloud retorna rapidamente a resposta ao usuário. Caso contrário, o Zilliz Cloud envia a consulta para o LLM em busca de uma resposta e a armazena no GPTCache para uso futuro.

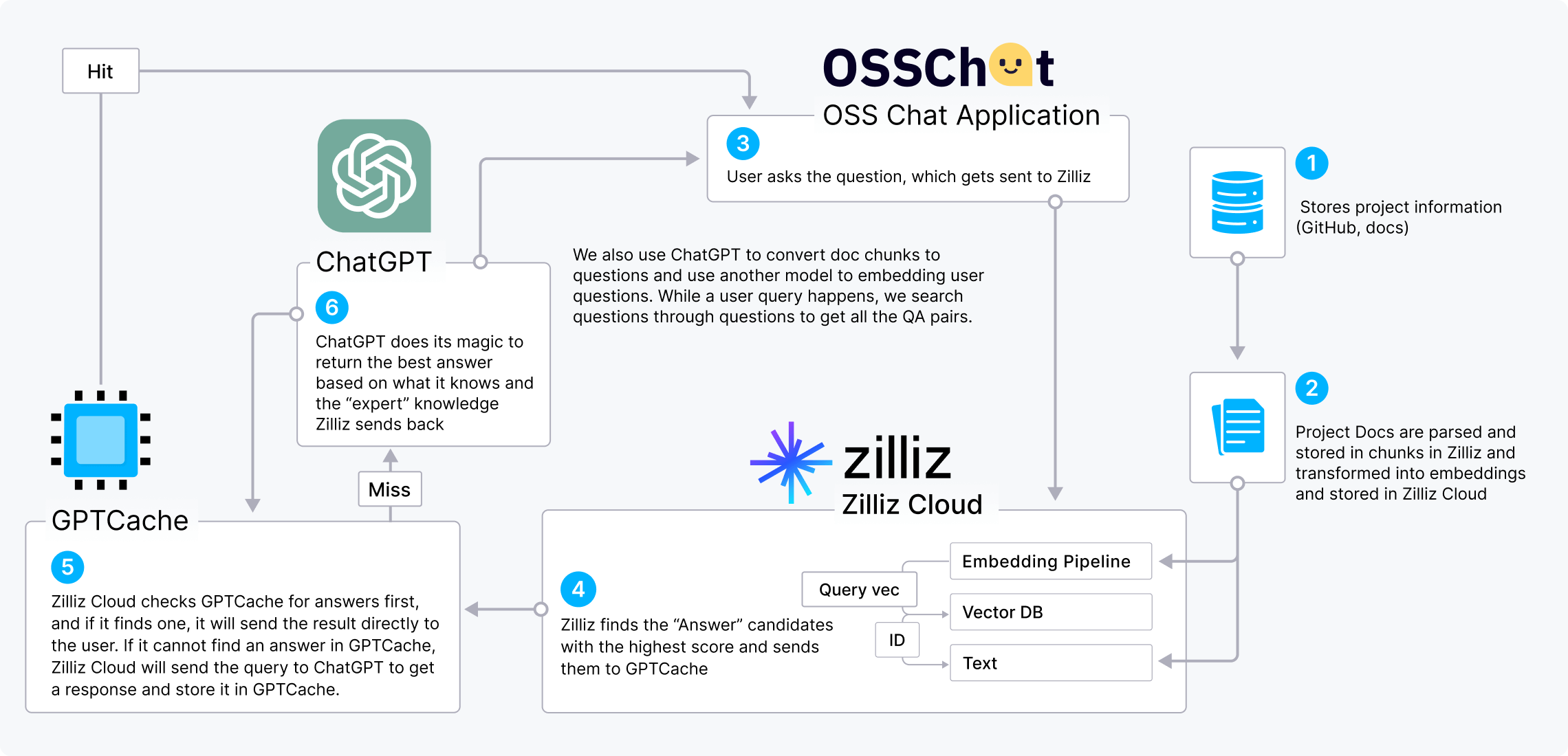

A Pilha CVP

ChatGPT/LLMs + um banco de dados vetorial + prompt-as-code

A pilha CVP (ChatGPT/LLMs + um banco de dados vetorial + prompt-as-code) é uma pilha de IA cada vez mais popular que mostra o valor dos bancos de dados vetoriais para a melhoria dos LLMs. Podemos usar OSS Chat como exemplo para demonstrar como a pilha CVP funciona.

OSS Chat é um chatbot que pode responder a perguntas sobre projetos do GitHub. Ele coleta e armazena informações de vários repositórios GitHub e suas páginas de documentação no Zilliz Cloud sob a forma de embeddings. Quando um usuário pergunta ao OSS Chat sobre qualquer projeto de código aberto, o Zilliz Cloud realiza uma busca de similaridade para encontrar os resultados mais relevantes. Então, esses resultados são combinados com a pergunta original para criar um prompt que dá ao ChatGPT um contexto mais amplo, resultando em respostas mais precisas.

Também podemos incorporar o GPTCache na pilha CVP para reduzir custos e acelerar as respostas.

Projetos LLM Utilizando Milvus & Zilliz Cloud

Saiba como os desenvolvedores utilizam Milvus & Zilliz Cloud para potencializar seus aplicativos de IA generativa.

- OSS Chat

- PaperGPT

- NoticeAI

- Search.anything.io

- IkuStudies

- AssistLink AI

Integrações do Milvus com Projetos Populares de IA

OpenAI, LangChain, LlamaIndex e muitos outros pioneiros da IA estão integrando com o Zilliz Cloud para amplificar suas capacidades de recuperação.