SuperGLUE : un banc d'essai complet pour l'évaluation avancée du NLP

SuperGLUE : un banc d'essai complet pour l'évaluation avancée du NLP

TL ; DR

SuperGLUE (Super General Language Understanding Evaluation) est un benchmark conçu pour évaluer les performances des modèles de compréhension du langage naturel (NLU). S'appuyant sur son prédécesseur, GLUE, il introduit des tâches plus difficiles pour évaluer la capacité d'un modèle à gérer des raisonnements linguistiques complexes, tels que la réponse à des questions, la résolution de coréférences et l'inférence. SuperGLUE comprend un ensemble varié de données et de mesures, et teste des compétences telles que la compréhension contextuelle, la recherche de connaissances et l'apprentissage multitâche. Développé pour repousser les limites du NLU, il reflète des tâches plus proches du raisonnement humain. L'obtention d'un score élevé à SuperGLUE indique la robustesse et l'efficacité d'un modèle pour relever les défis linguistiques du monde réel.

Introduction

Le traitement du langage naturel (NLP) a transformé la manière dont les machines interagissent avec les humains, des chatbots aux systèmes de recommandation. Des modèles tels que ELMo, BERT et GPT ont redéfini le seuil de compréhension du langage, améliorant la modélisation et la compréhension du langage humain. Ces transformations ont ouvert la voie au benchmark GLUE , un moyen d'évaluation systématique qui évalue la compétence des modèles de langage pour diverses tâches.

Cependant, au fur et à mesure que les modèles NLP deviennent plus intelligents, il devient évident que nous sommes confrontés à un défi plus difficile à relever. C'est là que ****[SuperGLUE] (https://super.gluebenchmark.com/) entre en jeu - avec des objectifs plus importants et plus exigeants, il propose une nouvelle gamme de tâches basées sur le raisonnement, la compréhension du sens commun et l'interprétation nuancée du contexte. SuperGLUE teste la capacité de n'importe quel modèle à résoudre des problèmes linguistiques difficiles et réels, ce qui met les modèles de NLP à rude épreuve.

Dans cet article, nous allons explorer les caractéristiques uniques de SuperGLUE, les tâches qu'il inclut et la façon dont il stimule le développement de modèles de TAL encore plus sophistiqués et fiables.

Qu'est-ce que SuperGLUE ?

[SuperGLUE] (https://arxiv.org/abs/1905.00537), abréviation de Super General Language Understanding Evaluation, est un test de référence créé pour évaluer la manière dont les modèles de TAL gèrent un large éventail de tâches complexes de compréhension du langage. Il s'agit essentiellement d'une version améliorée de [GLUE] (https://arxiv.org/abs/1804.07461), conçue pour placer la barre plus haut. Alors que GLUE se concentre sur des tâches plus simples, SuperGLUE comprend des défis plus sophistiqués qui exigent un raisonnement plus approfondi, des connaissances de bon sens et une compréhension du contexte. Par exemple, alors qu'une tâche de GLUE peut évaluer si deux phrases sont sémantiquement similaires, une tâche de SuperGLUE comme le Winograd Schema Challenge (WSC) exige de résoudre des pronoms ambigus en utilisant un raisonnement de bon sens.

SuperGLUE conserve deux des tâches les plus difficiles de GLUE (RTE et WNLI) et introduit six tâches entièrement nouvelles conçues pour pousser les modèles au-delà de la simple correspondance de modèles et aller vers des connaissances sémantiques et pragmatiques.

Quels sont les objectifs de SuperGLUE ?

Tester le raisonnement avancé:** SuperGLUE va au-delà du traitement du langage de base - il est conçu pour voir si les modèles peuvent raisonner, faire des inférences et utiliser des connaissances de bon sens dans des scénarios complexes.

En introduisant des tâches plus difficiles, SuperGLUE motive les chercheurs à développer des techniques d'apprentissage automatique plus avancées et plus performantes.

Contrairement à GLUE, qui se concentre sur des défis plus simples, SuperGLUE offre un moyen plus réaliste et plus complet de tester les performances des modèles avec des données complexes et réelles.

SuperGLUE a été conçu en pensant à l'avenir - il est suffisamment stimulant pour que même les meilleurs modèles actuels aient une grande marge de progression, ce qui en fait un outil précieux pour suivre les progrès de la PNL.

Comment fonctionne SuperGLUE

SuperGLUE évalue les modèles de PNL en mettant à l'épreuve leurs compétences linguistiques. Ces tâches exigent des modèles qu'ils ne se contentent pas de classer des phrases ou de prédire des mots individuels, mais qu'ils s'attaquent aux complexités du monde réel. Cela inclut la résolution de coréférences (déterminer quels mots ou phrases font référence à la même chose), le raisonnement (tirer des conclusions logiques à partir du texte) et la compréhension des relations entre les entités dans le contexte. Chaque tâche permet de mesurer la capacité des modèles à répondre aux exigences nuancées et sophistiquées du langage humain.

Aperçu détaillé des tâches

SuperGLUE est un sur-ensemble de plusieurs tâches, que nous allons couvrir dans cette section. Avant cela, nous verrons les différentes mesures d'évaluation nécessaires pour évaluer les performances du modèle.

Mesures d'évaluation

SuperGLUE utilise plusieurs mesures d'évaluation en fonction de la tâche :

Exact Match (EM): Utilisé pour les tâches visant à évaluer si la réponse prédite correspond exactement à la réponse attendue.

Score F1:** Mesure la précision et le rappel lorsque plusieurs réponses correctes sont possibles.

Précision : proportion d'exemples correctement prédits, utilisée dans des tâches de classification plus simples telles que BoolQ.

F1 macro-moyenné:** Moyenne des scores F1 des différentes classes, garantissant une évaluation équilibrée même en cas de déséquilibre entre les classes.

Figure- SuperGLUE Benchmark- Tableau récapitulatif des tâches de SuperGLUE, incluant la taille des corpus, les métriques, et les sources de texte pour chaque tâche..png](https://assets.zilliz.com/Figure_Super_GLUE_Benchmark_Summary_table_of_Super_GLUE_tasks_including_corpus_sizes_metrics_and_text_sources_for_each_task_3ba1fdfde9.png)

Figure : SuperGLUE Benchmark : Tableau récapitulatif des tâches de SuperGLUE, incluant la taille des corpus, les métriques et les sources de texte pour chaque tâche.

Explorons l'aperçu détaillé des tâches de SuperGLUE pour comprendre la profondeur et la variété de ses défis.

- BoolQ (Questions Booléennes)

[BoolQ ] (https://paperswithcode.com/dataset/boolq) est une tâche de réponse à une question binaire dans laquelle le modèle détermine si une question oui/non est vraie sur la base d'un passage donné. Voici l'entrée, la sortie et la métrique de la tâche :

| Entrée | Sortie | Métrique |

|---|---|---|

| Un passage et une question oui/non sur le passage. | Une valeur booléenne (Vrai pour oui, Faux pour non). | Précision |

Voici un exemple :

Passage : "Barq's est une boisson gazeuse qui contient de la caféine et qui est mise en bouteille par Coca-Cola.

Question : "La racinette Barq's contient-elle de la caféine ?"

Sortie : True

- CB (CommitmentBank) : CB (CommitmentBank) : **CB (CommitmentBank)

CB consiste à évaluer si une clause intégrée dans un texte est vraisemblablement vraie (implication), fausse (contradiction) ou indéterminée (neutre).

| Il s'agit d'une méthode qui permet d'évaluer si une clause intégrée dans un texte est vraisemblablement vraie (implication), fausse (contradiction) ou indéterminée (neutre). | --------------------------- | ------------------------------------------------ | ------------------------------- | | Une prémisse et une hypothèse. | Une étiquette (implication, neutre ou contradiction). | Une précision et une macro-moyenne de F1. |

Voici un exemple :

Premise : "Elle a dit qu'elle pourrait assister à la réunion".

Hypothèse : "Elle est certaine d'assister à la réunion".

Sortie : Contradiction

- COPA (Choix d'alternatives plausibles)

[COPA] (https://paperswithcode.com/dataset/copa) est une tâche de raisonnement causal dans laquelle le modèle détermine la cause ou l'effet le plus plausible d'une prémisse donnée parmi deux alternatives.

| Il s'agit d'une tâche de raisonnement causal dans laquelle le modèle détermine la cause ou l'effet le plus plausible d'une prémisse donnée à partir de deux alternatives. | ---------------------------------------------- | ---------------------------------------- | ---------- | | Une prémisse et deux alternatives (cause/effet). | L'alternative la plus plausible (1 ou 2). | Précision |

Prenons un exemple :

Sur place : "L'herbe est mouillée".

Alternative 1 : "Il a plu la nuit dernière".

Alternative 2 : "Le soleil brillait".

Sortie : 1

- MultiRC (Compréhension écrite de phrases multiples)

Le [MultiRC] (https://paperswithcode.com/dataset/multirc) consiste à répondre à des questions basées sur un passage, chaque question pouvant avoir plusieurs réponses correctes.

| Les questions peuvent être posées à l'aide de plusieurs réponses correctes. | ----------------------------------------------------- | ----------------------------------------------- | ------------------- | | Un passage, une question et un ensemble de réponses possibles. | Une étiquette binaire (Vrai ou Faux) pour chaque réponse. | Les réponses F1 et Exact Match. |

Voici un exemple simple :

Passage : "Susan a invité ses amis à une fête. L'une d'entre elles était malade, mais elle est venue par la suite."

Question : "L'ami malade a-t-il participé à la fête ?"

Réponses : "Oui", "Non"

Sortie : Oui

- ReCoRD (Reading Comprehension with Commonsense Reasoning Dataset)

[ReCoRD] (https://paperswithcode.com/dataset/record) est une tâche de compréhension de la lecture de type Cloze qui exige un raisonnement de bon sens pour prédire les entités masquées dans un passage.

| L'ensemble de données ReCoRD est une tâche de compréhension de la lecture de type Cloze qui requiert un raisonnement de bon sens pour prédire les entités masquées dans un passage. | ------------------------------------------- | --------------------------------------------- | ---------- | | Un passage avec des entités masquées et une requête. | L'entité correcte à partir d'une liste de candidats. | F1 et EM. |

Voici un exemple simple :

Passage : "Tesla a été fondé par

Requête : "Qui a fondé Tesla ?"

Candidats : "Elon Musk", "Nikola Tesla", "Thomas Edison"

Sortie : Elon Musk

- RTE (Reconnaissance de l'Entaillement Textuel)

[RTE] (https://paperswithcode.com/dataset/rte) détermine si une hypothèse est vraie, fausse ou indéterminée sur la base d'une prémisse donnée.

| Il s'agit d'une méthode qui permet de déterminer si une hypothèse est vraie, fausse ou indéterminée sur la base d'une prémisse donnée. | --------------------------- | ------------------------------------------------ | ---------- | | Une prémisse et une hypothèse. | Une étiquette (implication, neutre ou contradiction). | Précision |

Voici un exemple :

Premise : "Dana Reeve, la veuve de Christopher Reeve, est décédée à l'âge de 44 ans".

Hypothèse : "Dana Reeve avait 44 ans lorsqu'elle est décédée".

Sortie : Détaillé

- WiC (mot en contexte)

WiC teste la désambiguïsation du sens des mots en déterminant si un mot est utilisé avec la même signification dans deux contextes différents.

| Le test de désambiguïsation du sens des mots se fait en déterminant si un mot est utilisé avec le même sens dans deux contextes différents. | ---------------------------------------------- | ---------------------------------------------------------------- | ---------- | | Deux phrases contenant le même mot cible. | Une étiquette binaire (Vrai pour le même sens, Faux pour un sens différent). | Précision

Prenons un exemple :

Présentation 1 : "Il a cloué les planches au mur.

phrase 2 : "L'échiquier était magnifiquement travaillé."

Mot cible : "échiquier"

Sortie : Faux

- WSC (Winograd Schema Challenge)

Le [WSC] (https://paperswithcode.com/dataset/wsc) est une tâche de résolution de coréférence dans laquelle le modèle identifie le référent correct d'un pronom ambigu à l'aide d'un raisonnement de bon sens.

| Il s'agit d'une tâche de résolution de coréférence dans laquelle le modèle identifie le référent correct d'un pronom ambigu en utilisant un raisonnement fondé sur le bon sens. | ------------------------------------------- | --------------------- | ---------- | | Une phrase contenant un pronom ambigu. | Le référent correct. | Précision |

Voici un exemple :

La phrase : "Mark a offert un livre à Ted, mais il ne l'a pas aimé.

Prononyme : "il"

Sortie: Ted

Les tâches ci-dessus de SuperGLUE défient les modèles de TAL au-delà de la simple compréhension du langage, pour laquelle tout système est supposé construire un raisonnement nuancé et résoudre des problèmes du monde réel. Ainsi, SuperGLUE évalue le modèle sur la base de la compréhension, du raisonnement et de l'application efficace de connaissances de bon sens. Il fournit un cadre d'évaluation complet qui capture à la fois la précision et le rappel des modèles à travers divers défis de compréhension du langage.

Exemple de mise en œuvre

Voici un exemple de chargement et d'interaction avec la tâche ReCoRD de SuperGLUE à l'aide de la bibliothèque [Hugging Face] (https://huggingface.co/datasets/aps/super_glue) :

from datasets import load_dataset

# Chargement de la tâche ReCoRD depuis SuperGLUE

dataset = load_dataset("super_glue", "record", trust_remote_code = True

)

# Accéder aux données d'entraînement

train_data = dataset['train']

# Exemple de point de données

exemple = train_data[0]

print(f "Passage : {exemple['passage']}")

print(f "Requête avec entité masquée : {exemple['query']}")

La fonction "load_dataset" charge la tâche ReCoRD. L'entrée comprend un passage et une requête avec une entité masquée qui doit être résolue. Le modèle vise à prédire correctement l'entité masquée, en démontrant sa capacité à comprendre le passage et à appliquer un raisonnement de bon sens.

Figure- Output of Implemented Example.png

Figure- Output of Implemented Example.png

Figure : Sortie de l'exemple implémenté

SuperGLUE vs. GLUE : Principales différences

SuperGLUE améliore GLUE en introduisant des tâches beaucoup plus difficiles qui reflètent la compréhension de la langue dans le monde réel.

| Caractéristiques | GLUE | SuperGLUE | SuperGLUE** | SuperGLUE** | SuperGLUE** | SuperGLUE** | SuperGLUE** | SuperGLUE | :------------------------ : | :-------------------------------------------------: | :------------------------------------------------------: | Les tâches linguistiques de base (par exemple, l'analyse des sentiments) et les tâches complexes nécessitant un raisonnement et un bon sens (par exemple, l'analyse de l'opinion publique) sont des exemples de tâches complexes. | Saturation de l'ensemble de données** - Performances proches du niveau humain - Grande marge de manœuvre pour l'amélioration des modèles. | Les tâches complexes requièrent un raisonnement et un bon sens. | Diversité des tâches ** Principalement des tâches de classification et de similarité de phrases ** Comprend l'assurance qualité, la coréférence et la compréhension de la lecture ** Diversité des tâches ** Principalement des tâches de classification et de similarité de phrases | Application dans le monde réel** - Réflexion limitée dans le monde réel - Tâches conçues pour émuler les défis linguistiques du monde réel.

Avantages et défis de SuperGLUE

SuperGLUE remplace la façon dont les modèles de NLP ont été évalués en mettant l'accent sur leur capacité à résoudre des tâches du monde réel de façon nuancée qui exigent un raisonnement et un contexte avancé. Discutons des avantages concrets que SuperGLUE confère à la PNL et des défis auxquels les chercheurs sont confrontés pour l'utiliser au maximum de son potentiel.

Avantages

SuperGLUE inclut des tâches qui demandent aux modèles d'utiliser des connaissances de bon sens. Par exemple, le Winograd Schema Challenge (WSC) teste la résolution des pronoms en utilisant le bon sens, tandis que la tâche COPA évalue le raisonnement causal en choisissant la cause ou l'effet le plus plausible dans un scénario donné. Ces tâches les rendent plus aptes à affronter des scénarios du monde réel.

En incluant des tâches plus complexes, SuperGLUE surmonte la saturation de GLUE, où les modèles atteignaient des performances proches de celles des humains sur des tâches plus simples, ce qui le rendait moins efficace pour distinguer les progrès.

Les tâches complexes de SuperGLUE encouragent le développement de modèles performants et fournissent des résultats plus faciles à interpréter, ce qui aide les chercheurs à comprendre comment et pourquoi les modèles font des prédictions spécifiques.

Les tâches de SuperGLUE sont conçues pour refléter les problèmes rencontrés par les modèles dans des applications telles que la compréhension de la lecture et les systèmes de dialogue. Par exemple, la tâche ReCoRD teste le raisonnement de bon sens pour déduire les informations manquantes, tandis que WSC évalue la résolution des pronoms ambigus - des capacités clés pour les assistants virtuels et l'IA conversationnelle.

SuperGLUE permet aux chercheurs d'examiner comment et où les modèles échouent en fournissant des tâches variées et difficiles qui mettent en évidence des faiblesses spécifiques. Cette analyse détaillée des erreurs permet d'identifier les domaines dans lesquels les modèles rencontrent des difficultés, comme le raisonnement, la compréhension du sens commun ou la compréhension du contexte, ce qui permet d'apporter des améliorations ciblées pour rendre les modèles plus robustes et plus fiables.

Défis

Coûts de calcul élevés:** L'entraînement des modèles sur SuperGLUE peut être coûteux en raison de la complexité des tâches. L'utilisation d'architectures optimisées et d'infrastructures en nuage peut aider à gérer efficacement les demandes de ressources.

Chaque tâche de SuperGLUE peut nécessiter différentes stratégies de réglage fin. Les approches d'apprentissage multi-tâches et l'apprentissage par transfert peuvent aider à rationaliser ce processus. L'apprentissage multitâche entraîne un modèle sur des tâches connexes pour améliorer la généralisation, tandis que l'apprentissage par transfert applique les connaissances d'une tâche pour améliorer les performances d'une autre, minimisant ainsi le besoin de données et d'entraînement étendus.

Certaines tâches de SuperGLUE sont accompagnées de données limitées, ce qui augmente le risque de surajustement des modèles pendant l'entraînement. Ce défi peut être relevé en employant des techniques telles que l'augmentation des données pour créer des échantillons d'entraînement plus diversifiés et la régularisation pour améliorer la généralisation du modèle.

L'importance excessive accordée aux tableaux de classement:** Bien que les classements des tableaux de classement mettent en évidence les performances des modèles, le fait de se concentrer uniquement sur ces scores peut nuire à la valeur pratique des modèles. L'attention portée aux applications du monde réel permet de s'assurer que les modèles sont compétitifs et qu'ils ont un impact dans des scénarios pratiques.

Difficulté de comparer les résultats:** La variabilité des implémentations, du matériel et des hyperparamètres peut rendre difficile la comparaison équitable des résultats entre les groupes de recherche. En normalisant les protocoles d'évaluation, en partageant les bases de code et en utilisant des repères communs, nous pouvons obtenir des comparaisons plus cohérentes et plus justes.

Cas d'utilisation de SuperGLUE

SuperGLUE est un benchmark important qui permet d'améliorer le NLP en confrontant les modèles à des tâches basées sur la complexité du monde réel. Les exemples d'utilisation peuvent aller de l'amélioration de l'IA conversationnelle et des systèmes de raisonnement à la recherche sémantique.

SuperGLUE a de nombreuses applications dans le domaine du NLP et au-delà :

Intelligence conversationnelle: SuperGLUE améliore le développement des assistants virtuels en fournissant des repères qui testent la capacité des modèles à comprendre des requêtes nuancées avec un meilleur raisonnement et du bon sens.

Systèmes de raisonnement avancés:** SuperGLUE permet la création d'outils d'aide à la décision en évaluant et en améliorant les capacités d'inférence logique des modèles.

Compréhension de la lecture:** SuperGLUE permet aux modèles NLP d'analyser et de résumer des documents longs avec précision en les confrontant à des tâches qui requièrent une compréhension avancée et contextuelle, afin d'aider la recherche et l'éducation.

Représentation et inférence des connaissances:** SuperGLUE aide à construire des graphes de connaissances plus robustes en testant la capacité des modèles à comprendre les relations et à appliquer un raisonnement de bon sens, afin d'aider les moteurs de recherche et les systèmes de recommandation.

Recherche sémantique et bases de données vectorielles:** SuperGLUE améliore la précision de la recherche sémantique en permettant aux modèles de traiter efficacement des tâches complexes de recherche d'information à grande échelle.

Outils supportant SuperGLUE

Les tâches avancées et les critères de SuperGLUE ont conduit au développement d'autres outils et plateformes conçus pour faciliter sa mise en œuvre et son évaluation. Ces outils aident les chercheurs et les développeurs à prendre de meilleures décisions concernant l'accès aux données, la formation des modèles et l'analyse des résultats.

Examinons les outils qui soutiennent et améliorent l'adoption et l'interaction avec SuperGLUE.

Outils

Hugging Face Datasets: Fournit un moyen facile de charger et d'interagir avec les tâches de SuperGLUE, rationalisant ainsi le développement et le test des modèles.

TensorFlow Datasets: Offre des versions préformatées des tâches SuperGLUE, s'intégrant bien aux modèles basés sur [TensorFlow] (https://www.tensorflow.org/datasets/catalog/super_glue).

AllenNLP:** Fournit des modules et des composants pour les tâches NLP, ce qui simplifie l'expérimentation avec SuperGLUE.

Évaluer les modèles d'IA avec SuperGLUE et les améliorer avec RAG

Les tests comme SuperGLUE sont essentiels pour évaluer les capacités des grands modèles de langage (LLMs). Ils fournissent un cadre standardisé pour mesurer la performance d'un modèle dans diverses tâches et facilitent les comparaisons directes entre les modèles. En mettant en évidence les points forts, comme le raisonnement, et en exposant les faiblesses, comme les difficultés liées au raisonnement complexe ou aux tâches spécifiques à un domaine, SuperGLUE aide les chercheurs à identifier les domaines à améliorer. Ces informations permettent d'affiner le modèle et d'améliorer ses capacités de compréhension et de génération de contenu.

Cependant, si SuperGLUE est utile pour améliorer les LLM, il ne s'agit pas d'une panacée. Les LLM ont des limites inhérentes, quelles que soient leurs performances sur les bancs d'essai. Ils sont formés sur des ensembles de données statiques et hors ligne et n'ont pas accès à des informations en temps réel ou spécifiques à un domaine. Cela peut conduire à des [hallucinations] (https://zilliz.com/glossary/ai-hallucination), où les modèles génèrent des réponses inexactes ou fabriquées. Ces lacunes deviennent encore plus problématiques lorsqu'il s'agit de répondre à des requêtes propriétaires ou hautement spécialisées.

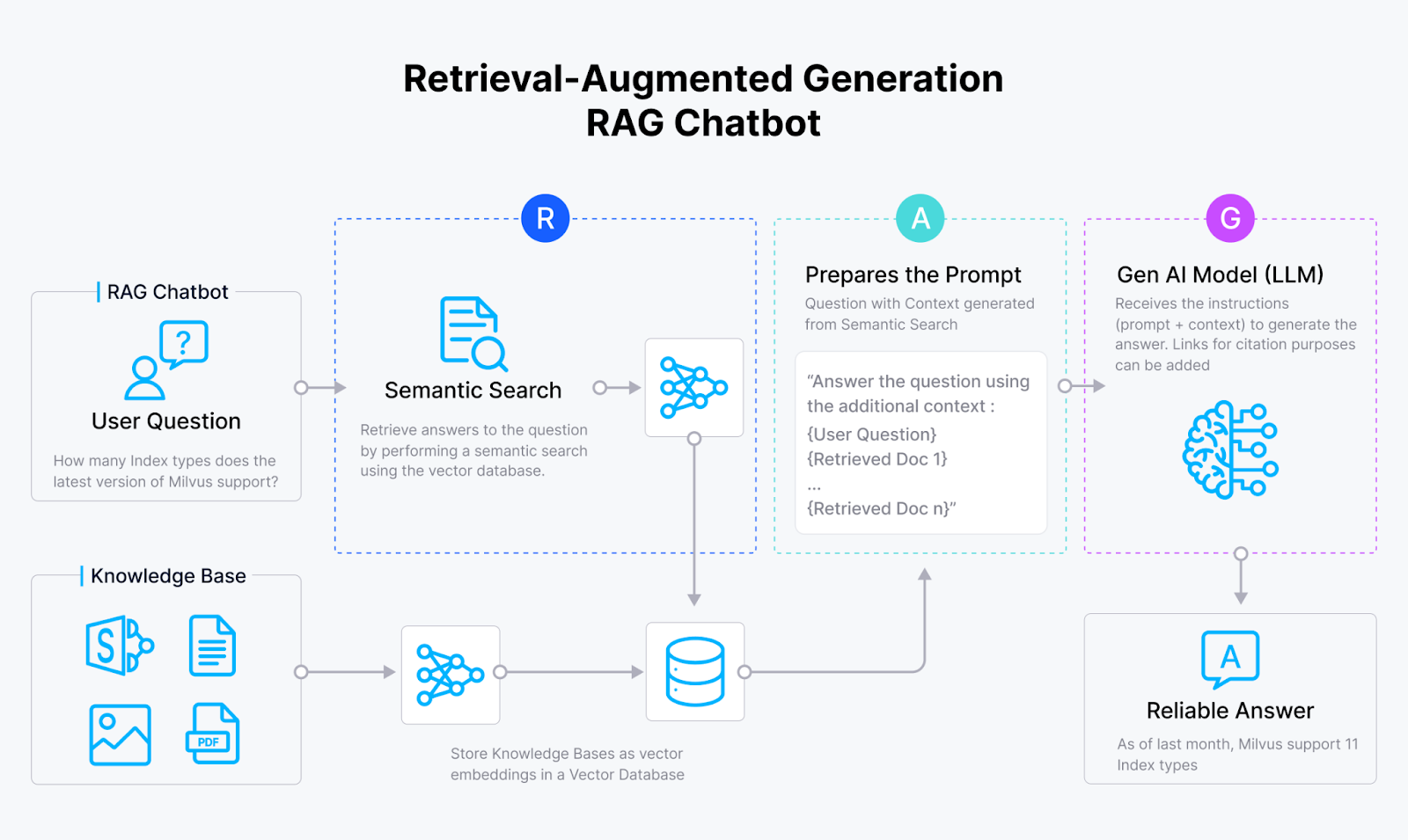

Introduction de RAG : une solution pour améliorer les réponses LLM

Pour relever ces défis, [Retrieval-Augmented Generation (RAG)] (https://zilliz.com/learn/Retrieval-Augmented-Generation) offre une solution puissante. RAG améliore les grands modèles de langage (LLM) en combinant leurs capacités de génération avec la capacité de récupérer des informations spécifiques au domaine à partir de bases de connaissances externes stockées dans une base de données vectorielle comme Milvus ou Zilliz Cloud. Lorsqu'un utilisateur pose une question, le système RAG recherche les informations pertinentes dans la base de données et les utilise pour générer une réponse plus précise. Voyons comment fonctionne le processus RAG.

Figure- RAG workflow.png

Figure- RAG workflow.png

Un système RAG se compose généralement de trois éléments clés : un [modèle d'intégration] (https://zilliz.com/blog/choosing-the-right-embedding-model-for-your-data), une [base de données vectorielle] (https://zilliz.com/learn/what-is-vector-database) et un LLM.

Le modèle d'intégration convertit les documents en vector embeddings, qui sont stockés dans une base de données vectorielle telle que Milvus.

Lorsqu'un utilisateur pose une question, le système transforme la requête en un vecteur en utilisant le même modèle d'intégration.

La base de données vectorielle effectue ensuite une [recherche de similarité] (https://zilliz.com/learn/vector-similarity-search) pour récupérer les informations les plus pertinentes. Ces informations sont combinées à la question originale pour former une "question avec contexte", qui est ensuite envoyée au LLM.

Le LLM traite cette entrée enrichie pour générer une réponse plus précise et contextuelle.

Cette approche comble le fossé entre les LLM statiques et les besoins en temps réel spécifiques à un domaine.

FAQ de SuperGLUE

**Qu'est-ce qui rend SuperGLUE plus difficile que la GLUE ? SuperGLUE s'appuie sur la GLUE en introduisant des tâches de raisonnement et de bon sens qui vont bien au-delà des tâches que l'on trouve dans la GLUE.

**Quels sont les modèles les plus performants sur SuperGLUE ? Les modèles basés sur les transformateurs excellent sur SuperGLUE grâce à leur mécanisme d'auto-attention, qui capture le contexte et les dépendances à long terme, le pré-entraînement extensif sur de grands ensembles de données, l'extensibilité et l'adaptabilité grâce à l'apprentissage par transfert.

**L'entraînement des modèles sur SuperGLUE nécessite des ressources informatiques importantes en raison de la complexité des tâches, qui exigent une grande puissance de traitement pour la mise au point, le raisonnement et le traitement efficace de grands ensembles de données.

**SuperGLUE peut-il être appliqué à des tâches spécifiques à un domaine ? Bien qu'il se concentre sur la généralisation, la personnalisation pour des domaines spécifiques est possible avec un réglage fin supplémentaire avec des données spécifiques à un domaine.

**En quoi SuperGLUE est-il pertinent pour les applications modernes de l'IA ? ** Il établit une norme pour l'évaluation des modèles dans des applications réelles telles que la recherche sémantique et l'IA conversationnelle.

Ressources connexes

Guide d'initiation au traitement du langage naturel](https://zilliz.com/learn/A-Beginner-Guide-to-Natural-Language-Processing)

Benchmark SuperGLUE](https://super.gluebenchmark.com/)

20 jeux de données ouverts utiles pour le traitement du langage naturel

Qu'est-ce que le RAG ? ](https://zilliz.com/learn/Retrieval-Augmented-Generation)

Qu'est-ce qu'une base de données vectorielle et comment fonctionne-t-elle ?

- TL ; DR

- Introduction

- Qu'est-ce que SuperGLUE ?

- Comment fonctionne SuperGLUE

- SuperGLUE vs. GLUE : Principales différences

- Avantages et défis de SuperGLUE

- Cas d'utilisation de SuperGLUE

- Outils supportant SuperGLUE

- Évaluer les modèles d'IA avec SuperGLUE et les améliorer avec RAG

- FAQ de SuperGLUE

- Ressources connexes

Contenu

Commencez gratuitement, évoluez facilement

Essayez la base de données vectorielle entièrement managée conçue pour vos applications GenAI.

Essayer Zilliz Cloud gratuitement