LlamaIndex

LlamaIndex Integration | Build Retrieval-Augmented Generation applications with Zilliz Cloud and Milvus Vector Database

Diese Integration kostenlos nutzenLlamaIndex-Integration, Erstellen von Retrieval-Augmented Generation-Anwendungen mit Zilliz Cloud

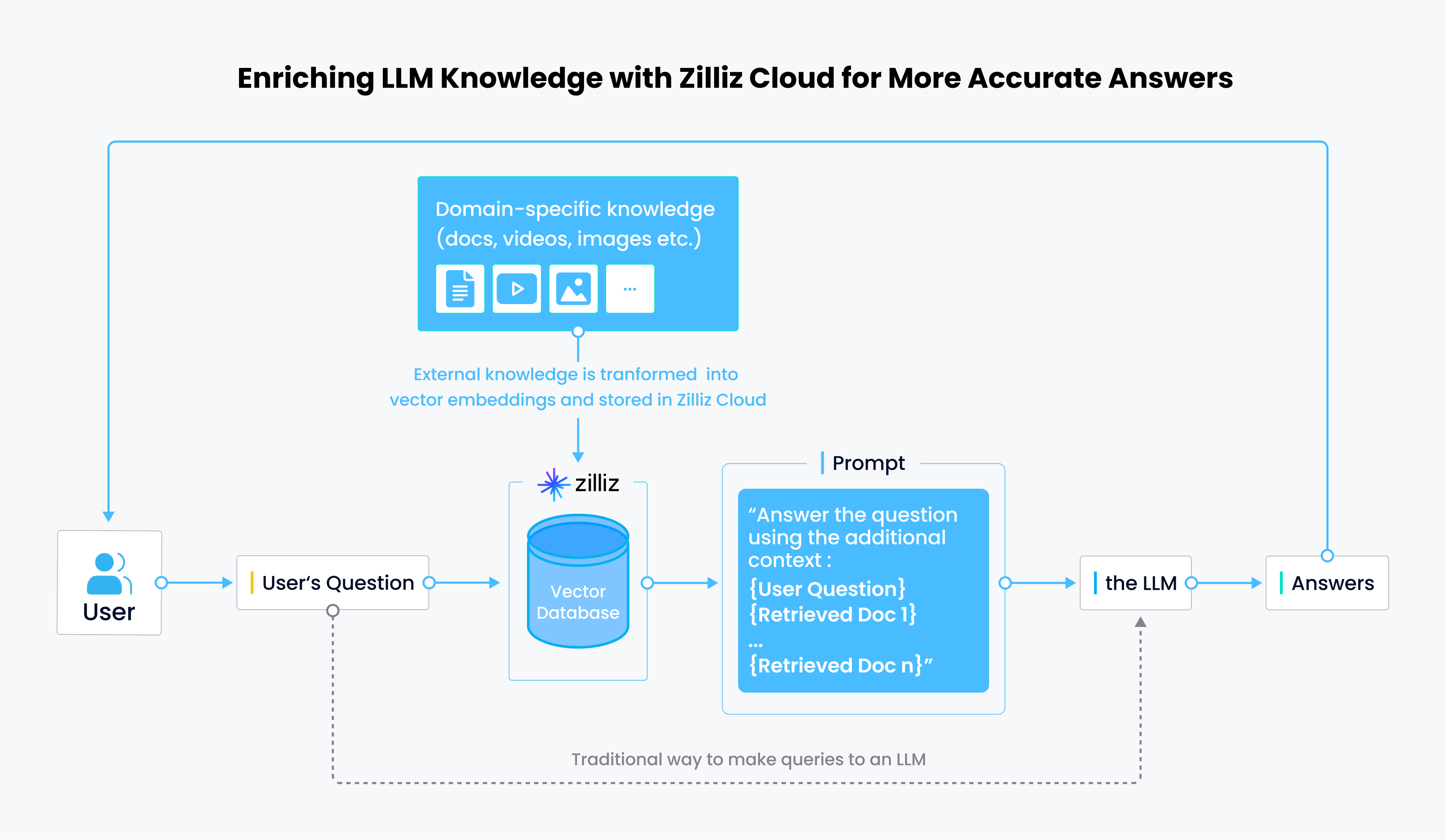

LlamaIndex (ehemals GPT Index) ist ein Daten-Framework, das auf Large Language Models (LLM)-Anwendungen zugeschnitten ist und die Aufnahme, Strukturierung und den Zugriff auf private oder domänenspezifische Daten erleichtert. LLMs fungieren im Kern als Brücke zwischen menschlicher Sprache und abgeleiteten Daten, sowohl strukturierten als auch unstrukturierten Daten. Weithin zugängliche LLMs sind zwar auf umfangreichen öffentlich zugänglichen Datensätzen vortrainiert, doch fehlen ihnen oft wichtige Daten, was zu Halluzinationen oder falschen Antworten führt, die von den LLMs generiert werden.

LlamaIndex integriert sich in Vektordatenbanken:

- Interne Indexverwendung: LlamaIndex kann als Index mit einem Vektorspeicher funktionieren. Ähnlich wie traditionelle Indizes kann dieser auf LlamaIndex basierende Index Dokumente speichern und effektiv auf Abfragen reagieren.

- Externe Datenintegration: LlamaIndex kann Daten aus Vektorspeichern abrufen und funktioniert dabei wie ein herkömmlicher Datenkonnektor. Nach dem Abruf können diese Daten nahtlos in die Datenstrukturen von LlamaIndex zur weiteren Verarbeitung und Nutzung integriert werden. Dies wird oft als "Retrieval-Augmented Generated" oder RAG bezeichnet.

Wie die LlamaIndex Integration mit Zilliz Cloud funktioniert

Erfahren Sie mehr darüber, wie Sie Llama verwenden können

- Tutorial | Erste Schritte mit LlamaIndex

- Docs | Dokumentation QA mit Zilliz Cloud und LlamaIndex

- Videokurzfilme mit Yujian Tang | Persistente Vektorspeicherung mit LlamaIndex

- Video mit Jerry Liu, CEO LlamaIndex | Boost your LLM with Private Data using LlamaIndex

- Aufbau eines Chatbots mit Zilliz Cloud, LlamaIndex und LangChain Teil I

- Erstellung von LLM-Apps mit 100x schnelleren Antworten und drastischer Kostenreduzierung mit GPTCache