Master Fine Tuning nel Deep Learning: Tecniche e suggerimenti

Master Fine Tuning nel Deep Learning: Tecniche e suggerimenti

Il fine tuning nel deep learning affina i modelli pre-addestrati per compiti specifici, risparmiando tempo e risorse. Ecco cos'è il fine tuning, perché è importante e come farlo.

Riepilogo rapido

Il fine tuning è una tecnica chiave del deep learning che ottimizza i modelli pre-addestrati per compiti specifici, rendendoli più efficienti e precisi grazie alle conoscenze esistenti.

L'estrazione delle caratteristiche e la messa a punto completa sono i due approcci alla messa a punto, ognuno dei quali ha i suoi vantaggi a seconda del compito e delle risorse.

La messa a punto richiede un'attenta preparazione dei dati, la scelta dei giusti modelli pre-addestrati, la messa a punto dei parametri e la validazione iterativa per far funzionare il modello nelle applicazioni del mondo reale.

Sintonia fine: Tecniche e migliori pratiche

Un'illustrazione delle varie tecniche di regolazione fine nel deep learning

Un'illustrazione delle varie tecniche di regolazione fine nel deep learning

Il fine tuning migliora i modelli pre-addestrati per applicazioni specializzate, regolando i loro parametri per compiti specifici. A differenza dell'addestramento di modelli ex novo, questo metodo utilizza le conoscenze esistenti all'interno del modello pre-addestrato, rendendolo più efficiente e spesso più efficace. Il processo di regolazione fine può essere suddiviso in regolazione fine supervisionata e apprendimento di rinforzo dal feedback umano (RLHF). Se eseguiti correttamente, possono davvero migliorare i [modelli linguistici di grandi dimensioni] (https://zilliz.com/glossary/large-language-models-) (LLM).

La scelta del modello preaddestrato giusto è importante: bisogna considerare le dimensioni del modello, i dati di addestramento e le prestazioni su compiti rilevanti. Ad esempio, in campi come la medicina personalizzata, la messa a punto può prevedere i rischi per la salute e personalizzare i piani di trattamento sulla base di dati e cartelle cliniche specifiche.

La comprensione dell'architettura del modello e del modo in cui si adatta ai nuovi compiti è fondamentale per la messa a punto. Questo processo non solo ottimizza i modelli per esigenze specifiche, ma ne migliora anche le prestazioni e l'utilità complessiva.

Introduzione

La messa a punto è una parte fondamentale del deep learning: si prende un modello pre-addestrato e lo si mette a punto per un compito specifico con un set di dati più piccolo. La regolazione di parti del modello per adattarlo a nuovi dati specifici migliora l'accuratezza e l'efficienza.

È utile perché consente di risparmiare tempo rispetto all'addestramento di un modello da zero e spesso produce risultati migliori sfruttando la conoscenza incorporata nel modello pre-addestrato.

Comprendere la regolazione fine

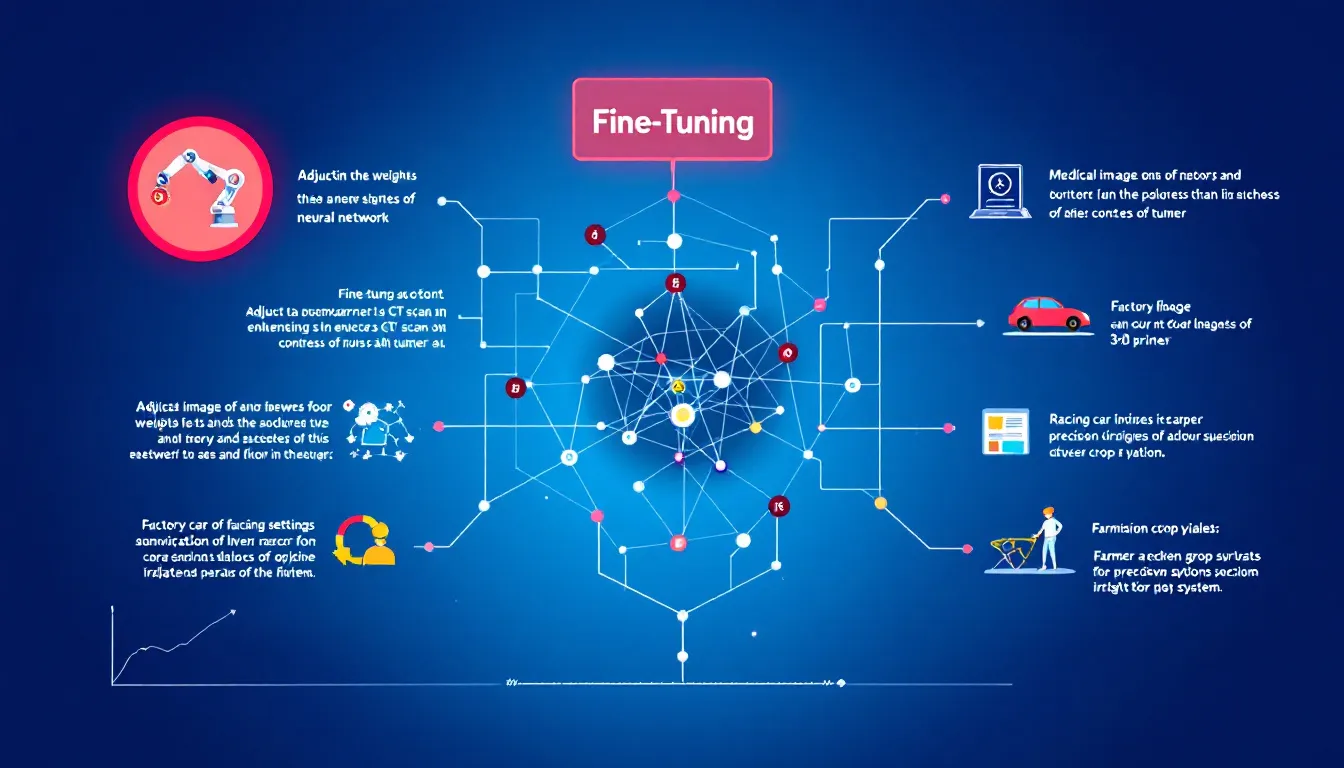

Un diagramma che illustra il processo di regolazione fine nel deep learning

Un diagramma che illustra il processo di regolazione fine nel deep learning

Il fine tuning migliora i modelli pre-addestrati per compiti specifici, aumentandone l'efficacia in applicazioni mirate. Spesso considerato come un perfezionamento dell'apprendimento per trasferimento, utilizza i modelli pre-addestrati per la specializzazione dei compiti. La comprensione delle sfumature del fine tuning, compresi i suoi metodi e i vantaggi principali, è fondamentale per sfruttarne appieno il potenziale.

I metodi di regolazione fine possono essere classificati in due grandi tipologie. Si tratta della regolazione fine supervisionata e dell'apprendimento di rinforzo dal feedback umano (RLHF). La selezione del modello preaddestrato appropriato è essenziale per allinearsi ai requisiti del compito, garantire un'integrazione perfetta e massimizzare l'adattabilità.

È necessario considerare attentamente fattori quali le dimensioni del modello, i dati di addestramento e le prestazioni su compiti rilevanti. Questa sezione esplora la definizione, l'importanza e i meccanismi di funzionamento della regolazione fine.

Definizione e importanza

Il fine tuning è una tecnica di regolazione dei parametri di un modello addestrato per migliorare le prestazioni su un compito specifico. Nel contesto dei modelli linguistici, si tratta di modificare i parametri di un modello pre-addestrato per adattarlo meglio a un particolare dominio o compito. Questo metodo consente ai modelli di mantenere le loro capacità originali adattandosi a casi d'uso specifici, migliorando così le loro prestazioni.

La regolazione fine personalizza i modelli pre-addestrati per concentrarsi su compiti specifici, migliorandone la specializzazione e le prestazioni. Questo metodo è particolarmente vantaggioso con insiemi di dati di grandi dimensioni e specifici per un compito, soprattutto se differiscono in modo significativo dall'insieme dei dati pre-addestrati. Consente un adattamento efficiente utilizzando dati limitati, ottimizzando le intuizioni pre-addestrate per applicazioni specifiche.

La regolazione fine sfrutta le conoscenze esistenti dei modelli pre-addestrati per ottenere risultati migliori su compiti specializzati. Questo approccio è efficiente ed economico, in quanto riduce la necessità di un'ampia riqualificazione. La messa a punto fine aiuta inoltre i modelli a generalizzarsi meglio ai nuovi dati, cosa fondamentale per ottenere risultati affidabili nel mondo reale.

Come funziona la regolazione fine

Il fine tuning spesso inizia congelando gli strati iniziali di un modello pre-addestrato e concentrando le regolazioni sugli strati successivi per specializzare il modello per i nuovi compiti. In questo modo si mantiene la conoscenza generale incorporata nei primi strati, consentendo al contempo l'adattamento ai dati specifici del compito. La riqualificazione utilizza in genere un tasso di apprendimento più basso, mantenendo la maggior parte dei parametri fissi e regolando gli strati finali.

L'obiettivo è quello di adattare i modelli pre-addestrati a domini specifici, regolando alcuni strati in base ai dati specifici del compito. Regolando solo gli strati successivi, il modello sfrutta la sua conoscenza generale esistente e si specializza sul compito da svolgere. Questo processo è fondamentale per ottenere prestazioni elevate in applicazioni specifiche senza un'estesa riqualificazione.

La messa a punto richiede una profonda comprensione dell'architettura del modello e dei requisiti specifici del compito. Il processo è iterativo e prevede più cicli di addestramento e convalida per garantire un buon adattamento ai nuovi dati. Questo metodo migliora le prestazioni e l'efficienza del modello nel gestire compiti specializzati.

Benefici

La messa a punto rende i modelli più efficienti e consente di creare modelli migliori con meno risorse rispetto alla formazione da zero. Di solito converge più velocemente e ha prestazioni migliori. L'uso di modelli pre-addestrati riduce il costo computazionale dell'addestramento.

Il vantaggio principale della messa a punto di un modello esistente è quello di ottenere prestazioni simili con un numero inferiore di esempi, quindi è utile per adattare i modelli a compiti specifici senza grandi insiemi di dati. L'efficacia dei costi è un altro grande vantaggio dell'uso dei modelli esistenti per migliorare nuovi compiti senza riqualificarli.

In breve, la messa a punto è positiva per le prestazioni, l'efficienza e i costi. Permette di creare modelli migliori con risorse minime, quindi è un approccio da adottare in molte applicazioni del mondo reale. Il fine tuning rende il modello più efficiente e riduce i costi di formazione, quindi è una soluzione pratica per adattare i modelli alle vostre esigenze.

Approcci principali alla regolazione fine

Un'infografica che riassume gli approcci principali alla regolazione fine nell'apprendimento automatico

Un'infografica che riassume gli approcci principali alla regolazione fine nell'apprendimento automatico

La sintonizzazione fine ottimizza i modelli pre-addestrati per un compito specifico, è migliore dell'addestramento da zero ed è essenziale per adattare le reti neurali a un compito senza ri-addestramento. Esistono due modi per effettuare la sintonizzazione fine, l'estrazione delle caratteristiche e la sintonizzazione fine completa, ciascuno con i propri casi d'uso.

L'estrazione delle caratteristiche consente di sintonizzare solo gli ultimi strati di un modello pre-addestrato, mentre la sintonizzazione fine completa consente di sintonizzare tutti gli strati per un nuovo compito. Entrambi sono importanti per ottenere prestazioni elevate in casi d'uso specifici. Questa sezione illustra questi due approcci, il processo e i vantaggi.

Estrazione delle caratteristiche

L'approccio di estrazione delle caratteristiche per la messa a punto dei modelli linguistici di grandi dimensioni (LLM) utilizza il modello pre-addestrato come estrattore di caratteristiche fisse, mentre solo gli ultimi strati vengono addestrati su dati specifici del compito. Questo metodo riqualifica gli ultimi strati mantenendo il resto del modello fisso, quindi è più veloce ed efficiente.

In compiti NLP come l'analisi del sentimento e la generazione di testi, l'estrazione di caratteristiche può migliorare le prestazioni del modello sfruttando la conoscenza generale del modello pre-addestrato e concentrandosi sulle regolazioni specifiche del compito. Ciò è utile nei domini in cui i dati di addestramento sono limitati ma le caratteristiche specifiche del compito sono importanti.

Regolazione fine completa

La regolazione fine completa offre un adattamento più profondo del modello, regolando tutti gli strati in base al set di dati specifico. Questo metodo consente al modello di apprendere in modo completo dai dati specifici del compito, ottenendo prestazioni migliori e una maggiore accuratezza. A differenza dell'estrazione delle caratteristiche, la sintonizzazione fine completa riqualifica l'intero modello, rendendolo più adattabile a nuovi compiti.

La messa a punto completa richiede più tempo e risorse computazionali, ma spesso si ottiene un modello che si comporta in modo eccellente su compiti specifici. Ciò è particolarmente utile per i modelli linguistici di grandi dimensioni (LLM) che devono essere adattati in modo approfondito per ottenere i migliori risultati.

Regolando tutti i livelli, il modello può integrare completamente le nuove conoscenze e migliorare le sue prestazioni sul compito target.

Tecniche di regolazione fine

Il fine tuning consiste nell'adattare i modelli pre-addestrati a compiti specifici senza partire da zero. Esistono diverse tecniche di regolazione fine per diversi scenari e casi d'uso. Questa sezione tratterà tecniche come la regolazione fine supervisionata, l'apprendimento di rinforzo dal feedback umano (RLHF) e il Low-Rank Adaptation (LoRA).

Queste tecniche servono a migliorare le prestazioni dei modelli su compiti specifici, sfruttando le conoscenze dei modelli pre-addestrati. La comprensione di queste tecniche e delle loro applicazioni vi aiuterà a scegliere quella giusta per il vostro dominio. Questa sezione approfondisce ogni tecnica e ne spiega il processo e i vantaggi.

Regolazione fine supervisionata

Nella messa a punto supervisionata, i modelli vengono addestrati su dati etichettati per migliorare per compiti specifici. Ciò comporta l'utilizzo di dati etichettati specifici per il compito per prevedere le risposte corrette. La [messa a punto degli iperparametri] (https://zilliz.com/glossary/hyperparameter-tuning) è fondamentale per ottenere le giuste configurazioni del modello per ottenere risultati migliori.

Si tratta di una soluzione efficiente dal punto di vista delle risorse, che consente di adattarsi a dati limitati anziché richiedere insiemi di dati completamente nuovi. La regolazione fine può accelerare il processo di addestramento del modello, poiché parte da uno stato ben informato invece che da zero. Adattando un LLM pre-addestrato per sfruttare al meglio i dati etichettati esistenti, la regolazione fine supervisionata consente di migliorare notevolmente la robustezza, l'accuratezza e la rilevanza del modello, soprattutto quando i dati etichettati sono scarsi.

In generale, la messa a punto supervisionata è fondamentale per migliorare le prestazioni del modello su compiti specifici utilizzando in modo efficiente i dati etichettati. Ciò è particolarmente utile per i modelli linguistici di grandi dimensioni (LLM), per i quali la messa a punto richiede un'attenta gestione dei dati etichettati per ottenere i migliori risultati.

Apprendimento per rinforzo dal feedback umano (RLHF)

Il Reinforcement Learning from Human Feedback (RLHF) è un modo per addestrare i modelli linguistici. Si basa sull'interazione con il feedback umano. Il feedback umano in RLHF viene alimentato continuamente per migliorare l'accuratezza e la pertinenza dei modelli di elaborazione del linguaggio naturale. Il modello di ricompensa in RLHF prevede la generazione di output classificati da valutatori umani.

L'ottimizzazione della politica prossimale (PPO) è un algoritmo iterativo di RLHF che aggiorna la politica del modello per massimizzare le ricompense con stabilità. RLHF affina i risultati del modello attraverso le valutazioni umane per migliorare il modello linguistico di grandi dimensioni in termini di accuratezza e pertinenza. Si tratta di una funzione fondamentale per la messa a punto dei modelli linguistici di grandi dimensioni (LLM) in modo che rispondano meglio agli input umani.

Il feedback umano durante l'addestramento consente ai modelli di generare risposte contestualmente rilevanti. Questo è utile nelle applicazioni in cui i risultati devono essere molto accurati e pertinenti. RLHF mette a punto i modelli per ottenere una maggiore precisione e migliori prestazioni in compiti specifici.

Low-Rank Adaptation (LoRA)

Low-Rank Adaptation (LoRA) è una tecnica di regolazione fine efficiente che utilizza matrici di basso rango e un approccio basato sull'adattatore. Questo metodo consente un adattamento sostanziale del modello con regolazioni minime dei parametri, rendendolo altamente efficiente. Utilizzando matrici di basso rango, LoRA può raggiungere prestazioni simili a quelle di un fine-tuning completo, richiedendo però risorse computazionali significativamente inferiori.

Per modelli con miliardi di parametri, LoRA può mettere a punto il modello di base utilizzando solo alcuni milioni di parametri, con una significativa riduzione dei requisiti di risorse. Ciò rende LoRA un'opzione interessante per la messa a punto di modelli di grandi dimensioni, in quanto fornisce prestazioni simili con un fabbisogno di spazio inferiore rispetto alla messa a punto completa del modello. Concentrandosi sulle regolazioni dei parametri di maggiore impatto, LoRA garantisce un adattamento efficiente del modello.

L'efficienza di LoRA la rende particolarmente utile quando le risorse computazionali sono limitate ma sono richieste prestazioni elevate. Questa tecnica consente una messa a punto efficace senza grandi spese di calcolo, il che la rende una scelta pratica per molte applicazioni del mondo reale. Sfruttando le matrici a basso rango, LoRA fornisce un approccio equilibrato alla messa a punto di modelli di grandi dimensioni, ottenendo un'elevata precisione con un utilizzo ridotto delle risorse.

Migliori pratiche per la messa a punto fine

Una guida visiva alle migliori pratiche per la regolazione fine nell'apprendimento profondo

Una guida visiva alle migliori pratiche per la regolazione fine nell'apprendimento profondo

Una messa a punto efficace richiede una comprensione completa dell'architettura del modello e delle sfumature del set di dati. Questa sezione illustra le migliori pratiche per garantire che i modelli siano adattati in modo efficiente ed efficace ai nuovi compiti. Le pratiche includono la preparazione dei dati, la selezione dei modelli preaddestrati giusti, la messa a punto dei parametri e la validazione e iterazione del modello.

Il rispetto di queste best practice può migliorare significativamente le prestazioni e l'affidabilità dei modelli messi a punto. Seguire un approccio strutturato assicura che il processo di messa a punto sia ottimizzato per ottenere i migliori risultati. Questa sezione fornisce informazioni dettagliate su ciascuna pratica, evidenziandone l'importanza nel processo di messa a punto.

Preparazione dei dati

La preparazione dei dati è fondamentale per la messa a punto, in quanto influisce direttamente sulle prestazioni e sull'affidabilità del modello. I compiti comprendono la cura e la preelaborazione del set di dati, la pulizia dei dati, la gestione dei valori mancanti e la formattazione del testo. Assicurarsi che il set di dati sia equilibrato e rappresentativo dell'attività è fondamentale per il successo dell'addestramento.

La messa a punto dei modelli di dialogo con set di dati specifici può migliorare significativamente l'accuratezza dei chatbot del servizio clienti, dimostrando l'effetto di dati di alta qualità su prestazioni comparabili. La preparazione accurata dei dati di addestramento garantisce che il modello sia esposto a esempi pertinenti e rappresentativi, con conseguente miglioramento delle prestazioni.

Questa fase è essenziale per ottenere un'elevata accuratezza e affidabilità nei modelli sintonizzati.

Selezione di modelli preaddestrati

La scelta del giusto modello preaddestrato è fondamentale e influisce sulla velocità e sui risultati del processo di addestramento. La scelta del modello avrà un impatto sulla velocità di addestramento e sulle prestazioni finali. Quando si sceglie un modello preaddestrato, occorre considerare l'architettura del modello, i dati di addestramento e le prestazioni su compiti correlati.

Scegliendo un modello che corrisponda all'attività target, i professionisti possono assicurarsi che la messa a punto sia efficiente ed efficace. Ad esempio, la scelta di un modello preaddestrato per il linguaggio naturale o di un modello che è stato addestrato su dati simili garantirà una convergenza più rapida e prestazioni migliori sul compito.

Questa è la chiave per la messa a punto e per ottenere i migliori risultati.

Parametri di regolazione fine

I parametri chiave per la regolazione fine includono il tasso di apprendimento, le epoche e la dimensione del batch. La regolazione dinamica del tasso di apprendimento durante l'addestramento può portare a una migliore convergenza. La regolazione fine completa richiede più risorse computazionali e richiede più tempo dell'estrazione delle caratteristiche, con un impatto sulla selezione delle epoche e della dimensione del batch.

La messa a punto fine consentirà di realizzare modelli per casi d'uso specifici in modo più efficiente, regolando attentamente questi parametri. Ottimizzando il tasso di apprendimento, le epoche e la dimensione del batch, i professionisti possono garantire che il modello si adatti bene al nuovo compito e raggiunga prestazioni elevate.

Questa fase è fondamentale per mettere a punto i modelli e ottenere i migliori risultati possibili.

Convalida e iterazione del modello

La convalida nel processo di messa a punto consiste nel valutare il modello utilizzando un set di convalida. L'iterazione del modello comporta l'affinamento del modello in base ai risultati della valutazione, garantendo un miglioramento continuo. Durante la convalida, per valutare le prestazioni del modello vengono monitorate metriche quali accuratezza, perdita, precisione e richiamo.

La convalida fornisce indicazioni sulle prestazioni e sulle aree di miglioramento del modello messo a punto. Le tecniche di convalida incrociata forniranno stime più affidabili delle prestazioni di un modello, garantendo che il modello si generalizzi bene a nuovi dati.

Con l'iterazione del modello in base ai risultati della convalida, i professionisti possono assicurarsi che il modello messo a punto raggiunga le migliori prestazioni possibili.

Applicazioni reali della regolazione fine

Esempi di applicazioni reali della regolazione fine in vari campi

Esempi di applicazioni reali della regolazione fine in vari campi

Il fine tuning è oggi utilizzato da molte aziende. Esse vogliono utilizzare modelli pre-addestrati per i loro casi d'uso. Alcuni esempi reali di fine tuning sono l'analisi del sentiment, i chatbot e la sintesi di testi. La messa a punto dei modelli per compiti specifici consente di migliorare l'accuratezza e la velocità del modello.

Il fine tuning è versatile, quindi esamineremo diversi esempi reali di fine tuning per vederne l'impatto e i vantaggi in diversi settori.

Grazie a questi esempi, i professionisti potranno apprezzare il valore della regolazione fine nelle prestazioni e nell'utilità dei modelli.

Analisi del sentimento

La regolazione fine migliora l'analisi del sentiment consentendo ai modelli linguistici preaddestrati di adattarsi al linguaggio e al contesto specifici, per rilevare meglio il sentiment. Grazie alla messa a punto dei modelli pre-addestrati, le organizzazioni possono adattare l'analisi del sentiment per cogliere le sfumature del loro settore o del loro pubblico. I modelli ottimizzati possono superare gli strumenti generali di analisi del sentiment grazie all'utilizzo di vocaboli e frasi specifici del settore.

Il miglioramento dell'analisi del sentiment attraverso la messa a punto contribuisce alla gestione della reputazione, analizzando il feedback e il sentiment dei clienti in tempo reale. Le organizzazioni possono utilizzare l'analisi del sentiment con la regolazione fine per rispondere in modo proattivo alle preoccupazioni dei clienti e quindi migliorare la loro reputazione complessiva. Questo porta a decisioni aziendali più informate, fornendo approfondimenti sulle opinioni dei clienti e sulle tendenze del mercato.

Chatbot e IA conversazionale

La messa a punto è fondamentale per creare conversazioni contestualmente rilevanti e coinvolgenti per i chatbot. I chatbot ben sintonizzati creano conversazioni e interazioni con gli utenti contestualmente rilevanti e coinvolgenti. Nell'e-commerce, i chatbot ben sintonizzati aiutano a rispondere alle domande e alle raccomandazioni sui prodotti. Inoltre, aiutano a facilitare le transazioni.

Nel settore finanziario, i chatbot fine tuned forniscono consigli finanziari personali e aiutano nella gestione dei conti. Nel settore sanitario i chatbot fine tuned rispondono a domande mediche dettagliate e forniscono assistenza.

I modelli ottimizzati possono analizzare i contenuti dei social media, fornendo informazioni sull'opinione pubblica e sulla percezione del marchio. Questi pochi esempi mostrano come la messa a punto possa fare la differenza nell'IA conversazionale.

Riassunto del testo

I modelli di riassunto ottimizzati riducono lunghi articoli di ricerca in contenuti più digeribili e comprensibili. Sono utili anche per ridurre lunghi rapporti e documenti aziendali. Grazie alla messa a punto dei modelli di riassunto, è possibile ottenere riassunti da lunghi articoli di notizie e assicurarsi che vengano catturate le informazioni importanti.

Ciò è particolarmente utile per le attività in cui è necessario accedere rapidamente alle informazioni riassunte, come nelle agenzie di stampa e negli istituti di ricerca. La messa a punto consente ai modelli di riepilogo di adattarsi a compiti e domini specifici e di fornire riepiloghi concisi e accurati di dati non visti, particolarmente preziosi in molti contesti professionali.

Questo migliora l'utilità dei modelli di riassunto del testo nel gestire grandi volumi di testo in modo efficiente.

Confronto tra Fine Tuning e altre tecniche

La sintonizzazione fine è ottima, ma confrontiamola con altri metodi di apprendimento automatico per vederne i punti di forza e di debolezza. Questa sezione esaminerà il confronto tra la sintonizzazione fine e l'apprendimento per trasferimento e la Retrieval Augmented Generation (RAG).

Alla fine di questa sezione saprete quale metodo utilizzare per il vostro caso d'uso. Questa sezione mostrerà le differenze e le sovrapposizioni tra il fine tuning e gli altri approcci.

Apprendimento per trasferimento vs. regolazione fine

L'apprendimento per trasferimento utilizza un modello pre-addestrato come punto di partenza per adattarsi ai dati specifici del compito. Il fine tuning è una regolazione specifica di un modello, mentre il transfer learning è un concetto più ampio di applicazione delle conoscenze di un compito a un compito correlato. Entrambi sono importanti per l'utilizzo di modelli pre-addestrati per compiti speciali, ma sono diversi nell'approccio e nell'applicazione.

L'apprendimento per trasferimento applica le conoscenze generali da un'attività a un'altra, mentre la messa a punto ottimizza la capacità di un modello per un caso d'uso specifico, regolandone i parametri. La messa a punto richiede più dati specifici per il nuovo compito, mentre l'apprendimento per trasferimento può lavorare con insiemi di dati più piccoli sfruttando le conoscenze esistenti.

Comprendere queste differenze è fondamentale per scegliere l'approccio giusto per compiti specifici.

Generazione aumentata di recupero (RAG)

La Retrieval Augmented Generation (RAG) combina modelli pre-addestrati con fonti di dati esterne che vengono convertite in embeddings e memorizzate in un database vettoriale per rendere l'output più rilevante. RAG colma le lacune di conoscenza introducendo dati in tempo reale nel processo di generazione. Ciò consente ai modelli linguistici di grandi dimensioni di fornire risposte più accurate, accedendo alle informazioni più recenti provenienti da più fonti.

[RAG può creare fiducia nell'utente citando le fonti, proprio come nella scrittura accademica.

Combinando un LLM con una banca dati curata, RAG consente ai modelli linguistici di grandi dimensioni di fornire risposte più accurate e contestuali. Questo facilita l'aggiunta di nuove basi di conoscenza ai modelli di intelligenza artificiale, in modo che gli sviluppatori possano semplicemente inserire nuove fonti di dati.

Sintesi

Il fine tuning è una potente tecnica di apprendimento automatico utilizzata per migliorare i modelli pre-addestrati per compiti specifici. Comprendendo il processo, le tecniche e le best practice del fine tuning, i professionisti possono utilizzarlo per creare modelli adatti alle loro esigenze. Dalla preparazione dei dati alla convalida, ogni fase del processo di fine tuning è importante. Confrontando il fine tuning con altre tecniche come l'apprendimento per trasferimento e il RAG, i professionisti possono decidere quale sia la migliore per le loro attività. Il fine tuning è un modo pratico, efficiente ed economico per migliorare le prestazioni dei modelli, quindi è uno strumento prezioso nel deep learning.

Domande frequenti

Che cos'è il fine tuning nel deep learning?

Il fine tuning nel deep learning è il perfezionamento di un modello pre-addestrato per un compito specifico, regolando i suoi parametri con un set di dati di addestramento più piccolo e specifico per il compito, migliorando così le sue prestazioni per quella particolare applicazione.

Quali sono gli approcci principali al fine tuning?

Gli approcci principali alla regolazione fine sono l'estrazione delle caratteristiche, in cui vengono regolati solo gli strati finali, e la regolazione fine completa, che regola tutti gli strati del modello. La scelta dell'approccio giusto dipende dai requisiti specifici e dal set di dati.

In che modo la sintonizzazione fine supervisionata differisce dalla RLHF?

Il fine tuning supervisionato si concentra sull'addestramento dei modelli con dati etichettati per compiti specifici, mentre l'RLHF sfrutta il feedback umano per migliorare le prestazioni del modello nel tempo. Questa distinzione evidenzia i diversi approcci al miglioramento delle capacità dell'IA.

Quali sono le migliori pratiche per la messa a punto dei modelli?

Per mettere a punto i modelli in modo efficace, è necessario concentrarsi su un'accurata preparazione dei dati, scegliere un modello pre-addestrato appropriato e regolare con attenzione i parametri chiave, convalidando e iterando in base alle metriche delle prestazioni. Questi passaggi miglioreranno l'accuratezza e l'efficienza del modello.

Quali sono le applicazioni reali del fine tuning?

Il fine tuning viene applicato efficacemente all'analisi del sentiment, ai chatbot e alla sintesi dei testi, fornendo una maggiore precisione e rilevanza in questi campi. L'utilizzo di modelli ottimizzati può migliorare significativamente le prestazioni delle applicazioni di IA nella comprensione e nella generazione di risposte simili a quelle umane.

- Riepilogo rapido

- Sintonia fine: Tecniche e migliori pratiche

- Introduzione

- Comprendere la regolazione fine

- Approcci principali alla regolazione fine

- Tecniche di regolazione fine

- Migliori pratiche per la messa a punto fine

- Applicazioni reali della regolazione fine

- Confronto tra Fine Tuning e altre tecniche

- Sintesi

- Domande frequenti

Contenuto

Inizia gratis, scala facilmente

Prova il database vettoriale completamente gestito progettato per le tue applicazioni GenAI.

Prova Zilliz Cloud gratuitamente