Dominar o ajuste fino na aprendizagem profunda: Técnicas e dicas

Dominar o ajuste fino na aprendizagem profunda: Técnicas e dicas

O ajuste fino no aprendizado profundo refina modelos pré-treinados para tarefas específicas, economiza tempo e recursos. Aqui está o que é o ajuste fino, por que é importante e como fazê-lo.

Resumo rápido

O ajuste fino é uma técnica fundamental no aprendizado profundo que otimiza modelos pré-treinados para tarefas específicas, tornando-os mais eficientes e precisos usando o conhecimento existente.

A extração de recursos e o ajuste fino completo são as duas abordagens para o ajuste fino, cada uma com seus próprios benefícios, dependendo da tarefa e dos recursos.

A afinação fina requer uma preparação cuidadosa dos dados, a escolha dos modelos pré-treinados corretos, a afinação dos parâmetros e a validação iterativa para que o modelo funcione em aplicações do mundo real.

Ajuste fino: Técnicas e práticas recomendadas

Uma ilustração que descreve várias técnicas de ajuste fino em aprendizagem profunda

Uma ilustração que descreve várias técnicas de ajuste fino em aprendizagem profunda

O ajuste fino melhora os modelos pré-treinados para aplicações especializadas, ajustando seus parâmetros para tarefas específicas. Ao contrário dos modelos de treino de raiz, este método utiliza o conhecimento existente no modelo pré-treinado, tornando-o mais eficiente e, muitas vezes, mais eficaz. O processo de afinação pode ser classificado em termos gerais em afinação supervisionada e aprendizagem por reforço a partir de feedback humano (RLHF). Quando bem efectuados, estes processos podem realmente melhorar os [modelos linguísticos de grande dimensão] (https://zilliz.com/glossary/large-language-models-(llms)) (LLMs).

A escolha do modelo pré-treinado correto é importante, tendo em conta o tamanho do modelo, os dados de treino e o desempenho em tarefas relevantes. Por exemplo, em áreas como a medicina personalizada, a afinação fina pode prever riscos para a saúde e personalizar planos de tratamento com base em registos e dados médicos específicos.

Compreender a arquitetura do modelo e a forma como se adapta a novas tarefas é fundamental para o ajuste fino. Este processo não só optimiza os modelos para necessidades específicas, como também melhora o seu desempenho e utilidade globais.

Introdução

O ajuste fino é uma parte fundamental do aprendizado profundo, pegando um modelo pré-treinado e ajustando-o para uma tarefa específica com um conjunto de dados menor. O ajuste de partes do modelo para se adaptar a dados novos e específicos da tarefa aumenta a precisão e a eficiência.

Isto é útil porque poupa tempo em comparação com o treino de um modelo a partir do zero e, muitas vezes, produz melhores resultados, aproveitando o conhecimento incorporado no modelo pré-treinado.

Entendendo o ajuste fino

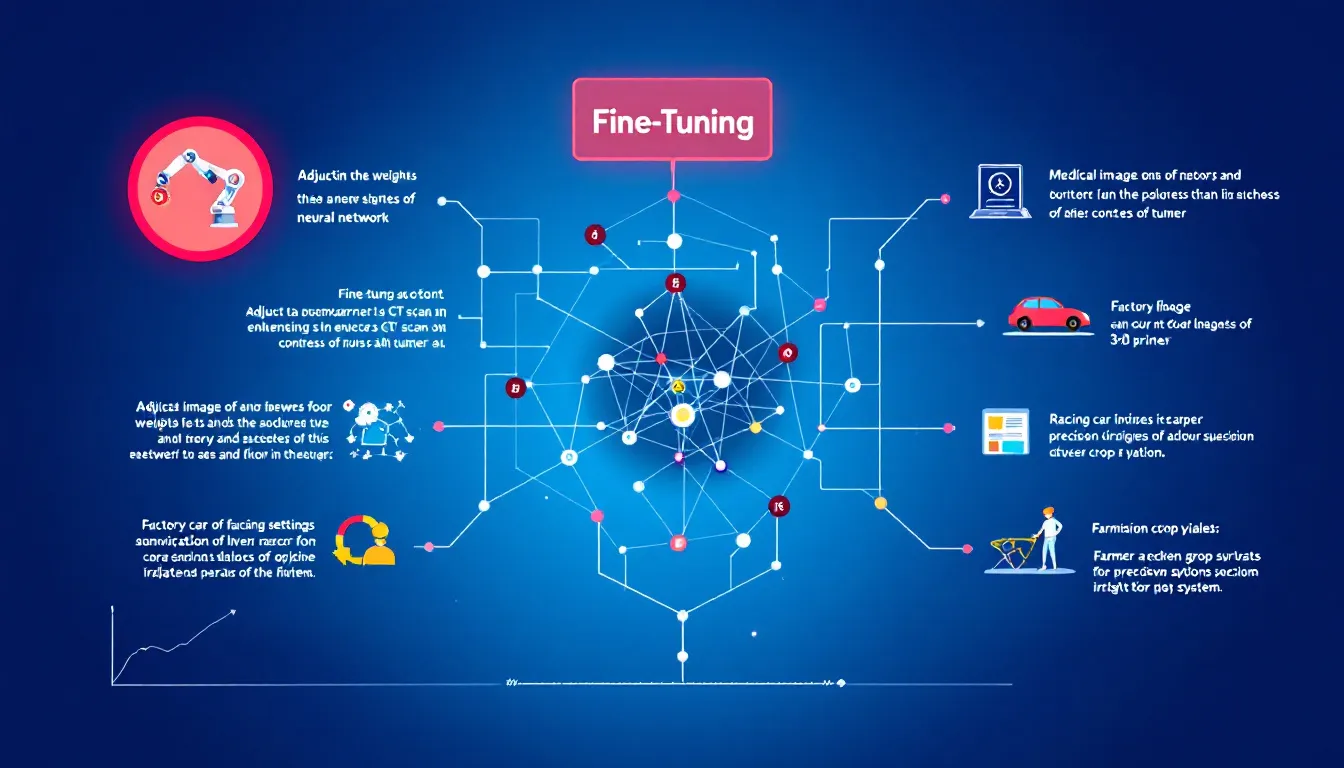

Um diagrama que ilustra o processo de ajuste fino na aprendizagem profunda

Um diagrama que ilustra o processo de ajuste fino na aprendizagem profunda

O ajuste fino melhora os modelos pré-treinados para tarefas específicas, aumentando a sua eficácia em aplicações específicas. Muitas vezes visto como um refinamento do aprendizado de transferência, ele utiliza modelos pré-treinados para especialização de tarefas. Compreender as nuances da afinação fina, incluindo os seus métodos e principais benefícios, é crucial para aproveitar plenamente o seu potencial.

Os métodos de afinação podem ser classificados em dois grandes tipos. São eles o ajuste fino supervisionado e a aprendizagem por reforço a partir de feedback humano (RLHF). A seleção do modelo pré-treinado adequado é essencial para o alinhamento com os requisitos da tarefa-alvo, garantindo uma integração perfeita e maximizando a adaptabilidade.

É necessário considerar cuidadosamente factores como a dimensão do modelo, os dados de treino e o desempenho em tarefas relevantes. Esta secção explora a definição, a importância e os mecanismos de funcionamento da afinação fina.

Definição e importância

O ajuste fino é uma técnica para ajustar os parâmetros de um modelo treinado para melhorar o desempenho em uma tarefa específica. No contexto dos modelos de linguagem, envolve o ajuste dos parâmetros de um modelo pré-treinado para melhor se adequar a um domínio ou tarefa específica. Este método permite que os modelos mantenham as suas capacidades originais enquanto se adaptam a casos de utilização especializados, melhorando assim o seu desempenho.

O ajuste fino personaliza os modelos pré-treinados para se concentrarem em tarefas específicas, melhorando a sua especialização e desempenho. Este método é particularmente vantajoso com conjuntos de dados grandes e específicos de tarefas, especialmente se diferirem significativamente do conjunto de dados completo pré-treinado. Permite uma adaptação eficiente utilizando dados limitados, optimizando as percepções pré-treinadas para aplicações específicas.

O ajuste fino aproveita o conhecimento existente dos modelos pré-treinados para obter melhores resultados em tarefas especializadas. Esta abordagem é eficiente e económica, reduzindo a necessidade de uma reciclagem extensiva. O ajuste fino também ajuda os modelos a generalizar melhor para novos dados, o que é crucial para resultados fiáveis no mundo real.

Como funciona o ajuste fino

O ajuste fino geralmente começa congelando as camadas iniciais de um modelo pré-treinado e concentrando os ajustes nas camadas posteriores para especializar o modelo para novas tarefas. Isso retém o conhecimento geral incorporado nas camadas iniciais enquanto permite a adaptação a dados específicos da tarefa. A reciclagem utiliza normalmente uma taxa de aprendizagem mais baixa, mantendo a maioria dos parâmetros fixos enquanto ajusta as camadas finais.

O objetivo é adaptar modelos pré-treinados a domínios específicos, ajustando certas camadas com base em dados específicos da tarefa. Ao afinar apenas as camadas posteriores, o modelo aproveita o seu conhecimento geral existente, especializando-se na tarefa em causa. Este processo é crucial para alcançar um elevado desempenho em aplicações específicas sem uma reciclagem extensiva.

O ajuste fino exige uma compreensão profunda da arquitetura do modelo e dos requisitos específicos da tarefa. O processo é iterativo, envolvendo várias rondas de formação e validação para garantir uma boa adaptação a novos dados. Este método melhora o desempenho e a eficiência do modelo no tratamento de tarefas especializadas.

Benefícios

O ajuste fino torna os modelos mais eficientes para que seja possível criar modelos melhores com menos recursos do que treinar do zero. Ele geralmente converge mais rápido e tem melhor desempenho. O uso de modelos pré-treinados reduz o custo computacional do treinamento.

A principal vantagem da afinação de um modelo existente é obter um desempenho semelhante com menos exemplos, pelo que é bom para adaptar modelos a tarefas específicas sem grandes conjuntos de dados. A relação custo-eficácia é outra grande vantagem da utilização de modelos existentes para melhorar novas tarefas sem necessidade de reciclagem.

Em suma, o ajuste fino é bom para o desempenho, a eficiência e o custo. Permite-lhe criar melhores modelos com recursos mínimos, pelo que é uma abordagem a adotar em muitas aplicações do mundo real. A afinação fina torna o modelo mais eficiente e reduz os custos de formação, pelo que é uma solução prática para adaptar os modelos às suas necessidades.

Principais abordagens para o ajuste fino

Uma infografia que resume as principais abordagens ao ajuste fino na aprendizagem automática

Uma infografia que resume as principais abordagens ao ajuste fino na aprendizagem automática

O ajuste fino optimiza os modelos pré-treinados para uma tarefa específica, é melhor do que treinar a partir do zero e é essencial para adaptar as redes neurais a uma tarefa sem voltar a treinar. Existem duas formas de afinação, a extração de caraterísticas e a afinação total, cada uma com os seus próprios casos de utilização.

A extração de caraterísticas afina apenas as últimas camadas de um modelo pré-treinado, enquanto o ajuste fino completo afina todas as camadas para uma nova tarefa. Ambos são importantes para um elevado desempenho em casos de utilização específicos. Esta secção abordará estas duas abordagens, o processo e as vantagens.

Extração de caraterísticas

A abordagem de extração de caraterísticas no ajuste fino de modelos de linguagem de grande porte (LLMs) utiliza o modelo pré-treinado como um extrator de caraterísticas fixo, apenas as últimas camadas são treinadas em dados específicos da tarefa. Este método treina novamente as últimas camadas, mantendo o resto do modelo fixo, pelo que é mais rápido e mais eficiente.

Em [NLP tasks] (https://zilliz.com/learn/popular-datasets-for-natural-language-processing), como a análise de sentimentos e a geração de texto, a extração de caraterísticas pode melhorar o desempenho do modelo, tirando partido do conhecimento geral do modelo pré-treinado e concentrando-se nos ajustamentos específicos da tarefa. Isto é útil em domínios em que os dados de treino são limitados mas as caraterísticas específicas da tarefa são importantes.

Ajuste fino completo

O ajuste fino completo oferece uma adaptação mais profunda do modelo, ajustando todas as camadas ao conjunto de dados específico. Este método permite que o modelo aprenda de forma abrangente a partir de dados específicos da tarefa, conduzindo a um melhor desempenho e a uma maior precisão. Ao contrário da extração de caraterísticas, o ajuste fino completo volta a treinar todo o modelo, tornando-o mais adaptável a novas tarefas.

O ajuste fino completo requer mais recursos computacionais e tempo, mas muitas vezes resulta num modelo com um excelente desempenho em tarefas específicas. Isto é especialmente útil para modelos de linguagem de grande dimensão (LLMs) que precisam de ser adaptados minuciosamente para obter os melhores resultados.

Ao ajustar todas as camadas, o modelo pode integrar totalmente novos conhecimentos e melhorar o seu desempenho na tarefa-alvo.

Técnicas de ajuste fino

O ajuste fino consiste em ajustar modelos pré-treinados para tarefas específicas sem começar do zero. Existem diferentes técnicas de afinação para diferentes cenários e casos de utilização. Esta secção abordará técnicas como a afinação supervisionada, a aprendizagem por reforço a partir de feedback humano (RLHF) e a adaptação de baixa classificação (LoRA).

Estas técnicas destinam-se a melhorar o desempenho do modelo em tarefas específicas, tirando partido dos conhecimentos dos modelos pré-treinados. A compreensão destas técnicas e das suas aplicações ajudá-lo-á a escolher a mais adequada para o seu domínio. Esta secção abordará cada técnica e explicará o processo e as vantagens.

Ajuste fino supervisionado

No ajuste fino supervisionado, os modelos são treinados em dados rotulados para melhorar para tarefas específicas. Isso envolve o uso de dados rotulados específicos da tarefa para prever respostas corretas. O [Hyperparameter tuning] (https://zilliz.com/glossary/hyperparameter-tuning) é fundamental, para obter as configurações corretas do modelo para obter melhores resultados.

Isto é eficiente em termos de recursos, permitindo a adaptação com dados limitados em vez de exigir conjuntos de dados inteiramente novos. A afinação fina pode acelerar o processo de treino do modelo, uma vez que este parte de um estado bem informado em vez de partir do zero. Ao adaptar um LLM pré-treinado para aproveitar ao máximo os dados rotulados existentes, o ajuste fino supervisionado proporciona grandes melhorias na robustez, precisão e relevância do modelo, especialmente quando os dados rotulados são escassos.

Em geral, a afinação supervisionada é fundamental para melhorar o desempenho do modelo em tarefas específicas, utilizando eficientemente os dados etiquetados. Isto é especialmente útil para os modelos linguísticos de grande dimensão (LLM), em que a afinação fina exige um tratamento cuidadoso dos dados etiquetados para obter os melhores resultados.

Aprendizagem por reforço a partir de feedback humano (RLHF)

A aprendizagem por reforço a partir de feedback humano (RLHF) é uma forma de treinar modelos de linguagem. Baseia-se em interações com feedback humano. O feedback humano na RLHF é alimentado continuamente para melhorar a precisão e a relevância do modelo de processamento de linguagem natural. A modelação de recompensas no RLHF envolve a geração de resultados classificados por avaliadores humanos.

A otimização da política proximal (PPO) é um algoritmo iterativo do RLHF que actualiza a política do modelo para maximizar as recompensas com estabilidade. O RLHF refina os resultados do modelo através de avaliações humanas para melhorar a exatidão e a relevância do modelo de linguagem de grande dimensão. Isto é fundamental para afinar os modelos linguísticos de grande dimensão (LLMs) de modo a responderem melhor aos contributos humanos.

O feedback humano na formação permite que os modelos gerem respostas contextualmente relevantes. Isto é útil em aplicações em que os resultados têm de ser altamente exactos e relevantes. A RLHF afina os modelos para obter maior precisão e melhor desempenho em tarefas específicas.

Adaptação de baixa classificação (LoRA)

A Low-Rank Adaptation (LoRA) é uma técnica para um ajuste fino eficiente, usando matrizes de baixa classificação e uma abordagem baseada em adaptador. Este método permite uma adaptação substancial do modelo com ajustes mínimos de parâmetros, tornando-o altamente eficiente. Ao utilizar matrizes de baixa classificação, a LoRA pode alcançar um desempenho semelhante ao da afinação total, exigindo significativamente menos recursos computacionais.

Para modelos com biliões de parâmetros, o LoRA pode fazer o ajuste fino do modelo base usando apenas vários milhões de parâmetros, oferecendo uma redução significativa nos requisitos de recursos. Isto torna o LoRA uma opção atractiva para o ajustamento de modelos de grande dimensão, uma vez que proporciona um desempenho semelhante com menos requisitos de espaço em comparação com o ajustamento de modelos completos. Ao concentrar-se nos ajustes de parâmetros mais impactantes, o LoRA garante uma adaptação eficiente do modelo.

A eficiência do LoRA torna-o particularmente útil quando os recursos computacionais são limitados mas é necessário um elevado desempenho. Esta técnica permite um ajuste fino eficaz sem grandes despesas computacionais, tornando-a uma escolha prática para muitas aplicações do mundo real. Ao aproveitar as matrizes de baixo grau, o LoRA fornece uma abordagem equilibrada para o ajuste fino de modelos grandes, alcançando alta precisão com uso reduzido de recursos.

Melhores práticas para o ajuste fino

Um guia visual para as melhores práticas de ajuste fino em aprendizagem profunda

Um guia visual para as melhores práticas de ajuste fino em aprendizagem profunda

O ajuste fino eficaz requer uma compreensão abrangente da arquitetura do modelo e das nuances do conjunto de dados. Esta secção descreve as melhores práticas, garantindo que os modelos são adaptados de forma eficiente e eficaz a novas tarefas. As práticas incluem a preparação de dados, a seleção dos modelos pré-treinados corretos, o ajuste de parâmetros e a validação e iteração do modelo.

A adesão a estas melhores práticas pode melhorar significativamente o desempenho e a fiabilidade dos modelos ajustados. Seguir uma abordagem estruturada garante que o processo de afinação é optimizado para obter os melhores resultados. Esta secção fornece informações detalhadas sobre cada prática, destacando a sua importância no processo de afinação.

Preparação de dados

A preparação dos dados é crucial no ajuste fino, afectando diretamente o desempenho e a fiabilidade do modelo. As tarefas incluem a seleção e o pré-processamento do conjunto de dados, a limpeza dos dados, o tratamento dos valores em falta e a formatação do texto. Garantir que o conjunto de dados seja equilibrado e representativo da tarefa é fundamental para o sucesso do treinamento.

O ajuste fino dos modelos de diálogo com conjuntos de dados específicos pode melhorar significativamente a precisão dos chatbots de serviço ao cliente, demonstrando o efeito de dados de alta qualidade num desempenho comparável. A preparação cuidadosa dos dados de formação garante que o modelo é exposto a exemplos relevantes e representativos, o que conduz a um melhor desempenho.

Este passo é essencial para alcançar uma elevada precisão e fiabilidade em modelos aperfeiçoados.

Seleção de modelos pré-treinados

A escolha do modelo pré-treinado correto é fundamental, pois irá afetar a velocidade e o resultado do processo de formação. A escolha do modelo terá impacto na velocidade de treinamento e no desempenho final. Considere a arquitetura do modelo, os dados de treinamento e o desempenho em tarefas relacionadas ao escolher um modelo pré-treinado.

Ao escolher um modelo que corresponda à tarefa-alvo, os profissionais podem certificar-se de que o ajuste fino é eficiente e eficaz. Por exemplo, a escolha de uma linguagem natural pré-treinada ou de um modelo que tenha sido treinado com dados semelhantes permitirá uma convergência mais rápida e um melhor desempenho na tarefa.

Esta é a chave para a afinação fina e para obter os melhores resultados.

Parâmetros de ajuste fino

Os principais parâmetros para o ajuste fino incluem a taxa de aprendizado, as épocas e o tamanho do lote. Ajustar dinamicamente a taxa de aprendizado durante o treinamento pode levar a uma melhor convergência. O ajuste fino completo requer mais recursos computacionais e leva mais tempo do que a extração de recursos, afetando a seleção de épocas e o tamanho do lote.

A afinação fina permitirá modelos para casos de utilização específicos de forma mais eficiente, ajustando cuidadosamente estes parâmetros. Ao otimizar a taxa de aprendizagem, as épocas e o tamanho do lote, os profissionais podem garantir que o modelo se adapta bem à nova tarefa e atinge um elevado desempenho.

Este passo é fundamental para afinar os modelos e obter os melhores resultados possíveis.

Validação e iteração de modelos

A validação no processo de ajuste fino consiste em avaliar o modelo usando um conjunto de validação. A iteração do modelo envolve o refinamento do modelo com base nos resultados da avaliação, garantindo a melhoria contínua. Durante a validação, métricas como exatidão, perda, precisão e recordação são monitorizadas para avaliar o desempenho do modelo.

A validação fornece informações sobre o desempenho e as áreas de melhoria do modelo aperfeiçoado. As técnicas de validação cruzada darão estimativas mais fiáveis do desempenho de um modelo, garantindo que o modelo se generaliza bem a novos dados.

Ao iterar o modelo com base nos resultados da validação, os profissionais podem garantir que o modelo aperfeiçoado atinja o melhor desempenho possível.

Aplicações do mundo real do ajuste fino

Exemplos de aplicações reais de afinação em vários domínios

Exemplos de aplicações reais de afinação em vários domínios

O ajuste fino é atualmente utilizado por muitas empresas. Estas pretendem utilizar modelos pré-treinados para os seus casos de utilização. Alguns exemplos do mundo real de afinação fina são a análise de sentimentos, os chatbots e a sumarização de texto. Os modelos de afinação fina para tarefas específicas conduzem a uma melhor precisão e velocidade do modelo.

O ajuste fino é versátil, pelo que analisaremos diferentes exemplos do mundo real de ajuste fino para ver o seu impacto e benefícios em diferentes sectores.

Ao ver estes exemplos, os profissionais podem apreciar o valor da afinação fina no desempenho e utilidade do modelo.

Análise de sentimento

O ajuste fino melhora a análise de sentimentos, permitindo que os modelos linguísticos pré-treinados se adaptem à linguagem e ao contexto específicos, para detetar melhor os sentimentos. Ao afinar os modelos pré-treinados, as organizações podem adaptar a análise de sentimentos para captar as nuances do seu sector ou público. Os modelos aperfeiçoados podem superar as ferramentas gerais de análise de sentimentos, utilizando vocabulário e frases específicos do domínio.

Uma análise de sentimentos melhorada através de uma afinação fina ajuda na gestão da reputação, analisando o feedback e o sentimento dos clientes em tempo real. As organizações podem utilizar a análise de sentimentos aperfeiçoada para responder proactivamente às preocupações dos clientes e, assim, melhorar a sua reputação geral. Isto conduz a decisões de negócio mais informadas, dando uma visão mais profunda das opiniões dos clientes e das tendências do mercado.

Chatbots e IA de conversação

O ajuste fino é a chave para criar conversas contextualmente relevantes e envolventes para os chatbots. Os chatbots bem afinados criam conversas contextualmente relevantes e envolventes, interações com os utilizadores. No comércio eletrónico, os chatbots bem afinados ajudam a responder a perguntas e a fazer recomendações sobre produtos. Também ajudam a facilitar as transacções.

No sector financeiro, os chatbots aperfeiçoados dão conselhos financeiros pessoais e ajudam na gestão de contas. Nos cuidados de saúde, os chatbots aperfeiçoados respondem a questões médicas pormenorizadas e prestam apoio.

Os modelos aperfeiçoados podem analisar o conteúdo das redes sociais, fornecendo informações sobre a opinião pública e a perceção da marca. Estes poucos exemplos mostram como o ajuste fino pode fazer a diferença na IA de conversação.

Sumarização de texto

Os modelos de sumarização bem afinados reduzem longos artigos de investigação em conteúdos mais digeríveis e compreensíveis. Também são úteis para reduzir relatórios longos e documentos comerciais. Ao ajustar os modelos de sumarização, é possível obter resumos de artigos de notícias longos e garantir que as informações importantes sejam capturadas.

Isto é particularmente útil para tarefas em que é necessário um acesso rápido a informações resumidas, como em agências de notícias e instituições de investigação. O ajuste fino permite que os modelos de sumarização se adaptem a tarefas e domínios específicos e forneçam resumos concisos e precisos de dados não vistos que são muito valiosos em muitos contextos profissionais.

Isto aumenta a utilidade dos modelos de sumarização de texto no tratamento eficiente de grandes volumes de texto.

Comparando o ajuste fino com outras técnicas

O ajuste fino é ótimo, mas vamos compará-lo com outros métodos de aprendizagem automática para ver os seus pontos fortes e fracos. Esta secção analisará a forma como o ajuste fino se compara com a aprendizagem por transferência e a Geração Aumentada de Recuperação (RAG).

No final desta secção, saberá qual o método a utilizar para o seu caso de utilização. Esta secção mostrará as diferenças e sobreposições entre a afinação fina e outras abordagens.

Aprendizagem por transferência vs. ajuste fino

A aprendizagem por transferência usa um modelo pré-treinado como ponto de partida para se adaptar aos dados específicos da tarefa. O ajuste fino é um ajuste específico de um modelo, a aprendizagem por transferência é um conceito mais amplo de aplicação do conhecimento de uma tarefa a uma tarefa relacionada. Ambos são importantes para a utilização de modelos pré-treinados para tarefas especiais, mas são diferentes em termos de abordagem e aplicação.

A aprendizagem por transferência aplica conhecimentos gerais de uma tarefa a outra, enquanto a afinação fina optimiza a capacidade de um modelo para um caso de utilização específico, ajustando os seus parâmetros. A afinação fina requer mais dados específicos para a nova tarefa, ao passo que a aprendizagem por transferência pode funcionar com conjuntos de dados mais pequenos, tirando partido dos conhecimentos existentes.

Compreender estas diferenças é crucial para selecionar a abordagem correta para tarefas específicas.

Geração Aumentada de Recuperação (RAG)

A Retrieval Augmented Generation (RAG) combina modelos pré-treinados com fontes de dados externas que são convertidas em [embeddings] (https://zilliz.com/learn/what-are-binary-vetor-embedding) e armazenadas numa base de dados vetorial para tornar o resultado mais relevante. A RAG preenche as lacunas de conhecimento ao introduzir dados em tempo real no processo de geração. Isto permite que os modelos linguísticos de grande dimensão dêem respostas mais precisas, acedendo às informações mais recentes de várias fontes.

O RAG pode criar confiança no utilizador através da citação de fontes, tal como acontece na escrita académica.

Ao combinar um LLM com uma base de dados com curadoria, o RAG permite que os grandes modelos linguísticos dêem respostas mais exactas e contextuais. Isto facilita a adição de novas bases de conhecimento aos modelos de IA, pelo que os programadores podem simplesmente introduzir novas fontes de dados.

Resumo

O ajuste fino é uma técnica poderosa de aprendizado de máquina usada para melhorar modelos pré-treinados para tarefas específicas. Ao compreender o processo, as técnicas e as melhores práticas de ajuste fino, os profissionais podem utilizá-lo para criar modelos que atendam às suas necessidades. Desde a preparação dos dados até à validação, cada passo do processo de afinação é importante. Ao comparar a afinação fina com outras técnicas, como a aprendizagem por transferência e o RAG, os profissionais podem decidir qual é a melhor para as suas tarefas. O ajuste fino é uma forma prática, eficiente e económica de melhorar o desempenho do modelo, pelo que é uma ferramenta valiosa na aprendizagem profunda.

Perguntas frequentes

O que é o ajuste fino na aprendizagem profunda?

O ajuste fino na aprendizagem profunda é o refinamento de um modelo pré-treinado para uma tarefa específica, ajustando seus parâmetros com um conjunto de dados de treinamento menor e específico da tarefa, melhorando assim seu desempenho para essa aplicação específica.

Quais são as principais abordagens para o ajuste fino?

As principais abordagens para o ajuste fino são a extração de recursos, em que apenas as camadas finais são ajustadas, e o ajuste fino completo, que ajusta todas as camadas do modelo. A escolha da abordagem correta depende de seus requisitos específicos e do conjunto de dados.

Como o ajuste fino supervisionado difere do RLHF?

O ajuste fino supervisionado concentra-se em modelos de treinamento com dados rotulados para tarefas específicas, enquanto o RLHF aproveita o feedback humano para melhorar o desempenho do modelo ao longo do tempo. Esta distinção destaca as diferentes abordagens para melhorar as capacidades de IA.

Quais são as melhores práticas para modelos de ajuste fino?

Para afinar eficazmente os modelos, concentre-se na preparação minuciosa dos dados, escolha um modelo pré-treinado adequado e ajuste cuidadosamente os principais parâmetros enquanto valida e repete com base nas métricas de desempenho. Estes passos irão melhorar a precisão e a eficiência do seu modelo.

Quais são algumas aplicações do mundo real do ajuste fino?

O ajuste fino é aplicado com eficácia na análise de sentimentos, chatbots e resumo de texto, proporcionando maior precisão e relevância nesses campos. A utilização de modelos ajustados pode melhorar significativamente o desempenho das aplicações de IA na compreensão e geração de respostas semelhantes às humanas.

- Resumo rápido

- Ajuste fino: Técnicas e práticas recomendadas

- Introdução

- Entendendo o ajuste fino

- Principais abordagens para o ajuste fino

- Técnicas de ajuste fino

- Melhores práticas para o ajuste fino

- Aplicações do mundo real do ajuste fino

- Comparando o ajuste fino com outras técnicas

- Resumo

- Perguntas frequentes

Conteúdo

Comece grátis, escale facilmente

Experimente o banco de dados totalmente gerenciado, construído para seus aplicativos GenAI.

Experimente o Zilliz Cloud grátis