O que é a retropropagação?

O que é a retropropagação?

Backpropagation em redes neurais

Se tem andado por São Francisco ultimamente, vai reparar que há muitos veículos autónomos da Waymo e da Zoox não só a conduzir pelas ruas, mas também a recolher e a deixar passageiros durante todo o dia e toda a noite. Estes veículos respeitam educadamente as regras de trânsito, evitam qualquer contratempo com outros carros e conseguem navegar entre as multidões de pessoas durante as horas mais movimentadas do dia. Para quem não está habituado a esta visão, é espantoso ver estes exércitos de veículos a fazer o seu trabalho!

Carro autónomo em São Francisco

Carro autónomo em São Francisco

Um processo de aprendizagem automática chamado retropropagação permite a estes veículos navegar nestas situações complexas. Mas o que é exatamente a retropropagação e como permite um comportamento tão sofisticado?

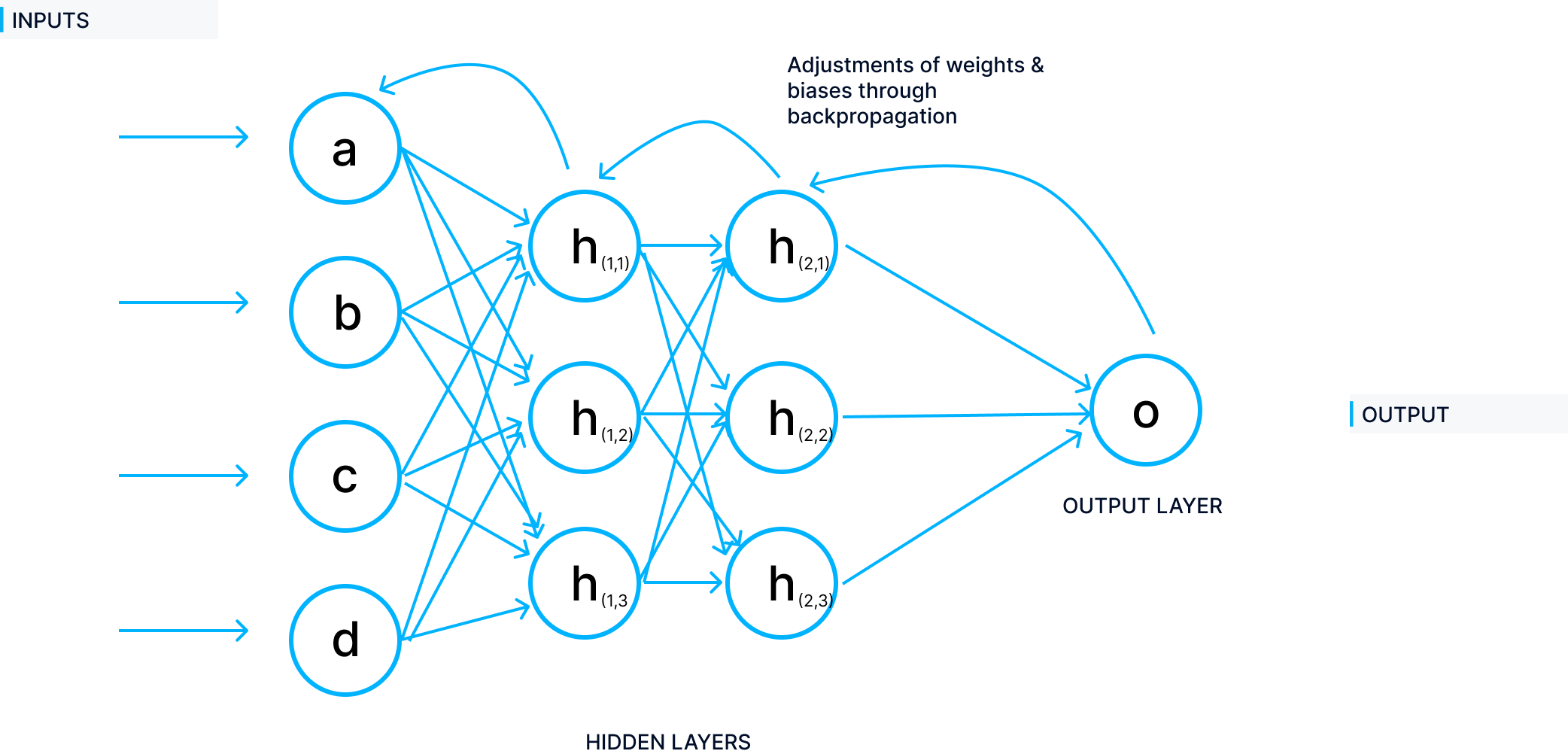

Na sua essência, a retropropagação é um mecanismo de aprendizagem altamente eficiente para redes neuronais artificiais, que se baseia fortemente na função de ativação para determinar a saída dos neurónios. Imagine um condutor principiante a aprender a navegar nas ruas da cidade. Pode começar por cometer erros - travar com demasiada força, virar demasiado bruscamente ou avaliar mal as distâncias. Com cada erro, ele ajusta as suas acções, melhorando gradualmente as suas capacidades. A retropropagação funciona de forma semelhante, mas à velocidade da luz e com precisão matemática.

Na aprendizagem automática, a retropropagação é o professor dos bastidores, que afina constantemente o processo de tomada de decisões dos sistemas de IA. Os dados de entrada fluem através das camadas do modelo de rede neural durante o processo de formação, afectando o desempenho e a eficiência dos processos de formação e de ajustamento de erros da rede neural. Esta técnica é o molho secreto por detrás de muitas aplicações de IA que encontramos diariamente - desde assistentes de voz que compreendem os nossos sotaques a sistemas de recomendação que parecem conhecer as nossas preferências melhor do que nós, tudo graças à camada de saída que gera as previsões do modelo.

Neste post, vamos desvendar as camadas ocultas do backpropagation, explorando como ele transforma dados brutos em decisões inteligentes. Iremos explicar a matemática sem nos perdermos em equações, apresentaremos um exemplo prático com o qual se pode identificar e até mostraremos como implementar esta poderosa técnica utilizando Python.

Quer seja um cientista de dados em início de carreira, um entusiasta tecnológico curioso ou simplesmente alguém fascinado pela revolução da IA que nos rodeia, a compreensão da retropropagação dar-lhe-á conhecimentos valiosos sobre a maquinaria da IA moderna. Portanto, vamos entrar no coração da aprendizagem automática, onde os números dançam com os neurónios para criar os sistemas inteligentes que moldam o nosso mundo.

O que é o algoritmo de retropropagação?

O backpropagation é um algoritmo de retropropagação crucial no treino de redes neurais feedforward, os cavalos de batalha de muitas aplicações de IA.

Pense no backpropagation como um treinador implacável com um talento especial para a melhoria orientada para os dados: Uma rede neural feedforward utiliza a retropropagação recorrente para ajustar os seus pesos e enviesamentos durante o treino, garantindo um desempenho ótimo.

Não se trata de um processo único, mas de um ciclo persistente de aperfeiçoamento. A cada rodada de treinamento (chamada de época), a retropropagação analisa o desempenho da rede e faz ajustes precisos. É como um treinador que analisa as imagens do jogo após cada jogada, ajustando as estratégias em tempo real.

O objetivo do algoritmo? Minimizar a "função de custo", reduzir a diferença entre as previsões da IA e a realidade. Para tal, afina os parâmetros internos da rede (pesos e enviesamentos), tal como um mecânico que ajusta os vários componentes de um motor para obter um desempenho ótimo.

A retropropagação emprega técnicas de otimização sofisticadas, normalmente a descida de gradiente ou a sua prima próxima, a descida de gradiente estocástica. Esses métodos ajudam a rede a navegar no complexo cenário de soluções possíveis, sempre em direção a um melhor desempenho.

Na sua essência, o backpropagation utiliza um princípio fundamental do cálculo: a regra da cadeia. Essa ferramenta matemática permite que o algoritmo percorra as intrincadas camadas da rede neural, determinando como cada componente contribui para o erro geral. É como seguir o rasto de um rio até à sua nascente, compreendendo como cada afluente afecta o fluxo principal.

Ao combinar aprendizagem iterativa, otimização inteligente e precisão matemática, a retropropagação transforma as redes neuronais de estruturas estáticas em sistemas dinâmicos e auto-aperfeiçoados. Não se trata apenas de fazer previsões; trata-se de evoluir constantemente para fazer melhores previsões, ultrapassando os limites do que a inteligência artificial pode alcançar.

Backpropagation of neural networks

Backpropagation of neural networks

Algoritmos de retropropagação

Matematicamente, a retropropagação é uma dança sofisticada de cálculo e otimização. Na sua essência, trata-se de compreender como as alterações nos parâmetros de uma rede neural afectam o seu desempenho global. O processo começa com uma função de perda, que quantifica a diferença entre as previsões da rede e os resultados reais. Esta função actua como uma bússola, orientando a rede para um melhor desempenho. O processo de feedforward empurra os dados através da rede, com cada neurónio a aplicar pesos e enviesamentos antes de passar o resultado através de uma função de ativação.

É aqui que o cálculo assume o papel central: a retropropagação calcula derivadas parciais para determinar como cada peso e tendência contribui para o erro geral. A regra da cadeia, um princípio fundamental do cálculo, permite que estas derivadas sejam calculadas de forma eficiente em várias camadas, calculando o gradiente. A taxa de aprendizagem, um hiperparâmetro crucial, controla a rapidez com que a rede ajusta seus parâmetros em resposta a esses cálculos. Se for demasiado elevada, a rede pode ultrapassar a sua configuração óptima; se for demasiado baixa, a aprendizagem torna-se dolorosamente lenta. Todo esse processo é iterativo, com cada época (uma passagem completa pelos dados de treinamento) refinando os parâmetros da rede. Ao longo do tempo, esta maquinaria matemática conduz a rede para uma configuração que minimiza a função de perda, ensinando efetivamente a IA a fazer previsões cada vez mais precisas.

Entendendo o algoritmo de retropropagação

A retropropagação opera em duas fases principais:

1. Forward Pass:

Os dados de entrada entram na rede através da camada de entrada.

Cada neurónio nas camadas subsequentes calcula uma soma ponderada das suas entradas, adiciona uma polarização e aplica uma função de ativação.

As informações fluem pela rede, com a saída de cada camada se tornando a entrada da camada seguinte.

A camada final produz a previsão da rede.

2. Passagem para trás:

A rede calcula o erro entre sua previsão e o alvo real.

Este sinal de erro propaga-se para trás através da rede.

Para cada neurónio, o algoritmo calcula como o erro se alteraria com pequenos ajustes nos pesos e nas polarizações.

Esses cálculos usam a regra da cadeia para determinar o gradiente do erro em relação a cada parâmetro.

Os pesos e as polarizações são ajustados para reduzir o erro.

**Componentes principais

- Funções de ativação: Introduzem a não-linearidade, permitindo que a rede aprenda padrões complexos. As escolhas comuns incluem ReLU para camadas ocultas e softmax para saídas de classificação.

- Função de perda: Mede a diferença entre as previsões e os valores reais. O erro quadrático médio é frequentemente utilizado para regressão, enquanto a entropia cruzada é comum para classificação.

- Taxa de aprendizagem: Determina o tamanho das atualizações de peso. Requer um ajuste cuidadoso para equilibrar a velocidade e a estabilidade da aprendizagem.

- Regra da cadeia: Permite o cálculo eficiente do gradiente em várias camadas, ajudando a rede a atribuir o erro final a cada um dos seus parâmetros.

A eficácia da retropropagação resulta da sua capacidade de ajustar vários parâmetros em simultâneo, melhorando gradualmente as previsões da rede ao longo de várias iterações.

Backpropagation

Backpropagation

Um exemplo de backpropagation na prática

Vamos dar vida ao backpropagation com um exemplo prático. Imagine que estamos todos a treinar redes neurais com uma IA simples para prever os preços das casas num bairro movimentado da cidade. A nossa rede neural é como um agente imobiliário novato que está a aprender as regras da avaliação de propriedades.

Começamos com uma arquitetura de rede básica:

Uma camada de entrada (pense nela como os olhos e ouvidos do agente).

Uma camada oculta (o cérebro do agente).

Uma camada de saída (a estimativa do preço final).

O nosso conjunto de dados é uma coleção de vendas recentes de casas com caraterísticas como a metragem quadrada, o número de quartos e a localização.

Na passagem para a frente e para trás, o nosso agente de IA olha para uma casa (introduz as caraterísticas). Faz suposições iniciais sobre a importância de cada caraterística (aplica pesos) e acrescenta alguns palpites pessoais (enviesamentos). Após alguns cálculos internos (funções de ativação), é produzida uma previsão de preço.

Agora vem a verificação da realidade. Utilizando uma função de perda, comparamos o erro quadrático da previsão da IA com o preço de venda real. Digamos que o nosso agente sobrestimou o preço em $50.000 - é um grande erro!

É aqui que entra em ação a retropropagação. É como o mentor do agente, ajudando a determinar por que a previsão estava errada. Trabalhando para trás, calcula quanto cada parte do processo de tomada de decisão contribuiu para o erro.

Com base nesta análise, actualizamos os pesos e os enviesamentos. Talvez o nosso agente estivesse a dar demasiada importância ao número de quartos e pouca à localização. Fazemos pequenos ajustes para corrigir isso.

Este processo repete-se para muitas casas (iterações). O nosso agente de IA torna-se um pouco mais inteligente com cada previsão e correção. Com o tempo, as suas previsões começam a aproximar-se dos preços de venda reais.

No final do treino, a nossa IA transformou-se de um novato num avaliador de imóveis experiente, capaz de fazer previsões de preços exactas com base nas caraterísticas de uma casa. É a retropropagação em ação - transformando dados em bruto em informações valiosas através da aprendizagem e do aperfeiçoamento contínuos.

A Perda de entropia cruzada* é utilizada para treinar modelos de classificação. É uma função de perda fácil de implementar que requer rótulos codificados em valores numéricos para um cálculo preciso da perda.

Vantagens da retropropagação em redes neurais

A retropropagação tornou-se um algoritmo fundamental no treinamento de redes neurais devido a várias vantagens importantes:

Acessibilidade: O algoritmo não requer grandes conhecimentos matemáticos, o que o torna acessível para os recém-chegados à aprendizagem automática. A sua implementação simples permite uma depuração e modificação mais fáceis.

Versatilidade: A retropropagação adapta-se bem a várias arquitecturas de rede e domínios problemáticos. Pode ser aplicada eficazmente em redes feedforward, redes neurais convolucionais e redes neurais recorrentes.

Aprendizagem eficiente: Ao calcular diretamente os gradientes de erro, a retropropagação permite ajustes rápidos dos pesos. Esta eficiência é particularmente valiosa em redes profundas, onde a aprendizagem de caraterísticas complexas pode ser demorada.

Capacidade de generalização: Através de actualizações de peso iterativas, a retropropagação ajuda as redes a identificar padrões subjacentes nos dados. Isso leva a modelos que podem fazer previsões precisas em exemplos novos e não vistos.

Escalabilidade: O algoritmo tem um bom desempenho em diferentes tamanhos de conjuntos de dados e complexidades de rede. Esta escalabilidade torna-o adequado tanto para pequenas experiências como para aplicações industriais em grande escala.

Estas vantagens contribuíram para a adoção generalizada do backpropagation no treino de redes neuronais. O seu equilíbrio entre simplicidade e eficácia torna-o uma ferramenta valiosa para o desenvolvimento de modelos de aprendizagem automática em várias aplicações.

Implementação do backpropagation em Python

Há uma série de projetos legais em python para ajudá-lo a experimentar o backpropagation por conta própria.

Implementando retropropagação em Python: Construindo uma rede neural a partir do zero - Andres Berejnoi

- [Blog](https://medium.com/@andresberejnoi/how-to-implement-backpropagation-with-numpy-andres-berejnoi-e7c14f2e683a#id_token=eyJhbGciOiJSUzI1NiIsImtpZCI6IjQ1MjljNDA5Zjc3YTEwNmZiNjdlZTFhODVkMTY4ZmQyY2ZiN2MwYjciLCJ0eXAiOiJKV1QifQ.eyJpc3MiOiJodHRwczovL2FjY291bnRzLmdvb2dsZS5jb20iLCJhenAiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJhdWQiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJzdWIiOiIxMTYzNTE3ODI0NjM1NzcyOTgwMDIiLCJlbWFpbCI6ImNocmlzLmNodXJpbG9AZ21haWwuY29tIiwiZW1haWxfdmVyaWZpZWQiOnRydWUsIm5iZiI6MTcyMzE4MTkzNiwibmFtZSI6IkNocmlzIENodXJpbG8iLCJwaWN0dXJlIjoiaHR0cHM6Ly9saDMuZ29vZ2xldXNlcmNvbnRlbnQuY29tL2EvQUNnOG9jSTYxYU12cG9ITVdSM2NZeXdMOXcxTXZkM2ZORjY3TlB3RkduQkNvcUtUN0gtd3F2d0M9czk2LWMiLCJnaXZlbl9uYW1lIjoiQ2hyaXMiLCJmYW1pbHlfbmFtZSI6IkNodXJpbG8iLCJpYXQiOjE3MjMxODIyMzYsImV4cCI6MTcyMzE4NTgzNiwianRpIjoiMTc1MmFhNjg2MjBkYmE5YzQ4MGExNWU4MDYwZjg3ZGU4M2UxZDBjMiJ9.TsKPdiNBLBFCdEek6Nc-i5yLVkArKch2P1oXJDRsyD

Como codificar uma rede neural com retropropagação em Python (do zero)](https://machinelearningmastery.com/implement-backpropagation-algorithm-scratch-python/)

Aplicações de retropropagação

A influência da retropropagação estende-se muito para além da aprendizagem teórica de máquinas, alimentando uma multiplicidade de aplicações de IA que se tornaram parte integrante da nossa vida quotidiana. Algumas dessas aplicações incluem:

Veículos autónomos: Como mencionado anteriormente com Waymo e Zoox, os carros autónomos dependem fortemente de redes neurais para interpretar dados de sensores, prever padrões de tráfego e tomar decisões em fracções de segundo. A retropropagação permite que esses veículos aprendam com cada viagem, melhorando continuamente seus protocolos de navegação e segurança.

Diagnóstico médico: Os sistemas de IA estão a ajudar cada vez mais os profissionais de saúde a interpretar imagens médicas, como radiografias, ressonâncias magnéticas e tomografias computorizadas. A retropropagação permite que estes sistemas aprendam com vastas bases de dados de imagens médicas, detectando frequentemente anomalias subtis que podem escapar ao olho humano.

[Processamento de linguagem natural] (https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models): Para além dos assistentes de voz, a retropropagação potencia os serviços de tradução automática, as ferramentas de análise de sentimentos e os chatbots. Estas aplicações podem compreender o contexto, as nuances e até o sarcasmo no texto escrito, ultrapassando as barreiras linguísticas e melhorando a comunicação.

Sistemas de recomendação: Os serviços de streaming, como o Netflix e o Spotify, utilizam redes neuronais para analisar os seus hábitos de visualização ou audição e sugerir conteúdos de que poderá gostar. A retropropagação ajuda estes sistemas a aprender com as interações dos utilizadores, aperfeiçoando continuamente as suas recomendações.

Robótica: Em ambientes de fabrico e investigação, os robôs utilizam redes neuronais para aprender tarefas complexas, desde operações de montagem precisas até à navegação em ambientes imprevisíveis. A retropropagação permite que estes robots aperfeiçoem os seus movimentos e processos de decisão ao longo do tempo.

Estas aplicações representam apenas uma fração do impacto da retropropagação. À medida que a IA continua a evoluir, este algoritmo permanece no centro das inovações que estão a remodelar as indústrias, a fazer avançar a investigação científica e a transformar a nossa interação com a tecnologia.

*Esta publicação aborda os [fundamentos do processamento de linguagem natural] (https://zilliz.com/learn/introduction-to-natural-language-processing-tokens-ngrams-bag-of-words-models) que são essenciais para compreender todos os modelos de linguagem actuais.

Desafios e considerações:

Embora o backpropagation tenha revolucionado o aprendizado de máquina, ele não está isento de desafios e considerações. Vamos explorar algumas das principais questões com que investigadores e profissionais se debatem:

Problema do gradiente em declínio: Nas redes neurais profundas, os gradientes podem tornar-se extremamente pequenos à medida que se propagam pelas camadas. Isto pode levar a uma aprendizagem dolorosamente lenta ou mesmo a uma paragem completa no treino das camadas anteriores. É como tentar sussurrar uma mensagem através de uma longa cadeia de pessoas - quando se chega ao fim, a mensagem pode estar perdida.

Problema do Gradiente em Expansão: O outro lado dos gradientes que desaparecem, ocorre quando os gradientes se tornam extremamente grandes, causando actualizações instáveis nos pesos da rede. É como se uma pequena mudança na entrada causasse uma mudança desproporcionalmente grande na saída, tornando a rede não confiável.

Armadilhas de mínimos locais: O objetivo da retropropagação é encontrar o mínimo global da função de perda, mas pode ficar preso em mínimos locais, conduzindo a soluções subóptimas. Imagine tentar encontrar o ponto mais baixo de uma paisagem montanhosa com os olhos vendados - pode pensar que chegou ao fundo quando, na verdade, está apenas num pequeno mergulho.

Intensidade computacional: O treino de grandes redes neuronais com retropropagação pode ser extremamente dispendioso do ponto de vista computacional, exigindo tempo e recursos significativos. Este facto pode limitar a acessibilidade da aprendizagem profunda às pessoas com acesso a hardware potente.

Overfitting: Com a sua capacidade de aprender padrões complexos, uma rede que utiliza a retropropagação pode, por vezes, aprender demasiado bem o ruído nos dados de treino, levando a uma fraca generalização em novos dados. É como memorizar as respostas de um teste em vez de compreender os princípios subjacentes.

**Escolha da taxa de aprendizagem correta, do tamanho do lote e da arquitetura da rede pode ser mais arte do que ciência, exigindo frequentemente uma experimentação extensiva. É um equilíbrio delicado - demasiado agressivo, e o modelo pode nunca convergir; demasiado conservador, e o treino pode demorar muito tempo.

Funções de ativação não diferenciáveis: A retropropagação depende do cálculo de gradientes, o que se torna problemático com funções de ativação não diferenciáveis, como a função de passo. Isto limita os tipos de arquitecturas neurais que podem ser facilmente treinadas.

Esquecimento catastrófico: Ao treinar com novos dados, as redes neurais podem esquecer rapidamente as informações aprendidas anteriormente. Isto é particularmente difícil em cenários que exigem uma aprendizagem contínua.

Problemas de interpretabilidade: A natureza complexa das redes neuronais profundas torna difícil interpretar a razão pela qual uma rede tomou uma determinada decisão. Esta natureza de "caixa negra" pode ser problemática em aplicações que exigem transparência, como os cuidados de saúde ou as finanças.

Dependência de dados: A eficácia da retropropagação depende muito da qualidade e da quantidade de dados de treinamento. Em cenários com dados limitados ou enviesados, o algoritmo pode ter dificuldade em aprender eficazmente ou pode perpetuar os enviesamentos existentes.

A resolução destes desafios é uma área de investigação ativa na comunidade de aprendizagem automática. Técnicas como a [normalização em lote] (https://zilliz.com/learn/layer-vs-batch-normalization-unlocking-efficiency-in-neural-networks), ligações residuais e taxas de aprendizagem adaptativas foram desenvolvidas para mitigar alguns destes problemas. À medida que o campo progride, as inovações continuam a alargar os limites do que é possível com a retropropagação e as redes neuronais.

Implicações futuras:

À medida que olhamos para o futuro da IA, a retropropagação encontra-se numa encruzilhada fascinante. Embora continue a ser a pedra angular da aprendizagem profunda, as tendências emergentes sugerem um cenário de evolução e revolução. Aqui está um vislumbre do que o futuro pode reservar:

Backpropagação quântica: Com o aumento da computação quântica, os investigadores estão a explorar versões quânticas da retropropagação. Estas poderiam potencialmente resolver problemas de otimização exponencialmente mais rápidos do que os métodos clássicos, abrindo portas ao treino de redes muito mais complexas.

Computação neuromórfica: À medida que o hardware de IA evolui para imitar mais de perto os cérebros biológicos, podemos ver novas formas de retropropagação que são mais eficientes em termos energéticos e capazes de aprendizagem em tempo real, semelhante à forma como os nossos cérebros se adaptam continuamente.

Aprendizagem federada: Os futuros algoritmos de retropropagação poderão permitir uma IA com melhor preservação da privacidade, permitindo que os modelos aprendam a partir de conjuntos de dados distribuídos sem centralizar informações sensíveis. Isto poderá revolucionar áreas como a IA nos cuidados de saúde, onde a privacidade dos dados é fundamental.

IA explicável: À medida que a procura de transparência na IA aumenta, podemos ver novas técnicas de retropropagação que não só optimizam o desempenho, como também fornecem informações mais claras sobre o processo de tomada de decisões das redes neuronais.

Meta-aprendizagem: A retropropagação futura poderá não só otimizar os parâmetros do modelo, mas também aprender a aprender. Isto poderá conduzir a sistemas de IA que se adaptem a novas tarefas com um treino mínimo, semelhante à intuição humana.

Sistemas de aprendizagem contínua: Os avanços na retropropagação poderão resolver o desafio do esquecimento catastrófico, conduzindo a sistemas de IA que aprendem continuamente ao longo do seu tempo de vida operacional, melhorando constantemente sem perder conhecimentos previamente adquiridos.

Abordagens de aprendizagem híbridas: Poderemos assistir à combinação da retropropagação com outros paradigmas de aprendizagem, como a aprendizagem por reforço ou os algoritmos evolutivos, criando sistemas de IA mais robustos e versáteis.

Inteligência emocional e social: As futuras técnicas de retropropagação poderão ajudar os sistemas de IA a compreender melhor e a reagir às emoções humanas, conduzindo potencialmente a assistentes de IA mais empáticos e socialmente inteligentes.

Adaptação ao ambiente: Dado que os sistemas de IA são utilizados em ambientes diversos e imprevisíveis, novas formas de retropropagação poderão permitir uma adaptação rápida a condições variáveis, crucial para aplicações como robôs de resposta a catástrofes ou sistemas de monitorização do clima.

Formação ética em IA: Os futuros algoritmos de retropropagação poderão incorporar considerações éticas diretamente no processo de aprendizagem, ajudando a criar sistemas de IA que não sejam apenas inteligentes, mas também alinhados com os valores humanos e as normas sociais.

Estes potenciais avanços sugerem um futuro em que a retropropagação evolui para além da sua forma atual, continuando a impulsionar a inovação da IA de formas que só agora começamos a imaginar. Como acontece com todas as previsões tecnológicas, algumas delas podem concretizar-se, enquanto outras dão lugar a desenvolvimentos totalmente imprevistos. O que é certo é que os princípios subjacentes à retropropagação continuarão a moldar a trajetória da IA nos próximos anos.

Relevância Interdisciplinar com Bases de Dados Vectoriais:

A influência da retropropagação estende-se a várias disciplinas, com [bases de dados vectoriais] (https://zilliz.com/learn/what-is-vetor-database) a desempenhar um papel de apoio crucial:

Neurociência Cognitiva: Simulação de processos neuronais para compreender a cognição humana.

Linguística computacional: Revolucionar o processamento e a geração de linguagem.

Visão computacional: Melhorar a interpretação de imagens para imagiologia médica e veículos autónomos.

Bioinformática: Previsão das estruturas proteicas e das funções dos genes.

Finanças: Potencializar modelos preditivos para tendências de mercado e avaliação de riscos.

Robótica: Ajudar os robots a adaptarem-se a novos ambientes.

Ciência dos materiais: Prever as propriedades dos materiais e conceber novos compostos.

Ciências climáticas: Criar modelos climáticos complexos e analisar padrões climáticos.

Sistemas de Recomendação: Refinando as preferências dos utilizadores para a entrega de conteúdos personalizados.

Cibersegurança: Deteção de anomalias e potenciais ameaças no tráfego da rede.

As bases de dados vectoriais melhoram estas aplicações, armazenando e recuperando eficazmente dados de elevada dimensão, cruciais para as redes neuronais treinadas por retropropagação. Esta sinergia permite uma formação mais rápida, uma inferência mais eficiente e a capacidade de trabalhar com conjuntos de dados maiores e mais complexos.

À medida que a IA e a aprendizagem automática continuam a evoluir, as aplicações interdisciplinares da retropropagação, apoiadas por bases de dados vectoriais, prometem desbloquear novas fronteiras numa gama crescente de domínios, desde a computação quântica até aos sistemas criativos de IA.

- Backpropagation em redes neurais

- O que é o algoritmo de retropropagação?

- Algoritmos de retropropagação

- Entendendo o algoritmo de retropropagação

- Um exemplo de backpropagation na prática

- Vantagens da retropropagação em redes neurais

- Implementação do backpropagation em Python

- Aplicações de retropropagação

- Desafios e considerações:

- Implicações futuras:

- Relevância Interdisciplinar com Bases de Dados Vectoriais:

Conteúdo

Comece grátis, escale facilmente

Experimente o banco de dados totalmente gerenciado, construído para seus aplicativos GenAI.

Experimente o Zilliz Cloud grátis