Che cos'è la retropropagazione?

Che cos'è la retropropagazione?

La retropropagazione nelle reti neurali

Se avete fatto un giro a San Francisco di recente, noterete che ci sono molti veicoli autonomi di Waymo e Zoox che non solo percorrono le strade, ma raccolgono e scaricano passeggeri per tutto il giorno e la notte. Questi veicoli osservano educatamente le regole del traffico, evitano qualsiasi incidente con altre auto e riescono a destreggiarsi tra la folla di persone nei momenti più affollati della giornata. Per chi non è abituato a questo spettacolo, è sorprendente vedere questi eserciti di veicoli che fanno il loro lavoro!

Auto autonome a San Francisco

Auto autonome a San Francisco

Un processo di apprendimento automatico chiamato backpropagation permette a questi veicoli di navigare in queste situazioni complesse. Ma cos'è esattamente la retropropagazione e come fa a consentire un comportamento così sofisticato?

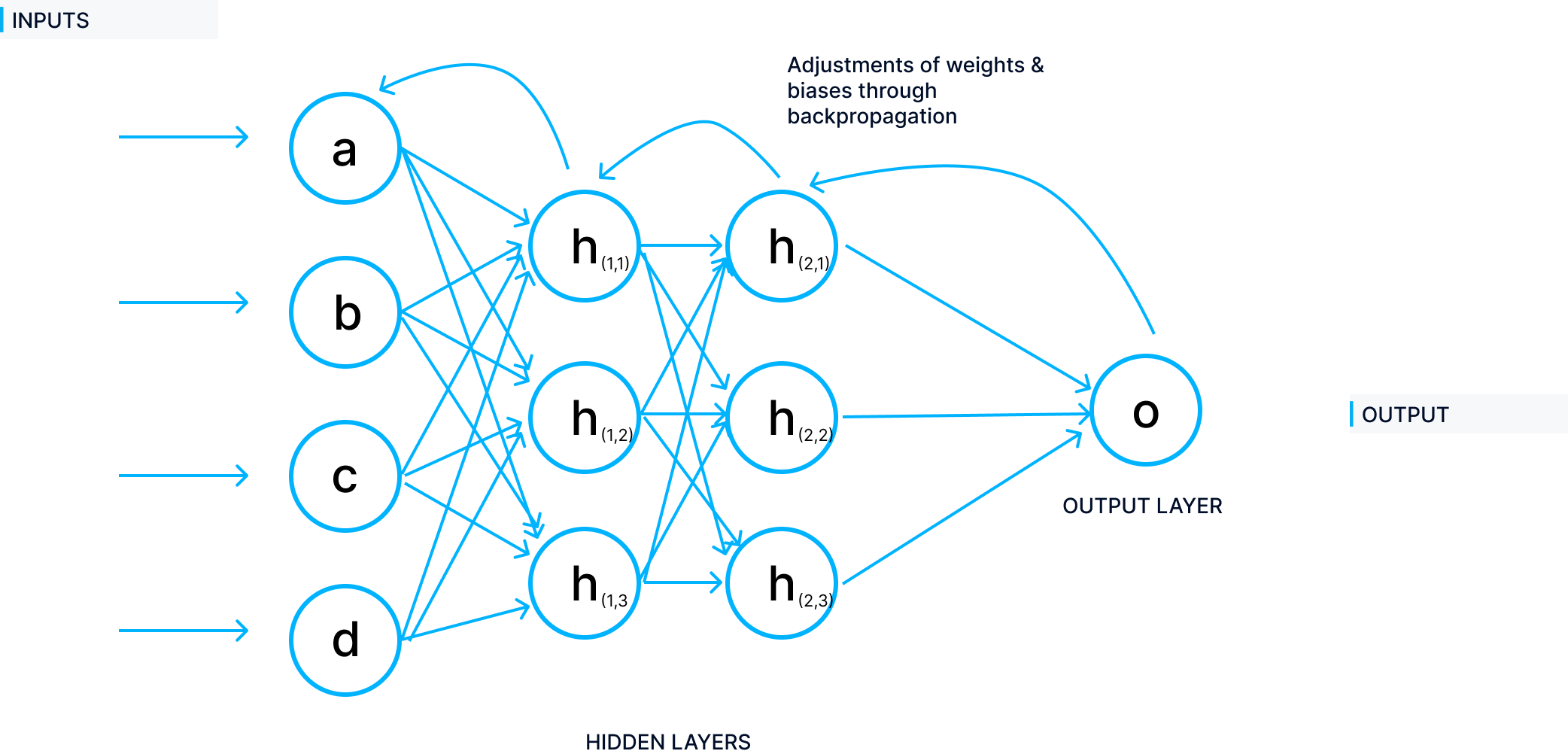

In sostanza, la retropropagazione è un meccanismo di apprendimento altamente efficiente per le reti neurali artificiali, che si basa fortemente sulla funzione di attivazione per determinare l'uscita dei neuroni. Immaginate un automobilista alle prime armi che impara a navigare per le strade della città. All'inizio potrebbe commettere degli errori: frenare troppo forte, svoltare troppo bruscamente o valutare male le distanze. Ad ogni errore, l'automobilista adatta le proprie azioni, migliorando gradualmente le proprie capacità. La retropropagazione funziona in modo simile, ma alla velocità della luce e con precisione matematica.

Nell'apprendimento automatico, la retropropagazione è l'insegnante dietro le quinte, che perfeziona costantemente il processo decisionale dei sistemi di intelligenza artificiale. I dati in ingresso scorrono attraverso gli strati del modello di rete neurale durante il processo di addestramento, influenzando le prestazioni e l'efficienza dei processi di addestramento e di regolazione degli errori della rete neurale. Questa tecnica non si limita alle auto a guida autonoma, ma è il segreto di molte applicazioni di IA che incontriamo quotidianamente, dagli assistenti vocali che capiscono il nostro accento ai sistemi di raccomandazione che sembrano conoscere le nostre preferenze meglio di noi, grazie allo strato di uscita che genera le previsioni del modello.

In questo post, scopriremo gli strati nascosti della backpropagation, esplorando come trasforma i dati grezzi in decisioni intelligenti. Illustreremo la matematica senza perderci in equazioni, illustreremo un esempio pratico a cui potrete fare riferimento e vi mostreremo anche come implementare questa potente tecnica utilizzando Python.

Che siate scienziati dei dati in erba, curiosi appassionati di tecnologia o semplicemente affascinati dalla rivoluzione dell'intelligenza artificiale che ci circonda, la comprensione della retropropagazione vi fornirà preziose informazioni sui meccanismi dell'intelligenza artificiale moderna. Entriamo quindi nel cuore dell'apprendimento automatico, dove i numeri danzano con i neuroni per creare i sistemi intelligenti che danno forma al nostro mondo.

Che cos'è l'algoritmo di retropropagazione?

L'algoritmo di backpropagation è un algoritmo fondamentale per l'addestramento delle reti neurali feedforward, il cavallo di battaglia di molte applicazioni di IA.

Pensate alla backpropagation come a un allenatore implacabile, capace di migliorare in base ai dati: Una rete neurale feedforward utilizza la backpropagation ricorrente per regolare i pesi e le polarizzazioni durante l'addestramento, garantendo prestazioni ottimali.

Non si tratta di un processo unico, ma di un ciclo persistente di perfezionamento. A ogni ciclo di addestramento (chiamato epoch), la retropropagazione analizza le prestazioni della rete e apporta modifiche precise. È come se un allenatore rivedesse i filmati della partita dopo ogni azione, modificando le strategie in tempo reale.

L'obiettivo dell'algoritmo? Minimizzare la "funzione di costo", ridurre il divario tra le previsioni dell'intelligenza artificiale e la realtà. Lo fa regolando con precisione i parametri interni della rete (pesi e bias), proprio come un meccanico che regola i vari componenti di un motore per ottenere prestazioni ottimali.

La retropropagazione impiega tecniche di ottimizzazione sofisticate, in genere la discesa del gradiente o la sua cugina stretta, la discesa del gradiente stocastica. Questi metodi aiutano la rete a navigare nel complesso panorama delle soluzioni possibili, puntando sempre verso prestazioni migliori.

Nel suo nucleo, la retropropagazione sfrutta un principio fondamentale del calcolo: la regola della catena. Questo strumento matematico consente all'algoritmo di attraversare gli intricati strati della rete neurale, determinando come ogni componente contribuisce all'errore complessivo. È come risalire un fiume fino alla sua sorgente, comprendendo come ogni affluente influisca sul flusso principale.

Combinando l'apprendimento iterativo, l'ottimizzazione intelligente e la precisione matematica, la retropropagazione trasforma le reti neurali da strutture statiche in sistemi dinamici e auto-miglioranti. Non si tratta solo di fare previsioni; si tratta di evolvere costantemente per fare previsioni migliori, spingendo i confini di ciò che l'intelligenza artificiale può raggiungere.

Retropropagazione delle reti neurali

Retropropagazione delle reti neurali

Algoritmi di retropropagazione

Dal punto di vista matematico, la retropropagazione è una danza sofisticata di calcolo e ottimizzazione. In sostanza, si tratta di capire come le variazioni dei parametri di una rete neurale influiscano sulle sue prestazioni complessive. Il processo inizia con una funzione di perdita, che quantifica la differenza tra le previsioni della rete e i risultati effettivi. Questa funzione agisce come una bussola, guidando la rete verso prestazioni migliori. Il processo feedforward spinge i dati attraverso la rete, con ogni neurone che applica pesi e bias prima di passare il risultato attraverso una funzione di attivazione.

È qui che il calcolo diventa protagonista: la retropropagazione calcola le derivate parziali per determinare come ogni peso e bias contribuisca all'errore complessivo. La regola della catena, un principio fondamentale del calcolo, consente di calcolare in modo efficiente queste derivate su più livelli, calcolando il gradiente. Il tasso di apprendimento, un iperparametro cruciale, controlla la velocità con cui la rete regola i suoi parametri in risposta a questi calcoli. Se è troppo alta, la rete potrebbe superare la sua configurazione ottimale; se è troppo bassa, l'apprendimento diventa dolorosamente lento. L'intero processo è iterativo: ogni epoca (un passaggio completo dei dati di addestramento) affina i parametri della rete. Nel corso del tempo, questo meccanismo matematico spinge la rete verso una configurazione che minimizza la funzione di perdita, insegnando di fatto all'intelligenza artificiale a fare previsioni sempre più accurate.

Comprendere l'algoritmo di backpropagation

La retropropagazione opera in due fasi principali:

1. Passaggio in avanti:

I dati in ingresso entrano nella rete attraverso lo strato di ingresso.

Ogni neurone degli strati successivi calcola una somma ponderata dei suoi ingressi, aggiunge un bias e applica una funzione di attivazione.

Le informazioni fluiscono attraverso la rete e l'output di ogni strato diventa l'input dello strato successivo.

Lo strato finale produce la previsione della rete.

2. Passaggio all'indietro:

La rete calcola l'errore tra la sua previsione e l'obiettivo reale.

Questo segnale di errore si propaga all'indietro attraverso la rete.

Per ogni neurone, l'algoritmo calcola come cambierebbe l'errore con piccoli aggiustamenti dei pesi e delle polarizzazioni.

Questi calcoli utilizzano la regola della catena per determinare il gradiente dell'errore rispetto a ciascun parametro.

I pesi e le polarizzazioni vengono regolati per ridurre l'errore.

**Componenti chiave

- Funzioni di attivazione: Introducono la non linearità, consentendo alla rete di apprendere modelli complessi. Le scelte più comuni includono ReLU per gli strati nascosti e softmax per le uscite di classificazione.

- Funzione di perdita: Misura la differenza tra le previsioni e i valori reali. L'errore quadratico medio è spesso usato per la regressione, mentre l'entropia incrociata è comune per la classificazione.

- Tasso di apprendimento: Determina la dimensione degli aggiornamenti dei pesi. Richiede un'attenta regolazione per bilanciare la velocità di apprendimento e la stabilità.

- Regola della catena: Consente un calcolo efficiente del gradiente su più livelli, aiutando la rete ad attribuire l'errore finale a ciascuno dei suoi parametri.

L'efficacia della retropropagazione deriva dalla sua capacità di regolare numerosi parametri contemporaneamente, migliorando gradualmente le previsioni della rete nel corso di più iterazioni.

Retropropagazione

Retropropagazione

Un esempio di backpropagation nella pratica

Diamo vita alla backpropagation con un esempio pratico. Immaginiamo di addestrare reti neurali con una semplice IA per prevedere i prezzi delle case in un vivace quartiere cittadino. La nostra rete neurale è come un agente immobiliare alle prime armi che sta imparando a valutare gli immobili.

Partiamo da un'architettura di rete di base:

Uno strato di input (consideratelo come gli occhi e le orecchie dell'agente).

Uno strato nascosto (il cervello dell'agente).

Un livello di output (la stima del prezzo finale).

Il nostro set di dati è una raccolta di vendite recenti di case con caratteristiche quali metratura, numero di camere da letto e posizione.

Nel passaggio in avanti e all'indietro, il nostro agente AI osserva una casa (inserisce le caratteristiche). Fa delle ipotesi iniziali sull'importanza di ciascuna caratteristica (applica i pesi) e aggiunge alcune intuizioni personali (pregiudizi). Dopo alcuni calcoli interni (funzioni di attivazione), viene prodotta una previsione del prezzo.

Ora arriva la verifica della realtà. Utilizzando una funzione di perdita, confrontiamo l'errore quadratico della previsione dell'IA con il prezzo di vendita effettivo. Supponiamo che il nostro agente abbia sovrastimato il prezzo di 50.000 dollari: è un grosso errore!

È qui che entra in gioco la retropropagazione. È come il mentore dell'agente, che aiuta a determinare perché la previsione era sbagliata. Lavorando a ritroso, calcola quanto ogni parte del processo decisionale ha contribuito all'errore.

Sulla base di questa analisi, si aggiornano i pesi e i bias. Forse il nostro agente ha dato troppa importanza al numero di camere da letto e poca alla posizione. Apportiamo piccoli aggiustamenti per correggere il problema.

Questo processo si ripete per molte case (iterazioni). Il nostro agente AI diventa un po' più intelligente a ogni previsione e correzione. Con il tempo, le sue previsioni iniziano ad avvicinarsi ai prezzi di vendita effettivi.

Alla fine dell'addestramento, la nostra IA si è trasformata da principiante in un esperto valutatore di immobili, in grado di fare previsioni accurate sul prezzo in base alle caratteristiche di una casa. Questo è il backpropagation in azione: trasformare i dati grezzi in intuizioni preziose attraverso l'apprendimento e l'affinamento continui.

La perdita di entropia incrociata* viene utilizzata per addestrare i modelli di classificazione. È una funzione di perdita facile da implementare che richiede etichette codificate in valori numerici per un calcolo accurato della perdita*.

Vantaggi della retropropagazione nelle reti neurali

La retropropagazione è diventata un algoritmo fondamentale per l'addestramento delle reti neurali grazie a diversi vantaggi chiave:

Accessibilità: L'algoritmo non richiede un'ampia preparazione matematica, rendendolo accessibile ai neofiti dell'apprendimento automatico. La sua implementazione semplice consente di facilitare il debug e la modifica.

Versatilità: La retropropagazione si adatta bene a diverse architetture di rete e domini problematici. Può essere applicata efficacemente in reti feedforward, reti neurali convoluzionali e reti neurali ricorrenti.

Apprendimento efficiente: Calcolando direttamente i gradienti dell'errore, la retropropagazione consente di regolare rapidamente i pesi. Questa efficienza è particolarmente preziosa nelle reti profonde, dove l'apprendimento di caratteristiche complesse può richiedere molto tempo.

Capacità di generalizzazione: Grazie agli aggiornamenti iterativi dei pesi, la retropropagazione aiuta le reti a identificare i modelli sottostanti nei dati. Questo porta a modelli in grado di fare previsioni accurate su nuovi esempi non visti.

Scalabilità: L'algoritmo si comporta bene su set di dati di diverse dimensioni e complessità di rete. Questa scalabilità lo rende adatto sia a piccoli esperimenti che ad applicazioni industriali su larga scala.

Questi vantaggi hanno contribuito all'adozione diffusa della retropropagazione nell'addestramento delle reti neurali. Il suo equilibrio tra semplicità ed efficacia lo rende uno strumento prezioso per lo sviluppo di modelli di apprendimento automatico in diverse applicazioni.

Implementazione della retropropagazione in Python

Esiste una serie di progetti python molto interessanti che vi aiuteranno a provare la backpropagation da soli.

Implementazione della retropropagazione in Python: Costruire una rete neurale da zero - Andres Berejnoi

- [Blog](https://medium.com/@andresberejnoi/how-to-implement-backpropagation-with-numpy-andres-berejnoi-e7c14f2e683a#id_token=eyJhbGciOiJSUzI1NiIsImtpZCI6IjQ1MjljNDA5Zjc3YTEwNmZiNjdlZTFhODVkMTY4ZmQyY2ZiN2MwYjciLCJ0eXAiOiJKV1QifQ.eyJpc3MiOiJodHRwczovL2FjY291bnRzLmdvb2dsZS5jb20iLCJhenAiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJhdWQiOiIyMTYyOTYwMzU4MzQtazFrNnFlMDYwczJ0cDJhMmphbTRsamRjbXMwMHN0dGcuYXBwcy5nb29nbGV1c2VyY29udGVudC5jb20iLCJzdWIiOiIxMTYzNTE3ODI0NjM1NzcyOTgwMDIiLCJlbWFpbCI6ImNocmlzLmNodXJpbG9AZ21haWwuY29tIiwiZW1haWxfdmVyaWZpZWQiOnRydWUsIm5iZiI6MTcyMzE4MTkzNiwibmFtZSI6IkNocmlzIENodXJpbG8iLCJwaWN0dXJlIjoiaHR0cHM6Ly9saDMuZ29vZ2xldXNlcmNvbnRlbnQuY29tL2EvQUNnOG9jSTYxYU12cG9ITVdSM2NZeXdMOXcxTXZkM2ZORjY3TlB3RkduQkNvcUtUN0gtd3F2d0M9czk2LWMiLCJnaXZlbl9uYW1lIjoiQ2hyaXMiLCJmYW1pbHlfbmFtZSI6IkNodXJpbG8iLCJpYXQiOjE3MjMxODIyMzYsImV4cCI6MTcyMzE4NTgzNiwianRpIjoiMTc1MmFhNjg2MjBkYmE5YzQ4MGExNWU4MDYwZjg3ZGU4M2UxZDBjMiJ9.TsKPdiNBLBFCdEek6Nc-i5yLVkArKch2P1oXJDRsyD

Come codificare una rete neurale con backpropagation in Python (da zero)

Applicazioni della retropropagazione

L'influenza della backpropagation si estende ben oltre l'apprendimento automatico teorico, alimentando una moltitudine di applicazioni di intelligenza artificiale che sono diventate parte integrante della nostra vita quotidiana. Alcune di queste applicazioni includono:

Veicoli autonomi: Come già menzionato in precedenza con Waymo e Zoox, le auto a guida autonoma si affidano pesantemente alle reti neurali per interpretare i dati dei sensori, prevedere i modelli di traffico e prendere decisioni in una frazione di secondo. La backpropagation consente a questi veicoli di imparare da ogni viaggio, migliorando continuamente i loro protocolli di navigazione e sicurezza.

Diagnosi medica: I sistemi di intelligenza artificiale assistono sempre più spesso gli operatori sanitari nell'interpretazione di immagini mediche come radiografie, risonanze magnetiche e TAC. La retropropagazione consente a questi sistemi di imparare da vasti database di immagini mediche, spesso individuando sottili anomalie che potrebbero sfuggire all'occhio umano.

Elaborazione del linguaggio naturale: Oltre agli assistenti vocali, la backpropagation alimenta i servizi di traduzione automatica, gli strumenti di analisi del sentiment e i chatbot. Queste applicazioni sono in grado di comprendere il contesto, le sfumature e persino il sarcasmo del testo scritto, superando le barriere linguistiche e migliorando la comunicazione.

Sistemi di raccomandazione: I servizi di streaming come Netflix e Spotify utilizzano le reti neurali per analizzare le abitudini di visione o di ascolto e suggerire i contenuti che potrebbero piacere. La retropropagazione aiuta questi sistemi a imparare dalle interazioni degli utenti, affinando continuamente le loro raccomandazioni.

Robotica: Nella produzione e nella ricerca, i robot utilizzano le reti neurali per apprendere compiti complessi, da operazioni di assemblaggio precise alla navigazione in ambienti imprevedibili. La retropropagazione permette a questi robot di affinare i loro movimenti e i processi decisionali nel tempo.

Queste applicazioni rappresentano solo una parte dell'impatto della backpropagation. Con la continua evoluzione dell'IA, questo algoritmo rimane al centro di innovazioni che stanno rimodellando le industrie, facendo progredire la ricerca scientifica e trasformando la nostra interazione con la tecnologia.

*Questo post tratta i fondamenti dell'elaborazione del linguaggio naturale che sono essenziali per comprendere tutti i modelli linguistici odierni.

Sfide e considerazioni:

Sebbene la retropropagazione abbia rivoluzionato l'apprendimento automatico, non è priva di sfide e considerazioni. Esploriamo alcuni dei problemi principali con cui si confrontano ricercatori e professionisti:

Problema del gradiente che svanisce: Nelle reti neurali profonde, i gradienti possono diventare estremamente piccoli man mano che vengono propagati attraverso gli strati. Questo può portare a un apprendimento dolorosamente lento o addirittura a un arresto completo dell'addestramento per gli strati precedenti. È come cercare di sussurrare un messaggio attraverso una lunga catena di persone: quando arriva alla fine, il messaggio potrebbe essere perso.

Problema del gradiente che esplode: Il rovescio della medaglia dei gradienti che svaniscono, si verifica quando i gradienti diventano estremamente grandi, causando aggiornamenti instabili dei pesi della rete. È come se una piccola variazione dell'input causasse una variazione sproporzionata dell'output, rendendo la rete inaffidabile.

Trappole dei minimi locali: La retropropagazione mira a trovare il minimo globale della funzione di perdita, ma può bloccarsi nei minimi locali, portando a soluzioni non ottimali. Immaginate di cercare di trovare il punto più basso in un paesaggio collinare mentre siete bendati: potreste pensare di aver raggiunto il fondo quando in realtà siete solo in un piccolo avvallamento.

Intensità computazionale: L'addestramento di reti neurali di grandi dimensioni con la retropropagazione può essere estremamente costoso dal punto di vista computazionale, richiedendo tempo e risorse significative. Questo può limitare l'accessibilità del deep learning a coloro che hanno accesso a un hardware potente.

Overfitting: Grazie alla sua capacità di apprendere modelli complessi, una rete che utilizza la backpropagation può talvolta apprendere troppo bene il rumore presente nei dati di addestramento, portando a una scarsa generalizzazione su nuovi dati. È come memorizzare le risposte di un test invece di comprendere i principi sottostanti.

**La scelta del giusto tasso di apprendimento, della dimensione del batch e dell'architettura della rete può essere più un'arte che una scienza e spesso richiede un'ampia sperimentazione. Si tratta di un equilibrio delicato: se troppo aggressivo, il modello potrebbe non convergere mai; se troppo conservativo, l'addestramento potrebbe richiedere un tempo eccessivamente lungo.

Funzioni di attivazione non differenziabili: La retropropagazione si basa sul calcolo dei gradienti, che diventa problematico con funzioni di attivazione non differenziabili come la funzione passo. Questo limita i tipi di architetture neurali che possono essere facilmente addestrate.

Dimenticanza catastrofica: Quando si addestrano su nuovi dati, le reti neurali possono dimenticare rapidamente le informazioni apprese in precedenza. Questo è particolarmente impegnativo in scenari che richiedono un apprendimento continuo.

Problemi di interpretabilità: La natura complessa delle reti neurali profonde rende difficile interpretare il motivo per cui una rete ha preso una particolare decisione. Questa natura di "scatola nera" può essere problematica in applicazioni che richiedono trasparenza, come quelle sanitarie o finanziarie.

Dipendenza dai dati: L'efficacia della backpropagation dipende fortemente dalla qualità e dalla quantità dei dati di addestramento. In scenari con dati limitati o distorti, l'algoritmo potrebbe faticare ad apprendere efficacemente o potrebbe perpetuare i pregiudizi esistenti.

Affrontare queste sfide è un'area di ricerca attiva nella comunità dell'apprendimento automatico. Tecniche come la [batch normalization] (https://zilliz.com/learn/layer-vs-batch-normalization-unlocking-efficiency-in-neural-networks), le connessioni residue e i tassi di apprendimento adattivi sono stati sviluppati per mitigare alcuni di questi problemi. Con il progredire del settore, le innovazioni continuano a spingere i confini di ciò che è possibile fare con la retropropagazione e le reti neurali.

Implicazioni future:

Se guardiamo al futuro dell'intelligenza artificiale, la retropropagazione si trova a un crocevia affascinante. Pur rimanendo una pietra miliare del deep learning, le tendenze emergenti suggeriscono un panorama di evoluzione e rivoluzione. Ecco uno sguardo a ciò che il futuro potrebbe riservarci:

Backpropagation quantistica: Con l'aumento dell'informatica quantistica, i ricercatori stanno esplorando versioni quantistiche della retropropagazione. Queste potrebbero potenzialmente risolvere problemi di ottimizzazione in modo esponenzialmente più veloce rispetto ai metodi classici, aprendo le porte alla formazione di reti molto più complesse.

Computing neuromorfico: Man mano che l'hardware dell'intelligenza artificiale si evolve per imitare più da vicino i cervelli biologici, potremmo vedere nuove forme di retropropagazione più efficienti dal punto di vista energetico e in grado di apprendere in tempo reale, in modo simile a come il nostro cervello si adatta continuamente.

Apprendimento federato: I futuri algoritmi di backpropagation potrebbero consentire un'IA migliore e rispettosa della privacy, permettendo ai modelli di apprendere da insiemi di dati distribuiti senza centralizzare le informazioni sensibili. Questo potrebbe rivoluzionare settori come l'intelligenza artificiale in campo sanitario, dove la privacy dei dati è fondamentale.

Ina Spiegabile: Con l'aumento della domanda di trasparenza dell'IA, potremmo assistere a nuove tecniche di backpropagation che non solo ottimizzano le prestazioni, ma forniscono anche informazioni più chiare sul processo decisionale delle reti neurali.

Meta-apprendimento: In futuro la retropropagazione potrebbe non solo ottimizzare i parametri del modello, ma anche imparare ad apprendere. Questo potrebbe portare a sistemi di intelligenza artificiale che si adattano a nuovi compiti con un addestramento minimo, simile all'intuizione umana.

Sistemi ad apprendimento continuo: I progressi della retropropagazione potrebbero risolvere la sfida dell'oblio catastrofico, portando a sistemi di intelligenza artificiale che imparano continuamente durante la loro vita operativa, migliorando costantemente senza perdere le conoscenze precedentemente acquisite.

Approcci di apprendimento ibridi: Potremmo vedere la retropropagazione combinata con altri paradigmi di apprendimento, come l'apprendimento per rinforzo o gli algoritmi evolutivi, creando sistemi di IA più robusti e versatili.

Intelligenza emotiva e sociale: Le future tecniche di backpropagation potrebbero aiutare i sistemi di IA a comprendere meglio e a rispondere alle emozioni umane, portando potenzialmente ad assistenti di IA più empatici e socialmente intelligenti.

**Adattamento all'ambiente: Poiché i sistemi di IA vengono impiegati in ambienti diversi e imprevedibili, nuove forme di backpropagation potrebbero consentire un rapido adattamento a condizioni mutevoli, cruciale per applicazioni come i robot di risposta ai disastri o i sistemi di monitoraggio del clima.

Formazione etica dell'intelligenza artificiale: I futuri algoritmi di backpropagation potrebbero incorporare considerazioni etiche direttamente nel processo di apprendimento, contribuendo a creare sistemi di IA non solo intelligenti, ma anche allineati con i valori umani e le norme sociali.

Questi potenziali progressi suggeriscono un futuro in cui la retropropagazione si evolverà oltre la sua forma attuale, continuando a guidare l'innovazione dell'IA in modi che stiamo solo iniziando a immaginare. Come per tutte le previsioni tecnologiche, alcune di queste potrebbero concretizzarsi, mentre altre potrebbero lasciare il posto a sviluppi del tutto imprevisti. Ciò che è certo è che i principi alla base della retropropagazione continueranno a plasmare la traiettoria dell'IA per gli anni a venire.

Rilevanza interdisciplinare con i database vettoriali:

L'influenza della backpropagation si estende a numerose discipline, con i database vettoriali che svolgono un ruolo di supporto fondamentale:

Neuroscienze cognitive: Simulazione dei processi neurali per comprendere la cognizione umana.

Linguistica computazionale: Rivoluzionare l'elaborazione e la generazione del linguaggio.

Visione artificiale: Migliorare l'interpretazione delle immagini per l'imaging medico e i veicoli autonomi.

Bioinformatica: Previsione di strutture proteiche e funzioni geniche.

Finanza: Alimentazione di modelli predittivi per le tendenze del mercato e la valutazione del rischio.

Robotica: Aiutare i robot ad adattarsi a nuovi ambienti.

Scienza dei materiali: Prevedere le proprietà dei materiali e progettare nuovi composti.

Scienze del clima: Creare modelli climatici complessi e analizzare i modelli meteorologici.

Sistemi di raccomandazione: Affinamento delle preferenze degli utenti per la distribuzione di contenuti personalizzati.

Cybersecurity: Rilevare anomalie e potenziali minacce nel traffico di rete.

I database vettoriali migliorano queste applicazioni memorizzando e recuperando in modo efficiente i dati ad alta dimensionalità, fondamentali per le reti neurali addestrate tramite backpropagation. Questa sinergia consente un addestramento più rapido, un'inferenza più efficiente e la possibilità di lavorare con insiemi di dati più grandi e complessi.

Con la continua evoluzione dell'IA e dell'apprendimento automatico, le applicazioni interdisciplinari della retropropagazione, supportate dai database vettoriali, promettono di aprire nuove frontiere in una gamma sempre più ampia di campi, dall'informatica quantistica ai sistemi di IA creativi.

- La retropropagazione nelle reti neurali

- Che cos'è l'algoritmo di retropropagazione?

- Algoritmi di retropropagazione

- Comprendere l'algoritmo di backpropagation

- Un esempio di backpropagation nella pratica

- Vantaggi della retropropagazione nelle reti neurali

- Implementazione della retropropagazione in Python

- Applicazioni della retropropagazione

- Sfide e considerazioni:

- Implicazioni future:

- Rilevanza interdisciplinare con i database vettoriali:

Contenuto

Inizia gratis, scala facilmente

Prova il database vettoriale completamente gestito progettato per le tue applicazioni GenAI.

Prova Zilliz Cloud gratuitamente